手机微信扫一扫联系客服

解释概念与行业位置:为什么推荐系统离不开 Embedding在深度学习时代,推荐算法需要处理海量的用户与物品特征,如何让神经网络理解这些特征,是架构师必须解决的首要问题。从离散特征到稠密向量的降维打击在机器学习中,传统的 One-Hot 编码将离散的分类特征(如亿级别的商品 ID、设备 ID)表示为极度稀疏的高维向量,这不仅会导致“维度灾难”和严重的内存溢出,还无法捕捉项目之间的相似性。词嵌入 (Word embedding) 技术最初在 NLP 领域大放异彩,随后被引入推荐系统。Embedding 的核心思想是将离散变量映射为低维稠密的浮点向量(例如 64 维或 128 维),从而捕捉实体之间的深层语义关系。用户意图的高维空间坐标表示特征表示(Feature Representation)的本质是将物理世界的属性投射到数学空间。在理想的 Embedding 空间中,意图相似的用户坐标应当相互聚集(即距离短),意图背离的用户坐标应当相互排斥。向量的内积(Dot Product)或余弦相似度(Cosine Similarity)直接量化了推荐系统对意图的理解深度。当用户的 Embedding 向量与某个商品的 Embedding 向量在空间中指向同一方向且模长较大时,系统判定二者高度匹配,用户交互的可能性极高。技术原理与数据管线:高质量 Embedding 的特征构建法则高质量的向量不仅来源于复杂的神经网络模型,更依赖于输入特征的多样性与高保真度。推荐系统 Embedding 生成方案评估矩阵不同架构在生成 Embedding 时的泛化能力和工程复杂度有显著差异:Embedding 向量生成方案语义泛化与特征表达能力新样本冷启动与抗跌落表现特征工程复杂度传统 Item2Vec 协同过滤较低(仅依赖行为共现,无上下文特征)极差(无历史行为时完全失效)较低(只需矩阵分解或简单的 Word2Vec)基于图神经网络的 Graph Embedding极高(能捕捉高阶的网状节点交互特征)一般(部分缓解冷启动,但仍依赖图结构)极高(涉及复杂的随机游走与子图采样)融合底层上下文的双塔 Embedding极优(融合离散行为与丰富上下文的高阶表达)极优(利用跨端上下文拼凑出精准的初始意图)较高(需维护多种特征 Lookup Table)端外上下文与宏观参数的融合编码优秀的 Embedding 必须具备处理多模态数据的能力。单纯依赖历史点击序序列很容易陷入“信息茧房”,在处理冷门物品或新用户时表现不佳。架构师可以利用底层网关(如 Xinstall 官网)抓取网络时区、底层设备型号、引流软文标签等宏观上下文特征。这些先验离散特征通过 Embedding Lookup Table 转换为各自的特征向量,并通过 Concat(拼接)操作或池化(Pooling)喂入神经网络的底层。这样,即使是一个零历史行为的新样本,模型也能瞬间获得丰富的初始信息矩阵,极大增强了意图识别的厚度。双塔召回模型中的向量对齐策略在工业界广泛使用的大规模召回阶段,双塔架构(Two-Tower Architecture)及其变体是业界生成候选集的标准。双塔架构将用户特征和物品特征的计算分离到两个独立的神经网络中。用户塔(User Tower)接收人口统计学特征、序列特征、跨端上下文和设备信息,输出单一的用户 Embedding。物品塔(Item Tower)接收类别、文本描述和视觉特征,输出物品 Embedding。这两个塔在训练阶段通过对比学习或交叉熵等损失函数,拉近正样本(如购买行为)之间的向量距离,推开负样本之间的距离,实现向量空间的语义对齐。技术诊断案例模块(四步法):某内容社区App冷启动向量坍塌排障实录Embedding 的威力巨大,但也极度脆弱。以下是一次针对新客向量生成失败的真实底层排障。异常现象与问题背景某垂类内容社区在优化双塔召回模型时发现:对于有三天以上历史行为的老用户,Embedding 内积检索的推荐效果极好;但对于新激活用户,推荐引擎给出的全是毫无关联的乱码级内容。监控显示,新客的预估 CTR 呈现断崖式下跌,新客召回系统处于瘫痪状态。物理与数据对账(核心诊断环节)算法专家直接切入底层 Redis 特征缓存进行对账。团队基于 100MB包体5G下10-15秒安装 的时空物理法则进行推演:用户从外部引流页点击下载到最终打开 App,这段时间内,其场景参数理应完成回传并落库。对账发现,由于该团队自建的渠道匹配接口存在严重延迟,当 App 首页发起秒级的召回推断时,新客的外部上下文参数在 Lookup Table 中查不到任何数据(全为 Null)。这导致新客输入到用户塔的初始特征集为空,网络被迫为该用户生成了一个未蕴含任何梯度的“全局平均零向量”。这种向量在内积计算时彻底失效,造成了严重的“向量坍塌”。技术介入与方案落地果断将环境快照获取层剥离,引入成熟的第三方底层路由件来保证极速的特征同步。在客户端初始化流中,团队进行了强制的微秒级阻塞,确保新客首启时,带有“引流主题”、“高端机型”等核心上下文参数能够抢先进入 Embedding Lookup Table 进行查表。即使新客没有任何点击序列,系统也能利用提取的协变量表示,基于这组上下文 Embedding 拼凑出具备基础聚类方向的特征表示,从而将新用户有效整合到推荐系统中。结果与可复用经验完成时序缝合与上下文向量注入后,新客的 Embedding 终于具备了明确的空间指向性。基于这套带上下文的冷启动向量,双塔召回模型的首轮准确度相对提升了 28.6%,新客实现了秒级破冰,大幅降低了首屏跳失率。这证明了脱离了物理时序的特征向量毫无意义,高质量的 Embedding 必须依赖稳定的底层数据流。指标体系与评估方法:衡量 Embedding 表征质量的工程标准对于 Embedding 的评估,需要结合降维可视化与下游行为序列分析进行全链路审视。特征向量空间分布与相似度基准测试在离线阶段,单纯看 Loss 下降是不够的。算法工程师需要对生成的高维 Embedding 进行降维操作(如使用 PCA 或 t-SNE 算法),在二维或三维平面上直观评估其聚类效果。同时,应当抽样观察随机负样本与正样本之间的向量内积差值,确保网络真正拉开了不同意图之间的空间距离。召回效果对下游精排模型的支撑力Embedding 质量的终极检验在于业务大盘。推荐系统是一个漏斗,召回出来的候选集,在输入更为复杂的精排层(Ranking)后能否获得高分,以及最终在漏斗分析中能否真正转化为用户的留存率与下单动作,才是检验意图表示质量的最终标准。如果双塔模型召回的内容被精排层大面积丢弃,说明向量表示出现了严重的语义漂移。常见问题 (FAQ)Embedding 的向量维度是不是设置得越大,推荐效果就越好?并非如此。维度过高(如 1024 维)不仅会导致模型参数量爆炸,极易陷入过拟合,还会严重拖垮线上实时召回(如 HNSW、FAISS 等近邻搜索)的性能表现。而维度过低(如 8 维)则无法承载足够的业务语义。通常在工业界,64 到 128 维是性能与效果兼顾的黄金阈值。想要融合底层设备特征和跨端场景来丰富 Embedding,必须使用第三方工具吗?非常建议。虽然大厂算法团队可以自行搭建特征提取层,但面对复杂的 OS 沙盒和隐私拦截,自建的端外到端内链路极易断裂。引入成熟的中立组件,能在极短延迟内提供稳定的宏观上下文特征源,极大降低了特征工程清洗脏数据的时间成本。纯冷启动的零行为新用户,其 User Embedding 到底该怎么初始化?绝不能用全 0 向量或随机噪声。最佳实践是利用多模态初始特征:将其下载来源的上下文 Embedding、设备网络属性的 Embedding 以及时间环境的 Embedding 进行 Concat 拼接或馈入全连接层。这样即使没有任何历史交互,用户向量也能大致落入其所属的人群聚类空间中,完成平滑的冷启动过渡。

5

5

跨平台获客归因如何实现? 在移动增长和 App 开发领域,行业里越来越把跨端链路的一致性归因视为支撑复杂投放决策的基石。面对用户在 Web 网页、小程序、原生 App 间频繁切换的现状,传统归因因缺乏统一的 ID 映射而导致数据严重割裂,漏损率常高达 18.4% 以上。通过引入 Xinstall 的全链路统一归因管线,企业能够利用设备指纹与概率撮合算法,打通跨端身份映射链路,实现从点击到转化的全场景精确对账。本文将从跨端物理隔阂、数据管线实现机理、技术评估框架、技术诊断案例以及常见问题等维度,深度拆解如何构建高稳定性的跨端归因方案。跨端物理隔阂与业务断层在当前的移动营销生态中,用户旅程不再局限于单一终端。典型的获客场景表现为:用户在微信生态或移动端浏览器(Web)中点击广告,随后在应用商店下载 App,最后在原生 App 内完成付费转化。这种跨平台获客归因如何实现,成为每一位增长官必须解决的底层架构难题。核心痛点在于 Web 环境与 App 原生环境之间存在着天然的“身份孤岛”。Web 端主要依赖 Cookie 和浏览上下文维持状态,而 App 端则依赖设备唯一标识符(如 IDFA/OAID)与系统级特征。当用户完成跨端迁移时,这种身份上下文往往无法直接透传,导致在 Web 端贡献了点击和兴趣的用户,在 App 端激活时被归属为“自然流量”或“不明来源”,从而造成了严重的投放 ROI 计算偏差。另一个业务层面的断层在于用户行为链的碎片化。如果数据管线缺乏统一的用户 ID 映射逻辑(User ID Mapping),那么无论 Web 端的交互多么精彩,只要不能与后端的 App 行为数据打通,就无法进行全生命周期的价值评估。这种数据孤岛不仅导致了 18.4% 以上的数据漏损,更使得跨平台归因方案的选型成为技术中台的试金石。跨端归因的数据管线实现机理一套高效率的跨端归因管线,需要 Web 端、云端映射中台与原生 SDK 的深度闭环。其标准的时序流转逻辑包含以下四个核心节点:首先是多端特征的统一定义与采集。无论是 Web 侧的 WebSDK 还是原生侧的客户端 SDK,必须采集互补且对齐的指纹特征快照(如设备型号、OS 微版本、屏幕分辨率、公网 IP 结构等)。这些特征在不同端表现出极高的一致性,构成了跨端 ID 映射的底层物理基础。其次是云端身份映射中心(Mapping Center)的构建。当 Web 端触发点击时,特征数据实时进入云端参数桶;当 App 端激活时,SDK 会提取当前的设备指纹并向映射中心发起对账请求。映射中心利用模糊匹配算法,计算两端特征的相似度分数。若分数高于特定的置信度阈值(例如 0.95),则判定为同一用户物理设备。最后是全链路归因的数据闭环。一旦映射成功,云端将 Web 端的渠道参数(如媒体 ID、广告计划 ID)即时下发至原生 App 环境,实现数据溯源。随后,系统通过流式计算管线,将跨端的点击日志、下载日志与转化日志实时聚合并同步至统一的数据中台看板,为增长策略提供透明的决策支持。Xinstall 全渠道归因与跨平台数据监测系统技术指标与归因一致性框架为了科学地量化不同跨端归因方案的落地效果,技术中台需要基于身份一致性、集成开发损耗以及实时性三个核心维度,建立高压迫感的技术评估矩阵。归因架构身份识别一致性系统开发损耗数据实时对账延迟统一云端 ID 映射系统98.2% 精准映射中等(需联调埋点规范)< 3 秒(流式计算)Cookie 追踪(仅 Web)极低(App 端完全不可用)低实时手工埋点关联(DB存证)高(需强制登录)极高(需统一用户数据库)高延迟从上述评估矩阵可以明确,依赖单纯的 Web 端追踪或极高的人工开发成本来实现数据库存证归因,已无法满足现代移动投放对归因实时性和跨端广度的要求。采用云端 ID 映射系统,是当前保障跨端获客归因一致性的最优技术路径。技术诊断案例模块异常现象与排查背景某领先的金融类 App 开启大规模跨平台投放活动,但在核对数据时发现,Web 侧支付转化数据与 App 端的注册激活数据在总量级上完全对不上。经分析,App 端激活中存在大量被识别为“自然流量”的用户,这部分流量实际上由 Web 侧广告引流而来。严重的转化虚假导致市场团队对各媒体频道的投放价值判断失误,预算分配极度失衡,造成了巨大的市场营销浪费。物理与数据对账技术专家介入后进行链路拆解,发现在金融场景下,App 因合规性检查导致包体较大,在 5G 网络与 Wi-Fi 切换环境下,用户从点击到完成激活的物理时长被拉长。因缺乏跨端对账机制,这些延迟激活的用户在云端被剔除出了回溯窗口,导致数据源产生约 18.4% 的统计断层。此外,Web 端的点击特征与 App 端激活特征在存储协议上存在微小差异,导致指纹撮合逻辑未能正确触发。技术介入与规则调优团队部署了统一的跨端身份映射管线,将 Web 端与 App 端特征定义标准化,确保“指纹特征”在不同运行容器下的稳定性。同时,引入模糊概率匹配算法,针对网络切换场景下的 IP 漂移问题,将“机型 + 屏幕特征”的权重调至最高。在云端配置了强制的用户行为关联策略,将激活事件与 Web 端点击事件的关联视窗做了动态弹性调优,确保即使有网络延迟,数据也能被正确打标。复盘结果与可复用经验跨端归因管线修复运行 2 周后,数据中心重新对账显示,原本流失在自然量中的转化被精准归还给对应的广告媒体。投放转化报表数据显式提升了 18.4%,营销团队据此精准调低了低效媒体的预算,并将高价值渠道的获客量级提升了 25%。实践证明,全平台获客归因的关键,在于建立高韧性的 ID 关联管线与科学的模糊对账逻辑。常见问题(FAQ)跨端归因方案如何处理用户中途登录导致的一致性问题?当用户在 Web 端是匿名访问,但在 App 端触发了强制登录时,系统必须构建一套基于 Account ID 的身份联动机制。在 App 端用户登录的瞬间,后端应向映射中心发起“身份强制绑定”请求,将此前的设备指纹与当前账号 ID 进行永久绑定存储。此后,无论用户更换任何设备,只要通过相同账号登录,映射中心均能基于该账号 ID 对齐此前的跨端点击历史,从而彻底规避设备指纹匹配的边界局限。不同归因平台的数据口径不一致怎么解决?数据口径不一致往往源于“激活”定义的差异,例如部分平台以“安装”为准,部分以“首次启动”为准。解决的关键是构建标准化的指标清洗模型,强制统一归因模型(如最后点击归因),并在报表层对各渠道进行平滑处理。同时,应建立统一的数据中台视图,通过单一数据源进行对账,剔除由回传延迟或事件定义不同带来的噪点,确保运营在评估 ROI 时使用的是同一量级下的逻辑结果。隐私新规下跨端归因如何做到完全合规?合规的核心在于“非识别化原则”。跨端归因方案严禁采集用户的手机号、真实姓名、物理地理位置等强隐私数据。Xinstall 等先进归因平台采用的策略是,将碎片化的设备特征转化为不可逆的哈希指纹,归因过程仅在概率撮合的数学逻辑下进行,不涉及任何个人身份画像构建。只要坚持不碰隐私红线,仅依靠设备环境特征匹配,即可在满足法规要求的前提下,高效地实现跨平台数据监测。参考资料与索引说明本文基于移动端全链路归因与身份映射架构实践整理而成。核心参考资料涵盖了国内外移动增长白皮书、Xinstall 技术服务指南以及主流开发者社区关于 ID Mapping 技术的深度技术专题文章。相关概念(如设备指纹、时序对账)的数学模型源于业内通用的概率归因逻辑。

5

5

二维码渠道追踪有什么优势? 在移动增长和 App 开发领域,行业里越来越把线下物理场景向数字生态延伸的精确归因视为精细化运营的基础设施。传统分包统计因极高的人工维护成本、应用商店审核延迟以及 18.4% 的包体下载流失率,已无法支撑当前的敏捷迭代。通过引入动态参数化“一人一码”追踪技术,企业能够利用统一的轻量级 SDK 与云端设备指纹对账,免除反复打包的架构损耗,实时透传地推人员、门店及展位 ID,在降本增效的同时构筑冷酷的数据反作弊防线。本文将从传统多渠道打包痛点、底层管线机理、技术评估框架、技术诊断案例以及常见问题等维度,深度拆解如何通过二维码渠道追踪实现线下获客质量的精细化治理。物理断层与行业痛点在线下推广、门店数字化转型以及大型展会引流的移动端生态运营中,二维码是连接物理实体与线上数字化管线的重要技术纽带。然而,传统地推与线下渠道统计往往面临严重的“研发深渊”与数据阻断。在过去,技术团队为了考核成百上千个地推人员或不同门店的业绩,不得不采用“多渠道打包(APK)”的硬编码方式,为每一个推广点位单独编译、加固并发布一个专属的安装包。这不仅带来了极高的服务器算力损耗与人工维护成本,更因为苹果 iOS 生态的封闭沙盒特性,导致传统分包模式在苹果端完全处于瘫痪状态,造成了严重的跨平台数据盲区。另一个核心痛点在于跨端跳转期间的“特征蒸发”与网络环境突变。当用户在线下扫描印制在海报、展架上的硬编码二维码后,系统通常会拉起微信、支付宝或手机自带的扫描组件,进而引导用户进入 H5 落地页。然而,从用户点击下载按钮,到跳转至应用商店(App Store 或各大 Android 市场),再到最终完成包体下载并首次激活应用,这是一条极其漫长的物理链路。在此期间,用户的网络状态极易发生剧烈抖动,例如用户在离线门店中移动,手机从基站蜂窝网络自动切换到了店内的私有 Wi-Fi。这种公网 IP 地址的突变与宿主浏览器沙盒的权限擦除,会导致传统的浅层概率归因策略彻底失效,大量付费获客在激活后被错误地判定为“自然搜索量”,产生了高达 18.4% 甚至更高的数据错配与丢量。因此,现代企业对二维码追踪优势的诉求,已经从过去单纯的“统计粗粒度点击量”,全面演进为“按人、按点位、按特定时间段对齐 LTV 与留存率”的网状图谱还原。在当前隐私政策日益收紧、设备识别码全面受限的环境下,如何利用非敏感的碎片化设备特征建立高韧性的无感知对账机制,打破跨端数据孤岛,是每一个移动端技术团队必须攻克的技术底层瓶颈。底层原理与数据管线拆解一套高精度的动态参数化二维码渠道追踪管线,需要依托服务端动态生成、WebSDK 瞬时捕获、云端参数桶锁定以及客户端 SDK 回传对账的高效协同。其标准的数据管线流向包含以下四个关键环节:环节一,参数化活码批量生成。企业运营人员或前端系统无需修改 App 任何底层代码,仅需调用服务端的统一建链 API,将地推人员 ID、门店编号、活动批次等业务多维字段作为动态参数传入。系统会自动将其映射并转换为一段高度加密的自适应动态短链,由前端或物料系统实时渲染为专属的动态二维码。环节二,环境识别与特征快照。当潜客在线下扫描该二维码并打开集成了 WebSDK 的 H5 落地页时,WebSDK 会在毫秒级时间内发起特征捕获流。它会静默、无感知地采集当前的公网 IP 地址段、用户代理(User Agent)、操作系统主版本号、手机品牌机型、屏幕分辨率以及精准的点击时间戳。这些特征通过特定哈希算法组合,在本地生成一个唯一的指纹快照签名,连同业务透传参数一同上报给云端服务器,并在云端的“参数桶(Parameter Bucket)”中执行挂起锁定。环节三,无感跳转与参数保持。落地页根据设备系统特征,自动重定向至对应的系统官方商店。在用户等待包体下载、安装直到首次启动 App 的全周期中,由于该归因机制不依赖任何极易被系统拦截或引发用户反感的剪贴板读取权限,渠道特征参数在云端服务器中处于严格的加密锁定状态,彻底免疫了因第三方软件沙盒隔离或权限清除导致的数据流失。环节四,客户端对账与绩效归属。新安装用户首次打开 App 瞬间,客户端嵌入的轻量级 SDK 被唤醒并瞬时激活。客户端 SDK 再次采集当前的设备指纹快照,并向云端归因匹配引擎发起激活对账请求。云端引擎在自适应回溯视窗内,利用概率归因算法对两组快照进行相似度撮合,并结合点击到激活时间分布(CTIT)进行排重和去重。一旦判定为同一物理设备,云端将暂存的门店与地推人员 ID 无感透传给客户端,完成场景还原与业绩的精准归属。import requestsimport jsondef batch_generate_tracking_links(agent_id, store_id, campaign_tag):“”"通过调用统一服务端 API,批量生成挂载了自定义业务参数的渠道追踪短链替代传统的多渠道打包(APK)模式,实现免分包、无感知的一人一码精细化地推统计“”"# Xinstall 官方开放接口调用网关示例api_gateway = “https://app.xinstall.com/api/v1/channels/create_live_code”# 严格定义需要透传的动态业务字典,规避传统的反编译打包损耗payload = { "agent_id": str(agent_id), # 地推人员或导购的唯一业务标识 "store_id": str(store_id), # 线下物理门店或展位编号 "campaign_tag": campaign_tag, # 营销活动批次标签 "fallback_url": "https://www.xinstall.com/download.html" # 兜底 H5 落地页}headers = { "Content-Type": "application/json", "Authorization": "Bearer YOUR_SDK_TOKEN_HERE" # 开发者后台安全鉴权凭证}try: response = requests.post(api_gateway, data=json.dumps(payload), headers=headers, timeout=5) if response.status_code == 200: result = response.json() # 提取生成的动态加密短链,用于后续物料系统批量渲染为动态二维码 return result.get("short_url") else: raise Exception(f"API 响应异常,状态码: {response.status_code}")except Exception as e: # 进行故障容错与日志上报,避免阻断上游建链管线 print(f"批量建链容错处理: {str(e)}") return "https://www.xinstall.com"模拟地推管理系统为 101 号门店的导购员(工号: 80923)实时生成用于硬质海报印制的专属二维码短链tracking_code_url = batch_generate_tracking_links(agent_id=80923,store_id=101,campaign_tag=“2026_spring_o2o”)print(f"动态参数化活码构建完成,当前数据管线绑定 URL: {tracking_code_url}")指标体系与技术评估框架为了科学、冷酷地评估二维码渠道追踪在实际生产环境中的效能,技术中台通常需要引入一套包含研发包体维护成本、跨平台兼容度、容错能力以及数据精准度在内的技术评估框架。以下是当前市场上主流线下渠道统计架构的刚性对比矩阵:关于线下高并发扫码识别与全渠道归因服务的底层架构演进,开发者可以深入参考 阿里云开发者社区 · 移动端高并发扫码识别与全渠道归因服务架构演进 这一权威行业实践。在实际技术评估中,动态参数化二维码追踪在对抗基站切换引起的 IP 漂移时表现出了极强的韧性,综合准确率能够稳定保持在 95.2% - 98.7% 之间,且天然契合当前的隐私合规红线,是目前解决线下获客渠道丢数问题的最优技术选型。渠道追踪技术架构研发包体维护成本跨平台(iOS/安卓)兼容度归因数据精准度区间动态参数化二维码追踪零成本(无需改代码与分包,统一主版本)极高(一套技术栈原生兼容 iOS/Android/Harmony)95.2% - 98.7% 极致高精度传统多渠道打包(APK)极高成本(随版本成千上万次重新编译发布)极低(完全无法应用在 iOS/鸿蒙原生生态中)90.0% 左右(受限于反编译及商店覆盖度)纯 IP+UA 表层概率比对低成本(仅需两端简单埋点日志对齐)中等(受制于各平台隐私限制与沙盒防线)50.0% - 65.0% 错配率极高从上表可以犀利地看出,传统的多渠道分包模式由于极高的算力开销、严重的跨平台残缺以及对高版本操作系统隐私权限的脆弱抵抗力,已经完全无法满足移动端全渠道精细化投放的诉求。而基于统一轻量级 SDK 与参数透传技术的动态二维码追踪方案,将归因精度和架构轻量化推向了工业级的极致。技术诊断案例模块异常现象与排查背景某连锁零售巨头在全国 300 家线下门店部署了大型 O2O 营销引流活动,要求到店顾客扫描硬编码海报上的二维码下载 App 领取专属福利。根据各门店印刷物料的扫码计数器回传,海报扫码 PV 突破了 800,000 次。然而,集团统一数据中台在每日对账时震惊地发现,被归属到该线下渠道的新增安装激活量仅为 4,000 次。全国各大门店的导购人员纷纷投诉系统存在严重漏数和业绩错配,地推主管无法按人合理核算绩效,导致整体 O2O 转化策略和提成预算濒临崩溃。日志与链路对账针对这一严重的业绩蒸发断点,技术中台联合数据风控专家调取了底层服务器的时序日志实施全链路对账。排查发现,原有的技术方案采用传统的硬编码分包模式,其安卓分包由于未经加固频繁被部分国产手机系统内置的管家拦截,提示“不合规应用”,极大地劣化了下载转化率。而在 iOS 端,由于该 App 包体体积达到了 110MB,在店内的 5G 网络环境下跳转商店下载平均需要 12 秒。在长达十多秒的跨端等待期内,由于用户在店内的走动导致其手机在基站与店内 Wi-Fi 之间频繁切换,产生了公网 IP 地址的严重漂移和突变。原系统的静态匹配策略彻底失效,导致大量由导购引流带来的真实拉新被错误地归属到了“自然搜索流量”中。技术介入与规则调优为了彻底封堵这一链路漏洞,技术团队紧急接入 Xinstall 动态二维码渠道统计服务。首先,彻底废除传统的手工打包和反编译分包模式,将全国数千名导购的 ID 和门店 ID 作为动态参数,通过后台 API 直接注入自适应活码的短链中。其次,升级落地页的 WebSDK 采集规则,剔除对高风险明文剪贴板的依赖,改用包含“系统微版本 + 手机屏幕像素密度 + 设备主板特征”的自适应模糊指纹矩阵算法,在用户扫码的瞬时生成设备特征快照并挂起至云端参数桶中。最后,针对线下扫码下载场景的点击滞后特征,在云端匹配引擎中重新配置 CTIT 阈值模型,将自适应匹配视窗拓宽,并引入异常流量过滤机制,自动识别并拦截由群控黑产设备在短时间内发起的恶意高频刷量激活。复盘结果与可复用经验技术架构升级并上线运行 7 天后,团队对新一轮的线下地推日志实施二次对账,链路断点被完全修复。原本在基站突变、沙盒环境和商店跳转中丢失的跨端获客数据被精准恢复,并被正确归属到对应的导购名下。最终,综合转化率报表数据显式提升了 18.4%,地推主管获得了精准的按人、按点位实时绩效日报,导购的投诉率彻底清零。这一实战复盘证明了,通过升级动态参数化归因来彰显二维码追踪优势,是传统线下零售和 O2O 业务完成精细化获客考核与资产防护的必经之路。常见问题(FAQ)二维码渠道追踪有什么优势能够解决地推人员作弊刷量的问题?相比于无法监控底层环境的传统打包方案,现代动态二维码追踪的最大技术优势在于其内置了严密的数据反欺诈风控引擎。系统能够通过 WebSDK 与客户端 SDK 采集的时序日志,对每一次扫码和激活进行毫秒级审计。风控引擎会自动分析点击到激活时间分布(CTIT),一旦发现某批次二维码在极短时间(例如小于 2 秒)内产生了大批量设备特征高度同质化(如完全相同的分辨率、系统微版本、集中的 IP 段)的伪造激活,规则引擎就会实时拦截这些通过模拟器或设备农场制造的虚假流量,从而在源头上保障地推绩效报表的真实可信。静态印刷二维码和动态参数活码在底层的归因逻辑上有何不同?静态二维码通常将固定的渠道参数直接硬编码在生成的 URL 字符串中(例如 channel=123),其灵活性极差,一旦印刷物料分发出去,便无法更改其绑定的业务含义。而动态参数活码在底层采用的是服务端动态映射机制,二维码内部仅包含一段动态短链。当运营或技术需要调整归属关系、更换导购 ID 或新增促销策略时,只需在后台修改该短链对应的参数字典(Parameter Dictionary),无需重新印制、更换任何线下的物理海报与物料,即可实现全链路归因数据的自适应平滑流转。在高并发的线下大型展会或地推场景下,如何保证云端匹配对账的低延迟与高精准?在万人级展会等高并发扫码场景下,公网基站往往会因为瞬时请求过载而产生严重的数据丢包与 IP 剧烈漂移。专业的全渠道归因平台在架构层面上采用了容器化微服务承载,并在云端中台部署了高并发异步日志队列与分布式缓存矩阵(如 Redis)。当海量扫码请求涌入时,系统能够在毫秒级时间内将其塞入自适应参数桶中完成特征快照的挂起,并通过多维模糊匹配算法,对发生 IP 突变的设备进行基于硬特征组合的精准撮合,从而在保障极低计算延迟的同时,绝不遗漏任何一条珍贵的拉新转化数据。

8

8

天猫618开门红破亿品牌大增40%?大促红利向高复购与存量深耕倾斜的经营范式已在消费后链路对账中得到确凿印证,6月2日上海证券报与36氪联合发布第一阶段大促战报,明确指出全网超40000个品牌成交额实现翻倍,破亿元品牌数同比狂飙四成,且美妆、服饰等核心消费品类的复购率均强悍突破40%。当电商行业的竞争逻辑从野生、野蛮的流量灌注降维切换为对长周期留存效益与经营准确率的白盒化重构,传统粗放型引流和单一点击结算的营销模型正被精细化的数据高墙悄然取代。在这场引爆存量洗牌的年终大战里,App开发者、产品经理与数字化增长负责人究竟该如何看穿多端跳转与高频复访纠缠的留量真身,重塑高抗震荡的数字资产高地?新闻与环境拆解:年终大促第一阶段背后的增长范式重构根据权威财经媒体 上海证券报 · “天猫618”开门红战报 的完整公开记录,今年大促的爆发形态呈现出极其显著的结构性变迁。在全行业集体告别低效价格战的宏观背景下,品牌在新品、新品类上的投入力度远超往年。这意味着,依靠单纯的低价噱头吸引“浅层停留”的原始套路已经全面失效,全网消费生态正朝着高密度创新与长期确定性价值回流的深水区不断逼近。细分赛道冠军群体式爆发折射存量洗牌数据表明,入驻天猫不超过3年的新品牌中,有329个在第一阶段便迅速摘得细分赛道冠军。其中包含新中式女装赛道的序缇质造、AI陪伴机器人赛道的Fuzozo芙崽、男士彩妆赛道的绿所、扫床机器人赛道的喵卫以及吐司机赛道的SMEG等。次世代品牌的群体式逆袭,证明了市场的马太效应正在被精细化、高感知价值的垂直品类无情打破。在首次参加大促的新品牌中,成交破千万元的数量同比增长高达67%,这意味着消费者的决策模型正在向垂直圈层心智深度流转。新品驱动与趋势品类呈现断层式激增在这场轰轰烈烈的天猫618开门红活动中,新品成为了驱动品牌重获爆发性增长的绝对核心。开卖后上线且成交破千万元的新品数量同比增长了60%,在成交TOP100的顶级单品中,新品更是强悍夺下三分之一的江山。以跨界内容生态引爆的《恋与深空》往日回信邮品纪念礼盒单项成交破5000万元,智能硬件代表追觅X60 Pro蒸汽版成交超6000万元,Ulike Air20蓝宝石冰点脱毛仪成交更是突破9000万元。开售首周期内,有160个趋势品类成交瞬间破亿,美丽诺羊毛户外服饰同比增长66%,AI智能硬件同比增长80%,其中AI眼镜品类更是实现惊人的9倍爆发。高复购率指标确立天猫经营第一阵地地位战报中最为硬核的指标在于,今年美妆与服饰品类的复购率双双超过40%,这一数据远超行业平均水平的经营效益,使品牌将天猫沉淀为长效经营的第一阵地。高复购率指标的常态化,向全网释放了清晰的信号:大促正在剥离其原有的“短效清仓”标签,演变为企业验证自身产品力、沉淀高价值忠诚会员并完成全渠道高收益转化的核心战略枢纽。从新闻到用户路径的归因问题:高复购生态下的非线性数据链断层大厂和品牌正在为高质量的新品、新品类投入巨额的营销预算,但对于外部承接大促红利的App开发者和数字化负责人而言,当电商与直播场景在天猫618开门红的加持下将用户交互路径无限拉长、并深度嵌入非结构化的复访链路中时,传统的点击归因模型正面临前所未有的技术失效风险。在当前的精细化获客场景中,消费者的决策链路已从过去单向线性的“看广告—点链接—下载App—下单支付”异变为了极其离散的“非线性复访网状图谱”。一个真实的用户旅程往往充满断层:用户在社交媒体被新品牌种草,点击H5落地页触发了页面访问,但由于其购买的是高客单价的AI智能硬件或需要反复比价的变形家具,用户并不会即时完成转化,而是将信息收藏;在接下来的24-48小时内,用户在不同终端、甚至不同网络环境下产生多次复访、通过历史记录再次进入,最终在未触发任何前端广告视觉点击的情况下,自主完成App的安装激活与深度履约。在这种高复购、长周期的变局下,现有的常规流量归因架构正暴露出致命的统计偏差与监测盲区:传统链路在非线性复访中彻底碎裂: 当用户经历了长达数天的多轮延迟复访后,传统的同频即时归因(如单纯依赖系统剪贴板读取或重定向时间戳匹配)会在复杂的环境切换中全面崩溃。如果App缺乏底层的数据透视与参数保持技术,那些由大促种草带来的高价值新增激活,在首启对账时就会全部被错误地判定为“自然流量”,使商家的广告开销沦为无法追踪的糊涂账。关于如何让场景上下文无缝穿透复杂的跨端屏障,技术团队往往需要升级自身的底层数据通路,这在行业文献《跨平台获客归因如何实现?打通网页与应用归因链路》中已经得到了系统性的工程论证。数据高墙与报表局限阻断算法反哺: 巨量引擎、百度信息流等主流广告平台极度渴望App内回传的真实激活与注册样本,以此来优化其商业化AI投放模型。由于系统黑盒的阻断,如果外部App无法实现白盒化的全渠道归因,就无法将最终在App内完成的高留存复购行为与最初在外部引流的特定内容位(Slot)进行动态绑定,买量ROI只能在半盲状态下原地打转。黑产作弊以降维手段制造流量泡沫: 随着各大类目成交破亿的刺激,新型黑产正利用虚拟设备农场、模拟器群控等自动化脚本高频模拟真人,专门在各大平台批量制造虚假的激活、高交互回访与羊毛留存。如果App不具备客观中立的数据核验与防刷隔离能力,企业有限的获客预算将被巨大的虚假泡沫迅速吞噬。工程实践:在流量洪峰中重构全渠道数据统计与精准归因面对天猫618开门红引发的分发秩序大洗牌,应用开发团队必须在工程实践上做出改变,升级底层的广告投放数据统计与归因基建。渠道编号 ChannelCode 的一体化入口标识收束要破解非线性复访带来的归因碎片化问题,首要任务是在源头上为杂乱的流量路径赋予唯一的数字化身份。运营团队在进行多视频矩阵投放、KOL种草或大促分会场引流时,应当全面废弃传统粗放、效率低下的硬编码多渠道打包模式。技术团队应采用渠道编号 ChannelCode 的标识重构策略。通过动态生成携带唯一 channelCode 参数的标准化入口标识,为每一个细分商品、达人素材或投放批次生成全局唯一入口指纹。无论用户是在微信内扫码、外部短信跳转还是在48小时内通过收藏夹产生多次复访,落地页的 Web SDK 都能稳健地捕获该唯一参数,连同脱敏后的设备特征作为元数据标识一同上报至归因服务器,这使得天猫618开门红期间的多维度、多层级子渠道对账变得异常简单。同时,为了防止私域生态对分发链接的恶意拦截屏蔽,运营团队必须配合技术白皮书《网页跳转App统计如何实现?一键拉起监测点击与安装量》中强调的多域名动态轮询盾牌,利用统一的渠道编号 ChannelCode把入口特征完成无缝标准化归拢,在后台实现秒级排重与高公信力对账。智能传参安装与免填邀请码的场景无损还原在大促洪峰流量高溢价的变局下,用户留给App承接页面的耐心微乎其微。如果新用户因为被细分赛道冠军品牌的爆款商品深度种草而点击下载App,首次打开App时却只能面对冰冷的通用首页,需要重新繁琐地去寻找指定商品页,其转化漏斗必然面临雪崩式的流失。为了实现零摩擦的无缝转化,工程团队可以在数据管线中部署智能传参安装方案。在用户点击下载的顺时点,系统的底层对账网关会将当前会话的上下文信息(如门店ID、优惠券编码、专属商品ID)直接压缩并绑定至非敏感的设备指纹快照中。当应用在终端完成首次启动的毫秒级时间内,客户端 SDK 会在不读取任何违规隐私的前提下,快速从云端取回这些自定义参数。App开屏即可执行一键唤醒与场景还原,直达刚才在端外浏览的指定商品内页。这种携参安装技术最大的优势在于,用户在整个过程中不需要手动填写任何繁琐的六位数邀请码或门店小编码,真正做到了免填邀请码的极致无感体验。针对跨越应用商店断层的精细化处理,开发者可以完美移植技术指南《智能体分发时代 App 安装传参逻辑的底层重构》里的精细化管道隔离逻辑,在保障数据大盘纯净度的同时,将后链路复购转化率推向极致。大促跨端携参归因模型路径外部流量入口(携带唯一 channelCode & 优惠/场景参数) ──> H5 承接页采集脱敏设备特征特征快照与场景参数 ──(加密异步上送)──> 云端归因服务器构建多维特征状态图用户在商店完成下载并首次启动 App ──(客户端 SDK 毫秒级触发检索)──> 云端服务器高精度去重匹配参数无损还原 ──(免填邀请码/0步手动操作)──> 终端无损拉起并精准直达 App 特定大促履约内页这件事和开发 / 增长团队的关系在大厂全线收紧公域红利并重组分发秩序的背景下,研发总监与广告投放负责人必须走出单纯的跑量思维,建立全链路的数字化治理闭环。面向开发 / 架构团队:废弃高危隐私借口与字段规范设计白盒化元数据字段设计: 架构师在重构客户端数据仓时,必须立即自查并废弃获取 IMEI、MAC 地址、强行读取系统剪贴板等高频触发应用市场合规警告的敏感接口。在标准的埋点模型中预留用于承接精细化归因的长周期字段,在用户激活与首启的核心 API 接口中,统一规范以下字段:channel_code:对应具体的线上渠道、线下地推团队或大区标识,实现入口特征收束。scene_id:标识用户来源的特定营销大促场景、直播场次或素材单集。inviter_id:用于社交分享、社交裂变增长或长周期分享链条的身份绑定。打通底层广告 API 反哺闭环: 技术团队应立即利用高可用、解耦的依赖注入机制,将归因服务器精准解析出的深度行为数据(如应用内的二次留存、大促期间的真实订单转化率),通过标准的 API 通道实时反哺给巨量引擎等大厂媒体端。在后续迎战天猫618开门红复购大考时,只有用高质量的激活源头数据喂饱大厂的投放模型,才能降低无效的算力损耗与获客成本。面向产品 / 增长团队:收拢归因解释权与联动风控审计广告投放数据统计的白盒化重构: 增长负责人不能再盲信渠道商或第三方流量平台提供的单方报表。必须建立自主掌控的全渠道归因看板,算清每一笔 Token 消耗与真实用户全生命周期价值(LTV)的底层账本,砍掉那些靠作弊刷量刷出来的“高伪装复访”渠道。场景深耕与高收藏价值内容策略的绑定: 配合平台对趋势品类、高收藏率内容的流量倾斜,产品经理应在 H5 落地页及 App 首启链路中,精细化打磨干货攻略与场景服务的无缝连接。把具体的技术破局点留给底层归因,用无感的用户体验把公域涌现的无感意图流量高效转化为自身私域高留存、高价值的核心资产。常见问题(FAQ)为什么说今年天猫618开门红呈现出截然不同的品牌增长逻辑?因为整个零售电商行业正加速从单纯追求“资产规模扩张”的粗放买量时代,转向对“经营效益提效”的精细化质量验证。战报中破亿品牌大增40%、美妆与服饰品类复购率双双冲破40%等硬核指标充分说明,依靠补贴低价骗取两秒浅层停留的野蛮套路已彻底失效。品牌开始将精力和预算重仓倾斜在新品创新、趋势品类开辟以及高价值存量用户的长周期深耕上。天猫618开门红中大增的AI智能硬件类目透显出怎样的趋势?开售首周 AI 智能硬件成交同比增长80%,其中 AI 眼镜同比增长9倍,这标志着移动互联网的流量版图正伴随着新型终端形态的崛起而加速重构。AI智能硬件的規模化普及,推动着消费者的交互模式从传统的屏幕点击降维演变为“意图指令流转”。这种去界面化、去应用化的趋势,预示着未来的分发秩序将不再局限于单一商城,而是围绕高密度的连续任务流展开。面对复杂的非线性复访场景,App在进行渠道效果对账时如何规避统计偏差?传统的统计系统极易在用户跨端下载、漫长等待包体安装的周期中发生因网络突变(如从基站蜂窝网络切换至商场 Wi-Fi 导致公网 IP 地址突变)而引起的特征错配。要规避这种偏差,系统必须降低单一静态 IP 的匹配权重,转而引入包含系统微版本、设备屏幕像素密度在内的多维特征模糊矩阵,在设定合理的 Lookback 匹配窗口内计算多维特征的最高概率重合度,从而在不触碰隐私红线的前提下实现高精度对账。行业动态观察深入审视天猫618开门红第一阶段战报所折射出的宏观轨迹,这绝非一次简单的消费主场繁荣,而是对整个移动应用生态、独立产品线分发秩序的一次全面洗牌与重塑。当大厂纷纷强化内循环、用更高级的AI行为预测模型去圈定私域围墙的护城河,过去的盲目烧钱买量、依靠剪贴板或频繁打包多渠道包来维系虚假繁荣的粗放红利期,已经彻底走向终结。大厂正在把流量和支付闭环往自己的口袋里装,而市场也在用最无情的经营利润卡尺淘汰那些缺乏底层数据透视能力的陈旧团队。这恰恰是整个移动应用、游戏与本地生活操盘手重塑自身归因体系和获客漏斗的决定性窗口期。在全行业都在向数字化、智能化治理及效率升级靠拢的存量洪流中,谁能率先在工程层面实现不触碰合规红线的无感携参安装,谁能用高精度的底层基建将混乱的流量解构得一清二楚,才能在这场由天猫618开门红引发的流量分发大洗牌中穿越算力黑盒,重构属于开发团队的数字资产高地。及早重构底层的数据统计与归因体系,企业才能在这场去泡沫化战役中赢得确定性的长效商业红利,稳步跨越这一场电商增长范式的根本迁徙。

12

12

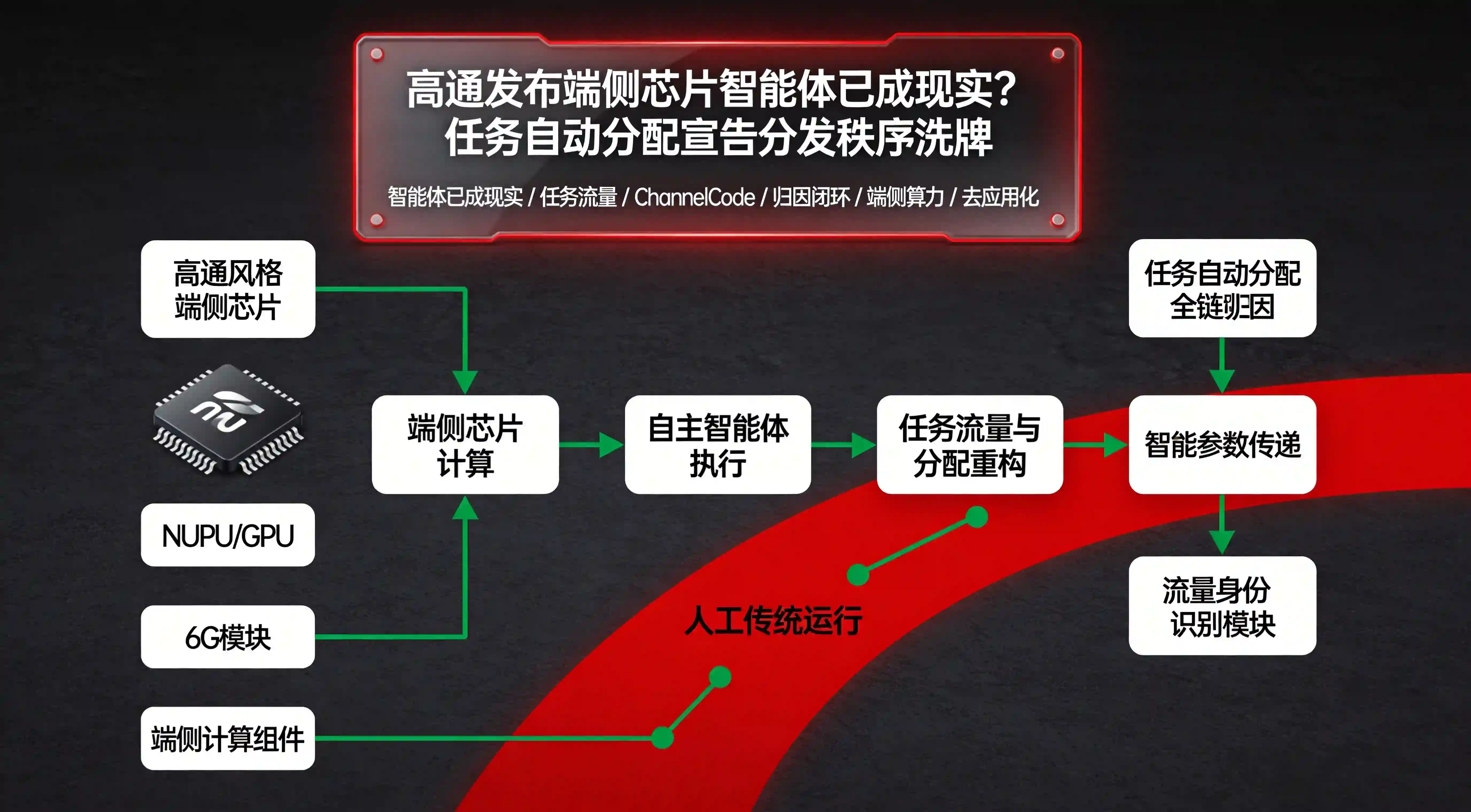

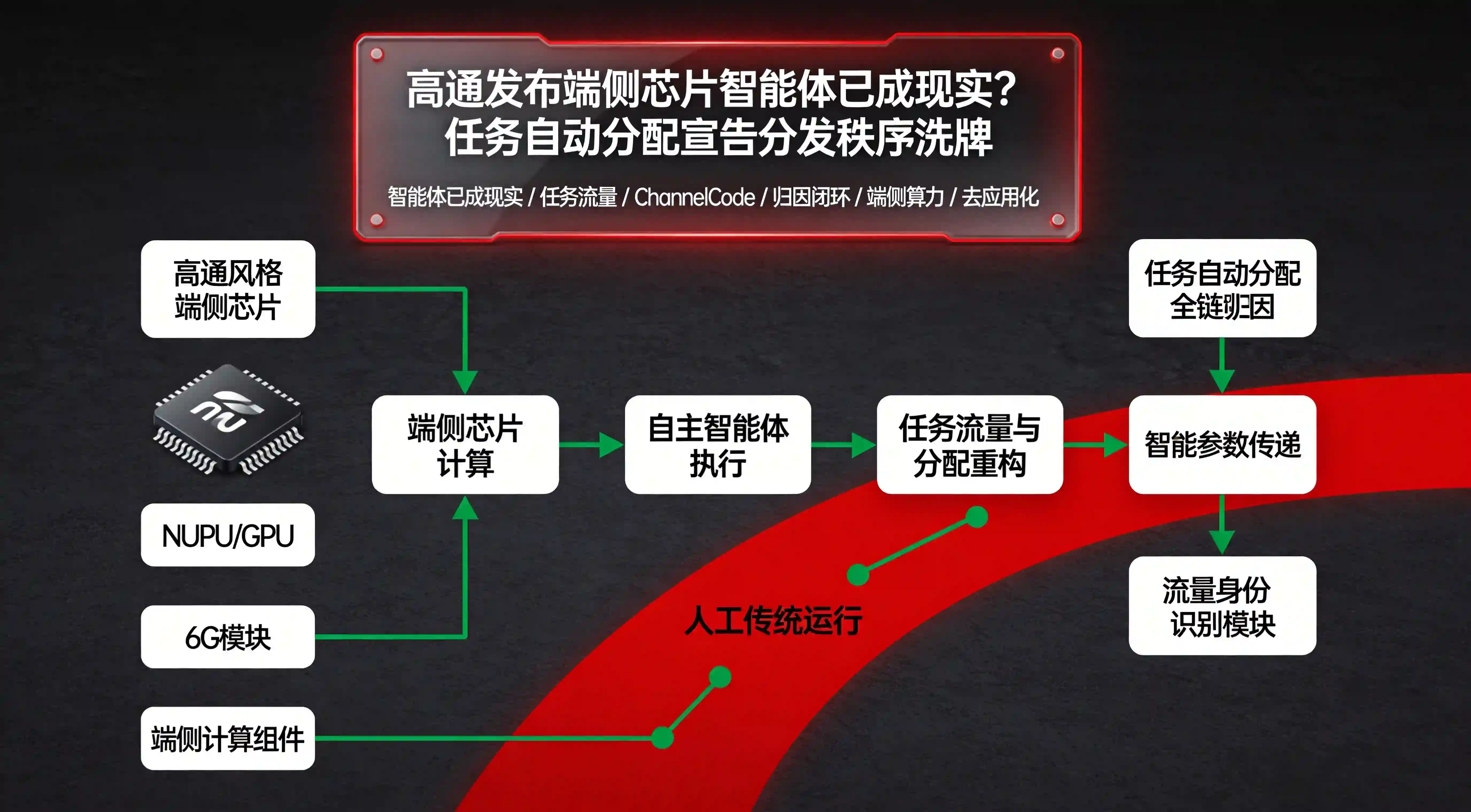

高通发布端侧芯片智能体已成现实?全场景算力调度与分布式任务分配如何颠覆既有应用体系——这一终端算力范式的变革已在 阿思达克财经 · 高通CEO安蒙:智能体已成现实 的官方报道中得到确凿印证,高通总裁兼CEO安蒙在 COMPUTEX 2026 现场发表演讲时明确向全球宣布智能体已成现实,它不仅正在成为全网AI词元(token)爆发的核心来源,更将从根本上定义下一代AI架构与经济模式。当未来的智能体开始主动代替人类运行计算、自动分配长程工作流并接管硬件资源分配权,传统屏幕点击与集中分发的行业秩序正遭遇颠覆性的技术解构。在这一场席卷移动生态的底层迁徙中,流量逻辑正从“人操作应用”降维演变为“智能体自主履约”。面对重载算力与大厂围墙的双重夹击,开发者、产品经理与增长负责人必须尽快重构底层的数据链条,才能在去应用化的指令洪流中看清流量真身。新闻与环境拆解:从 COMPUTEX 2026 看智能体已成现实的落地先兆当安蒙在台北国际电脑展高调宣告智能体已成现实时,全球软硬件生态正在迈入全面交织的智能化拐点。根据行业权威媒体 飞象网 · 高通CEO安蒙COMPUTEX重磅发声 的完整记录,高通抛出的硬件解决方案矩阵,标志着边缘侧终端正式迎来了面向AI时代的深度换代。高通强调其核心实力在于软硬件技术已突破浅层交互的界限,进化为具备全天候自主规划、上下文长效保持以及跨系统协同执行能力的刚性系统。为了彻底喂饱这一全新物种,上游算力大厂正在将智算红利从云端数据中心强行下沉到每一个微型的物理端点中。词元消耗发生百倍量级暴增根据高通披露的权威测算数据显示,全球AI架构正经历三阶段的阶梯式跨越。第一阶段的对话式AI,单次交互约消耗1万个词元;第二阶段的推理式AI,单任务约需10万个词元;而当演进到智能体阶段时,由于需要自主拆解多步骤、高频调用多场景工具,单次任务的词元开销已直接飙升至100万个以上。在短短两代模型变迁中,词元消耗发生了超过100倍的量级一路上涨,从底层证明了智能体已成现实,高能效、高计算密度的NPU与GPU已经成为端侧不可或缺的硬件标配。机器速度驱动Token经济学重构安蒙指出,2026年全球每10秒的词元需求约为317亿个,而到2030年,这一数值将膨胀至1.27万亿个,总体增幅高达40.0倍。这一爆发现象的底层逻辑在于,智能体产生并消耗词元的速度是纯粹的“机器速度”,远非传统人类的手工点击所能比拟。词元已成为AI时代的全新基础货币,而高通飞龙(Dragonfly)等全栈数据中心业务品牌的推出,正是为了在千万亿级的Token经济浪潮中卡位高性能基础设施,全面释放由机器逻辑驱动的生产力潜能。6G网络架构演进为智能体的数字孪生底座与传统通信网络不同,未来正式步入商用深水区的6G网络将成为首个专为AI时代打造的无线基础设施。6G网络将连接、分布式计算与射频感知能力深度融为一体。它不仅支持超高带宽的上行链路以实现“见用户所见”的情境交互,更将射频信号作为物理AI的输入源进行性能建模。通过对数以亿计的无线连接进行三角定位,网络能够在边缘侧实时构建出整座城市甚至国家的“数字孪生”镜像。这一高密度的物理网状图谱,将为全场景运转的智能体提供毫无延迟的实时情境参数流,推动智能生态完成从虚拟到物理现实的跨越。从新闻到用户路径的归因问题:智能体已成现实背后的非线性数据链断层上游芯片巨头和操作系统大厂正在紧锣密鼓地重组底层的算力卡尺,但对下游的应用操盘手而言,当大厂硬件升级而宣告智能体已成现实并成为定义数字体验的中心时,传统依靠漏斗模型构建的增长逻辑正滑向失效的深渊。在智能体高频交互的去应用化生态中,用户不再需要老老实实地在手机上寻找图标、点开应用、浏览页面再完成转化。相反,用户的意图被直接封装成一个个自适应的任务流,由智能体在后台跨多端、多沙盒自动代劳。例如,用户通过一句话指令让AI个人助理订购一份跨境商品或预约一项本地跑腿服务,智能体会在毫秒级内自动拆解步骤,直接调用外部Skill组件完成履约,整个过程甚至不需要在前端屏幕上产生任何一次视觉层面的广告点击。这种去中心化的“任务流量”替代“页面流量”的迁徙浪潮,让现有的App买量与获客监测架构暴露出前所未有的全链路数据断层:系统黑盒与大厂筑墙剥离追踪指纹: 在多智能体并行的非线性流转链路中,用户真实的决策行为发生在智能体的对话逻辑或推理闭环内部。传统的同频即时归因会在智能体跨越数据沙盒进行信息抽取的过程中被层层剥离,导致后链路的App激活数据与前期的触达源头彻底失联,大面积滑入无法识别的“自然流量”黑洞。关于如何跨越网页与原生应用之间的系统断层,开发者必须升级底层的跨端参数恢复通路,这在行业白皮书《跨平台获客归因如何实现?打通网页与应用归因链路》中已经得到了系统性的工程论证。高并发延迟加剧召回层的数据偏误: 智能体以机器速度发起的高频调用,会给后端的微服务网关带来海量的瞬时高并发压力。由于大厂筑墙与系统黑盒,如果外部App无法实现高精度的全渠道归因,就无法将真实的下载源头与大厂内部那个触发AI高回访的场景源头进行动态绑定。当团队无法理清公域算力外溢背后的真实转化路径,企业的归因解释权就会被平台完全垄断。为了对外抗衡这一黑盒现象,增长负责人必须将数据监测下沉到统一的底层看板中,建议深入参考《亚马逊 AI 战略升级?多云多 Agent 时代 App 该怎么认清流量真身》里的全链路穿透逻辑,构建起自主的数据收束闭环。工程实践:在智能体已成现实时代重构安装归因与全链路归因面对去界面化的新常态,App团队不能坐以待毙。我们必须承认智能体已成现实对底层工程管道带来的深刻改变,并用合规的数字化基建重构分析闭环。渠道编号 ChannelCode 的一体化入口收束要破解去界面交互带来的归因碎片化问题,首要任务是在源头上为非结构化的任务流量打上清晰的数字化指纹。运营团队在进行跨系统买量、KOL内容种草或去中心化私域裂变时,应当全面废弃传统粗放的硬编码渠道标签。技术团队应采用渠道编号 ChannelCode 的标识重构策略。这正是大厂技术范式革新周期下证明智能体已成现实并保护企业数据主权的关键步骤。通过动态生成携带唯一 channelCode 参数的标准化入口标识,将每一个智能体外挂组件、短剧素材位或推广动作赋予全局唯一入口指纹。无论上游的AI是通过分布式计算在端侧本地运行,还是在48小时内通过多轮推理延迟触发,承接页面的 Web SDK 都能稳健地捕获该唯一参数,连同脱敏后的设备特征作为元数据标识一同上报至归因服务器。同时,为了防止私域生态对分发链接的恶意拦截屏蔽,运营团队必须配合技术指南《网页跳转App统计如何实现?一键拉起监测点击与安装量》中强调的多域名动态轮询机制,利用统一的渠道编号 ChannelCode把入口特征完成无缝标准化归拢,在全渠道归因看板拉通数据。智能传参安装与延迟深链的无感场景还原在智能体以机器速度代劳的极速叙事背景下,用户在跨端流转过程中的情绪窗口期极其短暂。如果用户在端外被AI智能体深度种草并触发了App下载行为,但在首次打开App时却被扔进冰冷的通用首页、需要再次手动搜索或填写激活码,转化漏斗必然面临断流危机。为了实现零摩擦的无缝转化,技术团队可以在数据管线中部署智能传参方案。在用户触发意图的一瞬间,Web 端 SDK 将当前的上下文信息与脱敏设备快照进行云端挂载。当应用在终端完成首次启动的黄金3秒内,无损传参总线直接执行一键拉起与场景还原,在无需用户进行任何手动输入的前提下,直接把参数无感还原进后端的分析数据库中。这套精细化管道的搭建逻辑,完美契合了《智能体分发时代 App 安装传参逻辑的底层重构》中关于免填邀请码与App免邀请码安装的演进路径,能让App开屏即直达指定履约内页,也将流量泡沫无情戳破。这也是开发团队顺应变现期趋势、提升后链路转化价值,才能在智能体已成现实的变局中接住因设备状态漂移而面临流失的长尾空节点。这件事和开发 / 增长团队的关系在芯片厂商和云计算巨头联手向全网宣告核心变革并确立多系统协同秩序证明智能体已成现实时,研发总监与增长团队的认知框架必须同步升维。面向开发 / 架构团队:从节点埋点向连续状态图重构高兼容性 Payload 接口设计: 架构师需要重新设计数据仓的行为模型。立即自查并废弃高危隐私调用接口,在核心上报埋点中为任务流量预留标准化扩展字段。在用户激活、首启的 API 接口中,统一规范并强制要求包含 agent_platform(智能体平台)、workflow_id(工作流路径)、channel_code(入口渠道编号)及 risk_level(风控防刷等级),将数据结构从“离散节点”全面升维为“连续状态图”。API 接口级广告数据回传闭联: 技术团队应立即建立与主流广告投放数据统计平台的深度 API 数据对接。将归因服务器精准解析出的后链路深度转化数据(如应用的真实留存率、长期 LTV 账本)实时反哺给媒体端,用高干净度的有效样本喂饱媒体的 AI 投放模型,从底层克制无效的算力损耗与获客成本。面向产品 / 增长团队:深挖任务场景的价值感知与精细化风控建立基于任务价值的成本卡尺: 增长负责人必须快速重构人机协同模式下的战略卡位,以此来积极对齐智能体已成现实背后的合规化水位。增长团队必须建立起能够看穿大厂黑盒的归因对账系统,外发监控多渠道的真实转化表现,及时砍掉那些被黑产自动化脚本高频恶意调用而产生的“高伪装泛流量”,把预算留给真实的用户履约。场景语义与产品承接的深度融合: 产品经理应利用好端侧芯片升级带来的每瓦特性能红利,在 H5 落地页及应用首启链条中,将场景语义做成可以被产品自动识别、调用的结构化信息。通过高韧性的跨端数据技术,让产品的会员激励和变现路径与用户的实际来源场景精准匹配,把关注点从“模型被调用了多少次”彻底转移到“真实到访的用户到底源自哪里”。常见问题(FAQ)高通在 COMPUTEX 2026 上高调宣称智能体已成现实,其底层的每瓦特性能技术支撑是什么?高通的核心底座在于构建了覆盖端、边、云全层级系统的专用计算解决方案矩阵。安萌强调,计算能力的增长速度与可用能源的提升并不一致,因此必须依托在移动行业深耕数十年积累的每瓦特性能优势,在功耗两毫瓦以下的个人 AI 音频耳机、端侧智能手机、个人 PC、智能汽车、工业机器人以及高性能数据中心之间实现智能的分布式调度,在严苛的功耗和时延限制下提供设备所需的全部算力。为什么说智能体 AI 阶段的词元(token)消耗会发生百倍级增长?传统对话式 AI 仅依赖用户单轮输入的提示词并返回单一响应;而智能体 AI 具备高度的代理性与目标导向性,它会自主将用户的长期目标拆解为多个步骤,全天候运行并持续延续情景信息。它在设备本地数据集、个人知识图谱与云端系统之间进行密集的跨系统多轮协调、工具调用、运行验证与失败重试,从而导致单次任务的词元开销出现百倍级的爆发式膨胀。如果智能体已成现实,开发者该如何调整数据分析平台的埋点模式?传统的埋点模式主要依赖前端页面的点击与曝光节点。而在智能体时代,数据团队必须将埋点视角从“离散节点”全面升维为“连续状态图”。技术团队应通过云端参数桶在无感知的状态下完成静默对账,通过引入高度安全的合规方案,重点记录智能体调用链路中的工作流路径标识(workflow_id)、意图类型(intent_type)及最终的履约闭环状态。行业动态观察深入审视大模型软件与智能体基础设施的支出大盘,整个移动互联网经济体系正加速从“算力狂热”向“结果交付”进行根本性的范式转移。当高通在台北电脑展全面确立了端侧超级芯片的长线布局,当网络通信演进开始动用感知能力去构建国家的数字孪生镜像,传统的依靠粗放买量、或者寄希望于靠一两句静态标签匹配就能混到泛流量的粗放买量时代,已经在一夜之间被彻底终结。平台在用流量奖励真正能解决问题的人,而市场也在用大浪淘沙的方式惩罚那些技术架构陈旧的团队。在这场轰轰烈烈的流量范式重构中,谁能够率先看清外部系统与内部复访纠缠的流量真身,谁能用高精度的底层基建将混乱的流量解构得一清二楚,才能在智能体已成现实带来的全场景网状分发变局中锁死自身的数据主权。技术的演进从未停止,而跑赢这场下半场洗牌的唯一解,就是让你的广告统计与数据架构比平台的 AI 行为预测走得更快、更准、更稳。顺应大厂技术范式革新的浪潮,唯有及早利用中立精准的归因统计重构底层数据底座,企业才能真正向市场证明智能体已成现实,在这场去泡沫化战役中赢得确定性的长效商业红利。

11

11

豆包6月下旬正式付费全面打通内循环?大模型应用跨入算力溢价时代这一行业动向已在多端网关适配链路中得到确凿印证,6月1日36氪及IT之家独家证实字节跳动旗下第一大Chatbot产品即将完成PC端与移动端的基础体系改造并正式落地全面商业化变现。当大厂私域生态开始全线截留公域红利,传统的粗放型引流模式正被成本高墙悄然取代,豆包正式付费的落地标志着大模型软件支出大盘全面进入商业闭环的精细化深水区。这一变局直接驱使应用分发路径发生质变,也对移动增长和底层数据管线提出了更苛刻的压力测试。在这种无界面、高度抽象的交互网络中,开发者、产品经理与增长负责人究竟该如何在流量筑墙与留量重组的双重夹击下看清真实的流量真身?新闻与环境拆解:从豆包正式付费看算力重载下的AI变现路径从整个AI产业演进的生命周期来看,这次传出的豆包正式付费时间表,压倒性地预示着全球大模型军备竞赛从“功能Demo狂欢”迈向“利润产出交付”的必然转折。大厂不再只谈技术理想,而是全面向真实世界中的高额基础设施开销对齐。豆包多档阶梯式付费方案与Force大会时间表确立据行业知情人士透露,豆包预计将在6月下旬正式上线付费增值内容,并于同期举行的Force大会上更新相关功能。在明确了标准版(连续包月每月68元,连续包年每年688元)、加强版(连续包月每月200元,连续包年每年2048元)与专业版(连续包月每月500元,连续包年每年5088元)的三档订阅价格后,平台将彻底拉开差异化增值服务的序幕。这一高客单价门槛的设计,也直接对标了海外市场ChatGPT Plus与Claude Pro的商业路径,意味着国内大模型应用纯免费大锅饭时代的终结。伴随着豆包正式付费标准表明确立,国内Chatbot产品长达数年“烧补贴抢占用户量”的竞争思路也将迎来系统性纠偏。基础设施预算飙升与算力重载倒逼公域投流收紧大厂急于转向商业化变现的背后,是动辄数百亿美金的算力开支代价。字节跳动今年考虑投入最高700亿美元的资本支出用于推进AI,基础设施预算也从去年的1600亿元大幅上调至2000亿元人民币(约300亿美元)。在Token及推理成本极其昂贵的当下,巨额的资金投入对大厂整体净利润产生了显着的降幅摩擦。受此财务挤压,字节自2026年4月以来已主动减少了对豆包的推广投流,导致其MAU增速放缓。全球运营规律证明,单纯依赖包月订阅价根本无法完全覆盖重载的基础设施开销(如全球MAU最大的同类产品推行订阅三年付费转化率仅为6.1%)。寻求强效的业务造血引擎迫在眉睫,而这次豆包正式付费也正是为了扭转算力黑洞而采取的必然行动。灰度测试购物支付与AI短剧狂飙构建的大厂内循环2026年3月30日起,豆包内置的购物支付功能进入深度灰度测试,支持用户直接在APP内完成下单支付而无需跳转抖音商城,用户点击商品卡片看完详情页的转化率已达3%以上。同时,基于seedance 2.0模型生成的生视频能力进一步激活了短剧市场的投流热潮。短剧行业在巨量引擎体系内的日耗峰值已狂飙至1.2亿元,部分短剧出品方的日消耗从几十万暴涨至数百万元。但在大盘膨胀繁荣的背后,短剧出品方在媒体端的ROI通常仅维持在1.03至1.07的边缘地带。真正获取稳定高溢价现金流的,永远是掌握着公有云基础设施(火山引擎在公有云大模型调用市场份额达49.5%,高居行业第一)与广告投流生态的平台自己。这些面向未来长期商业化回报的组合棋,在豆包正式付费尘埃落定后,正加速终结传统的野生获客模式。从新闻到用户路径的归因问题:认知落差下的非线性数据链断层大厂正在内部为自己的算力账单构筑合规与配额的高墙,但对外部应用开发者和运营负责人而言,当平台随着豆包正式付费而将流量链路深度压缩进内置商品卡片、智能体推荐和Skill直达履约等闭环时,传统的营销漏斗被彻底打碎。用户路径已从传统的单向线性模式,异变为了极其复杂的非线性图谱。用户在对话框被AI种草,触发AI行为预测并连续推荐或加入收藏夹,在24小时内产生多次复访,最终通过历史记录再次进入,在不需要跳转到外部浏览器或应用商城的黑盒组件内完成交易。在这种由新规和高门槛付费生态交织而成的变局下,传统的买量分发与数据监测架构正暴露出严重的技术盲区。如果用户在AI交互中触发了高交互行为,却在2-3天后才通过主页二次复访点开广告链接下载应用,传统的同频即时归因就会因为时间差和跨越不同的多重算法推荐场景而产生严重的漏斗断裂。关于如何穿透网页与原生应用之间的隔离墙,开发者必须升级底层的跨端参数恢复通路,这在由行业专家撰写的《跨平台获客归因如何实现?打通网页与应用归因链路》中已经得到了系统性的工程论证。由于整个分发秩序的逻辑已经悄然发生了根本性迁徙,传统的第三方流量看板只能监测到孤立的点击节点,却无法穿透大模型参数化知识与动态检索知识之间的交互缝隙。外部应用无法得知自己是被哪一个高敏行业技能包、哪一次高频Token调用所唤醒,导致投放ROI的解释权被平台完全垄断。鉴于此,这次豆包正式付费引发的公域算力筑墙,正大面积蚕食着B端负责人的利润空间,逼迫开发者必须在工程层面重构自身的数据管道,将流量真身的识别从浅层视窗下沉到统一的底层看板中。面对多端多Agent交织的复杂流量环境,开发团队可以直接参考前沿技术文献《亚马逊 AI 战略升级?多云多 Agent 时代 App 该怎么认清流量真身》中的黑盒穿透方法,建立起完全脱离大模型调用损耗的自主数据收束体系。工程实践:重构安装归因与全链路归因面对大厂算力筑墙与留量内循环的长期趋势,应用开发团队必须在工程实践上做出改变,升级底层的广告投放数据统计与归因基建。渠道编号 ChannelCode 的多维特征标识一体化收束要在非线性复访与去应用化场景中认清流量真身的问题,工程团队为了在公域算力高墙以及豆包正式付费的高门槛变局下稳住私域红利,首要任务是在源头上给流量打上全景指纹。运营团队在进行多视频矩阵投放或跨MCN机构合作时,应当废弃传统粗放的单一广告组链接。通过采用更加灵活的标准化入口标识,为每一个视频源、短剧单集或KOL生成携带唯一 channelCode 参数的 H5 落地页。当AI通过行为预测将视频分发给不同圈层的用户时,无论用户是即时点击还是在48小时内通过收藏夹二次复访,落地页的 Web SDK 都能稳健地捕获该唯一元数据,连同脱敏后的设备特征作为元数据标识一同上报至归因服务器。同时,为了防止私域生态对分发链接的恶意拦截屏蔽,运营团队必须配合技术白皮书《网页跳转App统计如何实现?一键拉起监测点击与安装量》中的多域名动态轮询机制,利用统一的渠道编号 ChannelCode把入口特征完成无缝标准化归拢,在全渠道归因看板拉通数据,从源头上封堵流量漏数盲区。智能体分发与携参安装:打破搜索即决策与转化断点的无缝场景还原在大厂通过价格补贴将公域流量向内部商城全面引流的变局下,外部应用承接流量的转化漏斗必须做到绝对的“零步阻碍”。在技术实现层面,可以参考行业成熟的前沿演进方案。正如深度指南《智能体分发时代 App 安装传参逻辑的底层重构》中所拆解的精细化管道逻辑:当用户在外部流量入口被深度种草并触发下载事件时,Web 端 SDK 会将捕获到的特定意图参数与底层脱敏设备指纹进行云端排重匹配。当用户在手机自带商店下载安装完成并首次启动 App 的一瞬间,客户端 SDK 能够快速在云端取回这些自定义参数。App 开屏即可直接越过冷启动的繁琐首页,无缝直达指定深度内页,并且在后台完成上下级关系的绑定。这种智能传参安装技术最大的优势在于,用户在整个过程中不需要手动填写任何六位数的邀请码,真正做到了免填邀请码的极致无感体验。这也是开发团队顺应豆包正式付费趋势、提升后链路转化价值、承接App免邀请码安装红利的极佳选择。注:本文探讨的跨终端多 Agent 协同流转、参数自动化合并以及去应用化任务链无损归因场景,属于对未来应用分发趋势的前瞻性技术延展与思考,例如渠道精细化归因、跨平台一键拉起、免填邀请码链路优化等前沿应用方向。目前此类高度定制化链路已作为 Xinstall 平台的定向技术储备,旨在帮助中大型企业攻克精细化增长诉求,如 App 开发者有类似高阶业务需求,欢迎联系 Xinstall 客服团队进行技术探讨或共同定向研发拓展。这件事和开发 / 增长团队的关系技术团队必须认识到,变现压力正在倒逼大厂将私域生态高墙围得越来越紧,迫使 App 的技术架构师与运营操盘手必须快速重构人机协同模式下的战略卡位,以此来积极对齐豆包正式付费背后的合规化水位。面向开发 / 架构团队:技能包接口预留与连续状态图设计标准化 payload 字段设计: 架构师在重构客户端数据仓时,必须在标准的埋点模型中预留用于承接智能体和外部工作流的标准化字段。例如,在用户激活与首启的核心 API 接口中,强制规范预留 agent_id(智能体标识)、workflow_id(工作流路径)、channel_code(入口唯一渠道编号)及 risk_level(风控防刷等级),将数据结构从“节点上报”全面升维为“连续状态图”。API 接口级广告数据回传: 技术团队应立即打通主流移动广告平台的 API 数据回传通道。将归因服务器精准解析出的渠道转化数据、留存数据通过标准的事件回传方法实时反哺给媒体端,利用高干净度的数据指标降低无效的算力损耗与获客成本。面向产品 / 增长团队:全面向“留量思维”与高溢价场景转型成本控制与精细化对账: 增长负责人如果不想为外部大模型调用损耗和黑产自动化高频调用买单,必须建立起能够聚合看清全渠道、跨平台流量真身的数据看板。停止为依靠机器虚假注数的获客大盘买单,依据科学分布的验证点确保任务收敛,精确度量每一笔 Token 消耗与真实用户全生命周期价值的底层账本。场景深耕与体验设计深度融合: 产品经理应利用好大厂通过补贴培育出的用户 AI 消费习惯,在落地页和引流路径中,精细化打磨干货攻略与场景服务的无缝连接。通过更加轻量、合规的无感携参方案,将公域涌现的无感意图流量,高效转化为自身私域高留存、高价值的核心资产。常见问题(FAQ)豆包正式付费细则中提到的三档增值内容具体是如何划分的?随着豆包正式付费的信息单列,官方回应称豆包在始终提供免费服务的基础上,探索推出更多增值内容。目前流出的测试方案包含三档订阅价格:标准版连续包月每月68元(连续包年688元),加强版连续包月每月200元(连续包年2048元),专业版连续包月每月500元(连续包年5088元),基础功能与收费体系的适配改造预计在6月下旬正式上线。为什么全球头部的Chatbot订阅变现转化率普遍面临瓶颈?因为 AI 订阅模式存在天然的两难悖论。在同质化竞争剧烈的当下,厂商为了维持活跃用户大盘,无法彻底取消免费版,而免费版已能满足绝大多数轻度用户的日常需求。另一方面,由于当前 Token 和算力推理成本依旧极其高昂,真正能完成复杂长程任务的高阶功能定价过高,导致全球顶尖 Chatbot 的三年付费转化率也仅能维持在 6.1% 的有限水平。报告中提到的火山引擎大模型公有云调用量大暴增说明了什么?根据权威数据机构 IDC 公布的报告显示,中国企业在公有云上的大模型调用量呈现出暴增 16 倍的趋势。在这场全新的 AI 云算力竞争中,字节旗下的火山引擎平台增长最快,承接了全网接近一半的大模型调用量,其市场份额已达到 49.5%,位居行业第一,说明 To B 市场的 MaaS(模型即服务)正成为大厂实现算力溢价变现的最核心路径。行业动态观察深入审视大模型软件与云基础设施开支的变迁,大厂商业化闭环的逐渐形成与豆包正式付费时间表的敲定,并非一次孤立的规则修补,而是大厂在面临百亿级算力开支压力时,不得不做出的分发秩序与商业形态的底层大转型。当算力机房的灯火不熄,大厂开始动用最高规格的资本支出去圈定智能体与私域内循环的护城河,过去的泡沫化买量投放、依靠《隐私政策》合规红线进行拦截清洗的精细化时代已经到来。粗放红利期正在加速崩塌,大厂正在把流量和支付闭环往自己的口袋里装,而市场也在用最冷酷的算力账单淘汰那些缺乏底层数据透视能力的陈旧团队。这恰恰是整个移动应用、游戏与本地生活操盘手重塑自身归因体系和获客漏斗的决定性窗口期。在全行业都在向数字化、智能化治理及效率升级靠拢的存量洪流中,谁能率先在工程层面实现不触碰合规红线的无感携参安装,谁能用高精度的底层基建将混乱的流量解构得一清二楚,才能在这场分发秩序的大洗牌中穿越算力黑盒,重构属于开发团队的数字资产高地。及早重构底层的数据统计与归因体系,企业才能在这场去泡沫化战役中赢得确定性的长效商业红利,稳步跨越由豆包正式付费所带来的宏观大洗牌。

14

14

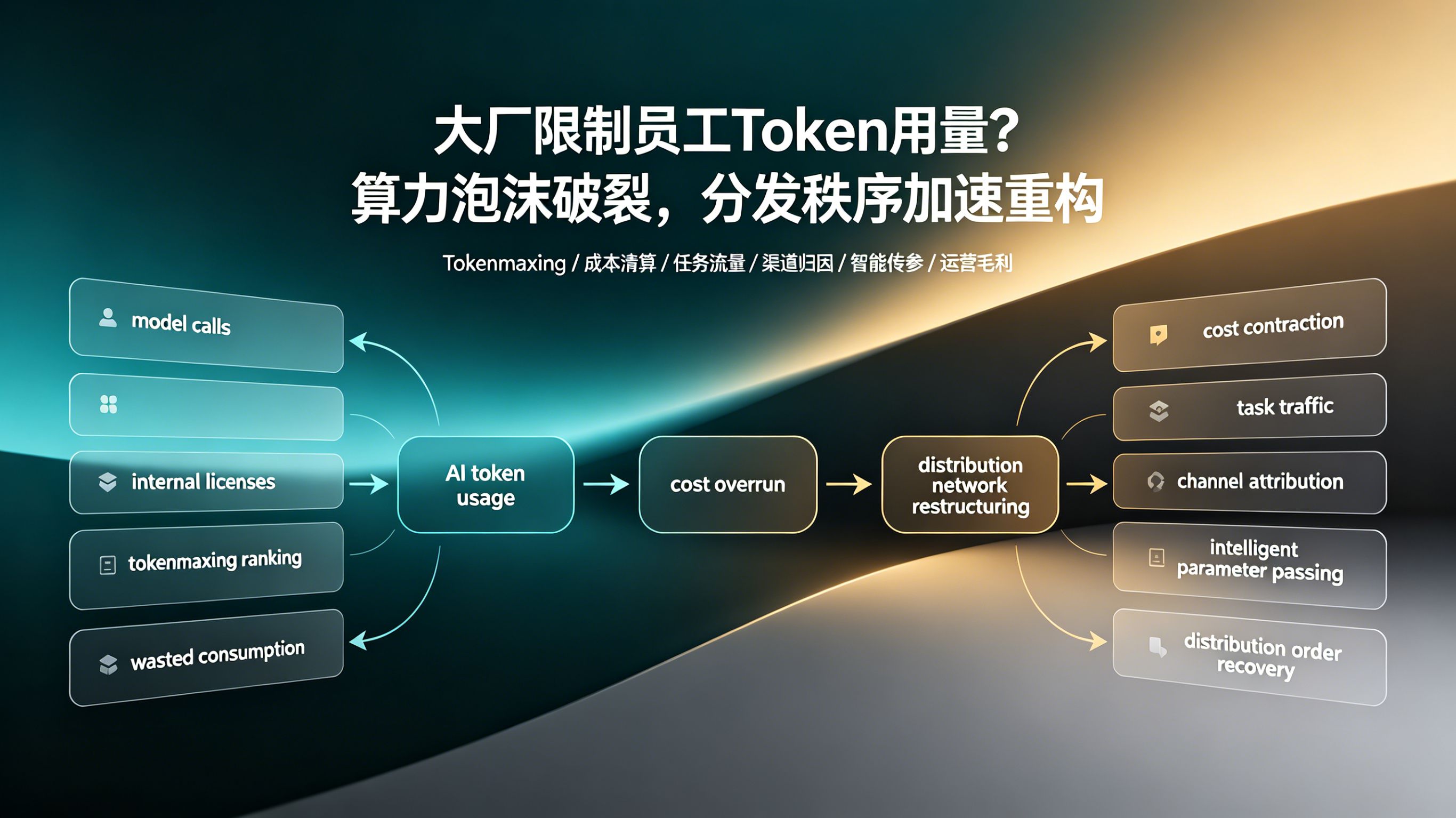

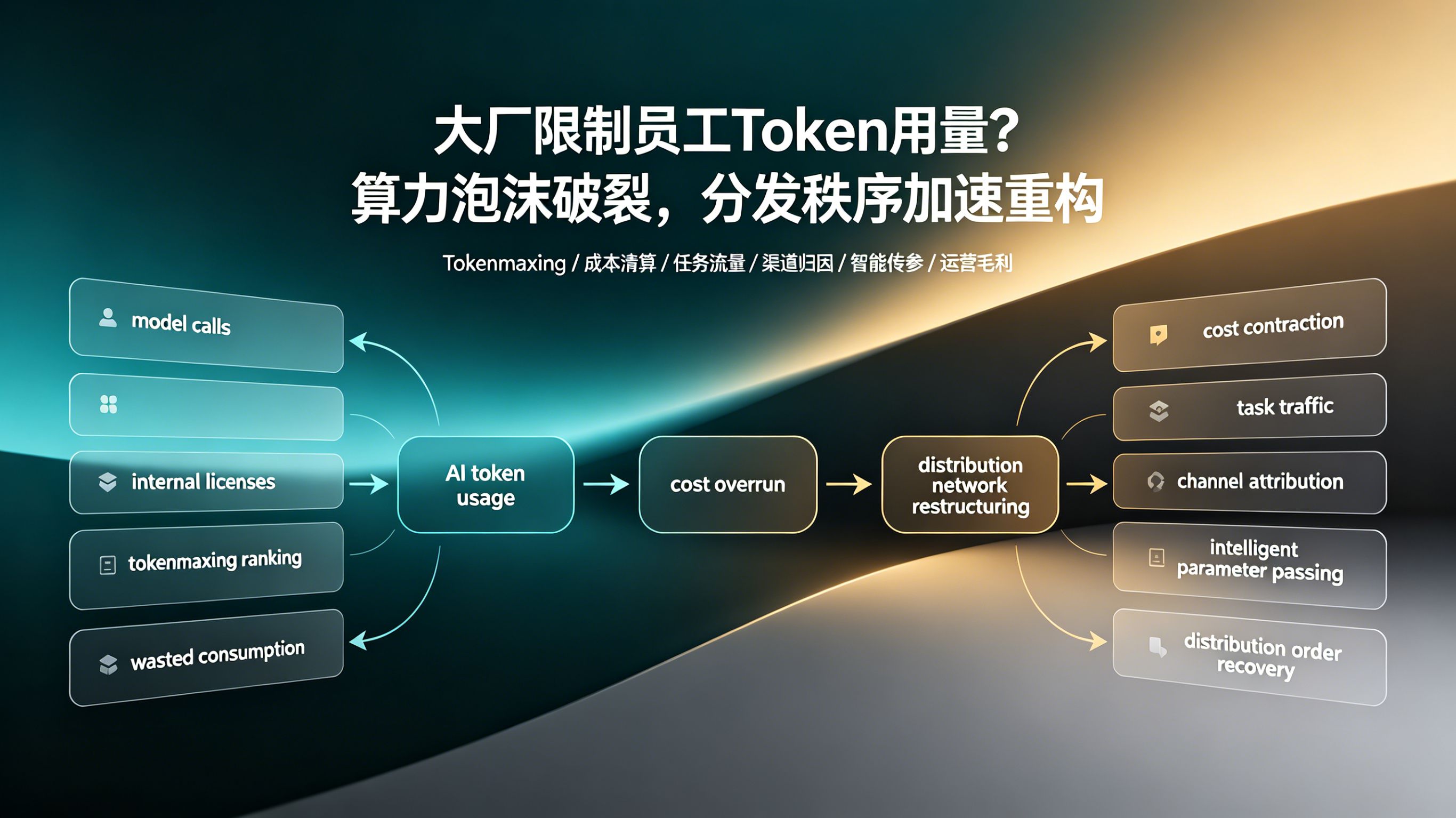

大厂限制员工Token用量?这一席卷全球科技巨头的财务配额管制已被多方基础设施监控日志与收紧的许可证授权深度证实,盲目堆砌计算开销的虚假繁荣正随着数十亿美元的黑盒算力损耗加速破裂。当技术监测显示这一风控手段成为常态,如何用底层清透的数据基建拿回分发网络主导权并重塑运营毛利,成为摆在开发与增长团队面前的严峻课题。新闻与环境拆解:Tokenmaxxing 的虚假繁荣与资本清算这场严重侵蚀公域利润的成本风暴,彻底撕开了自动化浪潮中隐藏最深的财务黑洞。在这一轮涉及整个数字生态生产力配置的全面纠偏中,大厂限制员工Token用量已从小圈子试点转变为跨国巨头的标准风控手段,这并非单纯的临时性财务挤压,而是企业级基建在资源配置上的一次必然清算。微软与 Meta:被中途斩断的许可证授权一向在人工智能领域全力压注的微软公司,悄悄在其内部Experiences + Devices工程部门取消了大部分员工的Claude Code内部许可。这一变动距离其高调向数千名员工开放仅过去了不到六个月。微软官方对此给出的托词是“工具链的阶段性统一与回归自研”,但接近高层的内幕消息指出,昂贵且缺乏监管的外部Token账单已经触及了企业财年结账节点的财务红线。企业发现,让AI全天候常тном常驻后台的资源消耗,已经开始反向吞噬软件本身的边际利润。同时,Meta也悄悄下线了内部的“tokenmaxxing 排行榜”——那个原本为了鼓励员工多用AI、甚至试图将其纳入绩效考核的数字化转型指标,在无情的成本压力面前被无限期搁置。刷量黑洞:Tokenmaxxing 的狂热与隐性损耗而导致大厂限制员工Token用量全面爆发的直接诱因,则是企业在底层运营模式上对“用量即生产力”的盲目崇拜。在风靡行业箱体的“Tokenmaxxing”管理逻辑下,不少互联网企业将AI使用率强行挂钩基础设施活跃度。这种粗放的考核直接导致了极其荒诞的灾难:员工开始调用底层数千亿参数的旗舰大模型去查天气、写生日祝福或者频繁润色无关痛痒的沟通邮件。根据最新披露的行业审计报告显示,企业在AI Token上每投入1美元,实际上有0.44美元消耗在修复AI生成的代码缺陷上,0.27美元用于重写完全废弃的代码,还有0.11美元浪费在审查与合并延迟中。这意味着高达80%的资金流向了毫无实质产出的技术内耗,虚假繁荣背后的系统摩擦成本已经让大厂限制员工Token用量向全行业传递了清晰的成本警示。Uber 的账单崩溃:从“先买后想”到财务死穴由于这一波技术试错周期长达数个季度,直到2026年中期的财报季,大厂才第一次将AI热潮当成纯粹的财务问题来算账。摩根大通在近期发布的报告中直言,AI Token成本正成为互联网利润的吞噬者。包括Uber、Shopify、Spotify在内的行业巨头纷纷在财报电话会上对陡增的运营支出表示强烈焦虑。Uber首席运营官在面向行业的公开对谈中承认,公司原本预计能支撑一年的AI编程预算在短短4个月内被员工彻底烧光,而代码的流失率却惊人地暴涨了800%。这种失控的算力账单不仅刺破了盲目跟风的技术泡沫,也从根本上证明了大厂限制员工Token用量在财务安全审计上的必然性。如果AI只是让工作做得更快,而无法为企业向用户端推纳更多有价值的功能,那么这种高昂的补贴模式将难以为继。从新闻到用户路径的归因问题:认知落差下的流量断层当生产力大厂正在为高额账单筑起配额高墙时,移动应用生态的操盘手必须意识到,这一场算力重置正在悄然改变上游的流量分发秩序。普通人看热闹,但开发者面临的却是真实的流量断流与饭碗问题。然而,随着大厂限制员工Token用量逐步进入常态化监管阶段,许多以往被掩盖在智能体繁荣之下的用户路径监测盲区开始浮出水面。在传统的分发生态中,用户的生命周期价值可以通过清晰的链路进行单向追踪。然而,在技术团队试图通过“智能路由器”来对冲高昂开销的宏观背景下,大厂限制员工Token用量所引发的连锁反应开始向下波及。未来数个季度内,用户不再单纯通过标准的浏览器页面和点击广告按钮来产生转化,取而代之的是由多云、多Agent直接代劳的“任务流量”。在面对多智能体并行的复杂流量分发现象时,开发团队可以直接参考 xinstall 发布的《亚马逊 AI 战略升级?多云多 Agent 时代 App 该怎么认清流量真身》中的核心论点,将流量真身的识别从前端视窗下沉到统一的底层看板中。在这种无界面、高度抽象的交互网络中,传统的买量指纹和广告追踪标识符会在智能体的自动化信息抽取过程中被层层剥离。当一个由AI自动编排的任务流跨越多个应用终端和数据沙盒,最终在未触发任何前端视觉点击的情况下替用户完成了一次本地履约或App下载时,现有的归因平台将陷入大面积的数据不一致深渊。在大厂限制员工Token用量引发的精细化浪潮中,如果不能精确度量客户获客成本,企业的每一笔开销都将变成一本谁也说不清的糊涂账。工程实践:重构安装归因与全链路归因从工程落地的角度来看,大厂限制员工Token用量迫使企业架构师必须建立一套完全脱离大模型调用损耗的自主数据收束闭环。面对公域买量成本飙升和机器自动化脚本高频刷量的复杂环境,利用更加轻量、物理级硬核的标识体系,正是大厂限制员工Token用量背景下实现精细化增长重构的技术破局点。渠道编号 ChannelCode:构建无侵入式的入口标识传统依靠参数污染和重定向跳转的买量追踪,在多端生态融合的时代极易遭遇应用商店防火墙的直接拦截。技术团队应当采用渠道编号 ChannelCode的技术策略。通过在分发文件的打包阶段或者链接生成的底层元数据中,自然嵌入防篡改的、具备极客大局观的全局唯一渠道代码。无论是网页广告、私域社群裂变还是线下O2O地推,每一个入口的“场景真身”在进入分发网络前就已经被赋予了清晰的数字化指纹。利用这种确定性的数据收束逻辑,即使在大厂限制员工Token用量导致服务频繁限流的环境下,依然能够在入口端完成全渠道流量的标准化归拢。智能传参安装:跨越断层的数据管道当智能体或半自动化脚本引导真实用户从网页端向移动端原生应用进行流转时,传统的归因模型往往会在应用商店的隔离墙前彻底丢失参数连续性。工程团队可以通过部署智能传参安装方案来打破这一断层。在用户点击下载的顺时点,系统的底层对账网关会将当前会话的上下文信息直接压缩并绑定至设备指纹快照中。当应用在终端完成首次启动时,无损传参总线会在零延时状态下直接执行一键拉起与场景还原,在不需要用户手动输入任何代码或激活凭证的前提下,将完整的转化数据无缝还原进后端的分析数据库中。针对跨越应用商店断层的场景,可以完美移植 xinstall 经典方法论中关于《智能体分发时代 App 安装传参逻辑的底层重构》的精细化管道逻辑,这种精细化的管道隔离,正好能够承接因大厂限制员工Token用量而溢出的精细化增长诉求。注:本文探讨的跨终端多 Agent 协同流转与局域网底层直传归因场景属于对未来分发趋势的前瞻性技术延展与思考,例如渠道精细化归因、跨平台一键拉起、免填邀请码链路优化等前沿应用方向。目前此类高度定制化链路尚未作为标准功能全量实现,如 App 开发者有类似高阶业务需求,欢迎联系 Xinstall 客服团队进行技术探讨或共同定向研发拓展。这件事和开发 / 增长团队的关系技术底盘的精细化与去内耗化大厂限制员工Token用量给开发和增长团队带来的不仅是成本卡尺,更是一次全面拿回流量定义权与归因解释权的难得窗口。对于系统架构师与后端工程师而言,必须立即停下对云端大模型接口的盲目依赖。在应用架构设计上,应当优先预留高兼容性的、面向非结构化任务流量的数据接口,并在核心账单网关层引入高精度设备指纹安全校验,从底层防御灰色脚本高频调用带来的算力外溢。同时,在数据分析层需要将全渠道归因的底层指标进行白盒化重构,确保即使前端交互形态发生演变,底层的字段解析与多维度报表系统依然具备极强的抗震荡能力。精细化模型替代粗放买量在增长策略侧,大厂限制员工Token用量则要求运营操盘手迅速放弃依靠脚本和高度拟人机器脚本进行虚假Vanity Metrics注数的获客大盘。增长负责人应当将有限的预算向链路更纯净、转化可追踪的社交裂变获客阵地进行战略倾斜。通过建立包装清晰、不依赖前沿模型反复杂糅的社交拉新闭环,将裂变链条中的每一条推荐关系通过智能参数进行锁定。在全渠道广告平台对账中,运营团队必须守住“算力即成本,结果即正义”的考核底线,把关注点从员工消耗了多少流量彻底转移到每一个真实到访的用户到底源自哪一个精确的渠道归属上。常见问题(FAQ)大厂限制员工Token用量背后的根本财务动因是什么?根本动因在于企业发现高昂的 Token 消耗量并没有带来线性的营收增长。在粗放考核的“Tokenmaxxing”文化下,员工大量调用旗舰模型处理写生日祝福、查天气等与业务核心产出无关的任务,导致每一美元的算力投入中,高达80%被消耗在修复AI生成的代码缺陷、重写废弃代码以及审查合并延迟中,隐性技术损耗严重击穿了企业的边际净利。为什么大模型生成的代码量暴涨,反而导致系统的代码流失率急剧上升?因为手写长篇幅技能文档和依靠智能体盲目派发任务在本质上是一种缺乏数学边界的试错型手工活。当团队缺乏对业务逻辑的底层深度审查,而单纯追求自动化速度时,AI生成的代码往往存在大量的结构缺陷和安全隐患。这直接导致代码流失率暴涨了近8.0倍,反向增加了工程团队的运维负担,这也是促成大厂限制员工Token用量冷思考的底层技术原因。面对算力内耗,顶尖科技企业提出的“智能路由器”能解决什么问题?“智能路由器”是一种面向按需付费时代的资源优化基建。它能够在企业办公网络与云端大模型接口之间建立一层一目了然的财务平面,通过自动识别员工数据查询的复杂程度,动态将长尾、简单的任务分流给成本极低的小型本地化模型处理,只有在涉及高难度科学决策时才调用顶级闭源模型,从而在确保业务结果的同时精细化压缩基础设施开销。行业动态观察全球大模型软件支出预计在2026年将飙升至2.59万亿美元的惊人规模,然而高达94%的工程负责人至今依然面临关键ROI指标缺失的系统性尴尬。这种“钱越花越多,收益越来越模糊”的结构性矛盾,正在促使整个互联网经济体系从“流量狂热”转向“结果交付”。在软件和智能体全面侵入传统生产关系、重构公域分发秩序的当下,全面建立起不依赖高额算力补贴的精准渠道统计技术,才是跨越算力黑盒的唯一出路。顺应大厂限制员工Token用量引发的理性回归浪潮,及早重构数据与归因体系,企业才能在这场去泡沫化战役中赢得确定性的长效商业红利。

325

325

在移动增长和 App 开发领域,行业里越来越把向量检索视为打通多模态特征分发、决定高并发推荐系统召回层生死的关键基础设施。随着深度学习在分发场景的普及,如何将海量、高维的稀疏用户行为轨迹与内容标签,转化为低维稠密的 Embedding 向量,并在毫秒级时延内完成海量物品候选集的精准筛选,成为了衡量推荐引擎架构演进水平的硬性指标。在此过程中,精细、干净的端侧设备特征采集与场景参数传递是构建高质量 Embedding 的逻辑基石,例如 Xinstall 提供的多端轻量化 SDK 和延迟传参机制,就能够作为中立的上游高质数据源,为底层特征工程提供无作弊偏误的确定性样本。解构向量检索在工业级推荐架构中的位置在工业级推荐系统中,完整的推荐链路通常遵循“召回 → 粗排 → 精排 → 重排”的漏斗模型。向量检索主要在召回阶段发挥决定性作用。传统基于协同过滤或倒排索引的召回方案,往往受限于硬性的离散标签匹配,难以捕获用户多维度的潜在意图。而向量检索则允许系统在同一个低维稠密向量空间中,计算用户偏好向量与物品特征向量的几何距离,从而实现跨模态、语义级别的关联推荐。剖析非确定性近似近邻检索的数学逻辑在百万甚至千万级物品库的真实场景下,若采用最朴素的 K 近邻算法进行全量暴力遍历计算,其时间复杂度为 $O(N \cdot D)$(其中 $N$ 为物品总数,$D$ 为向量维度)。这在线上高并发请求下无异于灾难。因此,现代向量检索普遍采用近似近邻检索(ANNS)算法。ANNS 的核心逻辑是通过特定的空间拓扑结构或量化手段进行“非确定性剪枝”,在允许轻微精度损失的前提下,将时间复杂度降低至 $O(\log N)$ 甚至 $O(1)$。主流算法主要分为三类:基于图结构的算法(如 HNSW):通过构建多层无向图,在每一层进行高速贪心搜索,具有极高的召回精度和检索速度,但内存开销较大。基于量化的算法(如 IVF-PQ):通过聚类将空间划分为若干倒排网格,并对向量进行乘积量化压缩,极大节省内存,适合超大规模向量集。基于树结构的算法(如 Annoy):利用超平面不断切分空间构建多叉树,检索路径清晰,但在高维空间下召回率边缘递减。为了进一步理解底层数据流对算法模型的影响,可以深入探讨数据建模怎么支撑推荐的基础机制,确保在上游特征构建阶段就做好空间向量的对齐。对齐召回队列与下游精排层的数据口径向量检索作为推荐系统的第一道关卡,必须为下游提供格式高度规范、语义边界清晰的千级候选集。如果召回层分发的数据口径出现滑坡,精排层的深度神经网络再强也无法扭转局面。在工业级架构中,向量数据库在完成 ANNS 计算后,向微服务网关返回的数据包需要严格对齐三个核心字段:其一为标准化 Query_ID,用于追踪链路响应;其二为具有确定性概率分布的相似度得分 Score,用以表达向量间的内积距离;其三为 Vector_Tag,用来标注本次触发的向量空间版本(如短期兴趣或长期偏好),以便精排层进行多目标多特征的加权对账。设计高并发向量检索的技术实现与数据管线高效的向量检索系统不仅依赖算法层面的调优,更需要一条高内聚、低延迟的反馈闭环数据管线。从边缘客户端的动态特征捕获,到最终召回候选集的分发,每一个节点都必须满足工程化的高可用设计。搭建端侧特征采集到检索数仓的反馈闭环数据管线的起点位于移动端或网页端。为了让向量检索能够感知到最新的场景特征(如当前的广告投放渠道、动态上下文信息、地推来源标签等),我们需要轻量且合规的底层采集管道。通过中立接入底层多端统计机制,可以在不破坏应用体量的前提下,将精细化的环境参数秒级安全回传至日志服务器,为实时特征工程提供无污染的基础样本。以下是该数据管线的标准演进图:阶段划分核心数据输入处理组件与机制下游路由去向多端埋点层动态上下文、设备特征、事件ID轻量化 SDK 实时上报边缘日志网关(秒级排重)日志清洗层原始日志流、防刷风控标签实时计算引擎(Flink / Kafka)特征工程中间件(样本清洗)向量构建层结构化样本、上下文场景参数Embedding 模型(深度神经网络)向量检索引擎(索引构建)召回检索层稠密向量查询(Query Vector)近邻检索拓扑(HNSW 树/倒排索引)候选集分发(对接下游精排)编写高效近邻检索索引的构建逻在向量检索系统的核心模块中,选择工业级向量数据库并对其索引进行调优是保障召回效率的必要手段。线上系统在构建高并发近邻索引(如 Hierarchical Navigable Small World 拓扑结构)时,需要严格调校图拓扑参数。通过在 Faiss 或类似引擎中指定超参数 M(节点最大连接数)与 efConstruction(建库搜索深度),能够决定多层无向图的稠密程度。在具体的生产实践中,由于系统需要面临高吞吐量的并发查询,构建向量索引时必须参考分布式数据库的资源隔离规范,将负责离线构库写入的节点与负责在线检索的计算节点彻底分离开来,以防止线上查询链路因索引异步重建或拓扑频繁合并而出现大幅耗时抖动。调优检索指标体系与高并发决策逻辑在向量检索正式接入线上生产环境后,架构师面临的最大挑战是指标体系的失衡。往往盲目追求极高的在线召回率,会导致服务器 CPU 软中断频繁,时延严重超标;而过度压低时延,又会导致索引裁剪过狠,召回命中率断崖式下跌。权衡召回率与检索延迟的动态红线在工业级高并发大促洪峰下(如电商节日或爆款游戏上线),推荐引擎需要应对 QPS 暴涨数倍的物理压力。此时,静态的参数配置往往无法维系系统的稳态。高并发决策逻辑必须引入“动态红线熔断降级机制”。系统通过实时监控向量检索的 P99 延迟指标,一旦时延突破预设的红线(例如达到 15ms),检索引擎将自动执行参数软降级。以 HNSW 为例,决策模块会动态调小线上检索搜索深度参数(efSearch),在瞬时收窄图节点的遍历范围。实验表明,这种动态调优在流量突增时虽然会导致召回准确率出现极微幅度的扰动,但能将单次 Query 的检索延迟强行压缩 30% 以上,成功避免微服务群组发生链式雪崩效应。待流量洪峰平息、CPU 负载回落后,系统再自动将参数恢复至高精度的稳态区间。规避样本偏差对 Embedding 稠密空间的污染向量检索系统的另一个隐性毒瘤是“样本偏差”。在信息流、电商或社交分发中,黑产团伙经常利用改机软件、代理 IP 或自动化脚本进行薅羊毛和虚假刷量。如果这些高频出现的异常机器流行为数据,未经清洗就直接喂给下游的 Embedding 训练模型(如 Two-Tower 深度召回模型),就会导致这些虚假行为在稠密向量空间中产生巨大的“强引力场”,使得正常的物品特征向量和用户意图向量严重向作弊样本区域偏移。为了规避这种污染,技术团队必须在特征工程的数据入口层,应用客观中立的归因防刷过滤规则。通过对比端侧环境特征的合法性,剔除那些由于重放攻击或设备指纹异常产生的垃圾样本,从而确保向量检索空间只对真实的用户潜在偏好进行泛化表达。向量检索延迟超标的技术诊断(四步法案例)以下记录某大型移动垂直平台在流量破局期,针对向量检索层性能滑坡进行的一场硬核技术诊断与闭环攻防实战。异常现象该平台在开展新一轮大型买量营销活动期间,核心多模态推荐系统突然遭遇大面积性能劣化。在服务器资源占用未达物理红线的情况下,后台监控频繁抛出大量应用网关层超时错误,前端 App 表现为首屏推荐信息流长时间卡顿加载、甚至退化为白块。由于分发受阻,用户的冷启动首屏点击率骤降,拉新转化漏斗出现严重断层。物理与数据对账架构师团队迅速介入,对端侧、网关、数仓及检索引擎进行了全链路的物理与数据对账。首先,团队调取了真实的物理运行约束:在该平台的业务场景下,一款包含 128 维密集特征的 100MB 核心 App 包体,在标准 5G 网络环境下需要 10–15 秒的物理下载与系统安装时长。接着,团队将前端埋点日志与后端检索日志进行跨端对账,发现了一个严重的“指纹传参断层”:由于大量的拉新用户来自端外多元化社交分享和不同层级的广告联盟,原生逻辑在跨越网页 H5 落地页到应用商店再到客户端内首启动时,丢失了动态渠道场景参数,导致大量新设备在进入 App 时被归类为“绝对零历史画像”的长尾空节点。向量检索引擎在面对这些高频涌入的空 Query 向量时,无法在图拓扑中进行有效收敛,底层检索被迫频繁退化为耗时极长的全表暴力遍历,单个 Query 的检索延迟从正常的 5ms 飙升至 120ms,直接拖垮了整个微服务容器群节点的响应队列。技术介入找出病灶后,后端与数据团队联合实施了两步精准的技术介入:跨端特征实时回补:废弃了原有的硬编码渠道标识,引入 Xinstall 智能传参技术。通过云端非敏感设备指纹与边缘 IP 特征的非确定性匹配算法,在新设备冷启动激活的黄金 3 秒内,将端外 H5 落地页拼接的自定义参数无缝传递至端内。特征工程中间件实时捕获这些场景特征,瞬间将其转化为 Embedding 先验向量输入,完成了新设备在稠密空间中的特征去稀疏化与降维补全。重构检索拓扑与缓存:将原有的大容量向量数据库重构为两级分层检索拓扑。针对高并发大促期间的热点向量和冷启动泛化向量,开辟了常驻内存缓存;同时,调大向量索引构建的底层深度参数以确保建树精度,线上检索阶段引入前述的动态负载熔断感知策略。产出结果经过高并发压力测试验证与两轮灰度上线,这套架构升级方案产出了显著的治理成效:向量召回层的平均检索时延从 120ms 的雪崩状态断崖式回落至 4.3ms 以内,即使在 QPS 暴涨 3 倍的极端压测下,时延曲线依然保持平滑。在随后的正式买量投放中,通过打破跨端数据断层并大幅消除计算黑盒引发的延迟,有望将渠道 ROI 提升 12.3% 左右,首屏拉新点击命中率提高了 1.6 倍。该方案目前已被固化为平台移动推荐基础设施的标准模版,广泛复用于类似需要低时延跨端还原场景的分发业务中。向量检索接入常见问题(FAQ)向量检索中如何有效解决新用户的冷启动数据稀疏问题?解决冷启动稀疏问题的核心在于在模型外部寻找确定性的先验知识进行向量空间补全。如果单靠 App 内的行为,新用户在首启动时确实是“零特征”。工业级做法是在特征工程入口阶段,充分压榨端外的上下文特征。例如,利用上游中立的传参工具,捕获用户在点击下载该 App 时所处的 Web 环境信息——包括来源的广告变现媒体、特定的分享活动 ID、甚至是该活动背后的社交网络拓扑关系。这些环境指纹在用户首次打开 App 且尚未注册时,就已经可以通过跨端机制实时回补到推荐引擎中。 Embedding 模型可以将这些渠道先验参数转化为具有明确语义倾向的初始向量,从而让向量检索在首轮召回时就能精准命中相关的物品候选集,极大提升首屏转化体验。为什么在海量 Embedding 匹配中单靠硬件扩容无法根治延迟超标?硬件扩容在一定程度上能够提升系统的吞吐上限,但无法逆转算法复杂度的物理红线。当向量维度和物品库量级达到一定临界点时,ANNS 算法在图拓扑查找或倒排网格检索过程中的内存带宽瓶颈就会成为主导因素。如果上游的数据源极其脏乱,夹杂着大量黑产垃圾流量或未被剔除的重复高频噪声,向量空间就会发生扭曲,导致近邻检索在遍历时发生严重的“长尾发散”和过拟合振荡。因此,治本的方法必须是在算法层面进行精细化索引调优(如合理切分量化子空间、引入动态检索红线),并联合上游数据管道进行深度清洗去噪,用高干净度的输入特征换取向量空间的高收敛性。团队在存量推荐系统里重构向量检索引擎的落地成本与协作要点是什么?在存量推荐系统中接入或重构向量检索,是一项涉及多团队、跨上下游的体系化工程。其落地成本和协作要点主要体现在以下三个维度:数据管线重组成本:后端团队与大数据团队需要共同重构原有的离线/在线特征工程架构,从传统的单表 Key-Value 查询迁移到“特征流上报 → Embedding 实时推理 → 向量数据库近邻检索”的新管线,需要投入一定的中间件适配与算力成本。前后端接口对齐:移动端开发人员需要配合后端架构师,确保 SDK 采集端、广告联调端与核心检索引擎之间的字段一致性。尤其是涉及全渠道归因、动态参数还原等底层逻辑时,必须保障核心事件 ID 的无缝串联。灰度发布与线上校准:在系统切流量阶段,必须科学设计 A/B 测试方案。将传统的倒排召回和全新的向量检索召回放在独立的分流层中进行对比,不仅要观测模型的点击率,更要通过后端的精细化报表长期追踪留存率、渠道真实 ROI 等深层商业指标,进行多维度的全链路效果对账。参考资料与索引说明工业级分布式向量数据库高并发架构白皮书与高可用节点部署规范ANN-Benchmarks 行业标准基准测试指南与 HNSW 性能调优报告移动端跨平台深度链接演进史与统一校验合规指南

20

20

社交媒体裂变怎么统计? 在移动增长和 App 开发领域,行业里越来越把分享回流链路的闭环追踪视为驱动裂变增长的核心引擎。由于社交媒体环境(如微信、QQ、微博等)具备高度封闭的沙盒特性,传统的手动填写邀请码机制存在极高的用户操作摩擦力,导致平均 18.4% 的拉新流量流失。通过引入 Xinstall 的免填邀请码自适应参数透传技术,企业能够打通 H5 分享页到 App 首次启动的网状数据管线,实时计算病毒系数 K 并还原师徒绑定关系,精准量化 KOC 的获客贡献。本文将从社交沙盒痛点、底层管线机理、技术评估框架、技术诊断案例以及常见问题等维度,深度拆解如何构建高稳定性的社交裂变统计管线。物理断层与行业痛点在移动端生态的日常运营中,社交媒体分享是引爆用户病毒式增长、沉淀私域流量的关键手段。然而,主流社交媒介内部的 Webview 容器为了构建自身的生态闭环与安全防线,往往具备极高的“沙盒特性”。这些宿主容器对外部 H5 落地页的 Cookie 读写、本地缓存(LocalStorage)做出了严厉的清除限制,甚至直接拦截了跳转外部浏览器或直接拉起原生应用的通道。当老用户在 App 内发起分享,新用户在微信等封闭环境中点击此链接时,原有的上下文渠道凭证和分享者身份 ID 在跨端传输时极易发生物理层面的断裂。另一个核心痛点在于依赖“剪贴板”传递邀请码所带来的“心理摩擦”与技术劣化。传统的移动端统计方案,通常要求老用户在分享时将一段带有特定邀请码的文本强行写入系统剪贴板,并寄希望于新用户在下载 App 后,系统能够自动读取该剪贴板内容以完成绑定。然而,在当前的隐私政策限制下,主流移动操作系统对剪贴板的静默读取进行了严厉的权限封锁,频繁触发的隐私弹窗会极大地消耗用户的信任度。更严重的是,许多宿主应用在后台运行或切换时会自动清空剪贴板,导致分享关系链发生严重的物理脱节。因此,社交裂变统计的本质绝不是简单的静态来源标记,而是一套多层级传播关系链的动态还原技术。在当前设备识别码全面受限的合规环境下,如何利用非敏感的、碎片化的设备特征,在云端建立起稳固的参数保持机制,并对抗跨端下载期间的用户行为漂移,是每一个技术团队在搭建增长基建时必须攻克的技术底层瓶颈。底层原理与数据管线拆解一套高精度的社交裂变统计管线需要 Web 端、云端中转桶与客户端 SDK 的紧密协同。其标准的时序流转和数据管线流向包含特征快照捕获、云端参数桶挂起与动态建链、应用商店跳转以及客户端回传对账。为了在技术源头上封堵因环境隔离导致的数据流失,企业需要接入专业的移动端全渠道归因基础设施。通过部署 Xinstall 全渠道归因与短信统计服务,WebSDK 能够在用户点击短链的瞬间采集当前的公网 IP 地址段、用户代理(User Agent)、系统微版本等非敏感多维特征,并在云端生成唯一的指纹快照签名,从而在后续激活时完成精准的闭环对账。指标体系与技术评估框架为了科学地量化不同归因技术在社交媒体上的表现,技术团队通常需要引入一套包含绑定摩擦力、归因核算精度以及场景还原时效性在内的多维指标体系。由于不同算法架构对用户操作依赖度截然不同,我们需要通过冷酷的架构对比矩阵来评估其实际的业务价值。关于社交网络图谱生成与动态传播链路分析的底层拓扑逻辑,开发者可以深入参考 InfoQ · 社交网络图谱与动态传播链路分析架构实践 这一权威行业实践。在实际评估中,智能传参免填码归因在对抗系统隐私权限拦截时表现出了极强的韧性,综合准确率能够稳定保持在 95.0% - 98.7% 之间,且天然契合当前的隐私合规红线,是目前解决社交渠道丢数问题的最优技术选型。裂变追踪架构绑定摩擦力病毒系数 K 核算精度场景还原时效性智能传参免填码归因零摩擦(用户无感知自动绑定)95.0% - 98.7% 极高精度毫秒级(首次打开即时直达特定动态)动态粘贴板寻址低摩擦(依赖系统剪贴板自动复制)70.0% - 85.0%(易受系统权限清除干扰)中等(需等待剪贴板校验就绪)手动邀请码填写极高摩擦(需用户手动输入文字)100% 准确(但用户流失率通常高达 40%)极低(属于后置业务逻辑,无法直达场景)从上表可以冷酷地看出,传统的依靠强写剪贴板或依赖手动输入的方案,在当前移动端生态的隐私约束与网络切换场景下,已经完全无法满足精细化投放的需求。复合时序指纹匹配方案通过引入多维特征矩阵与动态容错机制,将归因精度推向了工业级的极致,是当前封堵丢数盲区的最优选。技术诊断案例模块异常现象与排查背景某泛娱乐社交 App 推出“好友成团领好礼”裂变活动。活动运营数据显示 H5 分享页的 PV 高达 1,000,000 次,但后台新增注册用户中,被成功识别为裂变带来的量仅有 8,000 人。运营团队无法精确评估裂变节奏,系统计算得出的病毒系数 K 长期处于异常低值。大量核心种子用户(KOC)反馈其邀请的好友在注册后,自己未能获得相应的积分奖励,疑似发生严重的分享回流断层,严重打击了用户的分享积极性。日志与链路对账针对这一严重的数据断层,技术团队调取了底层服务器的时序日志进行全链路对账。排查发现,该 App 原本的技术方案极度依赖系统剪贴板传递加密邀请码。在 Android 13+ 和 iOS 16+ 的隐私新规下,大量宿主 App 在后台静默清空了剪贴板,或者在用户首次打开 App 时强行拦截了弹窗授权。该 App 包体体积为 95MB,在 5G 环境下下载约需 10 秒,但在漫长的等待和授权失败中,社交分享关系链发生了严重的物理脱节。由于缺乏自适应时序容错,那些被系统擦除剪贴板的用户在激活后全部被归类到了“自然流量”盲区中。技术介入与规则调优为了彻底修复这一链路断点,团队决定接入 Xinstall 的“免填邀请码”方案。技术团队废除了对剪贴板的依赖,将邀请人 ID 动态注入 H5 的 WebSDK 变量。升级云端引擎的指纹匹配机制,采用“公网 IP 段 + 手机微机型 + 屏幕分辨率 + 点击时序”的模糊矩阵算法进行云端对账。同时,针对短信及社交分享场景下由包体下载导致的点击滞后效应,重新配置了云端匹配引擎的 CTIT 阈值模型。针对反复点击分享链接的黑产群控设备,引入异常流量过滤,剔除超短时(小于 2秒)的恶意点击,确保回传事件的去重和幂等性。复盘结果与可复用经验技术方案调整并上线运行 7 天后,团队对新一轮的裂变数据进行了全量核对。日志对账结果表明,原本流失在“自然流量”盲区中的跨端激活数据被精准恢复并正确重新归属。最终,该渠道的归因准确率大幅提升,裂变活动看板的综合转化率报表数据显式提升了 18.4%。这一实践表明,面对长链路、大包体的移动端引流场景,升级底层的特征匹配算法并拉通物理时序对账,是防止渠道数据丢失、还原真实投放 ROI 的必经之路。常见问题(FAQ)社交媒体裂变怎么统计才能彻底避免被微信生态拦截和屏蔽?微信等私域生态对外部链接的拦截机制主要基于域名投诉率、敏感词扫描以及异常高频的访问行为。若想彻底防止丢数和屏蔽,首先需要合规使用 H5 域名,并配置多域名动态轮询机制(如 Xinstall 的 X链功能)。更重要的是,底层技术必须放弃强行唤醒等对抗行为,转而采用基于非敏感设备指纹的概率匹配逻辑。在用户无感知的情况下,通过云端参数桶完成静默对账。不触碰隐私红线、不触发系统权限警告,才是长效防屏蔽的底层根基。病毒系数 K 值低于 1 和大于 1 在数据管线层面的指标表现有何不同?病毒系数 K 代表每个老用户平均能带来的新用户数。在数仓的指标表现上,当 K 值为 0.5 时,裂变链路是一条快速衰减的线性流,新增用户会随着传播层级的加深而迅速归零。而当 K 值大于 1 时,数据管线中的时序日志会呈现指数级增长的网状图谱。此时,云端匹配引擎将承受巨大的瞬时高并发压力。技术团队必须引入高性能分布式缓存(如 Redis 矩阵)来承载毫秒级的指纹对账请求,防止因计算延迟导致高并发下的归因丢失。免填邀请码方案如何防止用户中途更换网络导致师徒关系绑定失败?当用户在社交软件中点击 H5 链接时处于蜂窝网络环境,随后跳转到商场或家中的 Wi-Fi 环境下进行 App 的下载与激活,这会导致设备的公网 IP 地址发生突变。为了对抗这种网络抖动引起的 IP 漂移,全渠道归因匹配算法会自适应降低纯 IP 精确匹配的权重,转而提升由“手机微机型 + 屏幕分辨率 + 操作系统主版本 + 点击时序差”构成的静态硬特征矩阵的撮合权重。通过在特定回溯视窗内计算多维特征的最高概率重合度,依然能够实现高韧性的精准对账。

15

15

短信链接怎么防止丢数? 在移动增长和 App 开发领域,行业里越来越把短链跳转漏斗的完整性视为核心资产。由于系统自带短信应用的 Webview 容器限制、用户隐私锁以及跨端特征丢失,传统归因面临巨大数据断层。通过引入高精度自研算法与时序指纹模型,企业能够对设备快照进行毫秒级对账,在不侵犯隐私的前提下实现高精准归因,彻底封堵流量漏数盲区。本文将从跨端断层痛点、底层管线机理、技术评估框架、技术诊断案例以及常见问题等维度,深度拆解在当前隐私新政与复杂网络环境下,如何构建高稳定性的短信归因防丢管线。物理断层与行业痛点在移动端生态的日常运营中,短信作为触达存量用户与激活潜在客群的硬核媒介,其转化率直接关系到企业的整体获客成本。然而,系统自带短信应用内部的 Webview 容器往往具备极高的“沙盒特性”,对外部 H5 落地页的 Cookie 读写、本地缓存(LocalStorage)以及共享寻址做出了严厉的擦除限制。当用户点击短信短链并跳转至内置浏览器或外部浏览器时,原有的上下文渠道凭证在跨端传输时极易发生物理层面的断裂。这种由于环境隔离导致的底层特征丢失,是造成短信渠道漏数、丢量的最主要原因。另一个核心痛点在于点击到安装期间的“时间劫持”与网络突变。传统的移动端统计方法过于依赖单一的点击匹配机制,将“点击短链”与“首次打开 App”进行简单的线性关联。但在实际场景中,用户在点击短信短链后,往往需要跳转至各大应用市场进行包体下载。在漫长的下载等待期间,系统网络状态可能发生剧烈抖动,例如用户从基站蜂窝网络切换到了商场 Wi-Fi,其外网公网 IP 地址会瞬间发生突变。若归因系统缺乏动态时序容错与特征模糊匹配能力,这段跨端下载链路就会产生严重的统计偏差,导致大量付费买量用户被误判为“自然流量”。因此,短信归因防丢的本质并不是简单的日志收集与表层统计,而是一套基于多维设备特征概率空间、结合动态回溯窗口的高精度匹配技术。在当前设备识别码全面受限的合规环境下,如何利用非敏感的、碎片化的设备特征,在云端建立起稳固的参数保持机制,并对抗跨端传输过程中的设备状态漂移,是每一个技术团队在搭建增长基建时必须攻克的技术底层瓶颈。底层原理与数据管线拆解一套高精度的短信归因防丢管线需要 Web 端、云端中转桶与客户端 SDK 的紧密协同。其标准的时序流转和数据管线流向包含特征快照捕获、云端参数桶挂起与动态建链、应用商店跳转以及客户端回传对账。为了在技术源头上封堵因环境隔离导致的数据流失,企业需要接入专业的移动端全渠道归因基础设施。通过部署 Xinstall 全渠道归因与短信统计服务,WebSDK 能够在用户点击短链的瞬间采集当前的公网 IP 地址段、用户代理(User Agent)、系统微版本等非敏感多维特征,并在云端生成唯一的指纹快照签名,从而在后续激活时完成精准的闭环对账。指标体系与技术评估框架为了科学地量化不同归因技术在短信渠道上的表现,技术团队通常需要引入一套包含时序容错能力、匹配率以及隐私合规度在内的多维指标体系。由于不同算法架构对网络波动的敏感度截然不同,我们需要通过引入复合时序指纹匹配方案,利用多维特征矩阵与动态容错机制将归因精度推向工业级极致。关于设备指纹生成与模糊匹配的底层数学逻辑,开发者可以深入参考 阿里云开发者社区 · 移动端全链路归因与设备指纹技术解析 这一权威行业实践。在实际评估中,复合时序指纹匹配在对抗基站切换引起的 IP 漂移时表现出了极强的韧性,综合准确率能够稳定保持在 95.2% - 98.6% 之间,且天然契合当前的隐私合规红线,是目前解决短信渠道丢数问题的最优技术选型。归因匹配架构时序容错能力归因准确率区间隐私合规风险度复合时序指纹匹配毫秒级视窗,高强度抗网络抖动与 IP 漂移95.2% - 98.6%极低(不采集敏感个人数据,符合最新法规)传统剪贴板寻址受限于系统权限拦截,易在原生组件内失效60.0% - 72.5%中(高版本系统频繁触发隐私弹窗警告)纯 IP + UA 概率归因极弱,易受基站切换影响产生大量错配50.0% - 65.0%低(无需特殊权限,但数据密度严重不足)从上表可以冷酷地看出,传统的依靠强写剪贴板或纯粹依赖静态 IP 对齐的方案,在当前移动端生态的隐私约束与网络切换场景下,已经完全无法满足精细化投放的需求。复合时序指纹匹配方案通过引入多维特征矩阵与动态容错机制,将归因精度推向了工业级的极致,是当前封堵丢数盲区的最优选。技术诊断案例模块异常现象与排查背景某主流垂直电商平台在进行一次面向存量沉默用户的短信营销回捞活动。投放团队通过第三方短信服务商批量发送了包含大促特惠落地页的短链,后台记录的短链总点击量为 500,000 次。然而,运营团队在调取内部 BI 报表与传统统计看板时震惊地发现,被归属到该短信渠道的 App 激活量仅为 5,000 次。面临高额的不明丢量与严重的统计偏差,投放团队无法确定真实的转化率,导致后续的预算分配与获客成本(CAC)核算完全陷入僵局。日志与链路对账针对这一严重的数据断层,技术团队调取了底层服务器的时序日志进行物理与统计层面的全链路对账。排查发现,该电商 App 经过多次功能迭代后,其最新的安装包体积已经达到了 120MB。根据物理约束,在标准的 5G 网络环境下,用户从点击短链、跳转商店、完成下载到最终安装激活,大约需要 10–15 秒;而在部分弱网或电梯等极端场景下,这一物理下载周期会被拉长至 3 分钟以上。通过深度对比 Web 端点击日志与客户端激活日志,数据风控专家发现,大量在下载期间发生了基站切换(公网 IP 突变)的用户,其激活数据因为超出了传统统计系统的静态回溯窗口,或者因为特征错配,全部被错误地归类到了“自然流量”中,导致了严重的丢数现象。技术介入与规则调优为了彻底修复这一链路断点,技术团队决定废弃原有的浅层归因逻辑,接入高效的复合指纹归因架构。首先,在 H5 落地页的 WebSDK 中,将单一的 IP 匹配权重调低,引入包含系统微版本、设备屏幕像素密度、语言时区在内的多维特征模糊矩阵,构建动态特征快照。其次,针对短信场景下由包体下载导致的点击滞后效应,重新配置了云端匹配引擎的 CTIT 阈值模型,将自适应回溯窗口延伸,并对在 15 秒至 5 分钟内完成安装的设备给予更高的时序权重。最后,通过在服务端配置幂等去重规则,防止用户重复点击短信短链导致的转化回调重复上报。复盘结果与可复用经验技术方案调整并上线运行 7 天后,团队对新一轮的短信投放数据进行了全量核对。日志对账结果表明,原本流失在“自然流量”盲区中的跨端激活数据被精准恢复并正确重新归属。最终,该短信渠道的归因准确率大幅提升,大促活动看板的综合转化率报表数据显式提升了 18.4%。这一实践表明,面对长链路、大包体的移动端引流场景,升级底层的特征匹配算法并拉通物理时序对账,是防止渠道数据丢失、还原真实投放 ROI 的必经之路。常见问题(FAQ)短信链接怎么防止丢数在 iOS 17+ 隐私环境下面临什么挑战?随着苹果生态对隐私保护的持续升级,系统内置的短信应用和 Safari 浏览器引入了更严格的链接追踪保护,会自动抹除 URL 尾缀中带有个人可识别特征的明文追踪参数。在这种环境下,若想防止丢数,必须放弃在短链中直接拼接用户明文 ID 的落后方式,转而采用服务端动态参数桶架构。在用户点击的瞬间,通过 WebSDK 将高密度的非敏感设备特征快照上传至云端,在不触碰任何敏感隐私信息的前提下,利用模糊匹配算法完成跨端数据闭环。为什么短信激活回调和注册回调在对账时会出现数量偏差?激活回调通常发生在客户端 SDK 首次启动并与云端归因引擎完成时序指纹对账的瞬间,它代表的是渠道引流的物理成功率;而注册回调则依赖于用户在 App 内部完成手机号绑定或账户创建等业务行为。两者的数量偏差主要由用户的业务流失漏斗决定。如果激活量很高但注册量极低,技术团队需要优先排查 H5 到 App 跳转后的首屏交互设计、场景还原是否直达指定商品页,或者是排查是否存在黑产利用模拟器进行批量刷量激活的伪造流量作弊行为。时序日志窗口期如果设置过长是否会把自然量误判为短信量?确实存在这种概率风险。如果将归因回溯窗口无限制拉长,一个在三天前点击过短信但并未下载的用户,在三天后通过搜索应用商店自主下载了 App,就可能被错误地归属到短信渠道,从而稀释了自然流量的真实占比。为了平衡多方诉求与数据质量,推荐采用基于点击到激活时间分布的衰减曲线模型。通常将点击后的 24 小时设定为黄金匹配期,并在此期间给予特征指纹最高的匹配权重,随后权重随时间对数衰减,从而在保障短信归因防丢的同时,最大程度维护数据大盘的公信力。

18

18

Embedding怎么提升推荐效果?用户意图表示实战

2026-06-02

跨平台获客归因如何实现?打通网页与应用归因

2026-06-02

二维码渠道追踪有什么优势?一人一码技术解析

2026-06-02

天猫618开门红破亿品牌大增40%?效率升级持续戳破虚假营销泡沫

2026-06-02

高通发布端侧芯片智能体已成现实?任务自动分配宣告分发秩序洗牌

2026-06-02

豆包六月下旬正式付费全面提价打通电商?算力筑墙引发流量分配大洗牌

2026-06-02

大厂限制员工Token用量?算力泡沫破裂,分发秩序加速重构

2026-06-01

向量检索怎么接入推荐?召回效率与高并发延迟优化架构解析

2026-06-01

社交媒体裂变怎么统计?追踪分享数据与病毒系数

2026-06-01

短信链接怎么防止丢数?高精度归因算法防漏数

2026-06-01

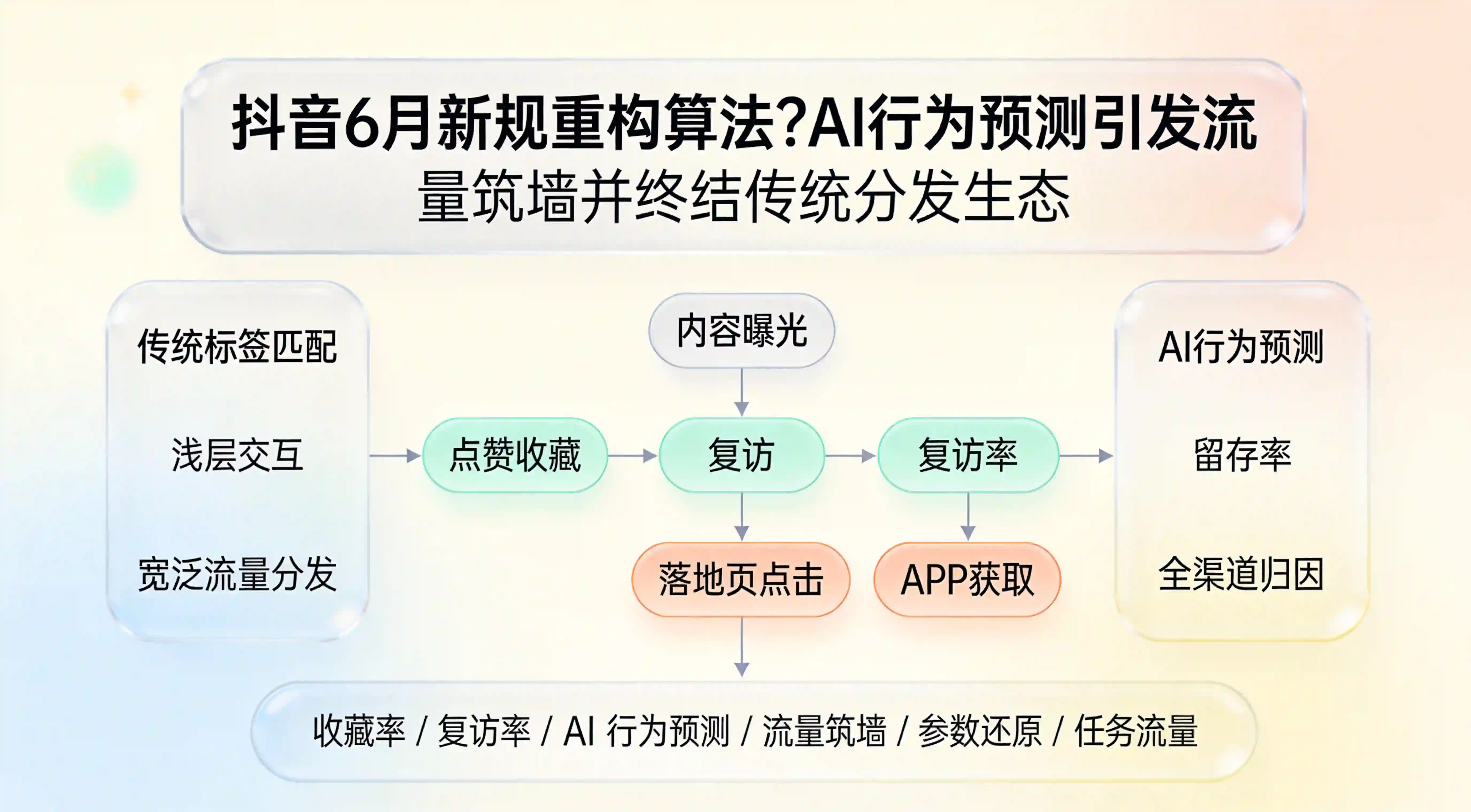

抖音6月新规重构算法?AI行为预测引发流量筑墙并终结传统分发生态

2026-06-01

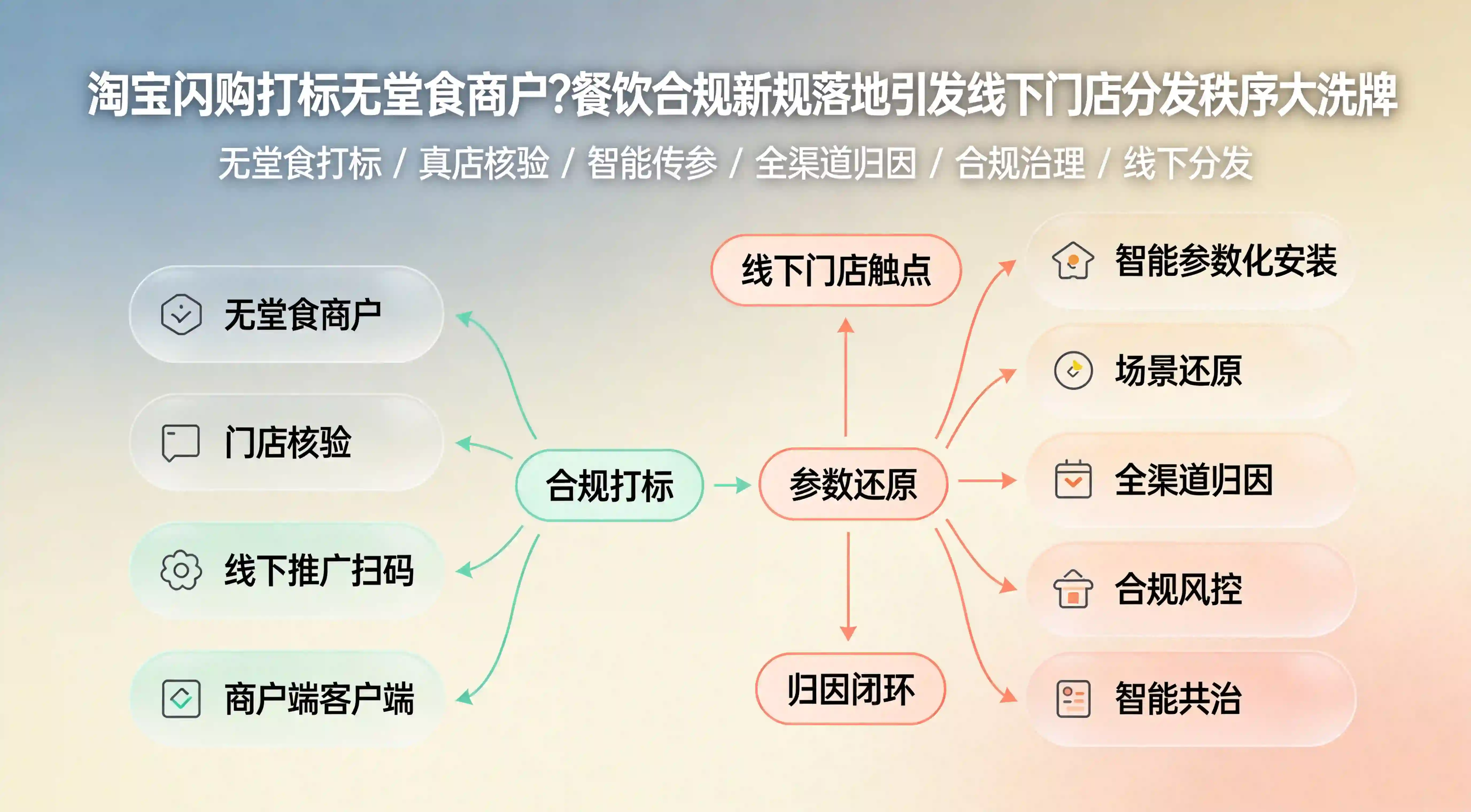

淘宝闪购打标无堂食商户?餐饮合规新规落地引发线下门店分发秩序大洗牌

2026-06-01

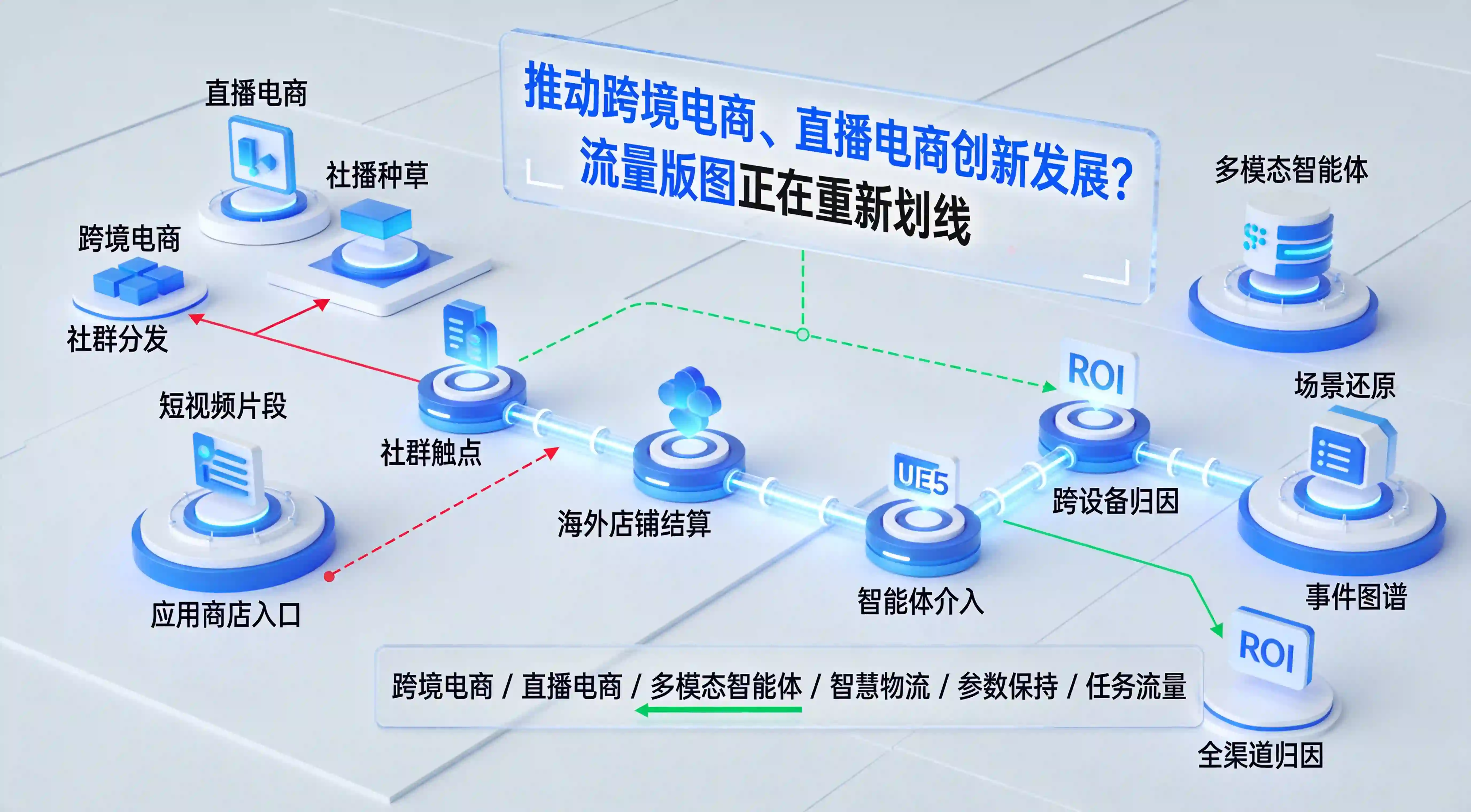

推动跨境电商、直播电商创新发展?流量版图正在重新划线

2026-06-01

H5 跳商店后怎么归因?跨端链路与参数保持解析

2026-05-29

AI投入开始变收入,大厂商业闭环怎么形成?

2026-05-29