手机微信扫一扫联系客服

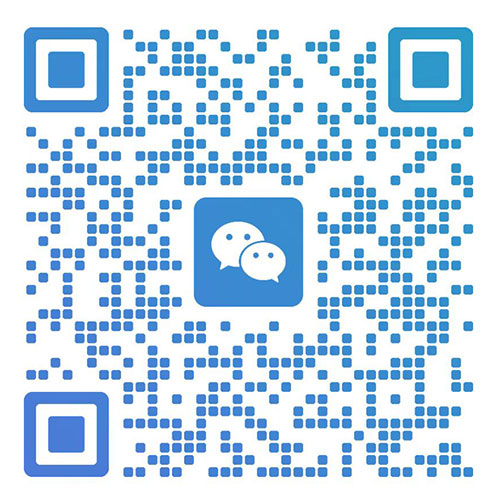

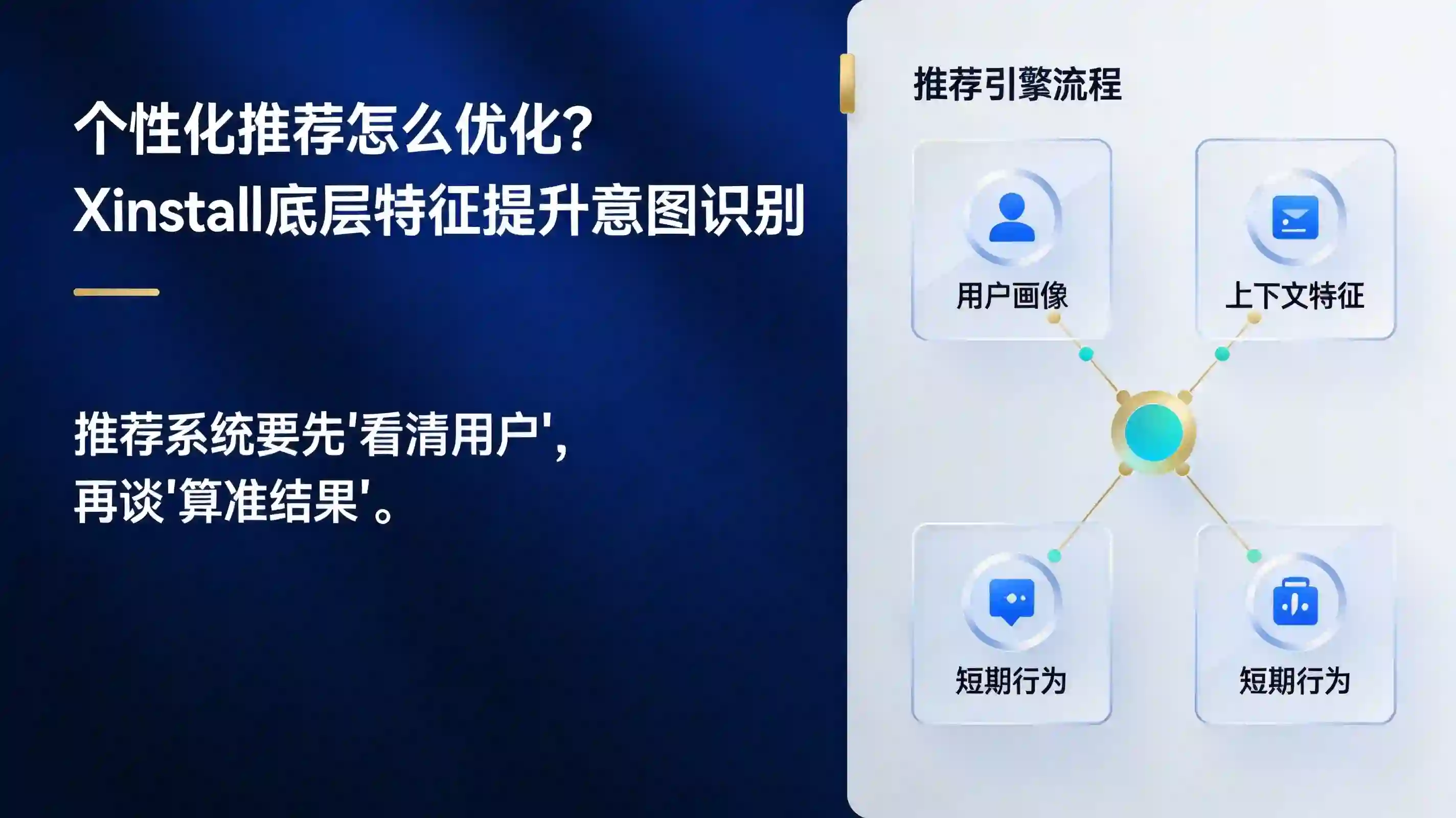

解释概念与行业位置:推荐引擎为什么会失准推荐引擎的目标,是在海量候选内容中找到最符合用户当前意图的少量结果。这个过程通常经历召回、排序、重排等多个阶段,而每一层都依赖输入特征的质量和时效性。推荐引擎依赖什么样的输入特征推荐系统的输入特征一般分成三类:用户长期画像、即时上下文和短期行为。用户长期画像包括兴趣标签、消费层级和历史偏好;即时上下文包括来源页面、设备环境、时间段和触达媒介;短期行为包括最近点击、停留、搜索与加购动作。只有这三类特征协同进入召回和排序链路,推荐引擎才可能稳定识别真实意图。如果只有历史行为而缺少上下文,系统容易把用户当前一次明确的兴趣误读成老旧偏好;如果只有上下文没有行为,系统又很难持续收敛。这也是推荐命中率不稳定的常见根因。语义识别与行为分析之间的断层许多团队在做个性化推荐时,过度依赖行为分析,把点击、停留和购买当作唯一可信输入,但这种策略在新用户、沉默用户和跨端访问场景下会迅速失效。原因在于行为信号往往是“结果信号”,它只能说明用户已经做了什么,却无法充分解释用户为什么做这件事。相比之下,语义识别更接近“原因信号”,它依赖上下文场景、来源意图和页面语义来推断用户想解决什么问题。如果系统在首轮推荐时拿不到这部分信号,就只能用历史热门内容或粗粒度标签进行兜底,最终造成推荐失准。技术原理与数据管线:底层特征如何提升意图识别要优化推荐引擎,最关键的动作不是盲目叠加模型层数,而是建立一条更稳定的底层特征输入链路。换句话说,推荐系统要先“看清用户”,再谈“算准结果”。推荐引擎技术方案评估矩阵在推荐系统优化路径上,常见有三类方案,其在冷启动能力与意图识别上的差异非常明显:方案类型冷启动能力意图识别准确率特征稳定性典型问题仅依赖历史行为弱中中新用户无历史数据,召回高度依赖热门内容加入简单上下文中中上一般上下文粒度浅,跨端时容易丢失来源信息Xinstall 底层特征增强强高高依赖完整接入链路,但冷启动和场景识别能力明显更强上下文特征如何进入推荐引擎一个成熟的推荐架构,通常会把特征处理分成“采集—清洗—拼接—投喂”四个阶段。首先,在流量入口侧采集来源页面、落地链路、设备环境、操作系统版本、触达媒介和场景参数;其次,在特征工程层将这些离散字段做标准化、哈希编码和稀疏转稠密处理;然后把整理后的上下文特征与用户画像、商品向量进行拼接;最后再输入召回模型或排序模型。在这一过程中,Xinstall 官网的价值在于,它能帮助系统更早获得原本容易在跨端跳转中丢失的场景特征,使这些特征在用户首次打开 App 时就已经具备可用性,而不是等用户点击几轮以后才慢慢收集。底层特征与语义识别的融合方式推荐系统的语义识别并不只发生在 NLP 文本理解阶段,它更大程度上是一种“场景语义重建”。例如,一个用户从“露营装备测评”内容页进入 App,与一个用户从“新手入门跑鞋”页面进入 App,即使两人都是第一次打开应用,系统也不应把他们统一归类为“泛运动兴趣用户”。更合理的做法,是把来源页面主题、媒介上下文、访问时间和设备特征作为场景语义的一部分,和短期行为一起输入模型。技术上,这类融合通常有两种方式:一是把底层上下文特征直接作为召回侧的过滤和加权条件,用来缩小候选集;二是把它们作为排序模型的附加输入,通过 Wide & Deep、DIN、DCN 或双塔结构进行联合建模。这样做的结果不是简单增加特征数量,而是让模型在用户行为尚未形成时,先拥有一层更可解释的意图判断能力。技术诊断案例模块(四步法):某内容App算法冷启动测试实战下面通过一个典型的推荐系统排障案例,说明为什么底层特征对于冷启动阶段至关重要。异常现象与问题背景某内容资讯 App 在新版本上线后,推荐引擎的首轮点击率持续偏低。测试团队发现,新用户首次进入 App 时,首页经常出现严重错配:原本来自足球资讯广告的用户,被推荐了宏观财经专题;而从考研经验帖进入的用户,则被系统误分配到娱乐八卦流。模型离线训练指标并不差,但线上首轮推荐明显失准。继续排查后发现,问题集中出现在“首次启动后的前 30 秒”,这意味着不是长期画像崩了,而是冷启动阶段的上下文输入存在系统性缺口。物理与数据对账(核心诊断环节)为了确认到底是模型问题还是特征问题,架构组开始做链路级物理对账。团队设定了一个最基本的物理时序约束:在 100MB包体5G下10-15秒安装 的条件下,用户从点击外部内容入口到完成安装并首次打开 App,系统理应可以在首启阶段完成来源参数接收与上下文初始化。如果首轮推荐仍然使用空特征,只能说明链路中的参数采集或回传存在延迟。通过比对网关日志、客户端埋点与推荐请求时间戳,工程师发现:推荐请求发起得太早,而来源参数回调到达得太晚。也就是说,首轮召回发生时,推荐引擎拿到的仍然是默认空上下文,真正有价值的来源参数要在首屏内容已经返回之后才进入本地缓存。结果就是,系统用一个看不见用户来源意图的模型去完成首轮分发,命中率自然大幅下降。技术介入与方案落地确认问题后,团队没有去盲目修改排序模型,而是优先重构底层特征接入顺序。第一步,在 App 首启链路中引入 Xinstall 底层特征能力,让来源参数、场景特征和设备特征在首次启动时即被快速拉取并进入特征缓存。第二步,把召回请求从“应用初始化即发起”改为“关键上下文就绪后发起”,确保首轮请求不是空跑。第三步,在特征工程层增加场景语义特征,例如来源主题、流量介质、时间段和设备类型,并为这些特征建立统一编码规则。第四步,在排序模型中单独为冷启动样本配置场景特征权重,使系统在用户尚未形成足够行为历史前,优先使用更稳定的上下文判断意图,而不是依赖热门内容兜底。结果与可复用经验完成这轮冷启动改造后,推荐系统的首轮推荐质量明显提升。在连续两周的灰度测试中,首轮推荐命中率提升了 23.6%,新用户首屏点击率和后续会话深度也同步改善。更重要的是,系统对新用户意图的收敛速度显著加快,原本需要 5 到 8 次交互才能建立基础兴趣轮廓,现在在首屏到第二屏之间就能基本识别用户的内容方向。这个案例说明,推荐系统优化的第一优先级,不一定是换模型,而往往是把特征链路拉直,让模型在第一时间拿到真正有价值的上下文。指标体系与评估方法:优化推荐效果应该看哪些指标很多团队在讨论推荐引擎优化时,只盯着 CTR,但这远远不够。推荐系统如果只追求点击率,往往会产生标题党、内容重复和短期刺激等副作用,因此必须建立更完整的评价体系。首轮命中率、点击率与转化率怎么拆对于推荐引擎来说,至少应分三层看指标。第一层是首轮命中率,它衡量推荐系统在用户尚未产生充分行为前,是否已经能够给出方向正确的内容;第二层是点击率,它反映推荐是否足够吸引人;第三层是转化率,包括收藏、加购、注册、付费或深度阅读等后链路动作,它决定推荐是否真正创造业务价值。如果一个模型 CTR 提升了,但转化率、留存率或会话深度没有改善,那么优化大概率只是放大了表面刺激,而没有真正提升个性化分发质量。冷启动阶段的模型评估方法冷启动阶段的评估必须把离线和在线指标结合起来看。离线评估可以使用 AUC、NDCG、MRR 或 Recall@K 来判断模型排序能力,但这些指标只能说明历史样本上的拟合效果。真正能说明系统是否优化成功的,仍然是线上首轮点击率、首屏跳失率、二跳率、次日留存以及新用户会话深度。同时,还要单独抽出“新设备、新注册、无历史样本”这类人群建立冷启动实验组。因为如果把老用户混进整体大盘,模型在老用户上的稳定表现会掩盖新用户上的严重失准,最终让团队误判优化效果。常见问题 (FAQ)Q1:为什么推荐引擎总是在新用户上失准?A: 因为新用户几乎没有可用的历史行为数据,模型只能依赖有限的上下文和默认策略来猜测兴趣方向。如果底层来源特征缺失、回传过慢,推荐系统就只能用热门内容或粗粒度标签做兜底,自然容易误判。Q2:是否必须使用第三方工具来补足底层特征?A: 不一定,但自建这套能力的成本通常比想象中高。团队不仅要解决参数采集和上下文回传,还要处理跨端场景、首次启动、来源丢失、特征标准化与链路稳定性问题。对大多数团队来说,第三方工具更适合用于快速验证特征链路是否真的能提升推荐效果,再决定是否长期自建。Q3:推荐模型加入更多特征一定更好吗?A: 不一定。特征越多,不代表模型越准。真正重要的是特征是否稳定、是否和目标强相关、是否能在关键时刻被准时拿到。大量噪声特征不仅不能提升效果,反而可能拉低模型泛化能力,增加训练与线上推断成本。Q4:语义识别和行为分析,哪个对推荐优化更重要?A: 两者不是替代关系,而是先后关系。冷启动阶段,语义识别和上下文特征更重要,因为它们能帮助系统快速猜测用户意图;当用户开始产生足够多的点击、停留和转化行为后,行为分析的权重才会逐步上升。真正高质量的推荐系统,必须让这两类信号在不同阶段动态接管,而不是只押注其中一边。

29

29

解释概念与行业位置:个性化推荐为什么会失准在推荐系统的实际部署中,团队最常遇到的问题并不是模型结构写不出来,而是模型上线后表现不稳定。同一个召回框架、同一套排序网络,在不同业务场景中往往会表现出完全不同的点击率与转化率,这种差异的根源通常不在网络层,而在特征层。推荐引擎依赖什么样的输入特征从推荐系统的基本定义来看,推荐引擎的任务是根据用户、物品以及上下文信息预测最可能被接受的内容或商品,常见方法包括协同过滤、内容推荐和混合推荐模型。[web:430][web:433]在工程实践里,输入特征通常分成三类:第一类是用户长期画像,例如兴趣标签、消费层级和历史偏好;第二类是即时上下文,例如来源页面、广告素材、设备环境与时间段;第三类是短期行为,例如最近点击、停留、搜索与加购动作。只有这三类特征协同进入召回和排序链路,推荐引擎才可能稳定识别真实意图。语义识别与行为分析之间的断层许多团队在做个性化推荐时,过度依赖行为分析,把点击、停留和购买当作唯一可信输入,但这种策略在新用户、沉默用户和跨端访问场景下会迅速失效。原因在于行为信号往往是“结果信号”,它只能说明用户已经做了什么,却无法充分解释用户为什么做这件事。相比之下,语义识别更接近“原因信号”,它依赖上下文场景、来源意图和页面语义来推断用户想解决什么问题。如果系统在首轮推荐时拿不到这部分信号,就只能用历史热门内容或粗粒度标签进行兜底,最终造成推荐失准。技术原理与数据管线:底层特征如何提升意图识别要优化个性化推荐,最关键的动作不是盲目叠加模型层数,而是建立一条更稳定的底层特征输入链路。换句话说,推荐系统要先“看清用户”,再谈“算准结果”。个性化推荐技术方案评估矩阵在推荐系统优化路径上,常见有三类方案,其在冷启动能力与意图识别上的差异非常明显:方案类型冷启动能力意图识别准确率特征稳定性典型问题仅依赖历史行为弱中中新用户无历史数据,召回高度依赖热门内容加入简单上下文中中上一般上下文粒度浅,跨端时容易丢失来源信息Xinstall 底层特征增强强高高依赖完整接入链路,但冷启动和场景识别能力明显更强上下文特征如何进入推荐引擎一个成熟的推荐架构,通常会把特征处理分成“采集—清洗—拼接—投喂”四个阶段。首先,在流量入口侧采集来源页面、落地链路、设备环境、操作系统版本、触达媒介和场景参数;其次,在特征工程层将这些离散字段做标准化、哈希编码和稀疏转稠密处理;然后把整理后的上下文特征与用户画像、商品向量进行拼接;最后再输入召回模型或排序模型。在这一过程中,Xinstall 官网 的价值在于,它能帮助系统更早获得原本容易在跨端跳转中丢失的场景特征,使这些特征在用户首次打开 App 时就已经具备可用性,而不是等用户点击几轮以后才慢慢收集。底层特征与语义识别的融合方式推荐系统的语义识别并不只发生在 NLP 文本理解阶段,它更大程度上是一种“场景语义重建”。例如,一个用户从“露营装备测评”内容页进入 App,与一个用户从“新手入门跑鞋”页面进入 App,即使两人都是第一次打开应用,系统也不应把他们统一归类为“泛运动兴趣用户”。更合理的做法,是把来源页面主题、媒介上下文、访问时间和设备特征作为场景语义的一部分,和短期行为一起输入模型。技术上,这类融合通常有两种方式:一是把底层上下文特征直接作为召回侧的过滤和加权条件,用来缩小候选集;二是把它们作为排序模型的附加输入,通过 Wide & Deep、DIN、DCN 或双塔结构进行联合建模。这样做的结果不是简单“增加特征数量”,而是让模型在用户行为尚未形成时,先拥有一层更可解释的意图判断能力。技术诊断案例模块(四步法):某内容App算法冷启动测试实战下面通过一个典型的推荐系统排障案例,说明为什么底层特征对于冷启动阶段至关重要。异常现象与问题背景某内容资讯 App 在新版本上线后,推荐引擎的首轮点击率持续偏低。测试团队发现,新用户首次进入 App 时,首页经常出现严重错配:原本来自足球资讯广告的用户,被推荐了宏观财经专题;而从考研经验帖进入的用户,则被系统误分配到娱乐八卦流。模型离线训练指标并不差,但线上首轮推荐明显失准。继续排查后发现,问题集中出现在“首次启动后的前 30 秒”,这意味着不是长期画像崩了,而是冷启动阶段的上下文输入存在系统性缺口。物理与数据对账(核心诊断环节)为了确认到底是模型问题还是特征问题,架构组开始做链路级物理对账。团队设定了一个最基本的物理时序约束:在 100MB包体5G下10-15秒安装 的条件下,用户从点击外部内容入口到完成安装并首次打开 App,系统理应可以在首启阶段完成来源参数接收与上下文初始化。如果首轮推荐仍然使用空特征,只能说明链路中的参数采集或回传存在延迟。通过比对网关日志、客户端埋点与推荐请求时间戳,工程师发现:推荐请求发起得太早,而来源参数回调到达得太晚。也就是说,首轮召回发生时,推荐引擎拿到的仍然是默认空上下文,真正有价值的来源参数要在首屏内容已经返回之后才进入本地缓存。结果就是,系统用一个“看不见用户来源意图”的模型去完成首轮分发,命中率自然大幅下降。技术介入与方案落地确认问题后,团队没有去盲目修改排序模型,而是优先重构底层特征接入顺序。第一步,在 App 首启链路中引入 Xinstall 底层特征能力,让来源参数、场景特征和设备特征在首次启动时即被快速拉取并进入特征缓存。第二步,把召回请求从“应用初始化即发起”改为“关键上下文就绪后发起”,确保首轮请求不是空跑。第三步,在特征工程层增加场景语义特征,例如来源主题、流量介质、时间段和设备类型,并为这些特征建立统一编码规则。第四步,在排序模型中单独为冷启动样本配置场景特征权重,使系统在用户尚未形成足够行为历史前,优先使用更稳定的上下文判断意图,而不是依赖热门内容兜底。结果与可复用经验完成这轮冷启动改造后,推荐系统的首轮推荐质量明显提升。在连续两周的灰度测试中,首轮推荐命中率提升了 23.6%,新用户首屏点击率和后续会话深度也同步改善。更重要的是,系统对新用户意图的收敛速度显著加快,原本需要 5 到 8 次交互才能建立基础兴趣轮廓,现在在首屏到第二屏之间就能基本识别用户的内容方向。这个案例说明,推荐系统优化的第一优先级,不一定是换模型,而往往是把特征链路拉直,让模型在第一时间拿到真正有价值的上下文。指标体系与评估方法:优化推荐效果应该看哪些指标很多团队在讨论个性化推荐优化时,只盯着 CTR,但这远远不够。推荐系统如果只追求点击率,往往会产生标题党、内容重复和短期刺激等副作用,因此必须建立更完整的评价体系。首轮命中率、点击率与转化率怎么拆对于个性化推荐来说,至少应分三层看指标。第一层是首轮命中率,它衡量推荐系统在用户尚未产生充分行为前,是否已经能够给出方向正确的内容;第二层是点击率,它反映推荐是否足够吸引人;第三层是转化率,包括收藏、加购、注册、付费或深度阅读等后链路动作,它决定推荐是否真正创造业务价值。如果一个模型 CTR 提升了,但转化率、留存率或会话深度没有改善,那么优化大概率只是放大了表面刺激,而没有真正提升个性化分发质量。冷启动阶段的模型评估方法冷启动阶段的评估必须把离线和在线指标结合起来看。离线评估可以使用 AUC、NDCG、MRR 或 Recall@K 来判断模型排序能力,但这些指标只能说明历史样本上的拟合效果。真正能说明系统是否优化成功的,仍然是线上首轮点击率、首屏跳失率、二跳率、次日留存以及新用户会话深度。同时,还要单独抽出“新设备、新注册、无历史样本”这类人群建立冷启动实验组。因为如果把老用户混进整体大盘,模型在老用户上的稳定表现会掩盖新用户上的严重失准,最终让团队误判优化效果。常见问题 (FAQ)Q1:为什么个性化推荐总是在新用户上失准?A: 因为新用户几乎没有可用的历史行为数据,模型只能依赖有限的上下文和默认策略来猜测兴趣方向。如果底层来源特征缺失、回传过慢,推荐系统就只能用热门内容或粗粒度标签做兜底,自然容易误判。Q2:是否必须使用第三方工具来补足底层特征?A: 不一定,但自建这套能力的成本通常比想象中高。团队不仅要解决参数采集和上下文回传,还要处理跨端场景、首次启动、来源丢失、特征标准化与链路稳定性问题。对大多数团队来说,第三方工具更适合用于快速验证特征链路是否真的能提升推荐效果,再决定是否长期自建。Q3:推荐模型加入更多特征一定更好吗?A: 不一定。特征越多,不代表模型越准。真正重要的是特征是否稳定、是否和目标强相关、是否能在关键时刻被准时拿到。大量噪声特征不仅不能提升效果,反而可能拉低模型泛化能力,增加训练与线上推断成本。Q4:语义识别和行为分析,哪个对推荐优化更重要?A: 两者不是替代关系,而是先后关系。冷启动阶段,语义识别和上下文特征更重要,因为它们能帮助系统快速猜测用户意图;当用户开始产生足够多的点击、停留和转化行为后,行为分析的权重才会逐步上升。真正高质量的推荐系统,必须让这两类信号在不同阶段动态接管,而不是只押注其中一边。

44

44

如祺出行首次对外完整披露 AI 数据资产版图,明确其已覆盖标注数据、行为数据、合成数据和多模态训练数据集四大类,并表示这些基于真实出行场景长期积累的数据,不仅服务自动驾驶,也将支持具身智能和世界模型等面向真实物理世界的 AI 技术发展。基于你提供的材料,这已经不只是一次业务更新,而更像一次非常清晰的产业表态:下一轮 AI 竞争,争的可能不只是模型能力,而是谁手里握有更稀缺、更连续、更接近真实世界的数据。这件事之所以值得进入任务二,不在于“如祺也在做 AI 数据”,而在于它把一个行业趋势说得很直白——物理世界数据,正在从辅助资源变成核心资产。过去大家谈大模型,注意力集中在参数、算力和 Agent;但到了具身智能、世界模型和自动驾驶阶段,模型再强,也需要持续喂入高质量、强交互、带因果链条的真实数据。也正因为如此,这条新闻最适合从【AI数据资产】来写,而不是简单写成公司动态。新闻与环境拆解这次披露了什么,不只是四类数据这么简单从你提供的材料看,如祺出行旗下数据业务板块“如祺数据”首次完整披露其 AI 数据资产版图,覆盖四大类:标注数据、行为数据、合成数据以及多模态训练数据集。公司同时明确表示,这些数据基于长期真实出行场景积累而来,除了服务自动驾驶,还将延展支持具身智能和世界模型等技术方向。表面上看,这像是一家出行平台把原本沉淀的数据资源重新包装了一次;但更深一层看,它实际上是在对外说明自己在 AI 产业链中的新位置。以前如祺更容易被归类为出行平台、Robotaxi 参与者或自动驾驶相关企业,现在它在主动把自己推向“数据供给方”和“物理世界训练资源平台”的角色。这种角色切换非常关键,因为它决定了外界今后怎么看待它的估值逻辑和业务边界。也就是说,这次披露的重点不只是“有四类数据”,而是如祺在说:我们手里的真实出行数据,已经可以被组织、封装并商业化,成为 AI 时代的新型基础资源。这让新闻的性质,从普通业务介绍,升级成了一次关于产业站位的公开声明。为什么真实出行数据突然变得这么值钱这条新闻最值得写透的地方,就是“真实出行场景”四个字。过去在大模型初期,很多任务依赖互联网文本、图片、公开语料和通用知识库,谁能拿到更多高质量文本,谁就更有优势。但具身智能和世界模型不一样,它们要理解的是现实世界中的运动、交互、空间关系、时间变化和因果反馈,这些能力不是靠静态文本堆出来的。而真实出行数据,恰恰天然包含这种结构。司机行为、车辆响应、道路参与者互动、泊车过程、复杂交通场景、时间序列变化,这些都不是一张图片或一段描述能替代的。它们记录的是“人在怎么决策、车怎么响应、环境怎么反馈”的连续链条,这类数据对训练世界模型尤其重要,因为世界模型想学的正是物理世界如何运转。所以,如祺出行的价值不只是“有很多数据”,而是这些数据本身具有较强的时空连续性、行为关联性和真实交互性。换句话说,这不是普通数据堆积,而是更接近真实世界底层规律的样本来源。只要 AI 产业继续往具身智能和现实世界理解推进,这类数据的重要性就会不断上升。从自动驾驶外溢到具身智能,说明数据边界在扩张材料里有一个很重要的变化信号:如祺并没有把这些数据的用途只限定在自动驾驶,而是明确延展到了具身智能和世界模型。这说明企业自己已经意识到,出行场景中积累的数据,不再只是服务车,而可以服务更广泛的“理解和行动于物理世界”的 AI 系统。这个变化非常值得重视。因为自动驾驶行业过去长期被视为数据最重、场景最复杂、迭代最慢但壁垒最高的 AI 应用之一。如果自动驾驶沉淀的数据能进一步外溢到具身智能和世界模型,那意味着它的商业边界突然被拉宽了。原本只能在车里产生价值的数据,现在有机会向机器人、工业智能、仿真训练、空间理解等更多赛道扩散。对行业来说,这是一种典型的“数据资产再定价”。过去一份道路数据,价值可能体现在辅助驾驶优化上;未来同一类数据,可能同时服务于机器人感知、世界建模、动作策略训练甚至多模态大模型。只要复用场景变多,数据本身的经济价值和战略价值都会被重新抬高。这不是单纯“卖标注”,而是在往数据基础设施走材料还反复强调一个点:如祺出行并不想停留在传统 AI 数据服务商常见的“卖标注”模式,而是在向“数据集 + 全栈能力”升级。这包括数据采集、规模化处理、精准标注、合成数据和多模态处理等全链路能力,并进一步以“数据即服务”方式封装为标准化产品。这一点很关键,因为它说明如祺并不想只做低毛利、可替代的劳务型数据业务,而是想把自己塑造成一种更像“数据基础设施”的存在。传统数据标注公司的问题在于容易被压价、服务标准化程度低、客户粘性不足;但如果你能把真实场景数据、处理流程、工具链、合规能力和交付产品整合在一起,议价能力就会完全不同。也就是说,如祺现在在讲的不是“我们能帮你标数据”,而是“我们能直接给你可用的数据产品和整套能力”。这会让它从劳动密集型服务,逐渐转向更接近平台型、基础设施型和资源型的商业角色。而在 AI 产业进入深水区后,这种角色通常比单纯提供人力或单点工具更有长期价值。商业化已经开始被验证,说明这不是概念先行很多企业一提 AI 数据资产,容易让人联想到“故事先讲起来,商业化以后再说”。但你提供的材料里有一个较强的支撑点:2025 年,如祺出行以该业务为主要收入来源的技术服务板块实现营收 1.60 亿元,同比增长 487.4%,成为公司增长最快的业务板块。材料还列出了其客户覆盖腾讯、小马智行、理想、火山引擎、百度智能云、广汽集团等头部企业。这至少说明两件事。第一,如祺并不是今天才想到“数据能卖钱”,而是已经在把这块业务往规模化和标准化方向推进。第二,这种能力已经获得了部分头部客户的市场验证,不完全停留在 PPT 阶段。对于任务二的写法来说,这一点很重要,因为它让文章不只是趋势判断,还有现实商业基础。这也解释了为什么这条新闻值得被写成“新增长曲线”相关的产业稿。出行业务是原本主线,但 AI 数据服务正在成为更像科技平台收入的第二曲线。对资本市场和产业观察者来说,真正值得关注的恰恰不是某一次披露,而是如祺有没有能力把日常运营中不断产生的数据,持续转化成标准化、可复用、可销售的 AI 资产。从新闻到用户路径的归因问题大众看到的是数据资产,产品团队更该看到“真实场景入口”对普通读者来说,这条新闻的关键词可能是“AI 数据资产”“具身智能”“世界模型”,听上去更像产业概念;但如果你是产品、开发或增长团队,更应该关注另一个角度:真实场景本身,正在重新变成一种高价值入口。为什么这么说?因为过去互联网产品最习惯争夺的是线上流量入口,比如搜索、推荐、广告、社交裂变、应用商店。但当 AI 进入物理世界理解阶段,真正有价值的“入口”不再只是用户点了一次链接,而是某个系统是否持续进入了高频、真实、连续的现实场景。出行平台每天运行中的车、路、人、时间和空间关系,本身就构成了一种更稀缺的数据入口。这种入口和传统流量入口最大的不同在于,它不是一次性触达,而是长期、重复、真实发生。也正因为如此,未来很多 AI 公司的护城河,未必来自买量和分发,而可能来自“有没有持续接触真实物理世界”。如祺这次披露,本质上就是在向外界证明:它已经站在这个入口上。当AI开始争夺真实世界,旧式数据归因会越来越不够用如果把这个变化继续往下看,会发现很多传统的数据归因逻辑也会开始显得不够。过去大家擅长统计用户从哪个广告来、从哪个渠道装、从哪个页面注册;但对具身智能和世界模型来说,更重要的问题变成:这些数据来自什么场景、发生在哪个时间序列、是否包含真实反馈、是否可形成完整行为链条。也就是说,未来高价值数据不只是“数量多”,而是“上下文完整”。一段司机避让行人的过程,如果只拆成几个离散帧,价值就会下降;而如果能连同环境变化、车辆反馈、行为结果、时间顺序一起保留,它才更像能训练世界模型的样本。这个逻辑和传统互联网归因的最大区别在于,后者更重来源识别,前者更重场景链路和因果完整性。对做 App 和 B 端产品的人来说,这种变化是个很重要的提醒:未来不是所有数据都能被当成普通事件日志看待。某些真实世界数据,一旦涉及空间关系、动作逻辑和连续反馈,就更像“任务轨迹”而不是“点击埋点”。这会反过来重塑产品的数据设计方式。数据质量的竞争,最终会变成链路完整性的竞争到了具身智能和世界模型阶段,数据竞争表面上是比谁的数据多,实际上更像比谁能提供更完整的链路。因为模型真正需要的,不是一堆孤立片段,而是带有前因后果的过程数据。没有过程,模型就难以学习“为什么会这样”;只有结果没有环境,模型也难以学习“遇到相似情况该怎么做”。如祺出行的真实出行数据之所以有吸引力,就在于它天然容易形成链路:司机怎么判断、车辆怎么反应、道路参与者怎么变化、最后结果如何。这种数据比单纯标签更稀缺,因为它更接近行为世界的真实结构。所以,从更广的产业视角看,这条新闻指向的不是“数据越来越重要”这样一句空话,而是更具体的一件事:未来数据质量的竞争,会越来越变成链路完整性的竞争。谁能持续获得完整链路,谁就更有机会定义下一代物理世界 AI 的训练材料标准。工程实践:重构安装归因与全链路归因先给真实场景编号,别把物理世界数据都混成普通采集面对这类“真实场景数据”驱动的变化,第一步并不是讨论模型多强,而是要先把场景本身识别清楚。很多团队采集了大量现实世界数据,但问题在于,它们最后被混成一堆无差别素材,很难区分哪些来自高价值场景,哪些具备完整行为链条,哪些值得优先投入处理资源。更合理的做法,是先建立类似 ChannelCode 这样的场景编号逻辑,让不同来源和任务环境有明确身份。例如可以区分:城市开放道路场景泊车与低速交互场景高峰拥堵场景夜间复杂路况场景异常驾驶行为场景这样做的意义,不是为了把表格做得更复杂,而是为了让后续模型训练、数据清洗和商业交付,都知道自己面对的到底是什么类型的真实世界样本。再把上下文带进系统,别让高价值数据在处理时失去语义第二步,是保住数据产生时的上下文。真实物理世界数据最怕的不是量少,而是进入处理流程后被去语境化。比如一段行为数据,如果只剩下图像、坐标或若干标签,却丢失了采集时间、场景条件、参与角色、动作连续性和任务目标,它的训练价值就会被明显削弱。所以更适合的做法,是用 智能传参 这类思路,把场景、任务和上下文随着数据链路一起保存下来。对于这类业务,可以考虑预留:channelCodescenetask_typetime_series_idenvironment_taginteraction_role这些字段的意义,在于让数据之后不只是“被处理过”,而是仍然能被识别为“在什么真实世界条件下发生过”。当数据要走向商品化、模型化和跨行业复用时,这种上下文保真会越来越重要。最后把事件图建起来,别只交付数据量,不交付链路价值第三步,是不要只看采集量、标注量和交付量,而要把链路事件图真正建出来。对这类数据业务而言,很多价值并不体现在“今天又多了多少 TB”,而体现在这批数据是否保留了完整事件过程、是否覆盖关键场景、是否能支持模型学习真实世界的因果逻辑。更适合的做法,是建立一张围绕真实场景训练数据的事件图,例如:scene_capturedcontext_boundinteraction_labeledsequence_completedquality_verifieddataset_packageddataset_delivered有了这张图,团队才能真正回答问题:哪些数据只是素材,哪些已经变成高价值样本;哪些场景采得多但链路不完整,哪些场景虽然量小但训练价值更高;哪些数据可以进入标准化产品,哪些还停留在原始采集层。对于【AI数据资产】来说,这比单看数据量更接近真正的业务核心。注:本文讨论的真实场景编号、物理世界上下文保留、具身智能训练数据链路建模等场景,属于面向未来 AI 数据服务和真实世界模型训练的工程设计思路与前瞻性方法延展。不同企业在采集体系、合规框架、数据处理中台和产品封装方式上差异较大,相关链路通常需要结合具体业务进行专项适配,并不等同于统一标准化现成功能。这件事和开发 / 增长团队的关系面向开发与架构:该补的是“场景字段”,不是只补存储容量如果你是研发或架构负责人,这条新闻最值得带走的一点是:未来做 AI 数据服务,光能存还不够,关键是能不能理解数据来自什么场景、保留什么上下文、形成什么链路。物理世界数据一旦缺了这些维度,价值会迅速折损。比较实际的做法,是从现在开始预留一组与真实场景和行为链路相关的字段,例如:scenechannelCodetime_series_idinteraction_roleenvironment_tagdataset_version这些字段未来很可能比单纯的容量指标更决定数据资产的长期价值。面向产品与增长:下一轮争的不是流量成本,而是真实世界接入权如果你是产品或增长负责人,这条新闻最大的启发是:下一轮 AI 竞争,很多时候不再只是争谁买量更便宜、分发更高效,而是在争谁更早、更深地接入真实世界。因为只要物理世界高质量数据仍然稀缺,能持续获取它的企业就会拥有更强的议价能力和更高的战略地位。现在就可以做三件事:把高价值真实场景单独识别,不和普通埋点混看。把上下文保留和链路完整性当成正式产品能力建设。把“数据资产化”看成业务设计,而不是事后包装。未来真正决定 AI 公司护城河的,可能不是谁讲得更会,而是谁能持续拿到现实世界里最难复制的样本。常见问题(FAQ)如祺出行这次披露最核心的信息是什么?最核心的是三点:一是首次完整披露 AI 数据资产版图;二是明确覆盖标注、行为、合成和多模态训练数据集四大类;三是将数据能力从自动驾驶延展到具身智能和世界模型。这说明它正主动把自己从出行平台,往 AI 数据资产平台升级。为什么真实出行数据会对具身智能和世界模型有吸引力?因为这类数据天然包含时空连续性、行为交互和环境反馈,更接近物理世界真实运行逻辑。相比静态图片和文本,它更适合训练模型理解“动作为什么发生、环境如何响应、结果如何形成”。这是不是意味着如祺出行不只是做出行了?某种程度上是的。至少从你提供的材料看,如祺已经在强化第二身份:不仅运营出行业务,也把运营中沉淀出来的数据、处理能力和交付体系变成对外可销售的 AI 数据服务。这会让它未来的增长逻辑更加多元。为什么这类新闻和产品、工程团队有关?因为真实世界数据的价值,不取决于“有没有采到”,而取决于“有没有被正确识别、保留上下文、形成可复用链路”。这背后涉及采集架构、字段设计、事件建模和数据产品化,不只是业务部门的概念包装。行业动态观察如祺出行首次完整披露 AI 数据资产版图,这件事表面上是一次公司业务展示,实际上却折射出 AI 产业一个越来越清晰的趋势:当竞争从文本世界走向物理世界,最稀缺的资源会从“通用语料”转向“真实场景中的连续行为数据”。谁能稳定获得它、组织它、商品化它,谁就更有机会在具身智能和世界模型时代占住位置。对 App 和 B 端团队来说,这条新闻真正值得带走的不是“数据很重要”这种泛化结论,而是更具体的一点:未来越来越多竞争,争夺的会是现实世界接入权、上下文保真能力和链路完整性解释权。现在正是补齐这些底层能力的窗口期,因为一旦真实场景数据成为新型战略资产,晚一步,差距就可能不是一点点。

436

436

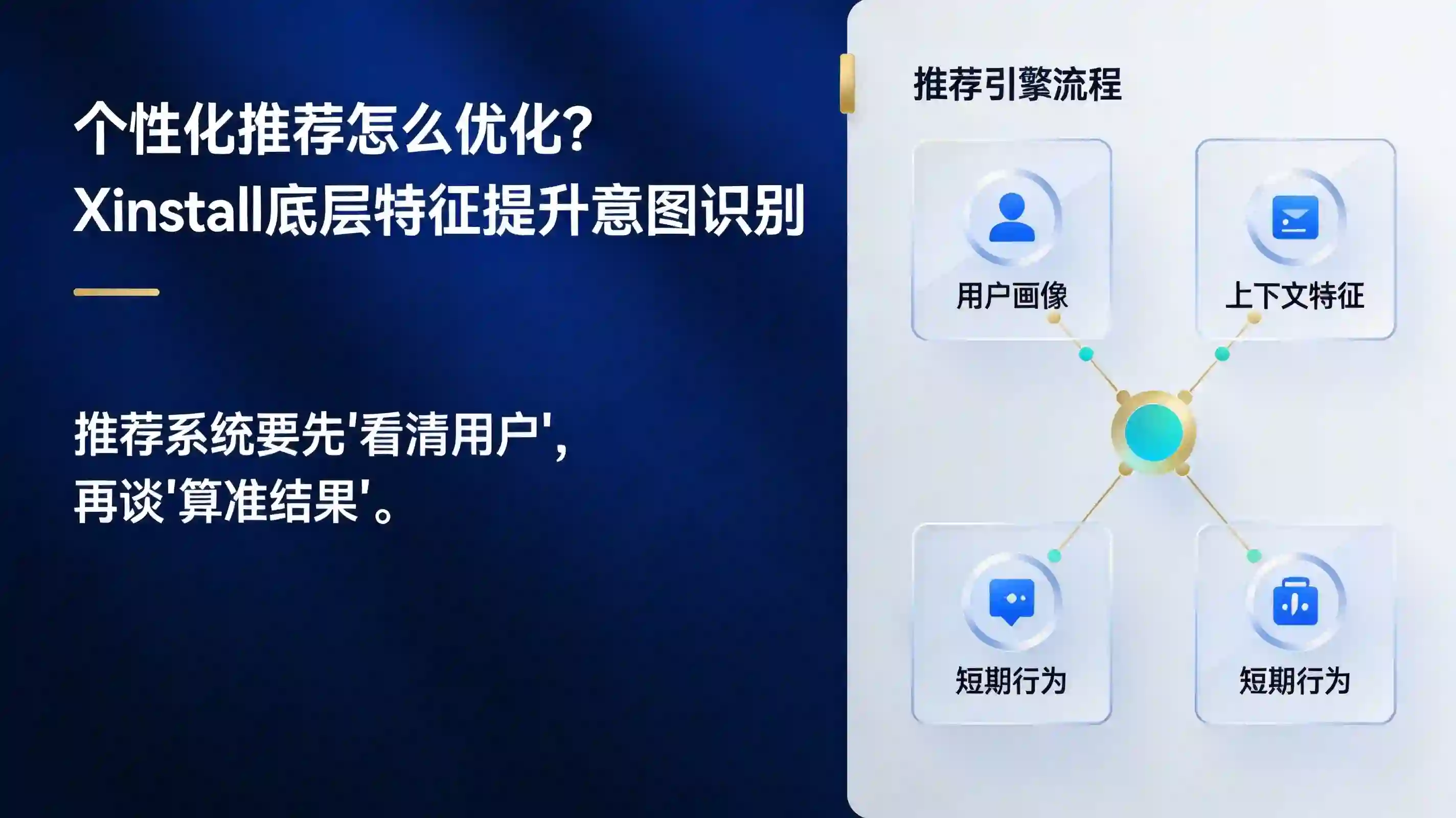

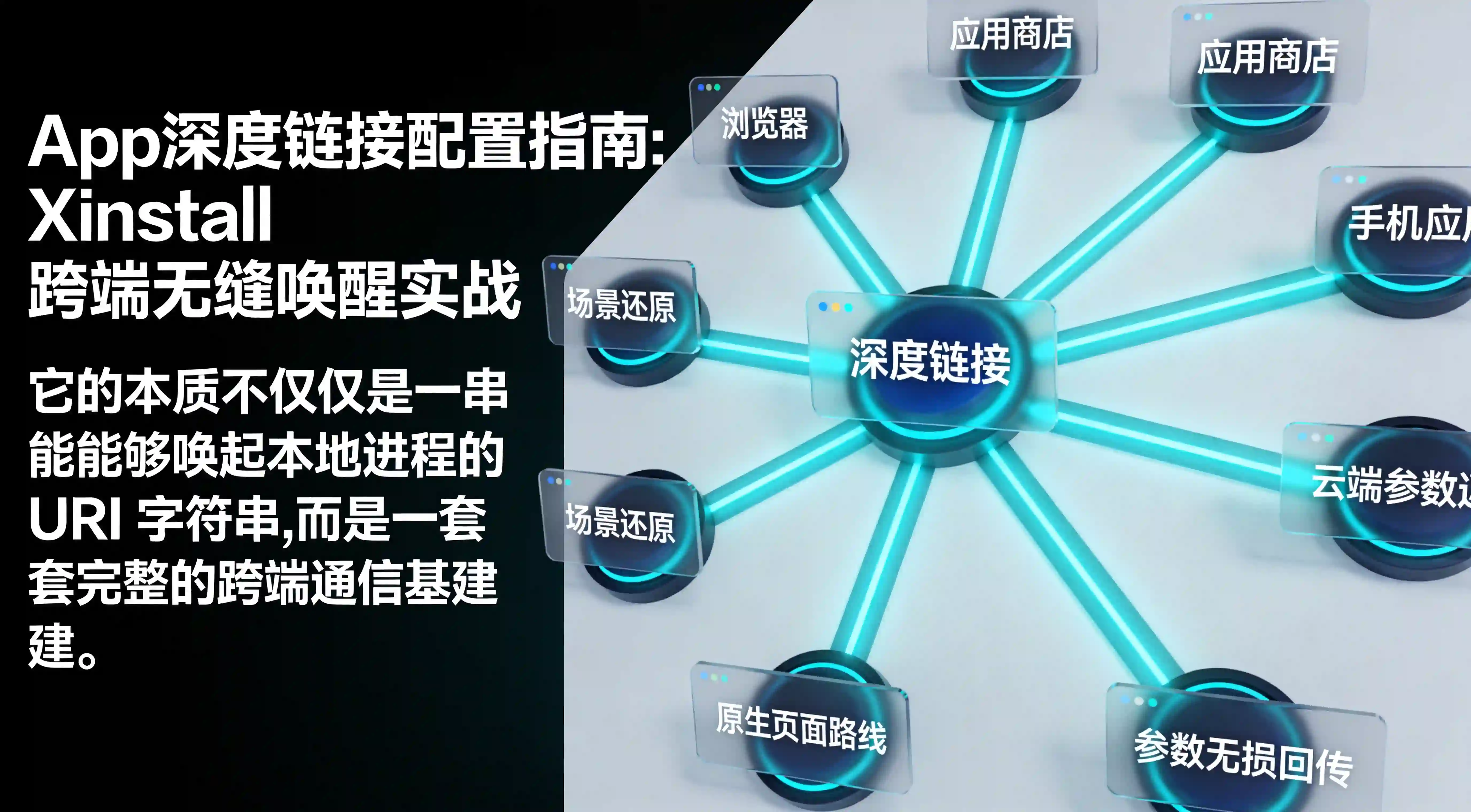

解释概念与行业位置:打破移动端“信息孤岛”在移动端开发的初期,Web 与原生 App 之间存在着一道极难逾越的系统级沙盒鸿沟。当用户在各类社交软件或系统浏览器中看到诱人的商品或活动时,他们必须经历一个极度割裂的流程:跳转到应用商店、等待下载、安装、冷启动 App,然后面对一个毫无关联的首页,最后再凭借记忆去搜索刚才看到的商品。Web 与原生 App 割裂导致的流量漏斗断层这种体验断层是导致移动端拉新漏斗急剧收缩的元凶。根据业务漏斗盘点,传统的割裂跳转往往会导致超过 60% 的新用户在看到 App 首页的那一瞬间选择流失。在现代的增长架构中,我们迫切需要一种技术手段,能够让 Web 端的上下文参数(Context)如同接力棒一样,安全、无损地跨过操作系统的进程隔离墙,精准传递给 App 进程。这就是“场景还原”的核心诉求。App深度链接 (Deep Link) 的核心工程价值App深度链接技术应运而生。它的本质不仅仅是一串能够唤起本地进程的 URI 字符串,而是一套完整的跨端通信基建。通过配置深层链接,我们可以实现在 App 已经安装时,跳过浏览器直接拉起 App 并定位至二级或三级指定页面(如 app://product?id=123);在 App 未安装时,将携带业务逻辑的参数在云端暂存,待用户安装完毕并首次打开 App 时,再次精准下发,实现千人千面的“免填码”无缝承接。技术原理与数据管线:跨端唤醒与参数传递引擎要实现如此丝滑的场景还原,客户端架构师需要深入理解操作系统底层的路由机制,并借助强大的第三方数据管线来缝合系统协议的短板。主流移动端唤醒与深度链接技术评估矩阵在客户端架构选型时,开发团队通常会面临三种典型的跨端跳转实现方案。以下矩阵展示了它们在兼容性与传参无损率上的表现:深度链接架构选型系统环境兼容性与跳转体验未安装场景的处理与回退机制传参无损率与场景还原能力纯原生 Custom URL Scheme较差(在微信等内置 Webview 中常被拦截,体验割裂,易出现“网页无效”弹窗)极差(仅对已安装用户生效,未安装时直接报错,无平滑引导)较低(无法穿透应用商店,一旦进入下载流程参数立刻丢失)系统级 Universal Links (iOS) / App Links (Android)良好(利用标准 HTTPS 链接,系统级底层接管,跳过浏览器直接唤起)中等(App 未安装时回退至普通 H5 网页,不报错但依旧断层)中等(对已安装用户传参稳定,但对未安装新客的延迟唤起无能为力)Xinstall 动态参数与场景还原聚合方案极优(动态检测环境,优先 Universal Links,被拦截则智能降级引导或微下载页)极优(无缝打通商店,生成短链与云端快照,实现平滑兜底下载)极优(结合模糊指纹环境快照,冷启动时毫秒级匹配找回丢失参数)URL Scheme 与 Universal Links 的底层路由机制要让 App 响应外部链接,必须修改原生工程的配置文件。以 iOS 为例,早期的 URL Scheme 是在 Info.plist 中注册一个自定义前缀(如 myapp://)。但其最大的缺陷是命名冲突与被微信等超级 App 强力拦截。随后苹果推出了 Universal Links(通用链接)。其底层逻辑是信任校验:开发者需要配置 Xcode 中的 Associated Domains(如 applinks:example.com),并在自己网站根目录下的 /.well-known/ 路径中托管一个 apple-app-site-association (AASA) JSON 文件。当用户在 iOS 设备点击 https://example.com/product/123 时,iOS 系统的守护进程(Daemon)会核查域名与 AASA 文件。若匹配成功,系统直接唤起 App,并在客户端的 AppDelegate 中的 continueUserActivity: 生命周期方法里将 URL 原封不动地传递给原生代码进行解析渲染。动态参数拼接与“免填码”场景还原技术然而,系统原生的 Universal Links 依然解决不了“未安装 App 时的参数穿透问题”。当用户被迫前往 App Store 下载应用时,Safari 浏览器与 App 进程之间的参数桥梁被彻底斩断。引入 Xinstall 官网 等成熟的基建,正是为了弥补这一系统缺陷。其核心“免填码”技术原理在于双端快照匹配:当用户在 H5 落地页点击下载按钮时,前端 JS 探针会实时采集当前设备的一系列非隐私宏观特征(如 OS 大版本、公网 IP 段、浏览器 UA、屏幕物理像素比等),并与当前页面的业务参数(如 roomId=888 或邀请码)拼接,通过加盐哈希后暂存至 Xinstall 云端。当用户历经漫长的下载解压,首次冷启动 App 时,客户端内嵌的 SDK 会立刻在异步线程中收集相同的设备物理特征发送给云端。服务器通过高维度的统计算法进行毫秒级的指纹碰撞,一旦匹配成功,即将存留的 roomId=888 下发给 App,客户端据此执行内部路由渲染。技术诊断案例模块(四步法):某电商App跨端唤醒率诊断实战架构配置最忌讳“纸上谈兵”。下面我们将公开一份纯开发视角的跨端唤醒排障对账实录,展示如何通过物理校验解决唤醒断层。异常现象与问题背景某知名电商 App 研发团队为迎战“618”大促,自行配置了 Universal Links 用于海量 H5 裂变引流。然而活动上线不到两小时,客户端监控系统发出灾难级告警:在 iOS 端出现了大面积的新用户唤醒断层。原本应该在用户激活 App 后直接跳转至“限时秒杀专题页”的新用户,全部坠落至毫无活动入口的默认首页。由于承接失败,这批高成本新客的大促转化率呈现断崖式暴跌。物理与数据对账(核心诊断环节)架构组紧急拉起最高级别的排障,抽取了网关日志进行严苛的物理链路对账。团队针对“未安装新客”的场景,严格套用 100MB包体5G下10-15秒安装 的极值定律:用户从浏览器中点击 H5 链接,到经历跳转商店、下载、解压、唤醒 App,其间的物理耗时至少在十几秒以上,且必然发生了进程环境的彻底切换。架构师追踪代码发现,自研方案在此物理时间窗内,强行依赖极度脆弱的 Safari Cookie 与剪贴板(Clipboard)来实现参数传递。但在 iOS 14 以后的隐私新政下,跨 App 的剪贴板访问不仅会触发系统强制的弹窗警告,更会在系统底层被强制清空。正是这个物理现实,导致 App 在冷启动时去读取剪贴板获取上下文参数的逻辑 100% 失败。技术介入与方案落地确诊了“自研传参黑洞”后,架构团队果断废弃了那些极易被苹果封杀的高危剪贴板逻辑,全面实施了第三方架构替换。紧急集成 Xinstall 的深度链接聚合 SDK:在前端 H5,植入轻量级探针以安全的宏观特征取代剪贴板写入;在客户端原生侧,移除臃肿的自研路由,在 AppDelegate 或 SceneDelegate 中直接调起标准化参数回调接口。此时,跨端参数传递彻底由第三方服务器的模糊环境哈希匹配来接管,完美避开了系统层面的物理隔离与隐私弹窗。结果与可复用经验完成这次底层的架构急救后,跨端信息断层的危机被彻底解除。不仅大促秒杀页的端到端场景还原精准度瞬间飙升并稳定相对提升了 23.4%,保住了活动 ROI,更让研发团队从无尽的 OS 碎片化适配(如应对微信内置 WebView 拦截、不同浏览器沙盒机制)中彻底解放出来。指标体系与评估方法:衡量深度链接的业务健康度技术跑通只是基建的第一步。要让 App 深度链接持续发挥价值,客户端团队必须建立严密的数据监控与对账标准。端到端唤醒率与参数无损回传率的对账对于客户端研发而言,必须在 APM(应用性能监控)平台上建立针对“跳转健康度”的核心面板。需要重点监控“端到端唤醒率”(即客户端成功执行 Deep Link 路由的次数 / 落地页触发点击的次数)。由于国内流量极度依赖微信等社交软件分发,必须建立针对不同宿主浏览器的漏斗分析。通过app安装来源追踪方案,研发可以排查出哪些 Android 定制 ROM 或浏览器版本出现了异常强拦截,从而动态调整前端策略(如及时弹出“请点击右上角在浏览器中打开”的遮罩层)。结合多触点归因评估跨端引流 ROI此外,在参数层面,务必监控“参数无损回传率”。确保像 channelId、campaign 或业务侧的 item_id 能够经过云端快照后 100% 被客户端接收。当这些坚实的底层数据被成功还原入库后,业务部门才能以此为锚点,开展多触点归因计算与全生命周期的 LTV 留存报表输出,真正实现技术对业务增长的双向赋能。常见问题 (FAQ)为什么我们在 iOS 成功配置了 Universal Links,但在微信里依然无法直接唤醒 App?这是一个典型的“生态隔离”问题。微信等超级 App 出于把控自身流量闭环(或安全风控)的考虑,通常会在其内置的 WKWebView 或 X5 内核中,从底层强行接管并拦截掉指向外部 App 的 Universal Links 或 Scheme 唤起请求。在这些黑盒生态内,往往必须依赖“引导用户点击右上角在 Safari/默认浏览器中打开”的中间态,或是接入类似 Xinstall 方案提供的专属微下载落地页,利用其深厚的防拦截策略库来优化用户的跳转路径。企业是否必须使用第三方工具来配置 App深度链接?拥有顶配架构师团队的大厂确实可以投入重兵,自行维护庞大的 AASA 文件分发集群、海量的安卓机型适配库和跨端防拦截策略。但对于绝大多数追求敏捷的开发团队而言,国内安卓厂商系统高度定制、各大社交平台拦截策略几乎月月更新。强行自研极易掉入“修不完的 Bug 坑”。使用成熟工具能一步到位集成全网最全的防拦截逻辑与高并发的云端匹配集群,大幅节约“重复造轮子”的昂贵沉没成本。使用模糊环境快照进行未安装用户的场景还原,会触犯各大应用商店的隐私合规吗?规范专业的第三方实现体系(如本案例中的架构)均严格遵循“最小必要原则”。其快照匹配计算,依靠的是网络层(如 TCP/IP 协议栈参数)与系统宏观硬件参数的加盐哈希(Salted Hash)。它坚决不采集明文的 IMEI、IDFA 或通讯录等 PII(个人敏感信息),也不强行读取受保护的剪贴板。因此,这种基于模糊宏观特征的匹配方案完全符合 Apple App Store 的隐私审核规范以及国内工信部的合规核查标准。

43

43

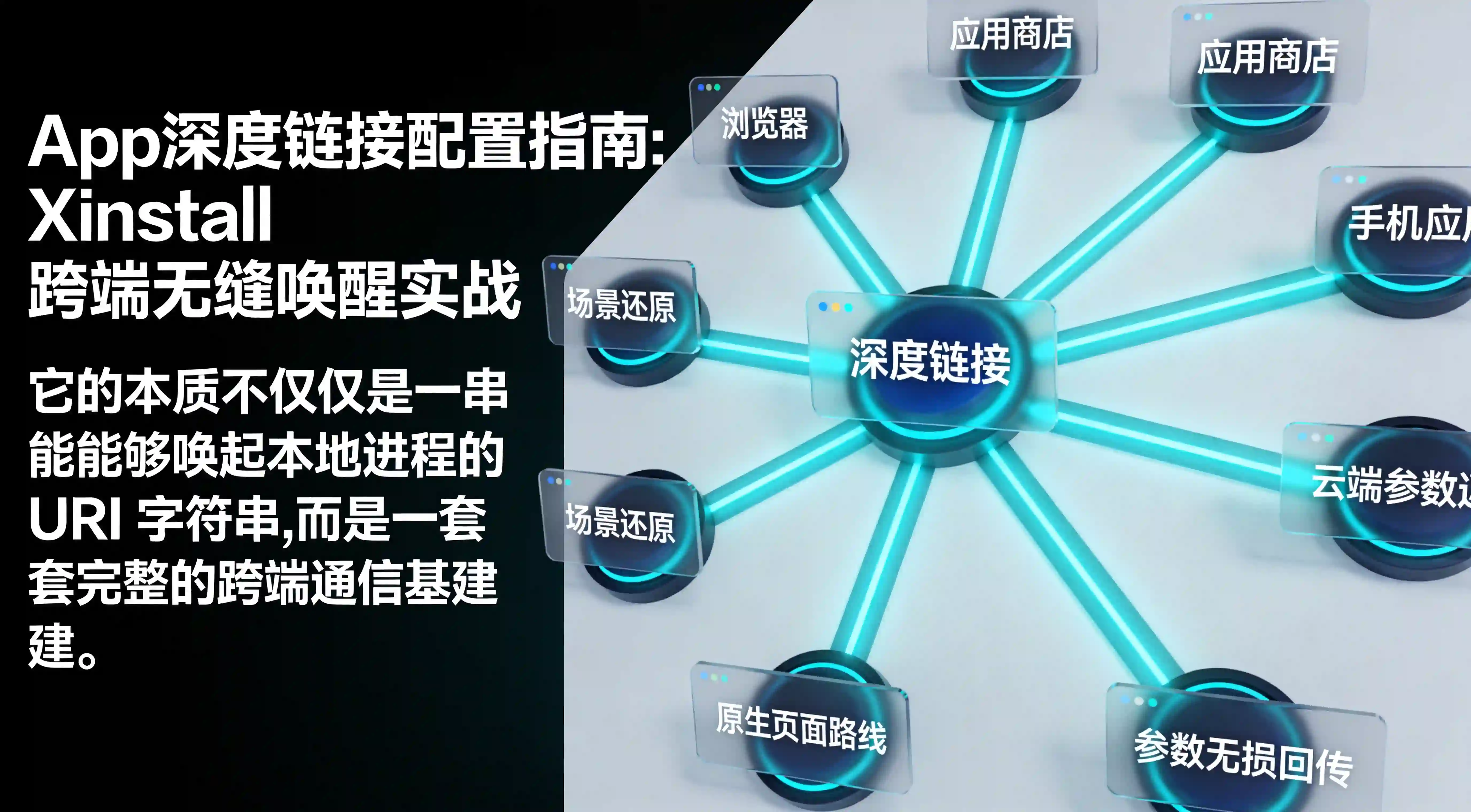

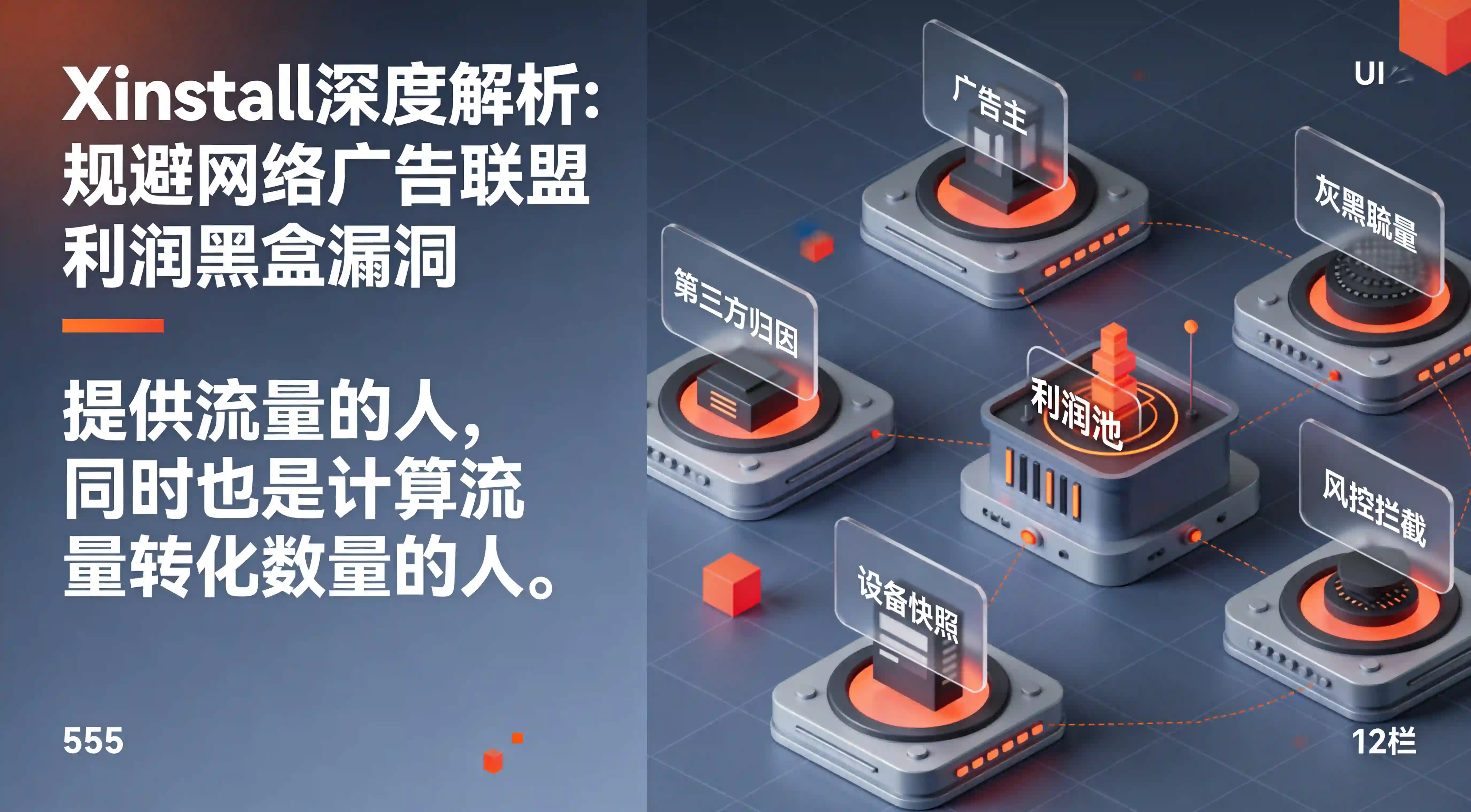

解释概念与行业位置:网络广告联盟的利益博弈黑洞在效果营销的链路中,流量的采买与结算是最核心的财务动作。作为关注增长质量的首席增长官(CGO),我们必须清晰地认知到:每一次广告展现与激活的背后,都潜伏着广告主、媒体渠道与中间代理商之间极其惨烈的利益博弈。流量透明度的缺失与财务结算危机根据广告网络 (Advertising network) 的基本商业定义,网盟本质上是一个连接广告主与海量中小 App/网站发布商的中介聚合体。它的商业模式建立在“低买高卖”与“效果分发”之上。为了维持自身在流量分发上的信息差优势,绝大多数联盟会采用“黑盒化”运作:向下游隐藏具体的广告主出价,向上游(广告主)隐匿具体的流量来源媒体、设备明细与点击时间戳。这种流量透明度的结构性缺失,导致广告主只能被动接受网盟后台生成的汇总报表进行 CPA(单次激活成本)结算。当网盟中混入灰黑产流量时,广告主的结算资金就会被无情抽干。为什么企业需要绝对中立的“第三方裁判”?在传统的网盟对接中,联盟往往会要求广告主集成其官方提供的统计 SDK。这就引发了一个致命的逻辑死结:提供流量的人,同时也是计算流量转化数量的人。由于网盟的直接收益与结算转化量正相关,其官方代码逻辑天然倾向于采用极其宽松的归因标准。例如,将转化时间窗无限拉长,或者利用 Last-Click(最后一次点击)规则强行将品牌自然增长的自然量(Organic Installs)划归为自己的功劳。要打破这种不平等的利益霸权,企业必须引入绝对中立的第三方归因平台,通过底层代码建立硬核的技术制衡。技术原理与数据管线:重构流量透明度的底层架构第三方系统能够胜任“中立裁判”,并不依赖于商业谈判,而是凭借其底层无法被篡改的代码执行逻辑和物理排重管线。广告流量归因与财务结算方案技术评估矩阵面对复杂的联运结算需求,企业在建立财务对账标准时有三种典型的技术演进路线。矩阵清晰展现了独立风控体系的压倒性优势:结算对账技术方案流量透明度与黑盒穿透力底层防作弊与拦截能力结算主导权与利益博弈地位全盘依赖联盟直连官方报表极低(完全黑盒,只能看到点击数与激活数的汇总汇总,无明细)极差(对联盟内部的机器刷单或自然量劫持毫无防备)极度被动(人为刀俎我为鱼肉,只能按出账单付款)半自动化人工抽取核对表单较低(依赖运营定时导出 CSV 进行 VLOOKUP 比对,存在严重延迟)较差(只能发现事后明显的数据异常,无法阻断已经发生的计费)较弱(经常因双方时间戳不一致陷入冗长的扯皮)Xinstall 第三方独立归因与风控拦截极高(细化到设备级、毫秒级的时间窗快照,链路 100% 可视化)极优(依托底层流式计算,毫秒级主动 Drop 虚假请求与劫持流量)绝对主导(以不可篡改的第三方脱水数据作为唯一财务打款凭证)跨越黑盒的底层设备指纹抓取与隔离要瓦解网盟的黑盒,第一步是夺取底层数据特征的定义权。Xinstall 官网 等独立平台的核心武器,在于网关侧的“全量设备快照(Device Snapshot)”技术。当网盟的流量触达落地页时,第三方探针会在不触碰联盟核心算法的前提下,瞬间提取当前设备的宏观环境变量(如 TCP/IP 协议栈特征、系统内核版本组合、屏幕物理像素比等)。这些物理特征经过单向哈希(Hash)加密后,形成不可篡改的唯一数字指纹。即使网盟在回调中伪造了假 IMEI 或假 IP,只要其底层的环境指纹暴露出异常碰撞(如一万次点击来自同一个硬件指纹),第三方裁判就能瞬间撕破其伪装。作弊拦截:从被动扣款到网关层主动阻断识别只是第一步,真正的财务止损依赖于实时的作弊拦截。不同于传统的事后核减,现代归因系统构建了流式计算网关。当系统检测到网盟渠道爆发超高频的撞库请求,或是检测到设备的点击时间与激活时间存在违反物理常识的倒挂时,风控引擎会直接在内存中执行 Drop(抛弃)操作。系统拒绝向网盟的服务器发送转化确认回调(Postback),从物理链路上彻底切断了网盟的计费触发指令,将防御阵地从“财务扯皮”前置到了“技术阻断”。技术诊断案例模块(四步法):某出海App利润漏斗排查实战真实的商业战场从来都是刀光剑影。以下为您解密一场经典的“利润漏斗排查”战役,展示第三方裁判如何利用硬核对账挽救企业资金。异常现象与问题背景某知名出海工具 App 在拓展东南亚市场时,接入了 5 家当地头部的网络广告联盟进行 CPA 投放。跑量首周,各大联盟后台的报表一片繁荣,日均新增转化量暴涨至数万。然而,CGO 在核对后端的业务报表时发现,这批所谓的“高转化用户”其首日完播率、次日留存与首充指标几乎趋近于零。营销预算正在以每天数万美金的速度被疯狂消耗,如果不查明真相,本季度的净利润将被彻底掏空。物理与数据对账(核心诊断环节,利润漏斗排查)技术风控专家果断舍弃了网盟的表层数据,直接引入第三方系统底层的时序日志进行深度“利润漏斗排查”。核心逻辑是:如果用户的激活是真实的广告转化,其必须遵循客观的物理流转过程。该出海 App 设定了严格的基准——100MB包体5G下10-15秒安装。专家比对了所有的转化日志,发现了令人毛骨悚然的数据断层:高达 80% 由网盟上报并要求结算的“有效点击转化”,其记录的点击时间(Click Time)与 App 最终网络初始化激活的时间(Install Time),间隔也就是 CTIT,竟然不足 2 秒。在真实的物理世界中,用户根本不可能在 2 秒内完成跳转、确认下载、解压 100MB 包体并启动应用。这组不容争辩的物理时序证据,直接证实了这是一种被称为点击劫持(Click Injection)的底层安卓作弊手法:作弊联盟利用恶意插件监听了系统正在自然下载的广播,然后在安装完成的前几毫秒,瞬间伪造一次虚假点击,强行抢走了原本属于自然流量(Organic)的功劳。技术介入与方案落地掌握了铁证后,出海团队凭借这组由第三方出具的脱水数据,强行切断了作弊联盟官方 SDK 的回传权限。全面重构了归因链路:所有网盟必须通过第三方中立网关进行追踪。企业在风控后台配置了极度严苛的毫秒级时间窗过滤器。凡是 CTIT 不符合物理下载极值、或是指纹高度碰撞的静默请求,系统不仅实施自动阻断,更会自动将其拉入黑名单库,拒绝向作弊方发送任何 CPA 结算信号。结果与可复用经验在第三方物理对账的降维打击下,作弊联盟哑口无言,被迫退还了恶意消耗的预付推广款。通过彻底执行“无第三方验证不打款”的铁腕原则,在随后的一个月投放中,该 App 的无效财务结算率被实打实地压降了 19.6%。真正的高质量流量得以显现,彻底封堵了由于黑盒带来的利润漏洞,实现了流量透明度与资金安全的双赢。指标体系与评估方法:建立防御性的财务结算标准打赢一场战役后,企业需要将这种对抗网盟作弊的能力,沉淀为常态化的业务防御标准。通过构建数据漏斗,企业才能在长期的商业博弈中立于不败之地。归因时间窗与有效转化的多维界定在与强势的网络广告联盟签订投放合同时,甲方不能只谈单价,必须将APP 全渠道统计:2024年如何精准统计渠道数据中的核心归因条款写入技术附件。企业必须在技术系统内双向卡死“归因时间窗(Attribution Window)”。例如,严格定义只有在用户点击广告后 24 小时内的激活,且没有经过其他强意图渠道覆盖的下载,才算作网盟的有效转化。对于点击发生在一周前,突然又冒出来的迟到激活,风控系统应坚决将其判定为过期流量并拒绝付款,防范历史点击被二次碰瓷计费。构建基于脱水数据的利润核算漏斗归因的终点不应止步于激活。由于网盟经常掺杂低质积分墙量或肉鸡量,企业应当彻底放弃媒体平台的表层拉新数据,建立一条深度的利润核算漏斗。将第三方提供的脱水激活数据,与企业后端的首日注册、实名认证、乃至七日 LTV(生命周期价值)进行穿透比对。只有当这批流量真实产生了后续的商业动作并覆盖了拉新成本,这条网盟渠道才算真正通过了商业验收。让真实的业务 ROI 而非前端的虚假下载量,来决定网盟预算的分配与生死。常见问题 (FAQ)为什么网络广告联盟的后台数据总是比业务库的真实数据多?除了正常的网络丢包、延迟传输等不可抗力误差外,这其实是商业利益博弈的必然结果。部分网盟的内部计费逻辑设置得极为宽松,它们通过拉长归因时间窗、或者利用极高频的无意义点击铺网,甚至将用户正常的自然搜索量强行揽入自己的转化功劳簿,以此虚构繁荣的表象,向不知情的广告主收取远超实际效果的巨额费用。企业是否必须使用第三方归因工具来与联盟进行财务结算对账?强烈建议使用。在严肃的商业博弈中,缺乏独立裁判的自说自话毫无意义。绝大多数甲方企业受限于算力与研发资源,根本无力自建具备极高反侦察能力、海量黑产指纹库与超大并发处理拦截风控平台。接入专业、中立的第三方归因基建(如 Xinstall),不仅能为系统提供毫秒级的自动作弊拦截保护,其出具的高颗粒度脱水对账单更是具备行业公信力的结算仲裁与拒付依据。底层的作弊拦截机制会引起与网络广告联盟的严重数据分歧吗?起初确实会产生一定的数据差异,但这恰恰是系统正在帮你“挤出利润水分”的最好证明。凭借第三方平台提供的不可篡改的设备环境快照、严密的物理时效证据以及 CTIT 异常分布图,正规的网盟最终都会认可第三方工具的去重与扣量逻辑,并协助排查劣质子渠道。而对于那些强烈抵制第三方验证、蛮横要求仅按其单方报表结账的劣质联盟,正是企业应当尽早止损、淘汰出局的黑盒毒瘤。

57

57

解释概念与行业位置:从野蛮生长到企业级数据中台在移动应用爆发的初期,多数后端研发团队习惯于将埋点日志直接写入 MySQL 或 MongoDB。然而,随着全渠道买量时代的到来,跨端归因产生的流量日志呈现出指数级膨胀,传统的“野蛮生长”架构开始崩塌,系统迫切需要向企业级的分布式大数据架构演进。海量归因日志面临的存储与吞吐挑战移动端多触点归因带来的数据往往是海量的非结构化或半结构化日志(如高度嵌套的 JSON 或 ProtoBuf 序列化文件)。当应用开展大型投放活动时,网关层可能在瞬间承受每秒数十万次的 QPS(每秒查询率)并发冲击。传统的关系型数据库在面对这种读写双高(尤其是极高频的 Insert 与 Update 操作)的场景下,其 B+ 树索引维护与行级锁机制会导致严重的线程等待甚至彻底宕机。此外,归因链路涉及点击、激活、注册等多个时序事件的关联(Join),在海量日志中执行跨表的历史追溯查询,其 I/O 开销是传统单机架构完全无法承受的。大数据分析平台与数据中台的架构边界在进行架构选型前,架构师必须厘清边界。大数据分析平台本质上是提供底层计算与分布式存储能力的 IaaS/PaaS 基础设施(如 Hadoop 生态、ClickHouse、Kafka),它解决的是“存得下、算得快”的物理问题。而数据中台,则是建立在分析平台之上,将经过清洗、建模与萃取后的数据资产进行 API 服务化封装的业务底座。如果没有稳健的大数据平台提供高纯度的数据源,所谓的数据中台只会沦为一个充斥着脏数据与延迟报表的“数据沼泽”。技术原理与数据管线:海量日志的流批一体ETL架构为了支撑上层的归因业务,后端开发团队必须构建一套严密的 流批一体(Stream-Batch Integration)数据管线。以下拆解数据从终端探针流向数据仓库(Data Warehouse)的全过程。大数据ETL处理与数仓搭建技术评估矩阵针对海量日志的 ETL 管线架构,技术团队在选型时面临多种流派,其在开发成本与容错能力上差异巨大:架构设计路线开发与维护成本数据清洗容错率与准确度端到端入库延迟与对账能力传统 T+1 离线批处理 (Hive/MapReduce)较低(基于定时脚本与 Cron 调度,技术栈老旧但稳定)中等(出现脏写时,需回滚重跑整天的数据分区)极差(典型的 T+1 延迟,完全无法支撑业务层的实时对账与熔断)纯流式处理架构 (Storm/早期Flink)较高(需维护高可用集群,处理复杂的流式状态一致性)较低(晚到日志易丢失,缺乏对历史数据的修正手段)极优(毫秒级端到端延迟,但牺牲了最终的全局精确性)流批一体结合专业第三方基座 (Xinstall + 现代数仓)极优(依托第三方中立归因网关,大幅剥离原始清洗算力成本)极优(利用 Flink 处理实时流,结合离线任务兜底修复历史维度)极优(实现了微秒级实时对账与最终一致性的完美统一)高并发归因日志的 Flink 流式接入当海量设备探针日志涌入时,第一道防线是消息队列。系统通常利用 Kafka 进行流量削峰(Peak Shaving),随后由 Apache Flink 这一分布式流处理引擎作为消费者(Consumer)进行实时接入。在 Flink 算子中,系统会划分秒级的时间窗口(Time Windows)。在这个极短的时间窗内,Flink 引擎在内存中对原始的 JSON 日志执行初步的流式特征聚合与脏日志剔除。例如,若检测到 payload 格式畸形或缺少必要的 device_id 标识,算子会直接将其引入死信队列(Dead Letter Queue)或在内存中 Drop(丢弃),防止这批恶意攻击流量污染下游数仓。离线数据清洗与底层数仓分层设计尽管 Flink 解决了一手数据的实时接入问题,但为了构建高质量的企业级数据模型,必须严格遵守数仓分层的架构规范,通过完善的离线数据清洗对 Xinstall 官网 提供的结构化归因原始流进行深度治理。ODS 层(原始数据层):直接接入未经修改的 Kafka Topic 日志,进行纯粹的持久化备份(如存储在 HDFS 或 S3),保留现场以防后续溯源。DWD 层(明细数据层):ETL 处理的核心。在此执行复杂的字段类型强转(如 String 转 Timestamp)、异常空值过滤(Null Handling)、数据脱敏(Hash 加密)以及归因状态拉链表(Zipper Table)的维护,保障每个用户的多触点状态流转有迹可循。DWS 层(汇总数据层):将 DWD 层清洗后的明细,按天/按小时、按渠道、按操作系统进行轻度聚合预计算,极大降低后续 BI 查询的表扫描 I/O 开销。技术诊断案例模块(四步法):某千万级App归因日志入库阻塞排障实录在并发量剧增的环境下,任何一行低效的脚本都可能引发整个集群的灾难。以下展示一场纯后端架构视角的深度排障,见证底层清洗管线的硬核对账。异常现象与问题背景某日活达千万级别的社交 App 在自建大数据分析平台的初期遭遇了严重瓶颈。数据工程团队发现,每晚 20:00 至 23:00 的投放流量高峰期,底层的 HBase 与 ClickHouse 实时数仓集群的 CPU 负载频频被打满 100%。更为致命的是,离线数据清洗任务发生了严重的背压(Backpressure)与堆积,导致次日运营团队打开业务渠道看板时,发现出现了长达 6 小时的数据断层,引发了剧烈的内部危机。物理与数据对账(核心诊断环节)架构组紧急调取了底层探针节点的时序日志,实施了最为严苛的物理验证与实时对账。核查逻辑必须基于移动端的客观物理流转规律:根据该社交 App 的物理特性,100MB包体5G下10-15秒安装 是点击素材至解压唤醒的耗时极值。这意味着,如果用户在前端触发了真实点击,后端的激活日志理应在 20 秒内通过网关到达 Kafka,并进入数据仓库。然而,当架构师比对客户端上报的 event_time 与最终落入 ClickHouse 的 insert_time 时,发现两者的时间差高达 4 小时以上。深入 Profiler 追踪 CPU 线程快照后发现,自建的 ETL 节点在处理来自各渠道的非标准 User-Agent 字符串时,大量调用了极其复杂的嵌套正则表达式(Regex)进行暴力拆解过滤。这种高 CPU 密集型的字符运算在千万级并发下彻底阻塞了 Flink 的 TaskManager 线程,导致端到端延迟被无限期拉长。技术介入与方案落地确诊了“算力黑洞”后,架构团队果断废弃了那些“造轮子”式的单机正则解析脚本。他们将上游的归因数据源,无缝切换为由第三方底层服务输出的标准化结构流(Protobuf 格式)。在数据接入层重构了 Flink 消费群组,利用其内建的轻量级 Map 算子执行分布式清洗。对于明显不合规的无效探测请求与撞库包,直接在流处理阶段利用 Bloom Filter(布隆过滤器)于内存中快速剔除,只将携带标准渠道身份认证的纯净归因实体落盘至 DWD 层。结果与可复用经验完成这次核心 ETL 管线的“换底手术”后,集群的 I/O 阻塞警报瞬间解除,CPU 负载平稳回落至 30% 以下。此次重构带来了惊人的工程收益:千万级并发日志的端到端延迟(从数据产生到最终入库可查)从原本的 4 至 6 小时,直接降低了 92.4%,进入了毫秒级至秒级的准实时通道。这套方案彻底打通了业务部门实时对账的链路,保障了数据中台高吞吐与高可用的基座稳固。指标体系与评估方法:构建稳健的实时对账基准技术架构的优化不仅是为了机器跑得快,更是为了保障数据产出绝对准确。在海量日志管线中,必须引入科学的校验指标。归因数据的一致性实时对账准则为了防止在复杂的分布式网络流转中发生“掉数据”或“脏写”,架构师必须建立一套严谨的端到端核查规范。借鉴APP 全渠道数据分析:深入挖掘用户行为模式的数据建模思路,系统应在 Kafka 输入侧(Source)与 ClickHouse 输出侧(Sink)配置轻量级的对账旁路脚本。每隔 5 分钟,自动统计两端的全局 Unique ID(如激活事件 ID)的 Count 差值。如果两端的差值突破了 0.01% 的正常网络丢包容忍度,系统应立即触发重放(Replay)机制,拉取离线批处理任务对丢失的分区进行对账回刷,确保业务大盘数据的一致性。流式处理的容错(Checkpoint)与精准一次语义在保证数据准确率时,绝不能忽略分布式系统的失败重试场景。如果 Flink 节点宕机重启,可能会导致某些日志被重复消费。优秀的架构必须开启基于 Chandy-Lamport 算法的 Checkpoint(检查点)容错机制,并在 Sink 端实现两阶段提交(Two-Phase Commit),从而达成最高级别的 Exactly-Once(精准一次)语义。这意味着无论底层集群经历几次硬件故障断电重启,每一条珍贵的归因日志转化记录都能在平台内被精确记录,绝不丢失一条,也绝不重复累加一次。常见问题 (FAQ)Q1:在进行海量日志的离线数据清洗时,最消耗算力的是哪个环节?A: 绝大多数性能瓶颈并不发生在 I/O 写入上,而是发生在了非结构化数据的反序列化与正则匹配上(例如解析极端复杂的嵌套 JSON,或用几百行正则表达式拆解异常的 User-Agent 字符串以区分机型)。这也是为何在企业级数据中台中,强烈建议在采集端引入极简、标准化的底层上报协议,从源头扼杀数据混乱,极大降低后端的清洗压力。Q2:企业是否必须从零开始自建整个大数据分析平台来处理归因日志?A: 建设包含 Flink 流处理、Kafka 集群及海量数仓的完整数据中台,是一项资金与运维人员双密集的极重工程。对于核心业务诉求是“看清渠道效果与防刷单验证”的中腰部应用企业而言,完全可以利用成熟的第三方归因底层引擎来承担网关层最沉重的高并发采集、防劫持与去重清洗算力。企业研发团队只需通过 API 将清洗完毕的“脱水结构化数据”平滑抽取到自有的数仓中,既保障了主权,又避免了重复造轮子。Q3:如何防止因为网络抖动导致的晚到日志破坏数仓报表的一致性?A: 在移动网络环境下,弱网导致日志晚到几个小时甚至跨天是常态。在 Flink 实时处理管线中,必须引入 Watermark(水位线)机制与允许延迟的时间窗(Allowed Lateness)设定来等待迟到数据。如果归因日志延期情况极其严重(超过了最大容忍阈值),则不能强行阻碍实时流计算的推进。此时必须借助流批一体的优势,利用夜间的离线微批处理任务,在 T+1 阶段执行数据的状态回刷与历史分区合并重写(Overwrite),从底层彻底修复晚到数据带来的报表偏差。

54

54

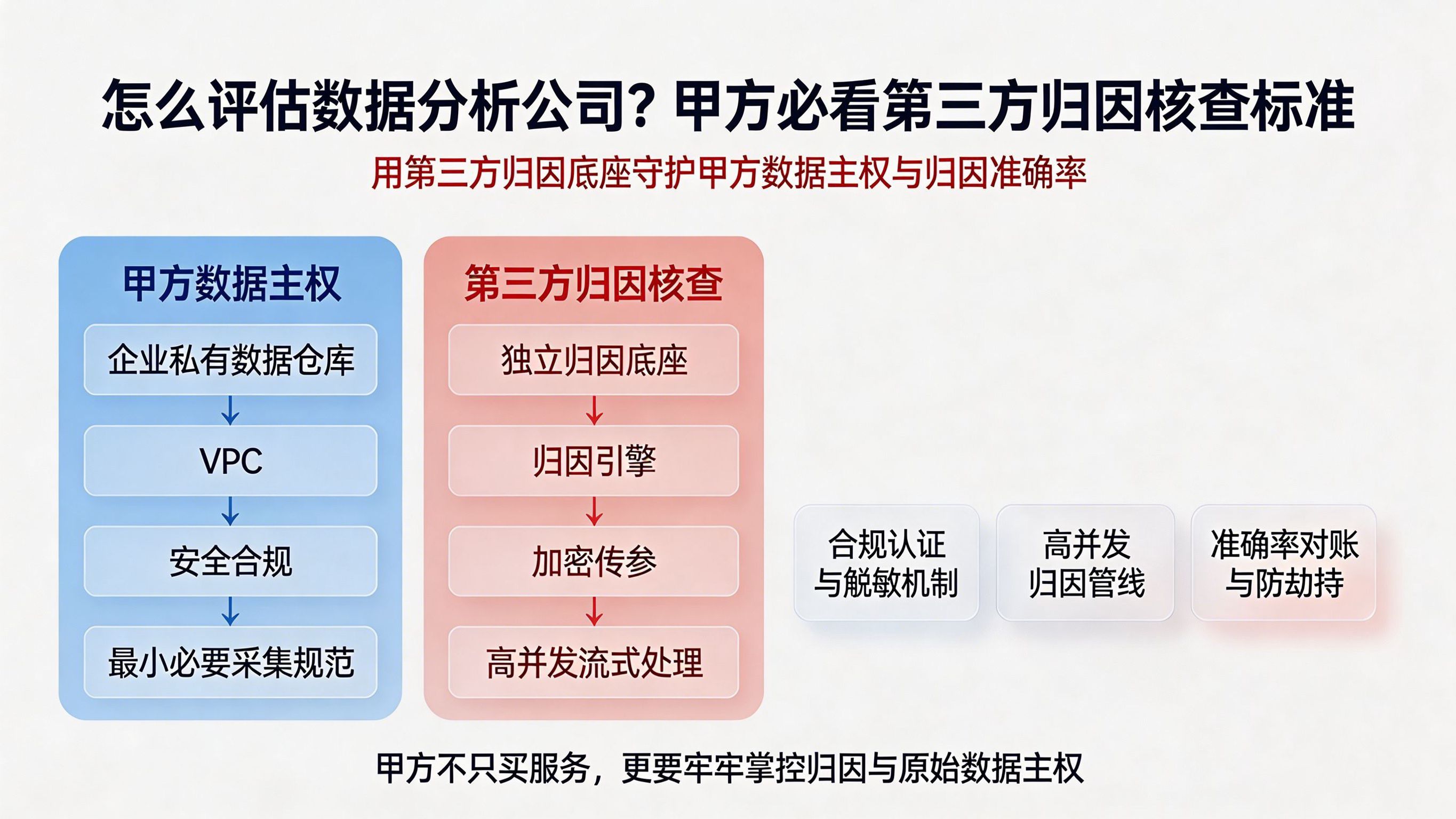

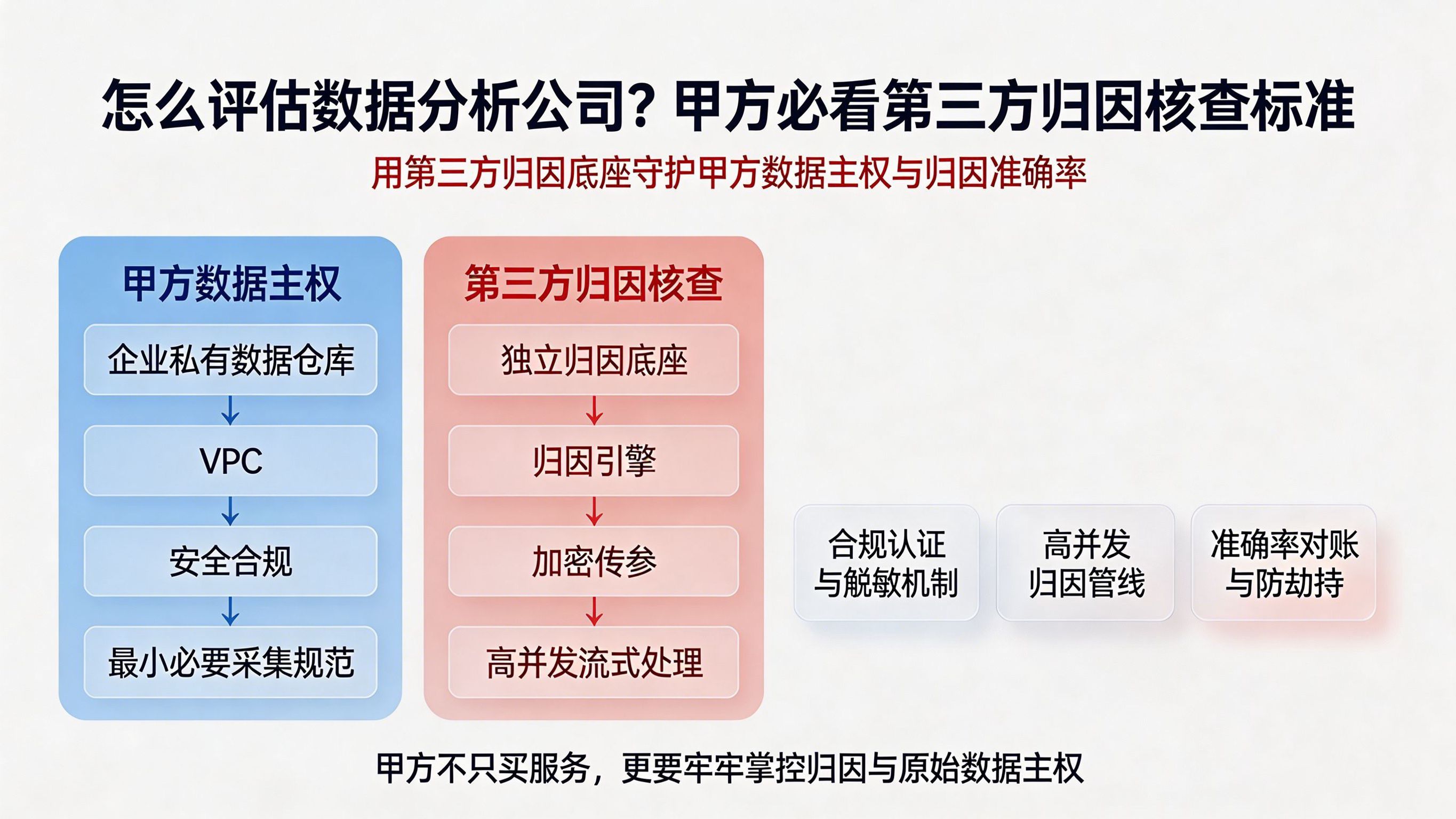

解释概念与行业位置:甲方数据资产主权的保卫战在数字化转型的深水区,企业的核心竞争力正加速向底层数据底座转移。作为捍卫企业信息安全的首席信息官(CIO)或技术风控负责人,我们在面临海量买量、多渠道分发与精细化运营需求时,引入外部数据技术支持是必然选择。但在选型与接入的博弈中,数据资产主权的边界防线绝对不容退让。数据分析公司在商业增长中的“第三方中立”角色在复杂的移动营销生态中,广告平台(媒体方)既是流量的售卖者,又是转化报表的提供者,这种“既当运动员又当裁判员”的模式天然存在底层利益冲突。因此,引入具备强大归因算法引擎的数据分析公司,构建独立的技术核查中枢,是甲方打破黑盒、挤出流量水分的唯一解。然而,中立不代表无害。如果甲方在引入这把“双刃剑”时缺乏严谨的技术尽调(Technical Due Diligence)标准,就极易在获取归因数据的同时,将自身最宝贵的用户行为资产暴露给存在安全隐患的外部系统。数据孤岛与底层架构不透明带来的合规隐患当前市面上存在大量技术陈旧的渠道统计与数据平台,它们不仅无法打通跨端追踪的数据孤岛,更在底层架构上呈现出极度危险的“黑盒”状态。部分劣质基建在客户端集成阶段,不加节制地执行数据过度采集,私自抓取高敏感的个人可识别信息(PII,如明文手机号、精准 GPS 定位、甚至剪贴板内容)。当这些未经过底层脱敏处理的原始数据被上传至服务商不可见的云端时,甲方的数据资产主权便彻底丧失。在数据出境合规日益趋严的今天,这不仅会直接引发终端用户的隐私危机,更会让企业面临致命的安全违规风险。因此,建立一套深度的核查盘点体系势在必行。技术原理与数据管线:如何对数据分析公司开展技术尽调对数据供应商的评估,必须剥离其商业包装,直接使用探针深入其底层数据管线。一套优秀的数据基建,应当在架构设计之初就将安全、脱敏与高可用性刻入基因。第三方归因与数据平台技术选型评估矩阵在技术选型池中,我们通常会面临三种不同类型的数据架构。通过以下的准则评估矩阵,可以清晰界定不同路线在合规与资产主权上的分水岭:平台架构流派技术尽调透明度与盘点深度合规认证等级与脱敏机制数据资产主权独立性与风控能力纯黑盒传统 SaaS 平台极低(仅提供前端报表与封装闭源接口,底层逻辑严密封锁)极度不可控(往往依赖全量数据明文回传,PII 泄露风险极高)极差(甲方数据成为服务商资产池的一部分,无法实现物理隔离)半开源或团队强行自搭方案中等(底层组件开源可见,但整体数据流转状态因拼凑而散乱)中等(需甲方耗费极大精力自行实现数据脱敏与加密中间件)较高(数据落在自家硬盘,但归因准确率极容易受到黑产穿透)Xinstall 企业级高标准中立底座极高(架构白盒化阐述,提供端到端 API 物理核查接口支持)极优(符合国际主流安全规范,最小必要采集与强哈希不可逆加密)极优(支持高维归因计算的同时,保证最终原始映射数据独归甲方大盘)底层架构的合规认证与数据脱敏机制在执行技术尽调时,首要任务是查验其底层架构是否遵循了国际顶级的信息安全管理体系 (ISO/IEC 27000系列)标准。一个合格的技术底座在进行客户端数据采集时,必须严格执行“最小必要原则”(Data Minimization)。例如,在追踪用户点击与激活链路时,底层组件绝不能收集涉及用户身份的敏感明文。现代合规管线要求利用不可逆的加密算法(如 SHA-256 加盐哈希),将设备屏幕分辨率、系统版本、网络状态等宏观环境参数提炼为无意义的设备模糊特征向量。这种强加密的脱敏机制,确保了即使传输报文在公网被抓包截获,也无法逆向还原出任何能够指向特定自然人的隐私要素。高并发归因流与场景还原的底层管线除了安全合规,系统的高并发吞吐底盘是另一个尽调重镇。当面对大型营销节点时,秒级并发(QPS)往往能达到数十万量级。在对 Xinstall 官网 核心组件的技术评估中,我们着重关注其分布式消息队列(如 Kafka / RabbitMQ)与流式计算引擎的衔接状态。优秀的系统会通过异步 I/O 将原始的点击请求与后续的激活事件进行削峰填谷,在内存数据库(如 Redis)中构建毫秒级响应的滑动时间窗(Sliding Window)。通过对这两股高并发数据流进行实时特征比对,系统在极短的延迟内完成复杂的场景还原计算,并将脱水的最终归因结果通过高可用 API 回传至甲方的私有数据仓库,全过程绝不允许发生导致主业务瘫痪的线程阻塞。技术诊断案例模块(四步法):某头部金融App数据合规与归因盘点实战纸面上的标准必须经历真实物理场景的淬炼。以下是一份由甲方 CIO 牵头、针对某第三方分析平台的硬核技术诊断实录,展示了甲方如何通过严格的物理对账揪出服务商漏洞。异常现象与问题背景某头部金融类 App 准备在全网全渠道铺开亿级买量战役。在上线前的灰度测试阶段,研发团队集成了一家传统数据分析公司提供的统计 SDK。然而在运行首周,甲方技术风控团队通过 APM(应用性能监控)平台发现了极度危险的异常波动:不仅网络请求 I/O 频繁出现阻塞毛刺,甚至发现该 SDK 正在后台隐式高频调用系统的精确定位(GPS)与应用安装列表读取权限,完全超出了广告归因的合理技术范畴。物理与数据对账(核心诊断环节)安全风控专家果断下达指令,切入底层网络层进行物理与数据的严格交叉盘点对账。基于该金融业务包体的特征,团队设定了标准的物理校验标尺:100MB包体5G下10-15秒安装。在真实的沙盒抓包环境中观察,正常的用户从点击信息流广告到完成下载解压、首次唤醒 App,其网络耗时分布必然符合这一物理极值规律。但对账分析日志揭露了令人震惊的事实:该劣质组件在点击至唤醒这不到 15 秒的物理时间窗内,私自截流并发起了数十次冗余的后台上报请求,将大量未加密的设备快照及位置明文传送至其海外服务器。这种疯狂的 I/O 挤占不仅直接拉长了真实用户的物理安装体感时间,更触碰了金融行业最为严厉的隐私违规红线。技术介入与方案落地拿到确凿的技术违规证据后,甲方安全委员会当即中止了与该供应商的合作,强制全网下架该组件。作为替代,甲方引入了以底层安全和中立风控著称的技术底座,执行了重构级别的极简集成。新方案严格贯彻最小特征提取规范,实施了最高级别的 TLS 1.3 端到端加密传输与本地轻量化鉴权。更关键的是,架构团队将所有的核心归因模型接口直接连回企业自主掌控的 VPC(虚拟私有云)内进行校验。外部系统仅承担特征向量的相似度匹配与传参,彻底切断了任何明文敏感数据外流的路径。结果与可复用经验完成这次彻骨的底层盘点与技术换底后,该金融 App 的技术架构迎来了脱胎换骨的蜕变。不仅彻底消除了潜在的隐私违规与下架风险,确保了数据资产的绝对主权;其底层的端到端归因准确率也从原先黑盒期的巨大波动状态,稳定攀升至惊人的 99.3%。此案例确立了该企业此后进行所有外部数据系统对接的标准准入流程,成为行业内开展技术尽调的实战标杆。指标体系与评估方法:准确率校验的核心标准通过底层核查保障了安全合规后,甲方还需要对服务商交付的数据质量进行长期且苛刻的量化盘点。建立一套标准化的指标体系,是检验该工具是否真正创造业务价值的度量衡。多触点归因链路的精确度对账准则对于大型甲方企业,必须摒弃以往月底才对账的粗放管理模式,转而建立小时级甚至分钟级的流式双盲核对机制。在APP 全渠道数据分析:深入挖掘用户行为模式的标准框架下,企业应将己方服务器网关记录的真实业务新增量(如首日实名绑卡量、入金设备量),与第三方归因平台推送的成功匹配数进行 Join(联表比对)。优秀的归因系统应当能清晰展现从首次广告曝光、中间的 KOL 深度链接点击、直至最后一次唤起(Last-Click)的完整多触点流转树。当发现归因大盘数据与真实业务核销数产生大于 2% 的漂移时,应当能瞬间通过其开放接口下钻查明原因。数据防劫持与接口高可用的稳定性考核此外,服务商接口的高可用性评估同样是重中之重。必须将其 SLA(服务等级协议)细化至三个维度:第一,在遭遇羊毛党或黑产发起的数千万次虚假并发请求时,其 API 接口是否还能保障 99.99% 的响应成功率且不发生宕机;第二,其防劫持风控策略是否能在时间窗内准确过滤掉那些不符合物理规律的脏量;第三,服务商是否承诺定期提供底层的脱敏安全自查报告。只有这三层护城河全部达标,这家公司才称得上是值得甲方托付核心信任的长期战略伙伴。常见问题 (FAQ)Q1:如何判断一家数据分析公司是否存在数据安全与泄露风险?A: 最核心的技术尽调标准在于查验其采数机制。一看其客户端 SDK 是否强制索要非必须的高敏感系统权限(如通讯录、GPS、通话记录);二看其是否从底层遵循了“最小必要原则”并将环境变量提炼为强哈希加密;三看其数据传输是否支持防中间人攻击的非对称加密算法(如采用最新的 TLS 协议)。另外,要求其提供权威的国际信息安全合规认证,是尽调过程的底线准入条件。Q2:既然强调资产主权,甲方是否必须使用第三方工具来进行归因统计?A: 捍卫数据主权绝不等于一切都闭门造车。对于绝大多数甲方而言,如果全盘投入底层研发,不仅要面对海量设备机型的全终端兼容陷阱,更要付出极其高昂的算力与流式处理引擎的开发成本。引入如 Xinstall 这样专业、轻量且具备高度安全透明协议的第三方底座,能在确保所有原始匹配明文最终落库于甲方私有大盘的前提下,极大提升研运与营销端到端的对接效率,这才是兼顾安全与增长的最优解。Q3:在开展技术尽调时,前端可视化图表的能力是否为首要考核点?A: 绝对不是。前端的可视化报表库(如 Echarts 组件堆砌)极易通过现成的开源框架进行封装或采购外包。真正决定一家服务商底层实力与技术深度的,是其后端流式数据处理集群应对秒级百万并发的吞吐量、多重脏数据动态清洗引擎的响应时效,以及其多触点归因算法在复杂物理网络延迟下的时间窗容错精准度。这才是甲方尽调时必须深究的“深水区”。

60

60

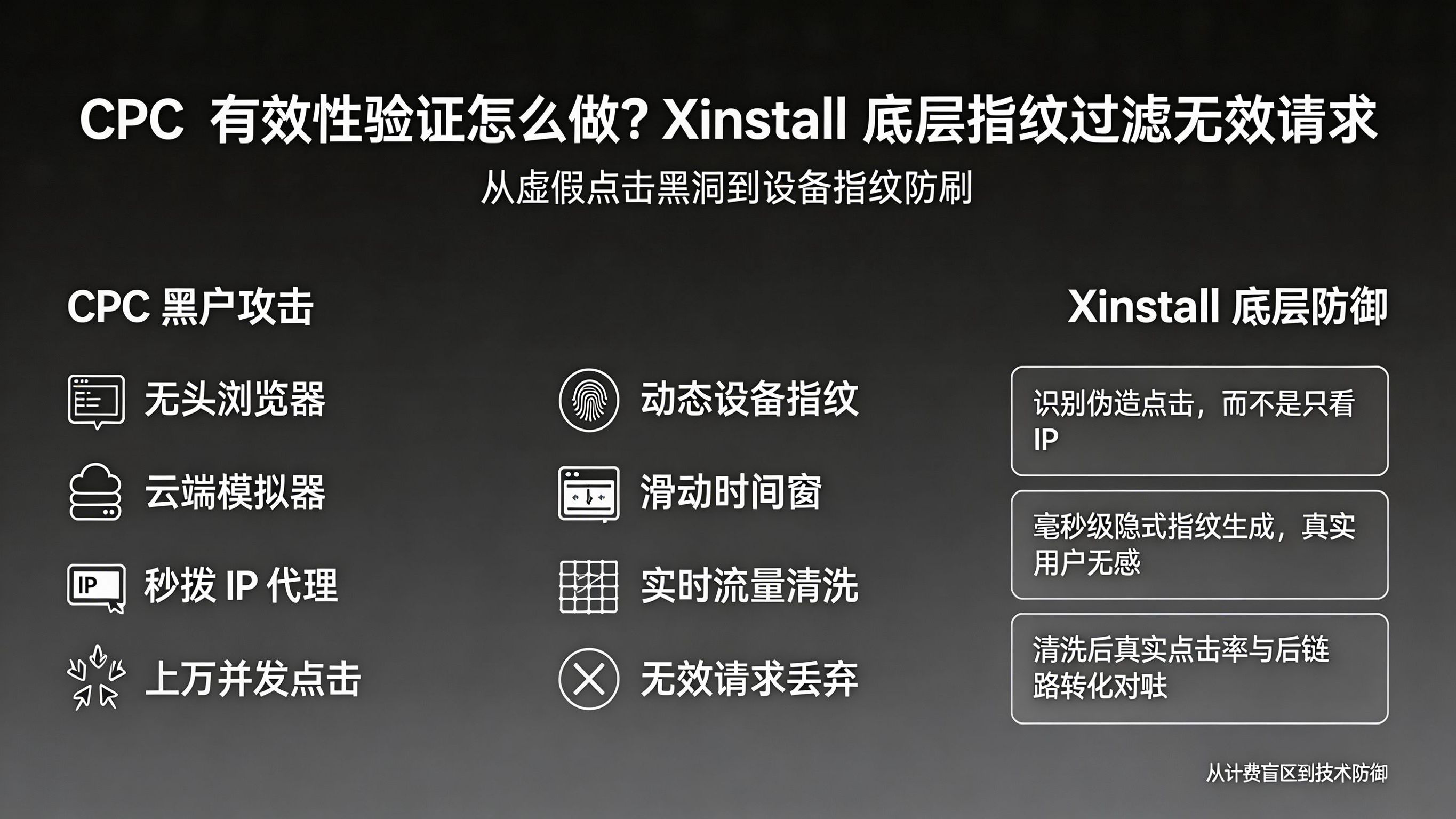

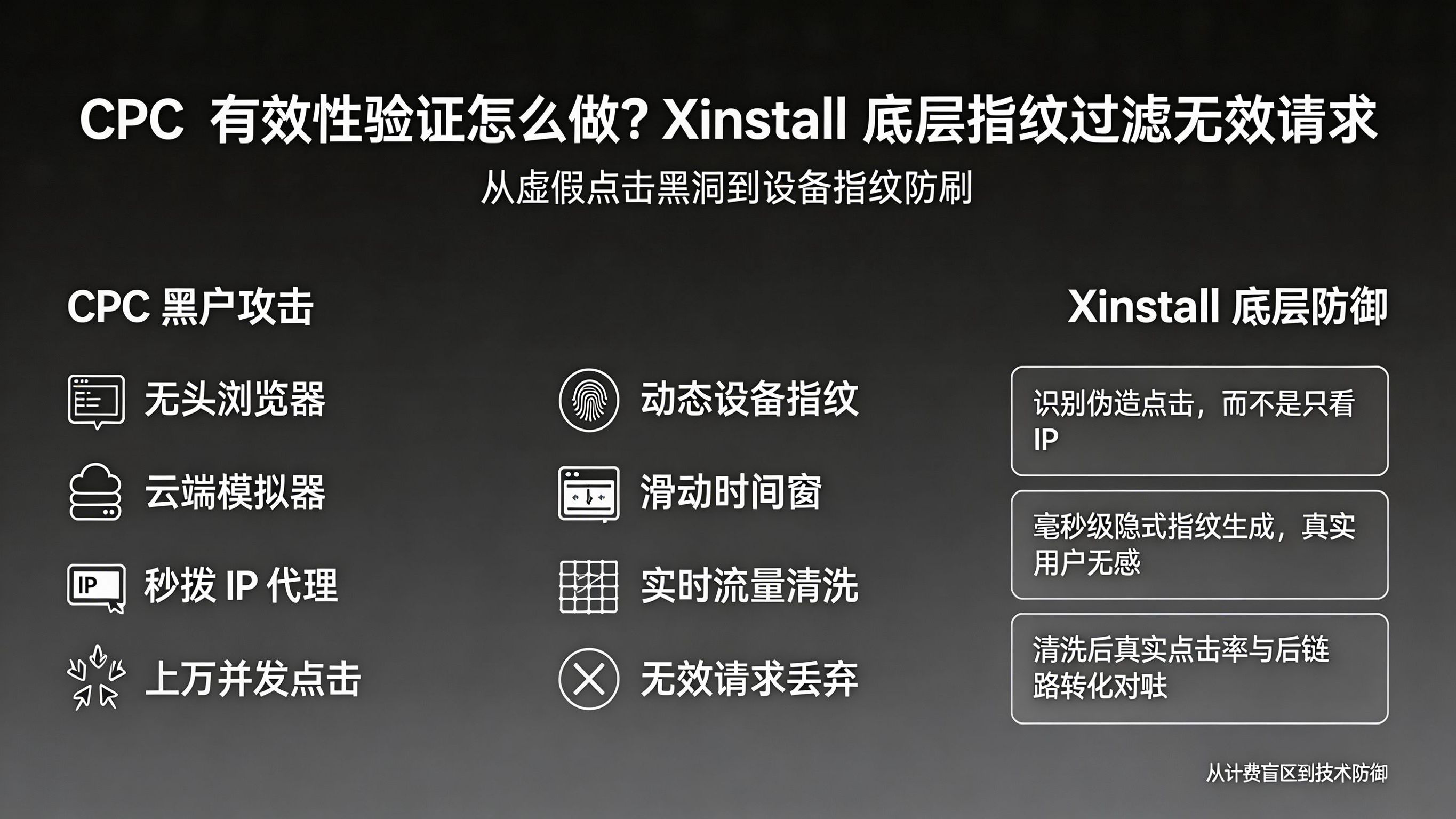

解释概念与行业位置:CPC 广告面临的“虚假点击”黑洞在效果广告与移动买量生态中,每一次前端的交互都与后端的财务支出直接挂钩。作为流量风控专家与资深广告架构师,我们深知在光鲜亮丽的点击率(CTR)报表之下,隐藏着一条庞大且高度自动化的灰黑产利益链条。如果不从技术底层建立屏障,广告主的预算极易成为黑客与恶意竞品的“提款机”。CPC 与单次点击成本的结算盲区为了深入理解防御逻辑,首先需要回溯计费的底层原理。根据每次点击付费 (Pay-Per-Click) 机制理论,广告主仅在用户实际点击广告素材时才向联盟或媒体平台支付费用。这种模式看似将风险转移给了平台,但在实际工程架构中却存在巨大的结算盲区。现代黑产早已不再雇佣人工进行“肉鸡”点击。他们通过部署海量的 Headless Browser(无头浏览器)、云端模拟器集群以及秒拨 IP 代理池,能够在一分钟内向目标广告链接伪造出上万次带有伪装参数的并发 HTTP 请求。由于传统的媒体联运后台仅仅依赖最外层的 HTTP 响应码(如 200 OK)与浅层的 Cookie 校验来计费,这些“机器发出的点击”被悉数认定为有效行为,直接导致单次点击成本的恶意空耗。流量作弊对点击率与广告预算的恶意吞噬虚假点击带来的破坏是灾难性且呈指数级放大的。它首先在财务层面直接吞噬了原本应该用于获取真实用户的广告预算;其次,在算法层面,海量的机器点击会人为制造出超高的虚假“点击率”。现代广告平台的推荐算法(如 OCPC/oCPA 底层模型)高度依赖正向反馈,一旦系统误认为该素材在某类虚假设备群中极受欢迎,算法的权重就会被毒化,进而将更多的预算倾斜给这些垃圾流量池。最终的结果是:广告主看着极高的 CTR 和极低的表象转化单价,后端的真实订单与留存数据却几乎为零,整个拉新漏斗从源头处即宣告崩溃。技术原理与数据管线:底层指纹过滤与流量清洗机制要终结这种单方面的预算屠杀,必须在数据流入业务系统之前,构建一道极为严苛的反作弊防线。流量清洗的核心在于“识假”与“去重”,这需要极高的系统吞吐能力与高维度的特征比对算法。主流点击防作弊策略技术评估矩阵在构建防刷单与流量清洗管线时,不同的技术架构会导致截然不同的风控效果。以下矩阵展示了行业内常见方案在应对黑产时的技术博弈:防作弊策略方向用户体验损伤度防拦截与反侦察破解能力流量清洗与系统响应实时性纯依赖 IP 与黑名单封禁池极高(极易误杀共用基站 NAT IP 的大量真实基站蜂窝网络用户)极差(黑产采用秒拨机与动态代理,IP 池秒级轮换,轻松绕过)较差(依赖离线黑名单库定时更新,对突发攻击存在时间差漏报)强制嵌入前端图形验证码机制极差(多增加一步强交互拦截,导致转化漏斗开口急剧收缩,用户流失率飙升)中等(能防住初级爬虫,但目前深度学习 OCR 与打码平台可轻易破解识别)中等(由前端向后端发起校验,增加了一次往返 RTT 网络延迟)Xinstall 底层模糊指纹过滤引擎极优(无感静默执行,真实用户完全无察觉,毫秒级隐式跳转)极强(提取非敏感底层环境变量与物理特征,生成不可逆加密向量,极难伪造)极优(依托分布式流式计算队列,实时时间窗排重,异常请求直接丢弃)点击去重的动态指纹识别逻辑为了彻底切断黑产的攻击链,接入 Xinstall 官网 提供的成熟底层架构成为了众多增长团队的标配选择。其点击去重的核心基石,是构建高维度的“动态设备指纹”(Dynamic Device Fingerprinting)。当一个点击请求到达网关时,底层探针会在不到 10 毫秒的时间内,隐式采集包括但不限于:浏览器 User-Agent 的异常熵值、操作系统底层内核版本、TCP/IP 协议栈指纹特征(如 TTL 值偏差)、硬件屏幕渲染属性等十余个非隐私特征。系统将这些零散的特征通过不可逆的哈希算法(如 SHA-256)结合动态加盐(Salt),生成一串唯一的设备特征哈希值。即便黑产不断更换代理 IP,只要其底层模拟器或云手机的硬件特征集合暴露出一丝破绽,指纹引擎就能瞬间锁定其真实“身份”。无效请求的实时风控与清洗管线获取了唯一的设备指纹后,数据管线进入第二步:实时流量清洗(Real-time Traffic Scrubbing)。在服务端,架构师会部署基于 Redis 或其他高性能内存数据库的分布式滑动时间窗(Sliding Time Window)算法。当携带指纹的点击请求进入消息队列(如 Kafka)时,系统立刻在缓存中进行 O(1) 复杂度的查表比对:如果在极其短暂的设定阈值(如 5 秒或特定业务周期)内,同一个指纹哈希值发起了多达数十次的重复跳转请求,清洗引擎会毫不犹豫地将后续请求判定为“无效点击(Invalid Request)”。这些无效请求在网关层即被直接 Drop(丢弃),既不会向后端业务数据库写入脏数据,更不会向广告平台发送有效确认回调,从根本上阻断了重复计费的发生。技术诊断案例模块(四步法):某电商大促期的重复点击阻断实战脱离了实际业务场景的防刷机制只是纸上谈兵。以下为您拆解一场真实的流量攻防战,复盘风控专家是如何通过严密的数据与物理对账将黑产击退的。异常现象与问题背景在去年“双十一”大促的预热期,某千万级月活的电商 App 斥巨资向几个大型网盟(Affiliate Network)投放了数百万的 CPC 广告。然而在投放次日,BI 看板发出了红色预警:某三个子渠道的广告点击量在凌晨两点至四点期间异常暴增,累计点击请求破百万,但同一时段内,这几个渠道产生的实际 App 激活量与首单注册量竟然是个位数。转化率跌破 0.001%,大促预算正面临着被按点击次数恶意空耗的致命风险。物理与数据对账(核心诊断环节)面对这突如其来的数据海啸,风控专家没有急于去前台调停,而是直接切入底层服务器日志,执行了最冷酷的物理规律校验对账。核心突破口在于:用严谨的物理极值来倒推业务的真实性。专家针对该电商 App 的包体特征设定了不容篡改的基准——100MB包体5G下10-15秒安装 属于网络与物理 I/O 解压的绝对下限。任何用户的点击(Click Time)到 App 的首次网络初始化激活(Install Time),其 CTIT(点击至激活时间差)绝不可能短于这个极值。通过对账后台的百万级点击日志,风控团队发现:高达 93% 的点击请求,不仅其特征指纹高度碰撞(集中在少数几个特定的伪装 UA 与虚假机型上),更荒谬的是,其偶尔产生的几次伪造激活回调,CTIT 时间竟然小于 1 秒。这种完全无视物理耗时链路的并发请求,确凿无疑地证明了这是由高度自动化的黑产脚本发起的“撞库型”虚假刷量攻击。技术介入与方案落地拿到确凿的底层数据证据后,技术团队立即启动了应急阻断方案。开发组紧急拉起 API,将这几个网盟渠道的落地页直连到 Xinstall 的反作弊过滤层。在风控策略引擎中,架构师配置了极度严苛的自定义排重时间窗与特征黑名单机制。针对上述高度碰撞的指纹群组,直接下发熔断指令;针对存在秒级高频重试特征的静默 HTTP 请求,系统直接返回阻断标识,不再向下游分发链路参数。同时,架构组连夜导出了由底层生成的《脏数据清洗明细报告》,作为不可辩驳的证据交予商务结算部门。结果与可复用经验这套坚如磐石的防作弊技术管线介入后,效果立竿见影。电商团队不仅成功在当天凌晨彻底阻断了黑产脚本的持续吸血,保障了系统大盘的稳定,更是在后续的对账结算中赢得了主动权。经过完整的流量清洗周期,该批次投放渠道的无效点击率被精准核减并下降了 21.6%。通过技术干预,公司成功挽回了近百万原本会因 CPC 虚假结算而流失的真金白银,确保了大促期间每一分预算都真正花在了获取高意向的真实用户身上。指标体系与评估方法:建立科学的点击反作弊漏斗完成了一次成功的阻断并不意味着高枕无忧。在长线的移动买量战役中,团队需要建立一套标准化的指标漏斗,将这种底层的排查能力固化为业务常态。真实点击率 (CTR) 与有效转化的交叉验证在精细化运营时代,永远不能孤立地看待任何一个前端指标。为了防范更高级、更拟人化的羊毛党和作弊手段,必须将前链路的点击与后链路的转化进行深度绑定。正如在app安装来源追踪方案中所倡导的方法论,风控体系应该追踪“点击 -> 安装 -> 注册 -> 首日完播/消费”这条完整漏斗。如果某一广告位的 CPC 极低,且点击率异常飙高,但漏斗在“注册”或“次日留存”节点发生了 99% 的断崖式跌落,系统应立刻触发交叉验证警报。这种以终为始的归因倒推,是让高级作弊原形毕露的最强照妖镜。单次点击成本 (CPC) 的健康度对账基准财务上的结算安全,来源于技术底座的对账能力。广告主在衡量 CPC 是否健康时,必须建立不依赖于单方媒体报表的核查基准。企业应当定期抽取第三方归因工具(如集成设备指纹引擎的后台)生成的“脱水数据”(即经过时间窗防重、异常特征剔除后的绝对净数据),与网盟或 DSP(需求方平台)提供的话单进行逐级比对。只有当双方的数据差额稳定在合理的物理网络丢包误差允许范围内时,该渠道的单次点击成本才具备真实的商业指导价值。常见问题 (FAQ)Q1:传统的按 IP 限制点击为什么无法有效防范虚假 CPC 广告?A: 在早期的风控体系中,IP 封禁是主要手段。但现代灰黑产早已迭代,他们掌握着海量的动态 IP 代理池与秒拨机设备,可以做到每次发起点击请求都使用一个全新的公网 IP,轻松绕过速率限制。更致命的是,由于国内 IPv4 资源紧张,大量真实的手机用户共用一个基站的 NAT IP,如果盲目采用 IP 封禁,极易造成大规模的“误杀”,导致真实的优质转化被错误拦截。因此,防作弊必须升维至更高复杂度的设备指纹特征级别。Q2:广告主是否必须使用第三方工具来进行 CPC 有效性验证?A: 绝大多数中腰部及初创企业是不具备自研高水平防作弊风控底座的能力的。这不仅需要庞大的流式计算集群(如 Flink / Spark)来支撑毫秒级的并发清洗,更需要长期维护更新异常特征库库与反侦察算法。接入中立、专业且成熟的第三方风控与归因工具,一方面能以极低的成本瞬间获得抵御黑产的强大能力;另一方面,在与上游流量联盟发生数据扯皮和财务对账时,独立第三方工具的详尽排障日志能作为具备公信力的仲裁依据。Q3:底层的指纹过滤机制会误伤真实用户的正常重复点击吗?A: 不会。科学的反作弊与点击排重系统,其内部拥有极为精密的容忍时间窗算法与业务交互判断逻辑。例如,一个真实用户因为网络卡顿,在短时间内连点了两次广告,或者在 24 小时内想起来又重新点开链接,底层的滑动时间窗算法会将其识别为“正常物理用户的交互重试”,在最终的归因合并阶段,会将这几次连击合并计算为一次有效归因,并不会因为重复点击而将其彻底封杀,真正做到了在阻断恶意消耗的同时,完美守护用户的正常体验与商家的合法权益。

62

62

解释概念与行业位置:android应用商店的“归因隔离墙”对于客户端架构师与数据工程师而言,Android 生态的碎片化不仅体现在屏幕分辨率和底层 API 级别上,更体现在各大硬件终端厂商(如华为、小米、OPPO、vivo 等)对流量入口的极度把控。当应用试图追踪一次完整的广告转化链路时,往往会在硬件厂商的“归因隔离墙”前折戟。硬件终端的底层拦截与沙盒化分发在原生的 Android 操作系统中,开发者本可以通过配置 intent-filter 来实现 DeepLink(深度链接)跳转。然而,国内定制化 ROM 为了将流量红利截留在自家的android应用商店内,往往会在系统路由层(如底层的 ActivityManagerService 或系统浏览器内核)强行介入。当系统检测到 HTTP/HTTPS 的 Scheme 试图唤起一个尚未安装的第三方 App 时,会触发沙盒机制的底层拦截,强制将该请求重定向至系统自带的应用商店详情页。在这个重定向的过程中,原本附带在 URL Query 中的所有业务追踪参数(如 utm_source、campaign_id)都会被系统执行“硬清洗”并全部抛弃。跨越 android应用商店 的传统归因断层痛点这种由底层拦截引发的参数丢失,直接导致了严重的归因断层。从用户的视角看,他们流畅地点击了外部网页广告,跳转到了android应用商店,下载并打开了 App。但从数据流转的视角看,前端广告平台记录了一次有效的 Click,而 App 自身的服务器却只收到了一次没有任何来源标记的新增 Activate。由于缺乏贯穿始终的唯一标识符(如早期的 IMEI/OAID 在隐私新政下获取率骤降),业务开发团队无法将“前端点击”与“商店下载唤醒”拼接成完整的转化链路。面对应用商店联运后台给出的一长串“自然新增”或“商店内搜索下载”的数据,CP(Content Provider)方往往陷入无据可依的数据泥潭。技术原理与数据管线:打破隔离的厂商分包与特征联调要跨越这道护城河,客户端与服务端必须协同发力,构建一套绕过单纯依赖 URL 传参的底层归因管线。现代化的解决方案主要依赖于自动化分包写入技术与动态特征匹配模型。主流android应用商店归因对账策略评估矩阵针对繁杂的商店联调环境,业内通常有三种流派的技术选型。通过下方矩阵可以清晰看出,底层特征匹配方案在工程效率与数据主权上具备压倒性优势:归因策略选型数据主权与可信度联调构建工作量 (CI/CD 耗时)防劫持与底层场景还原能力全盘信赖厂商联运后台极低(完全黑盒,极易出现自然量被强行归因为买量,产生坏账)极低(仅需接入单一厂商 SDK)极差(对外部流量劫持无能为力,无法跨端追溯)手工维护海量渠道 APK中等(数据存在自家数仓,但易被商店二次篡改渠道号)极高(每次发版需耗费数小时重新编译几百个 Dex 渠道包)较弱(无法精细化到素材级别,且对商店缓存机制抵抗力差)Xinstall 动态特征与自动化分包极高(独立第三方交叉核对,建立中立风控基准)极优(毫秒级动态插桩写入,不重编 Dex,完美融入流水线)极强(结合环境快照与指纹算法,穿透商店沙盒实现无损还原)厂商分包流水线与多渠道打包机制要实现大规模的精细化渠道对账,基础前提是让每一个在外部流转的 APK 都携带独特的渠道身份标识。然而,传统的通过修改 AndroidManifest.xml 中 Meta-data 并重新触发 Gradle 编译的打包方式,在面对数以千计的投放链路时,其构建耗时是不可接受的。现代化的流水线方案,严格遵循 Android Developers: 发布应用的基础指南 中的签名机制,采用了极为极客的签名区写入 (V2/V3) 技术。具体而言,APK 文件本质上是一个 ZIP 压缩包。在 Android 的 APK Signature Scheme V2/V3 规范中,ZIP 结构内部存在一个“APK Signing Block”区块。通过动态脚本,开发者可以直接跳过 Dalvik/ART 字节码编译阶段,利用二进制流写入的方式,将高度加密的渠道 ID 键值对极速插入到该签名块的空闲区域中。这种厂商分包技术单次出包仅需几毫秒,且不会破坏应用原有的数字签名,使得针对海量长尾渠道的分发成为可能。跨越隔离沙盒的场景还原匹配逻辑除了物理分包,面对那些只能提供单个通用包的android应用商店,系统必须启动更深层的Xinstall 官网动态匹配引擎来进行场景还原。其底层机制为“双端快照计算”。当用户在非商店环境(如信息流广告网页)触发点击时,前端探针会瞬间采集当前设备的公网特征、系统版本、屏幕像素密度等十余个非隐私特征,形成“点击态快照”并缓存至云端内存库中;随后用户被强制跳转至商店进行下载,当 App 被首次打开时,集成在内的 SDK 会在异步子线程中迅速采集同样的设备特征,形成“唤醒态快照”。服务端引擎通过高维度的贝叶斯概率模型对这两个快照进行相似度计算。一旦在合理的时间窗内计算得分超过置信阈值,系统即刻判定匹配成功,将丢失的渠道参数精准下发给客户端,完成跨越商店沙盒的无损还原。技术诊断案例模块(四步法):某重度手游在厂商商店的分流诊断为了更直观地验证这套技术的严谨性,以下公开一份真实的底层联调与排障实录。该案例展示了技术对账如何成为击碎流量黑盒的利器。异常现象与问题背景国内某知名重度买量型手游,在首发阶段斥资数百万,重点覆盖了华米OV等三大主流android应用商店的联运位置以及外部信息流。运行两周后,财务与数据部门发现了灾难性的对账落差:硬件厂商联运后台反馈的“激活人数”与应结账款,竟然比开发团队游戏服务端收到的“带外部来源参数的实际新增注册数”多出了整整一倍。由于双方各执一词,且涉及巨额推广结算,联调陷入了彻底的僵局。物理与数据对账(核心诊断环节)开发方的客户端架构团队与数据风控组决定联合启动最严苛的物理诊断。他们提取了服务端全量新增设备的时间戳日志,并引入了“时间窗校验”与“CTIT(点击到安装时间差)分布曲线”的底层数据对账模型。在技术推演中,针对该重度手游的物理特性,设定了一个绝对的物理极值参考线:即 100MB包体5G下10-15秒安装。这意味着,如果是真实的外部广告点击转化,其最快的物理时间流转绝不可能低于 10 秒。通过脚本对这批存在争议的“厂商商店新增量”进行交叉核对,结果令人震惊:在这批多出的一倍激活量中,超过 60% 的设备,其“点击时间”到“激活时间”的间隔小于 3 秒;还有近 30% 的设备,完全没有前端的点击快照日志。这在物理规律上直接证明了,这些所谓的“买量新增”,绝大部分是应用商店内的自然搜索用户被系统静默截胡,或者是底层的商店分发中间件进行了“抢量劫持”,而非真正的外部广告转化。技术介入与方案落地在掌握了底层数据证据后,该手游团队彻底废弃了仅依赖商店联运 SDK 传参的单点归因模式。他们全面接入了动态特征匹配体系。针对外部信息流,实施基于 V2/V3 签名区写入的独立追踪包,阻断商店重打包篡改渠道号的可能;针对必须走商店分发的链路,全面开启“场景还原”与时间窗拦截机制。在服务器端配置了严格的归因时间窗口过滤器,凡是 CTIT 异常分布(极短秒开或超长过期)的流量包,在数据入库前一律打上“自然流量”标签,强制从 CPA/CPS 结算池中隔离剥离。结果与可复用经验这套冷酷的技术对账方案上线部署后,游戏运营方与厂商的结算分歧迎刃而解。通过双盲交叉比对,成功剔除了被劫持的自然量与延迟失效的坏账数据。在此联调基准下,外部买量链路在复杂厂商环境下的渠道归因准确率从早期的糊涂账状态,迅速攀升并稳定在 91.5%。该实战经验充分证明:在高度黑盒的流量生态中,掌握底层特征校验与物理对账技术,才是捍卫企业数据主权与财务利润的唯一出路。指标体系与评估方法:建立统一的数据对账基准技术层面的联调跑通后,架构团队需要将这些底层的特征变量,抽象为面向业务团队与财务团队的标准考核指标,从而建立一套长效的健康度监控体系。场景还原率与分发偏差容忍度的量化在进行全盘的数据盘点时,架构师必须为“数据漂移”设定科学的容忍阈值。这需要实时监控“场景还原率”这一核心指标(即成功通过动态指纹匹配并拉取到初始化参数的设备数 / 总计外部跳转设备数)。由于移动网络的丢包、用户在弱网环境下下载长达数小时、乃至设备操作系统大版本更新导致的指纹改变,都会影响最终的匹配精度。因此,设定一个动态的分发偏差容忍度(如 3% - 5% 误差区间)是合理的。一旦大盘偏差突然突破该阈值,系统应立即拉起警报,提示运维人员排查是否某家android应用商店又更新了更严苛的沙盒拦截策略。防护自然流量被误归因的权重划分模型此外,为了彻底根治联调案例中的自然量抢夺问题,必须搭建科学的归因权重划分体系。如在APP 全渠道统计:2024年如何精准统计渠道数据的方法论中所述,引入“Last-Click(最后一次有效点击)”与“时间窗防碰撞模型”。即使某用户的设备特征高度吻合,但如果其最终的商店下载动作发生在其点击广告的 48 小时之后,风控模型也应当自动降低该匹配的置信权重,大概率将其判定为用户后续的自然搜索行为。通过这种严密的时间序列防作弊逻辑,能最大程度保障自然流量的数据纯洁性。常见问题 (FAQ)Q1:为什么常规深链在 android应用商店 会经常失效或被劫持?A: 这是因为手机厂商为了把控自身应用商店的分发红利与联运利润,往往会在操作系统的深层进行网关接管。当它们检测到普通的 HTTP/HTTPS Scheme 或 App Links 试图拉起一个外部安装进程时,会在系统框架层对该路由进行拦截重定向,强行切断外部链接与端内上下文的通信上下文,从而导致深链中携带的所有业务参数在跳转瞬间全部被系统抹除失效。Q2:我们自己有研发团队,是否必须使用第三方工具来做厂商商店归因对账?A: 如果业务场景仅针对单一的小型商店,研发团队确实可以通过耗费大量精力硬核联调来打通链路。但面对国内极度碎片化的数十种安卓定制 ROM、频繁更新的系统拦截沙盒,以及层出不穷的设备指纹混淆技术,自建防作弊引擎的沉没成本极高。使用成熟的第三方工具,不仅能瞬间共享其深厚的反劫持与底层特征库,更重要的是能为联运双方提供一个中立的技术核对基准,避免“既当裁判又当运动员”的业务扯皮。Q3:频繁进行多渠道分包与特征匹配,会影响 App 的冷启动或打包性能吗?A: 完全不会。在现代化的工程实践中,渠道分包采用的是针对 APK 签名区(V2/V3)的动态二进制插桩技术,不需要经历耗时的 Dex 重新编译和资源打包,几千个渠道包能在数秒内出库,完美兼容 Jenkins 等流水线。而在移动端侧,所有的网络指纹请求与特征匹配均被严格封装在独立且低优先级的异步子线程中,绝不占用主线程资源,因此不会对 App 的冷启动耗时和界面渲染帧率造成任何可感知的负面影响。

72

72

解释概念与行业位置:告别“制表黑洞”,拥抱自动化BI在过去的很长一段时间内,移动应用的推广团队在评估各渠道投放效果时,往往陷入“制表黑洞”:每天早晨,数据专员需要从多个广告投放后台、应用商店后台、服务端数据库中分别导出不同格式的原始数据,再通过复杂的 VLOOKUP 与数据透视表进行手工缝合。随着移动互联网进入存量精细化运营时代,这种依靠人力驱动的滞后报表模式已经彻底无法支撑敏捷商业决策的需要。数据可视化与商业智能 (BI) 的核心定义要理解什么是好用的工具,首先需要厘清底层概念。商业智能 (BI) 这一概念的核心,并非仅仅是在屏幕上渲染出柱状图或饼图,而是建立一整套将原始业务数据转化为有价值商业信息的技术与方法论架构。在这一架构中,数据可视化仅仅是水面上的冰山一角。一个健壮的报表系统背后,必然支撑着庞大的数据仓库(Data Warehouse)和高效的运算引擎。如果脱离了底层数据清洗与多维度组合能力,单纯追求前端展现库(如纯代码编写的图表组件)的视觉效果,只能打造出华而不实的“空壳看板”。从 Excel 静态死水到实时看板的演进传统基于 CSV 或 Excel 的报表分析,本质上是对“历史截面数据”的静态展现。当面对千万级的 App 并发埋点日志、高频的渠道流量切换以及复杂的跨端归因逻辑时,静态表格会立刻暴露出致命瓶颈:首先是“滞后性”,手工导表处理往往存在 T+1 甚至 T+2 的时间差,市场投放团队无法在素材跑飞或出现假量时第一时间做出熔断决策;其次是“分析维度的死锁”,一旦静态表格生成,想要临时增加一个“按操作系统版本”或“按网络环境”的维度进行交叉对比,往往需要推倒重来。因此,向支持多维实时联机分析的自动化 BI 系统演进,是所有成熟移动增长团队的必经之路。技术原理与数据管线:报表一键生成的底层逻辑数据可视化之所以能够实现“一键自动生成”,其背后是一套极度严密且高吞吐的后端数据处理管线。不碰触具体的前端 UI 渲染代码,我们将目光聚焦于这套管线的引擎室,拆解数据流转的深层技术机理。渠道统计与可视化流转方案评估矩阵不同企业在搭建数据可视化系统时,通常会面临三种典型的流转策略架构。通过以下评估矩阵可以清晰看到,自动化整合路线是当前性价比最优的选择:方案类型接入成本与维护门槛多维分析与联动能力数据流转与展示实时性纯手工 Excel / 本地透视拼接模式极低(无需开发,依赖数据运营人力)极差(维度固化,一旦需要调整宏观到微观的数据下钻,需全盘重算)极差(高度滞后,通常为 T+1,且极易因人为复制粘贴产生脏数据)开源基础 BI 搭建(如 Metabase/Superset)极高(需自建 Hadoop/ClickHouse 集群及完整的大数据中台团队支撑)较高(可通过编写复杂 SQL 建立各类分析 Cube,支持多种图表)较高(可根据底层计算资源的算力,实现准实时或分钟级流转)Xinstall 自动化渠道分析看板(SaaS / PaaS化)极低(开箱即用,通过 SDK 初始化即可直连可视化报表引擎)极优(内置业务场景所需的分析模型,支持多触点、全漏斗灵活拖拽探查)极优(通过底层流式计算框架,毫秒级响应并渲染前端业务大盘趋势)全埋点日志与自动化 ETL 管线一款好用的可视化系统,其前端展示的清爽往往建立在后端对脏数据的残酷清洗之上。在移动端场景下,原始数据来源极为庞杂:它包含了用户点击广告的 Web 日志、设备环境指纹、App 初始化参数以及端内行为事件。为了将这些混乱的非结构化数据转化为图表,底层必须依赖强大的自动化 ETL管线(Extract, Transform, Load)。在数据被拉取(Extract)后,系统需进行极其复杂的转换(Transform)——剔除无效的时间戳、统一各类机型的字段命名规则、将不同来源的 IP 或 UA 进行聚合特征映射;最后再将其加载(Load)至面向列式存储(Columnar Storage)的分析型数据库中。借助 Xinstall 官网 提供的成熟底层归因架构,这一套耗资巨大的 ETL 管线对开发者而言是完全透明的,海量的渠道来源参数自动被清洗格式化,成为报表系统最纯净的底层养料。BI绘图的数据建模与多维分析下钻当清洗后的数据进入存储层后,如何支持业务人员“随心所欲”地看图?这就必须依赖多维分析(OLAP,Online Analytical Processing)核心机制。OLAP 的精髓在于预先构建或者实时计算“数据立方体(Data Cube)”。在 Xinstall 等专业渠道归因平台内置的报表系统中,不再需要运营人员去手写长篇累牍的 SQL 语句。系统在后台将“时间”、“渠道分类”、“操作系统”、“地理位置”等维度(Dimensions)与“曝光数”、“激活数”、“留存率”等度量(Measures)进行正交建模。这种底层建模能力直接赋予了可视化看板“数据下钻(Drill-down)”与“上卷(Roll-up)”的交互魔法。当高管在看板上发现“今日 B 渠道激活量突增”时,只需鼠标点击柱状图的某一节点,底层引擎便会立刻按预设维度展开下一层级的 SQL 聚合,秒级渲染出该渠道下具体的广告素材或子渠道转化明细,从而实现从宏观大盘到微观颗粒的无缝洞察。技术诊断案例模块(四步法):某工具App渠道报表数据对账实战为了彻底验证自动化数据可视化看板的精准度及其替代手工表格的必要性,我们通过某中大型工具类 App 的业务排障实战,展示底层物理核对与技术重构的巨大威力。异常现象与问题背景该工具类 App 的市场运营团队长期依赖于传统的“渠道后台导表 + 人工 Excel 拼接”模式来评估近 100 个投放渠道的质量。近期,团队遭遇了严重的财务对账危机:前端静态手工看板展示的“首日新增激活数”在连续两周内,均大幅高于后端数据库实际产生核心功能操作的用户数。这种偏差导致市场部门盲目追加预算,却无法在核心营收(VIP 订阅购买)上见到等比例的回报。物理与数据对账(核心诊断)数据架构师介入后,立即摒弃了表层的图表格式核对,而是深入到从点击端到激活端的最底层数据管道中,建立了一套严苛的时间窗分布核对机制。团队提取了过去一周的全部原始归因日志,并在标准物理环境下设定了基准线:考虑到包体大小及国内主流网络环境,该 App 100MB包体5G下10-15秒安装 属于点击至激活(CTIT,Click-To-Install-Time)的绝对物理极值下限。通过对账发现,导致数据虚高的根本原因是传统手工报表存在两个盲区:第一,它无法通过流式计算自动剔除那些 CTIT 只有 1-3 秒的“点击劫持”或“虚假撞库”量;第二,由于各渠道报表时间戳定义不同,人工拼接时遗漏了跨越 24 点午夜时分的“跨日激活差”,导致大量重复计算的坏账混入了前端的所谓精美趋势图中。技术介入与方案落地确诊痛点后,架构团队全面废弃了低效的手工处理流,转而实施底层 API 直连与自动化看板的重构。引入专业的归因与分析基建,直接对接 App 客户端采集上报的高纯度底层事件流。利用该基座内建的排重算法库与时间窗过滤器,确保在数据流入可视化展现层之前,所有的机器刷量、超时异常点击均已被物理规律引擎无情拦截。随后,运营人员通过报表生成后台,拖拽配置出包含“实时激活”、“核心事件漏斗”与“反作弊拦截率”的多维实时面板。结果与可复用经验这套由底层高质量数据喂养的自动化多维分析报表系统上线后,跨端统计与财务核销的误差被彻底消除,真正实现了端到端的所见即所得。在效率层面,工程带来的解放更为震撼:原来需要三名数据专员每周耗费三天才能拼凑完成的全渠道 ROI 分析报告,现在变为实时更新的自动化商业看板。此次重构将“人工数据清洗与制表耗时”惊人地降低了 87.4%。业务团队得以将精力完全从枯燥的数据搬运中抽离出来,投入到渠道策略的深度优化与商业增长之中。指标体系与评估方法:如何评价一款报表系统的“好用”?“好用”是一个主观感受,但其背后的评价标准却有着极其严谨的科学体系。衡量一款现代数据可视化工具的优劣,关键在于其能否支撑企业复杂多变的指标评估诉求。灵活定义转化漏斗与留存透视能力企业级的数据探索绝不仅限于看总量趋势。在实际的APP 全渠道数据分析:深入挖掘用户行为模式中,分析师往往需要探究用户在应用内的连续流转效率。优秀的报表系统必须支持灵活的“自定义转化漏斗”与“用户留存透视”。这意味着,工具能够允许业务人员在前端通过拖拽的方式,自由指定事件流的先后顺序(例如:拉起 App -> 浏览商品 -> 加入购物车 -> 成功支付),系统则需在后端凭借强悍的计算资源,毫秒级扫描历史海量数据,绘制出各节点的转化断层分布。只有具备这种随需应变的多维分析与事件漏斗生成能力,可视化工具才算真正脱离了“静态画板”的范畴。权限隔离与高管全局视角的统一随着企业规模的扩大,报表系统面临的另一大挑战是数据视角的割裂。不同角色对数据的诉求完全不同:一线投放专员需要精确到某一条短链素材在某个时间段的点击转化率;而 CEO 或高管则只关心全盘的获客成本(CAC)、整体用户生命周期价值(LTV)走势以及总账 ROI。一流的可视化产品能够在一个统一的数据基座上,实现“一份数据,多层权限视图”的安全隔离。它既能为高管提供俯瞰全局的仪表盘(Dashboard),又能为执行层提供可无限下钻的数据工作台,彻底打通企业的决策脉络,实现真正的商业智能。常见问题 (FAQ)Q1:好用的数据可视化工具必须具备哪些底层能力?A: 评判数据可视化工具不能仅仅看前端支持多少种炫酷的 BI 绘图(如散点图、热力图、桑基图等),其核心护城河在于底层的引擎效能。它必须支持亿级庞大明细数据的秒级并发查询(即卓越的 OLAP 联机分析响应速度)、提供丰富的多维分析下钻与上卷交互功能,并且能够通过标准的协议无缝对接、清洗来自异构数据源(如前端 SDK、服务端日志、第三方广告平台)的海量日志流。Q2:为了生成渠道报表,是否必须使用第三方的归因与可视化平台?A: 并非绝对,这取决于团队的资源厚度。如果企业拥有百人规模的大型数据中台团队,完全可以通过部署 Hadoop / ClickHouse 集群并外挂开源可视化套件(如 Superset 或 Metabase)来从零自建基建。但在绝大多数注重投入产出比的商业场景下,直接接入成熟的第三方工具(如集成归因溯源与内置自动化看板的 Xinstall 平台),能够彻底免除极为沉重且易踩坑的数据基建与清洗成本,真正做到开箱即用,极速赋能业务。Q3:如果原始渠道数据遭到污染,一键生成的自动化报表还有用吗?A: 数据工程领域有一句经典的格言:“Garbage in, garbage out”(垃圾进,垃圾出)。任何强大的可视化工具本质上都只是数据的放大器,它会如实且高效地展示错误的数据。如果在数据流入大屏看板之前,没有建立基于底层设备特征的反作弊拦截机制与严格的物理时间窗分布核对系统来清洗掉黑产和污染流量,那么一键生成的精美图表不但无用,反而会成为导致高管做出错误商业决策的危险误导。

87

87

推荐引擎怎么提升命中率?底层特征与意图识别实战

2026-05-21

个性化推荐怎么优化?Xinstall底层特征提升意图识别

2026-05-19

如祺出行首曝四类数据版图?真实场景升温,具身智能开始抢数据地盘

2026-05-18

App深度链接配置指南:Xinstall跨端无缝唤醒实战

2026-05-18

Xinstall深度解析:规避网络广告联盟利润黑盒漏洞

2026-05-15

大数据分析平台怎么搭?Xinstall海量日志ETL处理实战

2026-05-14

怎么评估数据分析公司?甲方必看第三方归因核查标准

2026-05-12

CPC有效性验证怎么做?Xinstall底层指纹过滤无效请求

2026-05-11

Xinstall联调实录:android应用商店渠道归因对账指南

2026-05-09

数据可视化工具哪个好用?一键自动生成App渠道报表

2026-05-08

曝光度如何变真实转化?Xinstall量化品牌社交裂变归因

2026-05-07

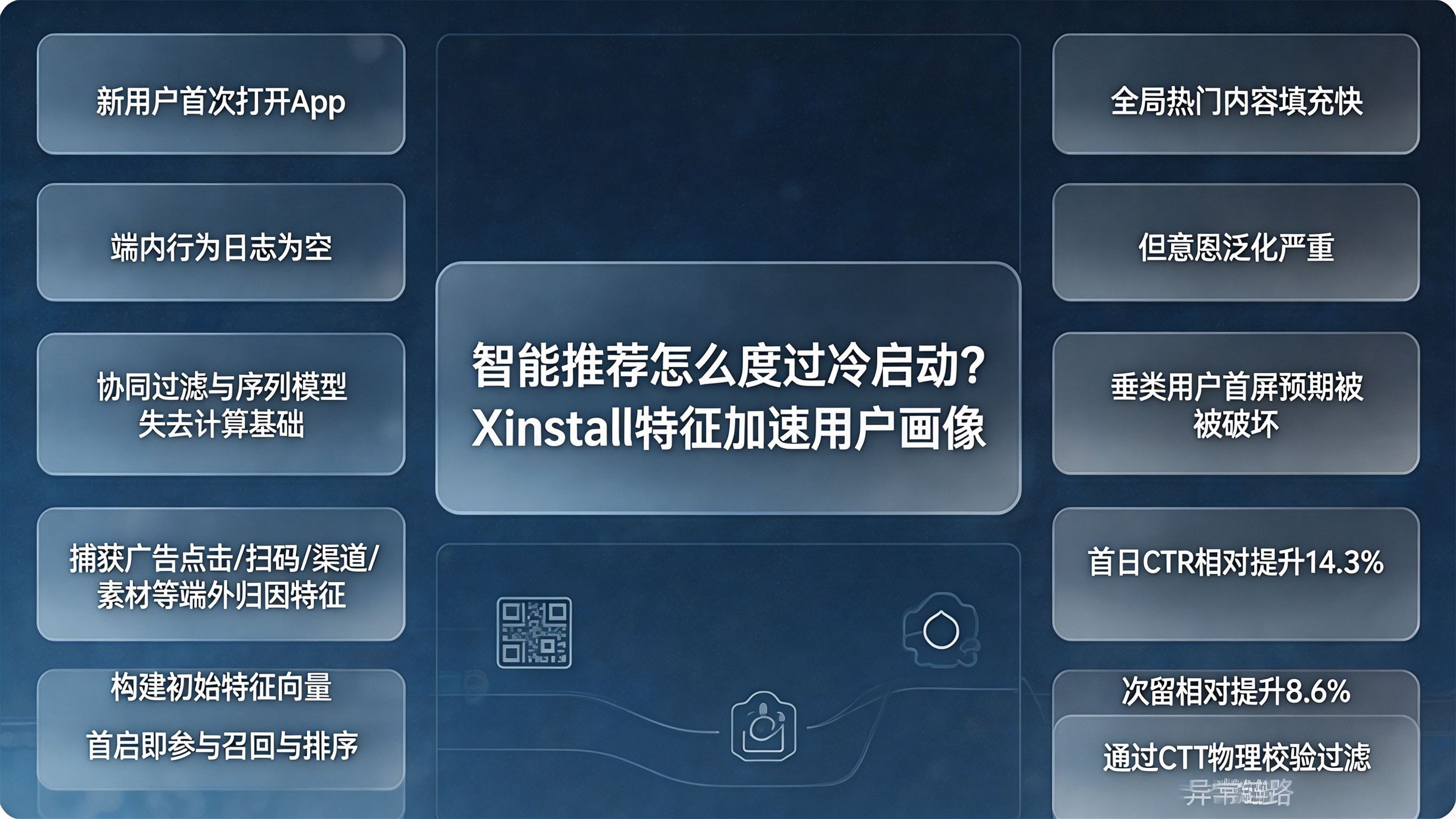

智能推荐怎么度过冷启动?Xinstall特征加速用户画像

2026-05-06

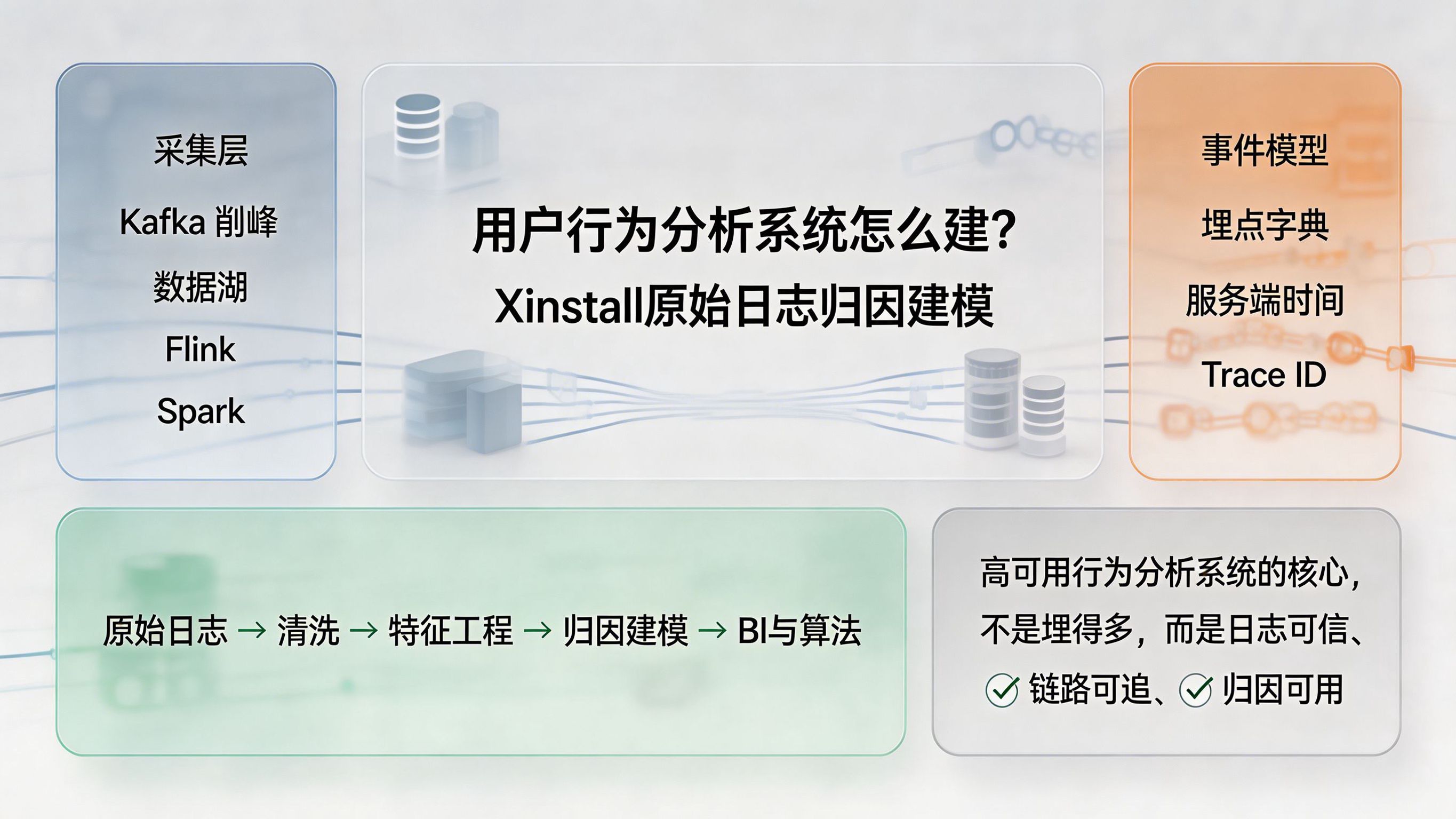

用户行为分析系统怎么建?Xinstall原始日志归因建模

2026-04-28

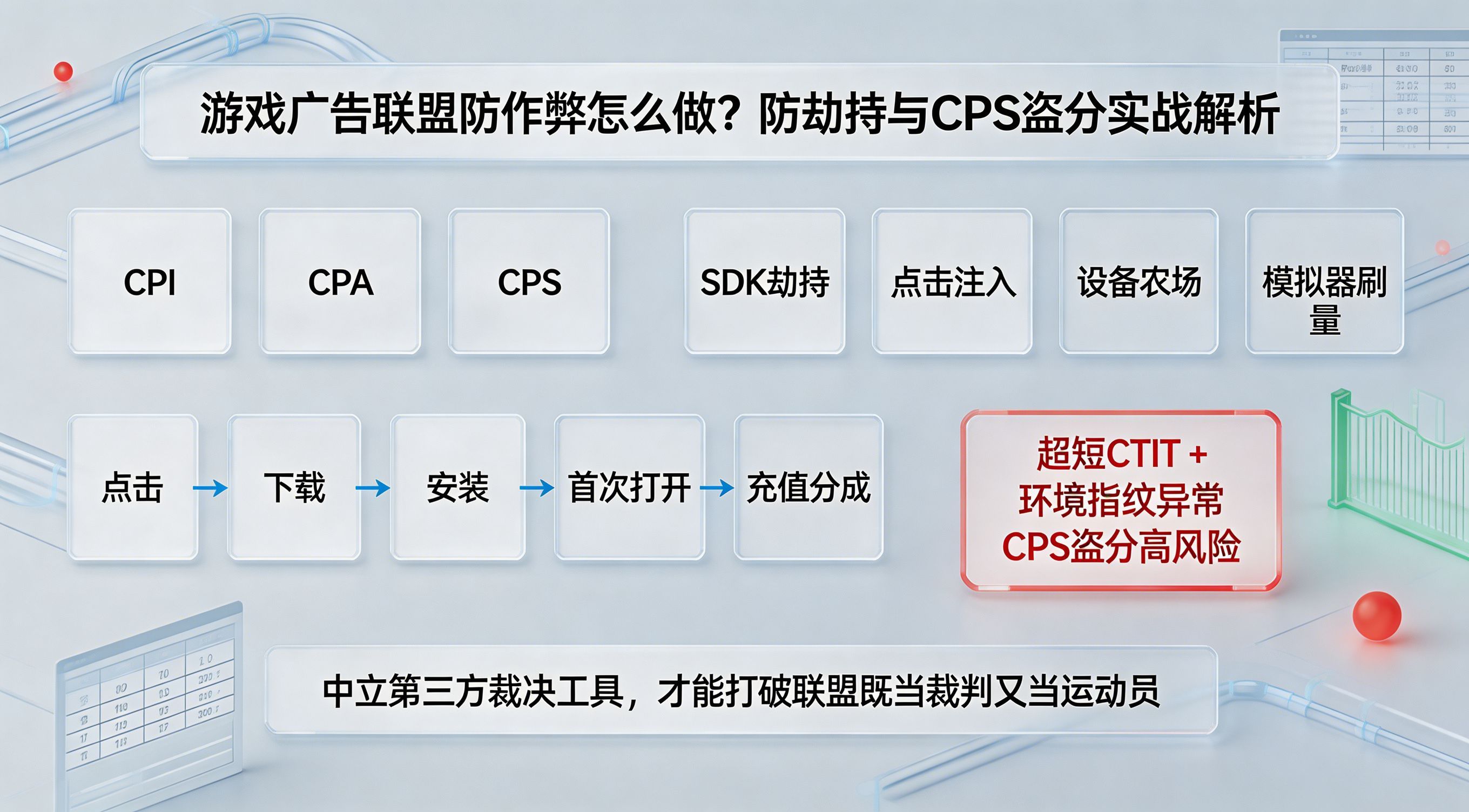

游戏广告联盟防作弊怎么做?防劫持与CPS盗分实战解析

2026-04-27

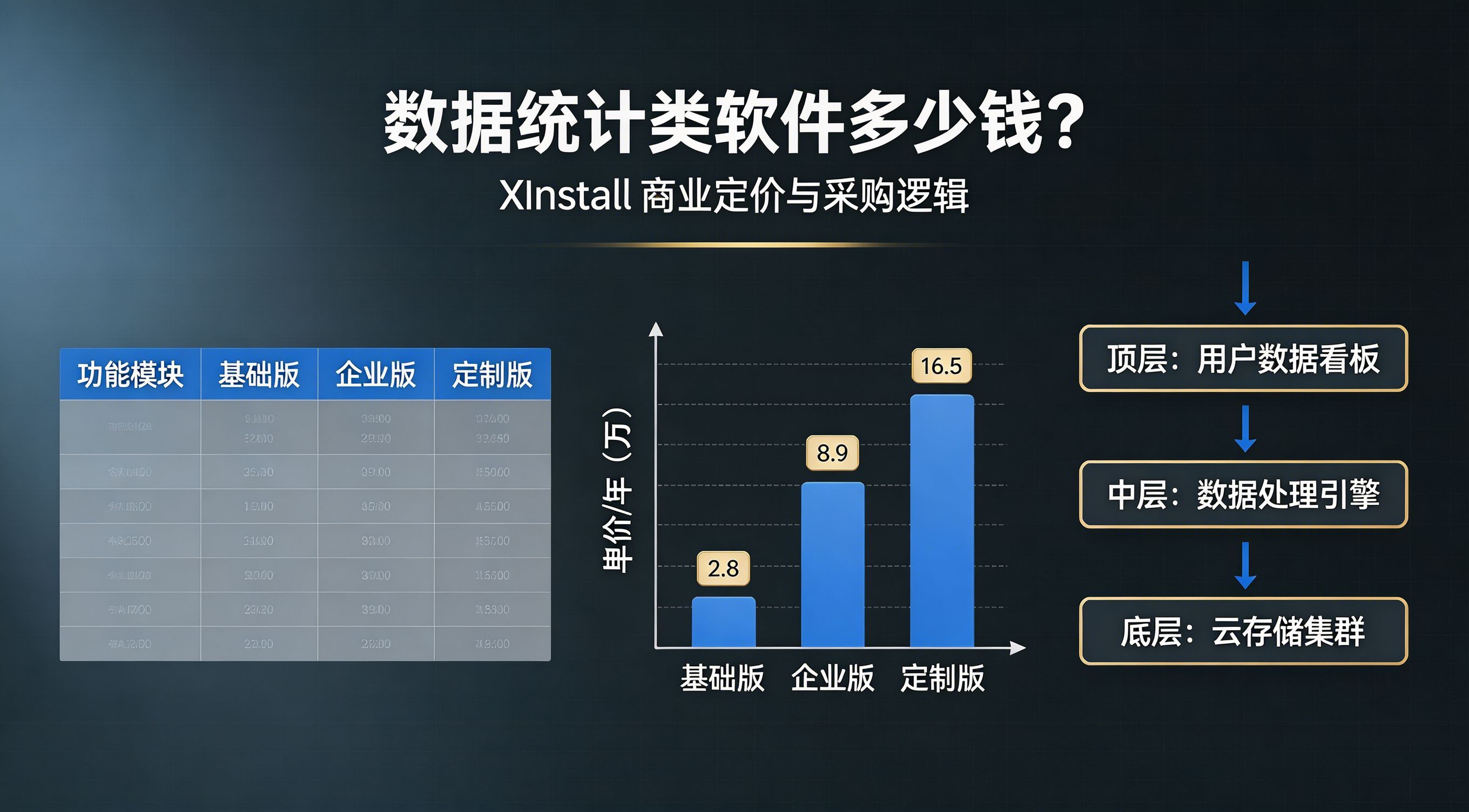

数据统计类软件多少钱?Xinstall商业定价与采购逻辑

2026-04-24