手机微信扫一扫联系客服

7

7AI Agent频繁陷入“演示惊艳、上线失灵”的反差,问题往往不在单点模型能力,而在真实任务链路中的容错、恢复与可观测性缺失。对开发者、产品和增长团队来说,这意味着从评测到上线的整套归因与交付方式,都需要从“平均表现”转向“最差时刻”重构。

2026年了,AI Agent为什么还是“Demo很惊艳,上线就翻车”?如果只把答案归结为“模型还不够强”,其实等于什么都没回答。真正的问题在于,Demo展示的是一个被精心清洗、被反复排练、被主动规避噪音的理想环境,而用户上线后遇到的,却是一个充满脏数据、长链路、模糊意图和偶发失败的真实世界。对开发者、产品经理和增长团队来说,这背后最值得重构的,不只是模型效果,而是整条【全链路归因】能力。

很多团队今天做 Agent,仍然习惯用“模型能力”解释一切:理解更强了、工具更多了、推理更长了、分数更高了。可用户不会因为你的评测集提分了 5 个点,就自动觉得产品变好用。用户只会记住一次离谱失败:把广告当正文、把导航栏当标题、把一步执行错扩散成整条任务链崩盘。Agent 真正的产品问题,不在“有没有能力”,而在“能不能在真实链路里稳定交付”。

原文最犀利的一点,是把 Demo 形容成“活在无菌环境里”。这不是夸张,而是几乎所有 Agent 演示的共同底色。演示中的网页通常是干净的结构化内容,用户 query 是标准表达,路径是预先踩通过的最佳流程,干扰变量被尽量排除,所以结果自然显得丝滑。[材料原文]

但真实用户不会这么配合。

真实输入可能有错别字、口语化、省略主语、意图跳跃;真实网页可能有弹窗、评论区、浮层、iframe、长图和混排;真实任务也不会只走“最优路线”。

这意味着,Demo 说服力越强,往往越可能掩盖一个事实:它展示的是“在最好条件下能做到什么”,而不是“在最差条件下还能不能交付”。

这也是为什么很多团队并不是故意造假,却仍然在上线后迅速翻车。

因为开发期接触最多的,就是那些被自己筛过、跑通了、效果不错的输入样本。

问题不在测试有没有做,而在测试分布和真实分布之间,天然隔着一层被低估的复杂性鸿沟。

原文指出的第二个核心矛盾,是“评测分数和用户体验不是一回事”。这个判断非常关键,因为它几乎击中了今天大多数 Agent 团队的共识误区。[材料原文]

评测分数看的是平均表现,但用户感知记住的往往是最差时刻。

一次任务里前面九步都还行,只要最后一步输出离谱,用户就不会觉得你“平均有 85 分”,而只会觉得“这玩意不靠谱”。

传统软件里,按钮失灵还能重试,页面卡顿还能刷新,但 Agent 的很多输出是一次性的:摘要错了就是错了,结论偏了就是偏了,信任崩了就很难靠下一次正常发挥补回来。

这决定了 Agent 的评测逻辑,不能简单沿用传统系统。

平均分当然重要,但它不足以描述“翻车成本”。

真正该盯紧的,是最差 case 到底差到什么程度、出错时有没有兜底、错误会不会沿链路放大,以及失败后用户还能不能被安全带回可接受状态。

如果这些问题没被纳入评测,再高的榜单成绩也可能只是一种局部乐观。

很多 Agent 团队现在最容易自我说服的一件事,是模型已经“理解用户意图”了,所以离产品成熟只差一点工程打磨。原文对此的拆解非常准确:理解和执行之间,隔着一整条会不断衰减成功率的链路。[材料原文]

比如用户说“帮我对比两篇文章的观点差异”,模型也许能理解这件事,但真正执行时,它还要完成读取、提取、归纳、比对、生成、呈现这几个连续动作。

如果每一步成功率看起来都有 90%,整条四步链路乘下来,成功率就会显著下滑。

这也是为什么单节点评测看起来都不错,但一到多步骤任务里,产品体验就会突然塌掉。

本质上,Agent 是链式系统,不是单点系统。

单点能力再强,也不代表整条任务流能稳定运行。

Demo 之所以惊艳,恰恰是因为它通常只展示短链路、单节点或低噪音路径;而真实用户触发的,往往恰好是长链路、高依赖、强耦合任务。

链越长,风险越高;节点越多,故障传播越快。

这就是“上线就翻车”最常见也最难被平均分揭示的结构性原因。

原文第四部分特别值得被反复引用:模型有能力做某件事,和用户能稳定获得这个能力,中间隔着一整道产品化鸿沟。[材料原文]

能力属于模型层,前提通常是输入足够好、环境足够可控、任务边界足够清晰。

产品力则属于工程和设计层,它要求系统在用户表达含糊、需求越界、执行中断、上下文污染甚至工具失灵时,仍然能给出可接受的输出或安全降级。

这里面最容易被忽视的三层补位,其实就是:

这三件事,本质上都不是“再训一个更强模型”就能自动解决的。

它们需要工程设计、策略系统、后处理规则、异常监测和交互设计一起补位。

很多团队今天把资源几乎全砸在模型和 Demo 上,却低估了产品化层的工作量,结果就是“发布很强,留存很弱”。

原文最后一点很妙,它提醒我们:很多所谓“翻车”,不只是能力问题,也是预期问题。[材料原文]

Demo 的传播方式,天然会把用户预期拉到极高。

用户看完演示,默认自己拿到的是“天花板表现”;但上线后的真实产品,只能提供“平均表现”甚至“受条件影响的波动表现”。

于是同样一个 70 分的输出,在没看过 Demo 的用户眼里可能是“还行”,在看过 Demo 的用户眼里就会变成“诈骗感”。

这并不意味着团队不该发 Demo。

在今天的竞争环境里,不发 Demo 很容易丢掉传播势能。

问题在于,大多数团队只认真做了“能力展示”,却没有认真做“边界说明”和“预期校准”。

用户不知道什么场景最适合、什么输入最稳定、什么任务最容易失误,自然会把最佳表现当成基准,把平均表现当成翻车。

长期来看,这比模型本身的不稳定更伤信任。

很多团队讨论 AI Agent 上线效果时,仍然习惯用传统增长问题来问:用户来了没有、激活了没有、留存了没有、转化了没有。

这些指标并不无用,但它们很难解释 Agent 为什么“看起来有人用,口碑却持续崩”。

因为 Agent 的问题,常常不是出在入口,而是出在任务链中间的隐性失真。

用户看到一个 Demo,被吸引进来,说明最前面的叙事没有问题。

但从用户输入一句模糊需求开始,到模型理解、调用工具、跨页面执行、恢复状态、整合结果、输出答案,这中间其实已经是一条典型的多节点任务链。

一旦某个节点掉链子,用户表面上只会感知为“这个 Agent 不行”,但团队后台如果没有更细的链路观测,就只能把问题粗暴归因到“模型不够强”或“用户不会用”。

这正是为什么 Agent 产品特别需要【全链路归因】。

你不能只看最终任务成功率,也不能只看模型单次输出质量,而要把整条路径拆开看:

如果这些节点不可见,团队就只能看到一个最终结果:任务失败。

但“失败”背后到底是输入问题、工具问题、环境问题、边界问题还是预期问题,就完全说不清。

而一旦说不清,后面的优化就会越来越像撞大运。

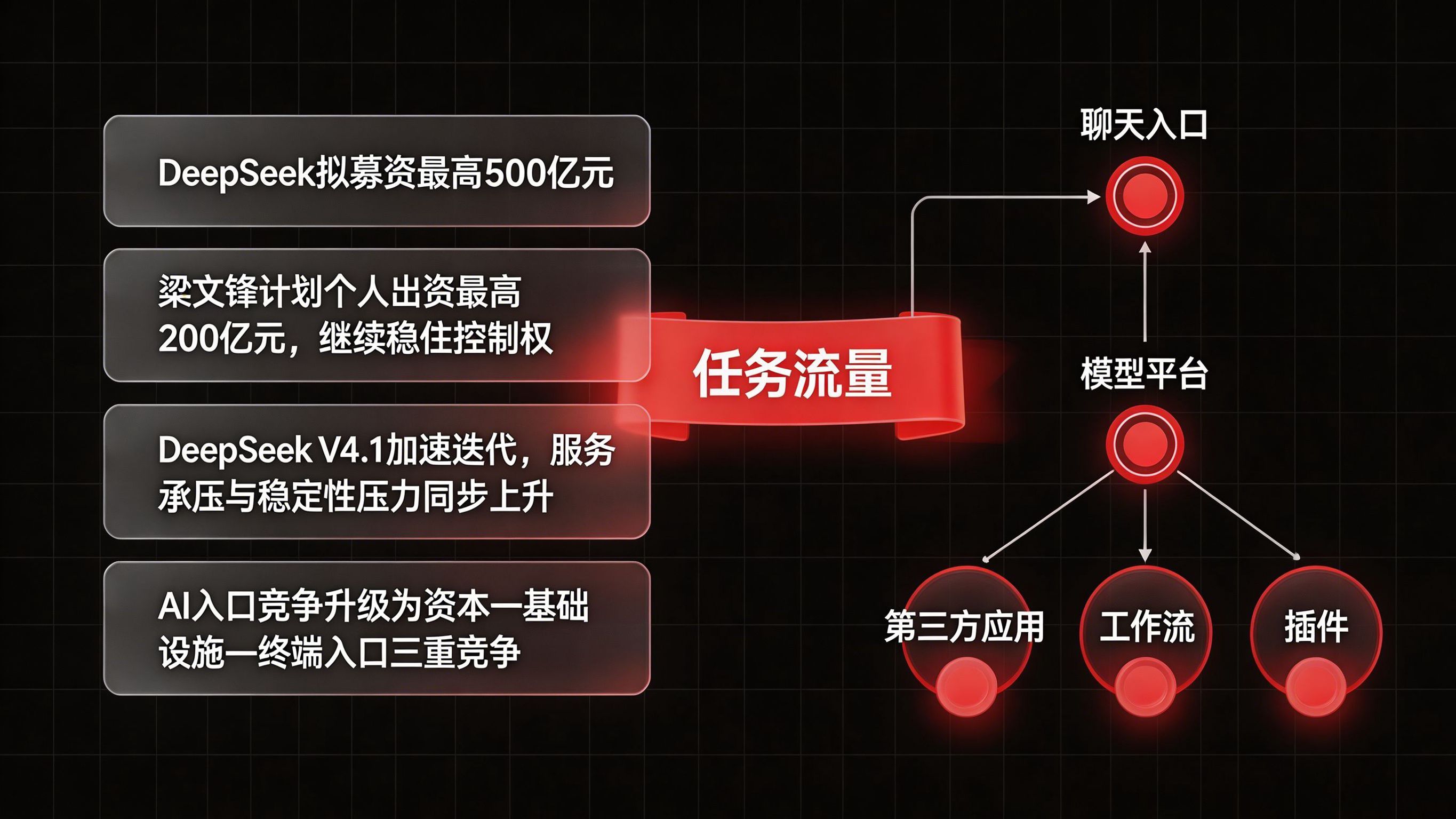

更进一步说,Agent 不是单纯的“人物流量产品”,而越来越像“任务流量产品”。

用户不是为了逛而来,而是带着明确任务来交付给系统。

所以真正该被归因和优化的,不只是“这个用户从哪来”,而是“这类任务为什么在这条链路里反复失败”。

如果还停留在旧漏斗里,Agent 产品就会长期误诊。

Agent 产品最常见的问题之一,是把所有流量都混成“自然使用”。

但现实里,用户可能来自 Demo 视频、内容种草、开发者社区、应用商店、官网、企业场景、插件入口,甚至其他 Agent 的分发。

这些入口带来的用户预期和任务类型完全不同,如果都被记成同一种来源,后续分析一定会失真。

更稳妥的做法,是先用 渠道编号 ChannelCode 把来源分开,并尽量把“入口”和“任务类型”一起编码。

例如可以预留这些字段:

这样做的意义在于,你不只知道“用户是从哪里来的”,还知道“他是带着什么任务来的、预期有多高、在哪个阶段最容易出错”。

对于 Demo 驱动型 Agent 产品,这一步尤其重要,因为传播入口本身就决定了后续的用户容忍度和失败阈值。

第二步,是上下文不能断。

很多 Agent 产品的问题,不在于单点输出,而在于一进入真实任务流,上下文就开始丢失。

用户输入的原始意图、前一步解析结果、工具执行状态、失败原因、页面环境、重试历史,如果无法一路带到后续节点,系统就会越来越像“每一步都在重新猜”。

这时,智能传参安装 的价值,并不只是安装时多带参数,而是帮助团队保留任务语境,让一次进入、一次唤起、一次执行、一次失败都能挂在同一条任务线上。

在设计上,可以参考 xinstall 站内《智能体分发时代 App 安装传参逻辑的底层重构》里那种“入口携参—安装承接—首启恢复—事件还原”的思路,把上下文从最前面的入口一路延伸到关键执行节点。

对 Agent 来说,这一步尤其关键。

因为没有上下文,失败只是一次孤立事故;有了上下文,失败才会变成可分析、可复现、可修复的工程对象。

第三步,是要彻底告别只看平均分的评测习惯。

如果 Agent 的本质问题发生在链路里,那么评测体系也必须围绕链路重建。

更可行的方法,是搭一张任务事件图。

例如先定义这样一组事件:

有了这张事件图,团队才能真正回答原文里提出的那些关键问题:

到底是最差 case 太差,还是链路太长;到底是输入容错不够,还是失败恢复缺失;到底是理解没问题但执行崩了,还是预期拉太高导致平均表现也被判成翻车。

注:本文讨论的多步骤任务链、Agent 工作流失败恢复、上下文携带与跨节点状态还原,属于面向未来智能体产品化的工程设计思路。像复杂工具编排、跨系统状态同步、模型与规则系统协同兜底等场景,往往需要结合具体业务架构进行专项设计,并不等同于统一标准化现成功能。

如果你是研发负责人,今天最应该追问的,不是“模型榜单还能提升多少”,而是“我们能不能定位最差 case 到底坏在哪”。

Agent 真正的工程价值,不是把最佳表现再抬高一点,而是把最差时刻往上托住。

建议优先补齐这些字段和观测点:

谁先把这些字段体系建起来,谁就更有机会把“翻车”从主观吐槽变成可修复问题。

如果你是产品或增长负责人,要最先放弃的一种幻觉,就是“Demo 火了,上线自然会转化”。

在 Agent 产品里,传播和留存之间隔着产品化,不隔着营销。

你需要重新定义增长的关键节点:

现在就可以做三件事:

数据团队在 Agent 时代最容易犯的错,是继续用传统软件那套“平均成功率”来定义健康度。

但 Agent 用户记住的不是平均数,而是崩溃时刻。

如果不把异常链路、恢复链路和放弃链路单独抽出来看,很多问题会一直被漂亮的平均值掩盖。

因为 Demo 通常运行在更干净、更可控、更短链路的环境里,输入、页面和任务路径都经过精心挑选或反复验证。

它展示的是理想条件下的最佳表现,而不是复杂真实世界中的稳定交付能力。

因为评测更偏向平均表现,而用户体验更受最差时刻影响。

Agent 只要有一次离谱失败,就可能让前面多次正确输出积累的信任快速归零。

因为理解只是第一步,真正的产品交付依赖整条执行链路。

一旦读取、提取、调用工具、生成结果等任一节点失误,前面正确的理解也很难转化成稳定体验。

关系在于,未来越来越多产品都会被任务流量和 Agent 入口重写。

如果今天不把任务链路、上下文参数和失败恢复纳入系统设计,明天很多“上线就翻车”的问题就会在你的业务里重复出现,而【全链路归因】恰恰是最早该补上的底层能力。

2026年了,AI Agent为什么还是“Demo很惊艳,上线就翻车”?这不是某一个产品做差了,而是整个行业都在从“模型能做什么”转向“产品怎么稳定交付”的必经阶段。

过去两年,大家证明了 Agent 可以看起来很强;接下来两年,真正决定胜负的,会是链路稳定性、失败恢复能力、边界管理和真实场景下的长期信任。

对 App、SaaS 与 B 端团队来说,现在恰恰是重新搭建数据和任务体系的窗口期。

因为未来用户不只是在使用一个功能,而是在把完整任务交给系统代执行。

谁能先把任务源、上下文、失败节点和恢复路径都纳入同一套观测框架,谁就更有机会把“惊艳 Demo”真正变成不再轻易翻车的【全链路归因】产品能力。

上一篇

上一篇

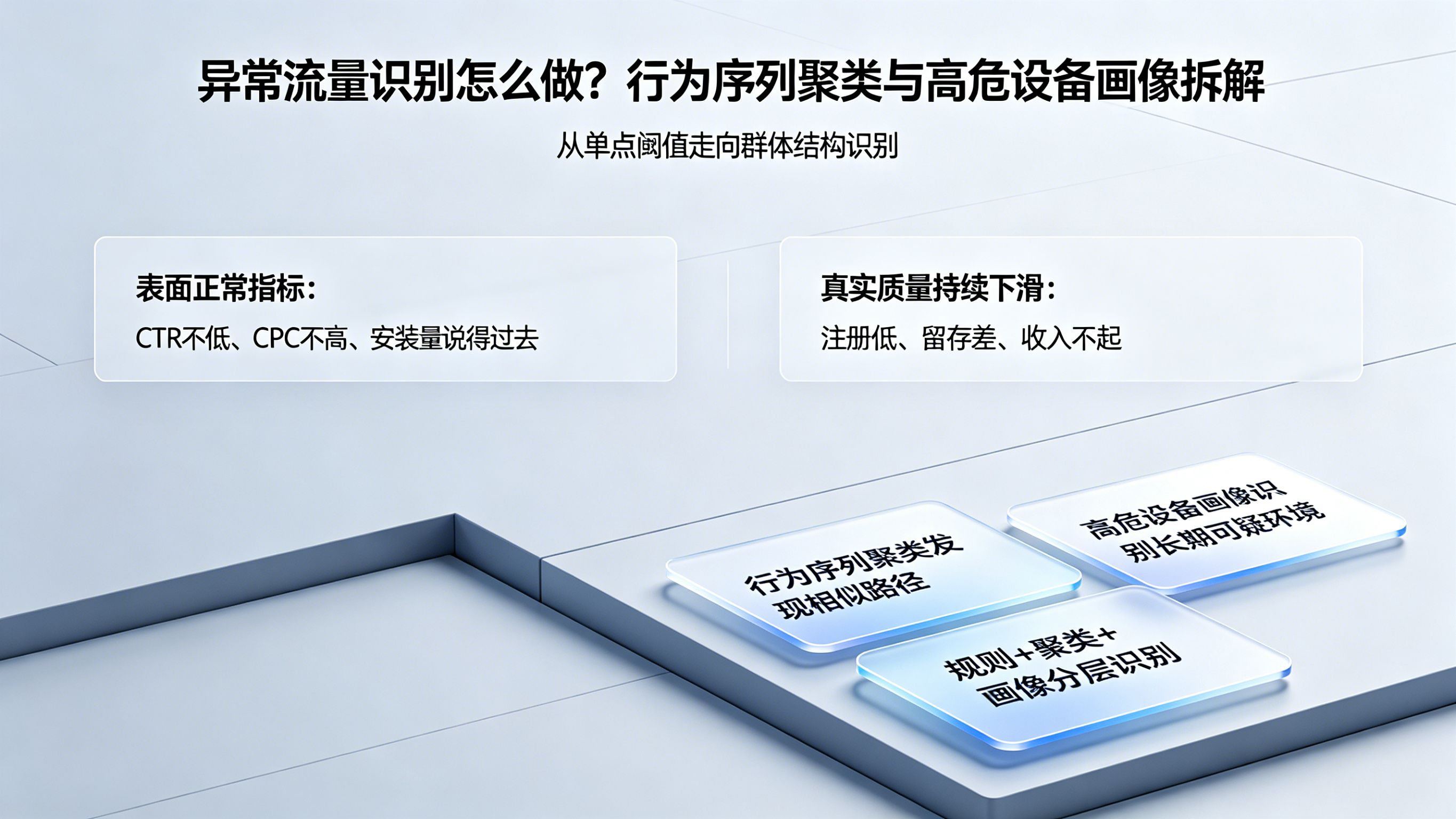

异常流量识别怎么做?行为序列聚类与高危设备画像拆解

2026-05-11

广告数据验证怎么做?流量真实性独立核查与物理时长对账

2026-05-11

2026年了,AI Agent为什么还是“Demo很惊艳,上线就翻车”:任务链路仍在失真吗?

2026-05-11

千问与淘宝打通,正式上线AI购物?消费入口前移

2026-05-11

豆包开启付费模式?免费叙事松动:生态洗牌加速

2026-05-11

Xinstall联调实录:android应用商店渠道归因对账指南

2026-05-09

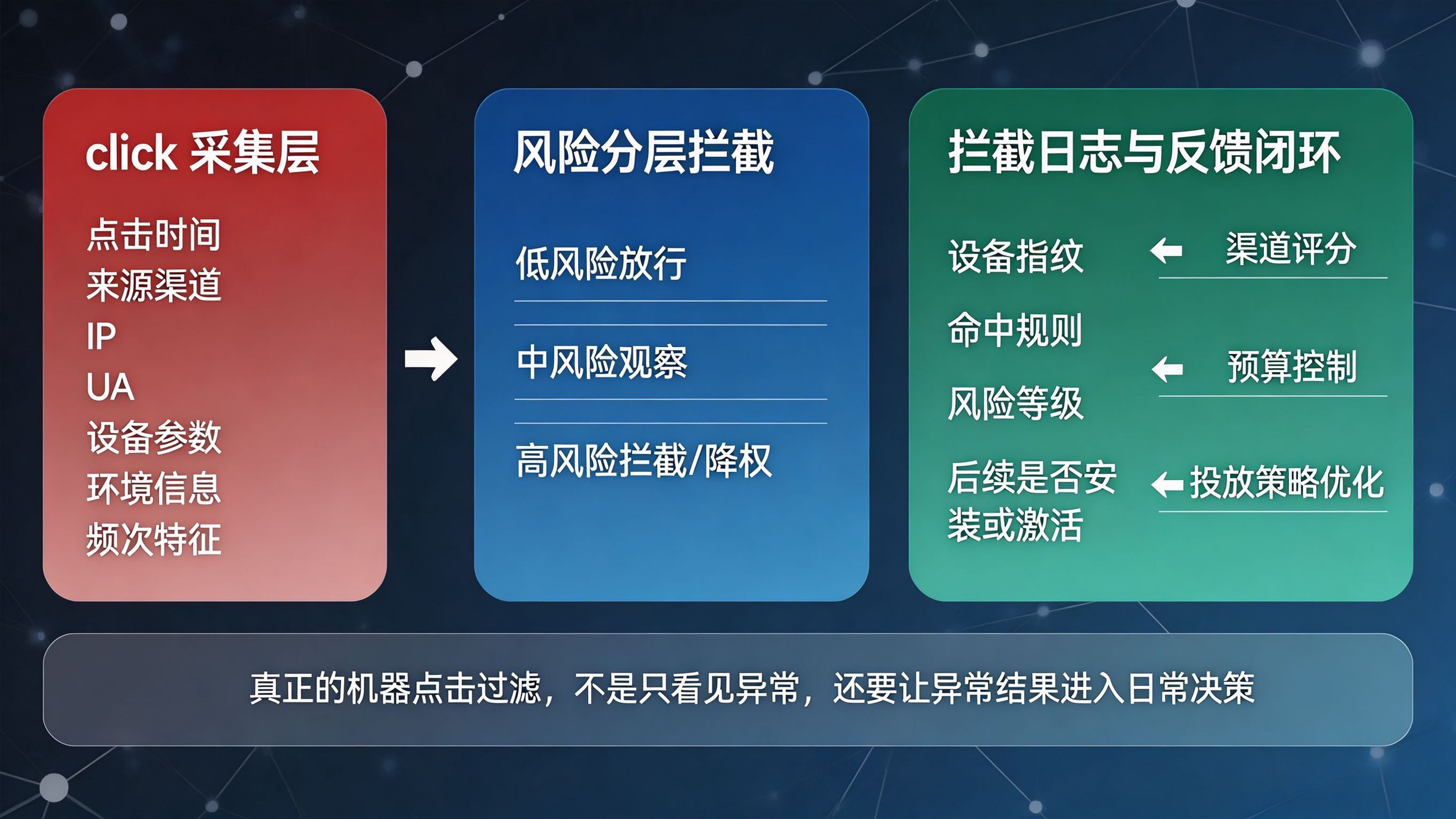

机器点击过滤如何实现?风控引擎拦截黑产刷量与物理校验

2026-05-09

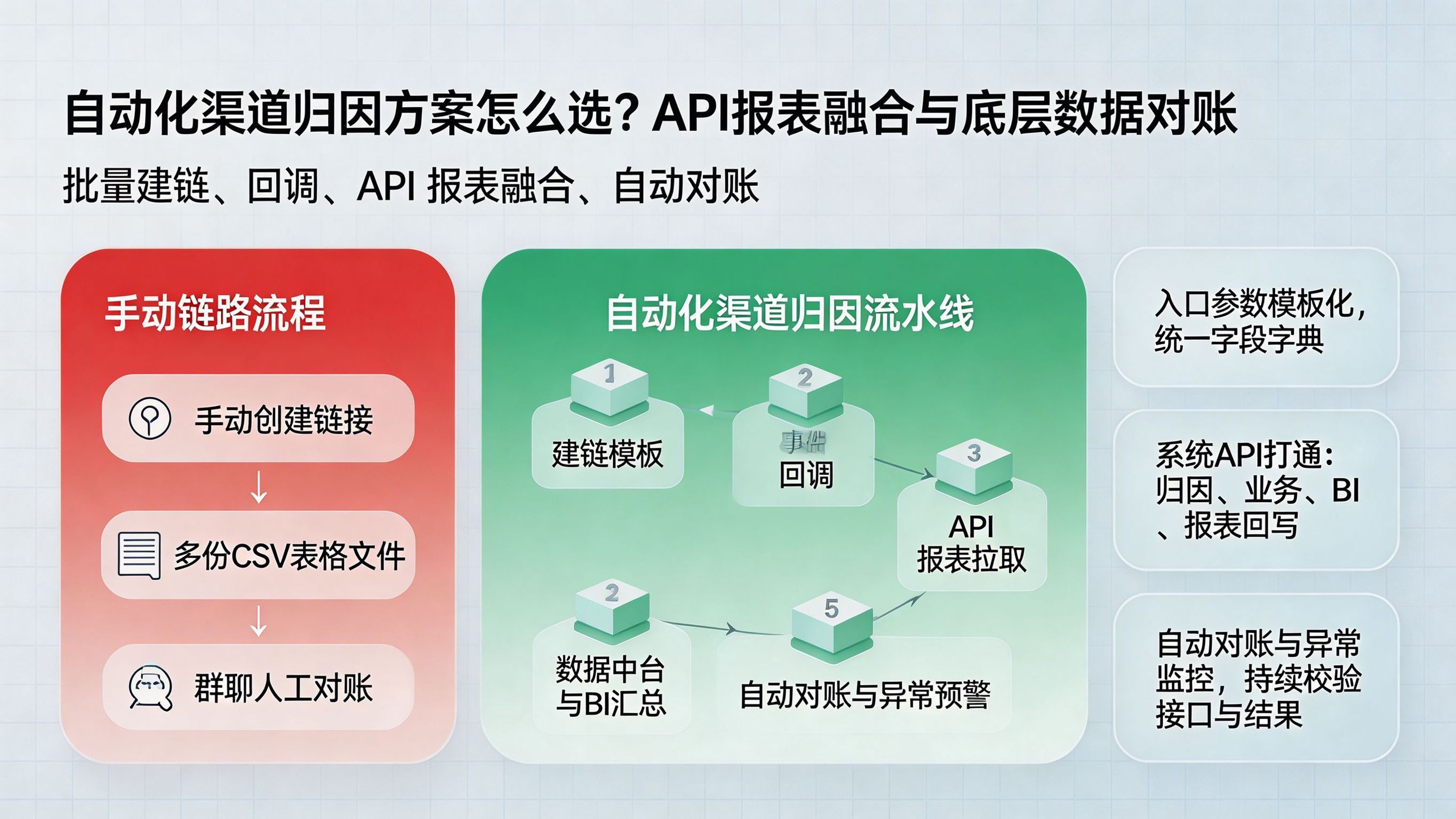

自动化渠道归因方案怎么选?API报表融合与底层数据对账

2026-05-09

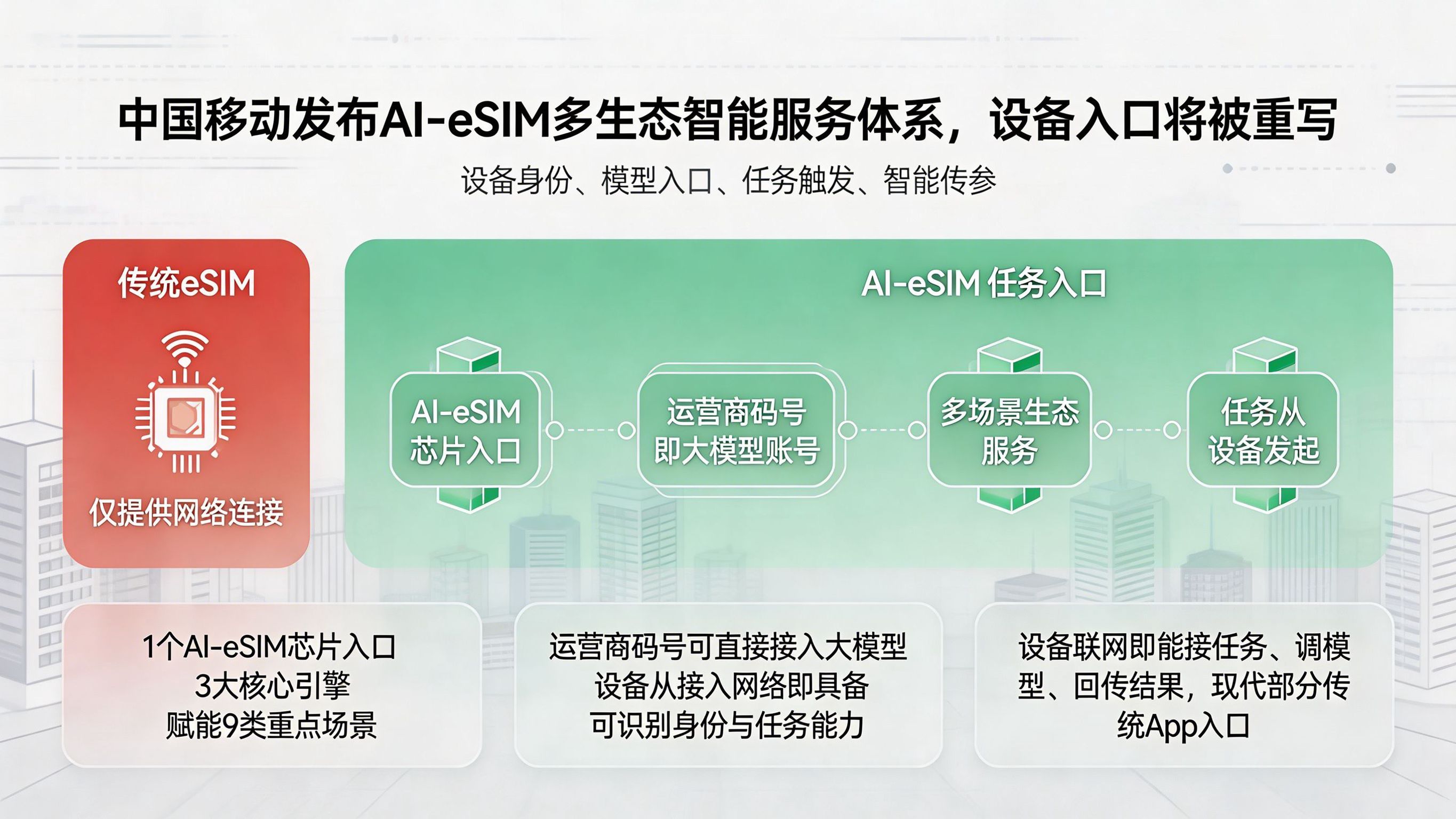

中国移动发布AI-eSIM多生态智能服务体系?Token入口升温,终端生态面临重排。

2026-05-09

终端入口:英特尔与苹果据悉达成初步协议,设备分发格局会变吗?

2026-05-09

DeepSeek拟募资最高500亿,资本狂潮加速:AI入口竞争怎么变?

2026-05-09

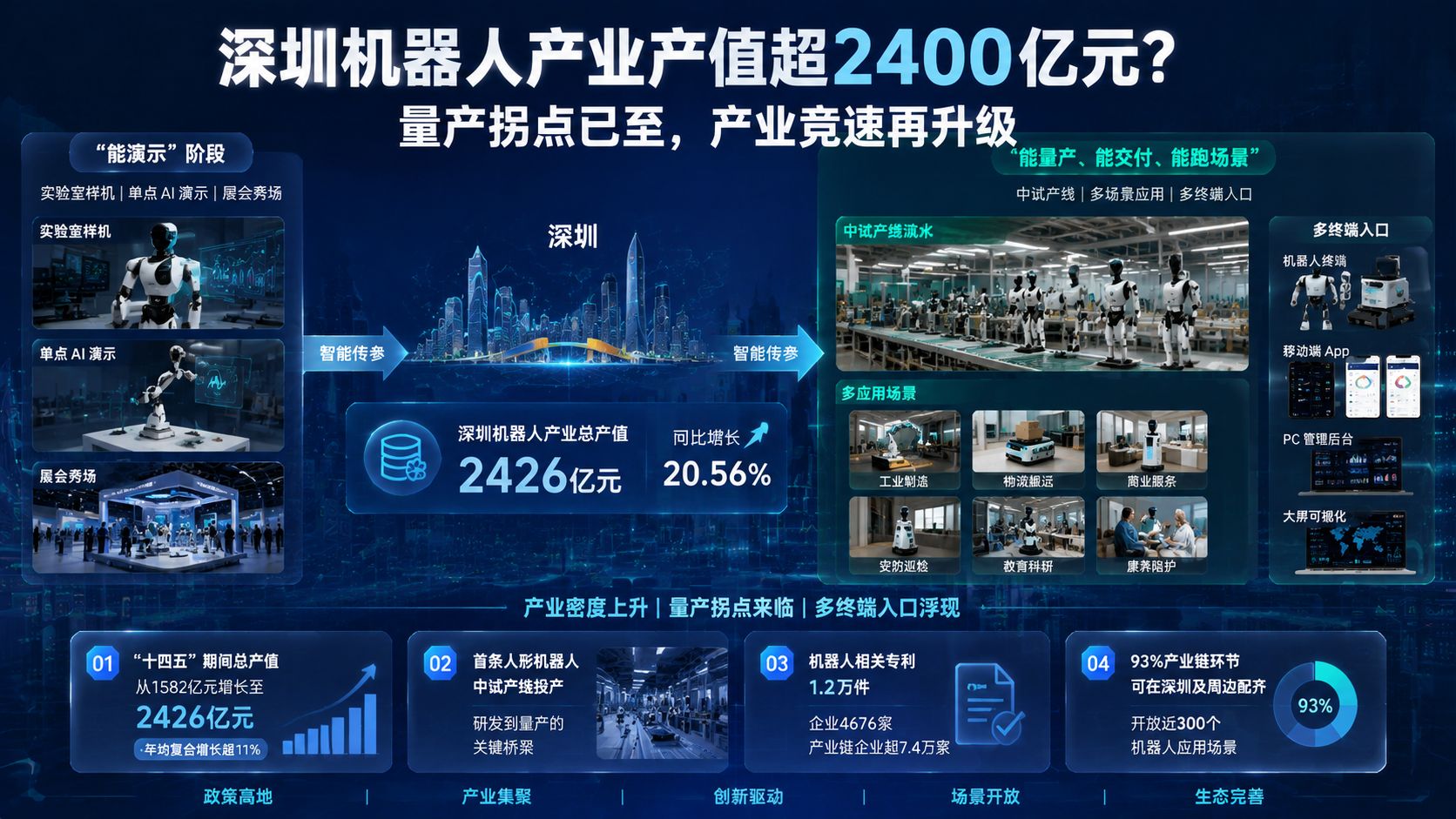

深圳机器人产业产值超2400亿元?量产拐点已至,产业竞速再升级

2026-05-08

数据可视化工具哪个好用?一键自动生成App渠道报表

2026-05-08

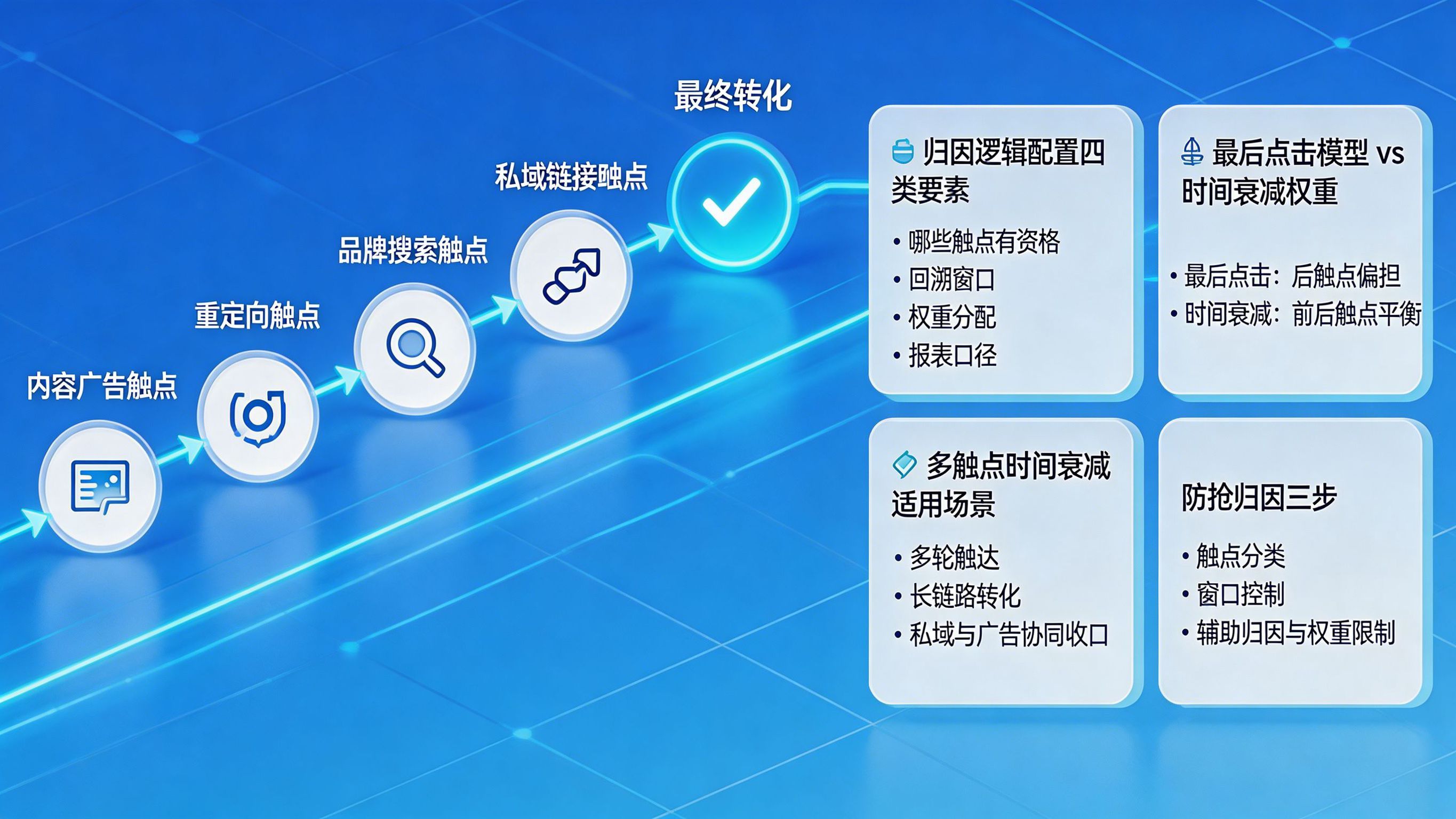

归因逻辑配置怎么做?多触点时间衰减权重与防抢归因实战

2026-05-08

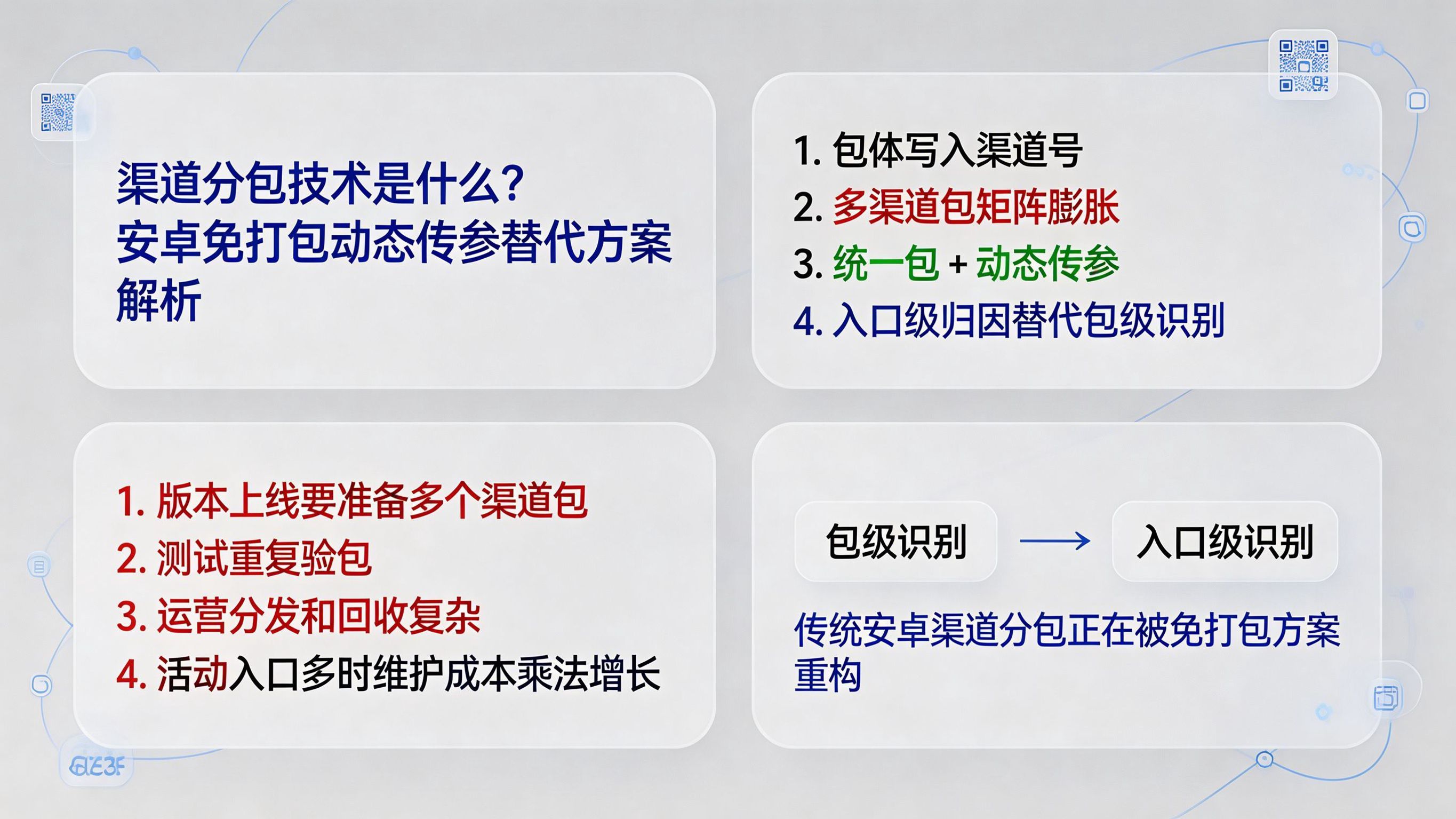

渠道分包技术是什么?安卓免打包动态传参替代方案解析

2026-05-08