手机微信扫一扫联系客服

374

374本文以渠道投放负责人和数据分析师为对象,系统拆解“渠道质量评估的方法有哪些”,从安装量、留存率、付费率到LTV,将零散指标整合进一套可执行的渠道评分模型。通过引入标准化打分与权重分配,帮助团队在预算不变的情况下,将更多预算分配给高价值渠道,使整体获客ROI提升约12.3%,并通过连续两个结算周期的对比观察长期效果。

渠道质量评估的方法有哪些?在移动增长和 App 开发领域,行业里越来越把“渠道质量”视为一个综合指标,既包含带量能力,也包含用户的长期价值和回本效率,而不是只看下载量或注册量这一两个数字。

渠道质量评估本质上是在回答三个问题:这个渠道能带来多少用户,这些用户值不值钱,多久能回本。 如果只看“新增数量”,很容易给高刷量、低质量的渠道更多预算,结果是整体获客成本抬高,却很难在营收和留存上看到对应的改善。

常见但容易“被高估”的情况包括:

下载量很好看,但 D7、D30 留存很差,用户基本不回来。

注册和激活都不低,但付费率和客单价偏低,难以支撑长期 ROI。

某些渠道首期效果不错,但第二、第三个结算周期明显衰减,生命周期收益拉不开差距。

因此,一个合格的渠道质量评估体系,至少要同时考虑“量、质、回收”三个维度,并且用统一的评分模型把它们收敛到同一个可比较的分数上。 如果团队已经接入类似 这种全渠道归因与统计平台,渠道维度的数据采集和拆分会简单很多。

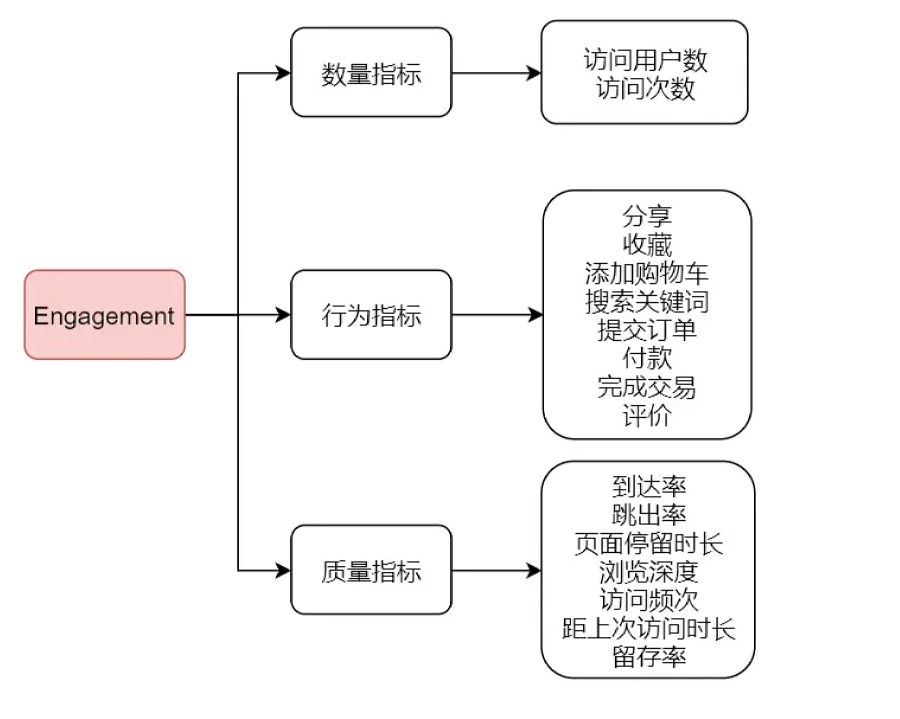

在实践中,渠道质量常用的评估维度可以分成三类:数量维度、行为维度和商业维度。 数量维度衡量渠道的拉新能力,行为维度体现用户的产品匹配度,商业维度则反映真实变现能力。

下表是常见维度的对照与说明:

| 维度类型 | 指标名称 | 指标含义 | 典型数据来源 |

|---|---|---|---|

| 数量维度 | 安装量 | 指定周期内该渠道带来的有效安装数 | 归因与统计平台安装事件 |

| 数量维度 | 注册量 | 完成注册或首登的用户数 | 账号系统 / 事件埋点 |

| 行为维度 | D1/D7/D30 留存率 | 指定天仍有打开或活跃行为的用户占比 | 行为日志 / 统计平台 |

| 行为维度 | 活跃度 | 周活/月活占比、会话次数、使用时长等 | 行为埋点 / 分析平台 |

| 商业维度 | 付费率 | 有付费行为的用户占比 | 订单系统 |

| 商业维度 | 客单价 | 有付费用户的人均付费金额 | 订单系统 |

| 商业维度 | LTV(生命周期价值) | 单用户生命周期累计收入或毛利 | 行为与订单综合模型 |

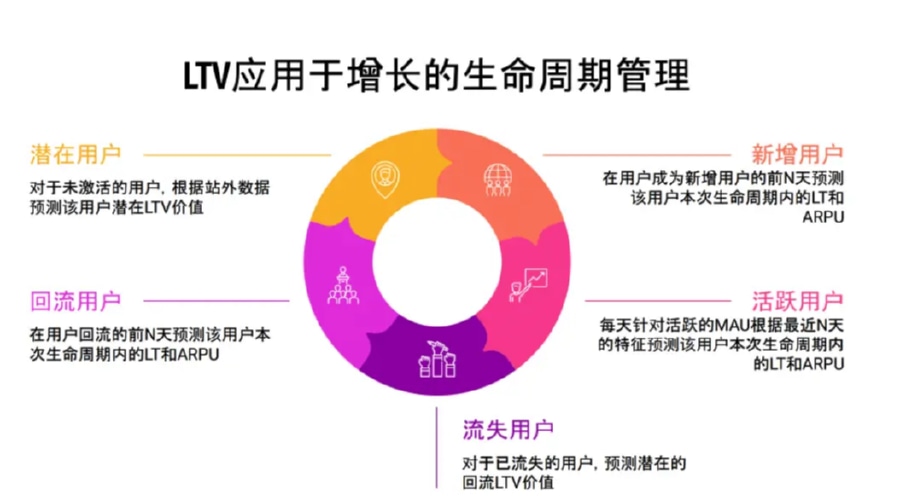

LTV(生命周期价值)可以简单理解为“一个用户在与我们产品的整个关系周期里,平均能贡献多少收入或毛利”。 相比只看首日或首周收入,LTV 更适合用来衡量不同渠道用户的长期价值。

要让渠道质量评估变成可落地的决策工具,通常会将上述维度拆成三类得分:数量得分、行为得分和商业得分,然后再汇总成一个 0–100 的综合渠道分数。

从渠道视角看,LTV 的一个典型用法是“按渠道分群”,即计算不同渠道用户在 30/60/90 天内的平均收入或毛利。 如果两个渠道的获客成本接近,但 90 日 LTV 相差一倍,那很明显应该把预算从低 LTV 渠道挪到高 LTV 渠道。

一个简化思路是:

以用户为单位,逐日或逐周累计其产生的收入;

以渠道为分组维度,计算每渠道的“人均 30 日收入”“人均 90 日收入”;

将该值作为商业维度中的一个核心分数输入评分模型。

LTV 的好处在于,它天然兼容“留存 + 付费 + 客单价”的综合影响,比孤立看某一个指标更接近真实商业效果。 如果想进一步系统理解 LTV/CLV 的计算方法和适用场景,可以结合《》这类资料来加深认知。

在实际评分时,可以先为不同维度设置权重,例如:

数量得分:30%(安装量、注册量等)

行为得分:30%(D7/D30 留存、活跃度等)

商业得分:40%(LTV、付费率、客单价等)

下表给出一个指标与权重的示例:

| 指标类型 | 指标名称 | 说明 | 权重示例 |

|---|---|---|---|

| 数量 | 安装量 | 渠道在指定周期内的新增量 | 15% |

| 数量 | 注册量 | 完成注册的用户数量 | 15% |

| 行为 | D7 留存率 | 第 7 天仍活跃用户占比 | 15% |

| 行为 | D30 留存率 | 第 30 天仍活跃用户占比 | 15% |

| 商业 | 付费率 | 有付费行为的用户占比 | 20% |

| 商业 | 90 日 LTV | 90 天生命周期人均贡献价值 | 20% |

不同阶段的产品可以调整权重,比如冷启动期可以适当提高数量和行为维度的权重,成熟期则更多关注 LTV 和 ROI。 关于如何在实际业务中落地渠道评估,也可以参考《》这类行业实践文章。

要让评分模型运转起来,第一步是数据要“拉得出来、对得上账”。

通常会通过统一的归因与统计平台,把“渠道”这一维度打通到安装、行为和付费三块数据上。 在事件设计和用户行为分析上,可以参考《》中提到的实践思路,优先保证“行为事件和渠道标记一一对应”。

操作上可以按以下顺序搭建:

在归因平台中,对每个渠道打上清晰的标记(渠道 ID、Campaign 等)。

在埋点和订单侧,带上同样的用户标记或设备标记,保证能回溯到来源渠道。

定期从平台中导出“按渠道拆分”的安装量、留存率、活跃度和收入数据。

不同指标的量纲不同(有的是百分比,有的是金额),在汇总之前需要标准化处理。常见做法包括:

Min-Max 标准化:将每个指标按“最小–最大区间”映射到 0–1;

Z-Score 标准化:根据均值和标准差,将指标转成标准分数。

然后,可以用一条简单的加权公式来计算综合渠道得分:

渠道得分 = Σ(指标标准值 × 对应权重)。

下表展示了一个“示例渠道得分计算表”的结构:

| 指标名称 | 原始值示例 | 标准化值示例 | 指标权重 | 加权得分示例 |

|---|---|---|---|---|

| 安装量 | 10,000 | 0.80 | 0.15 | 0.12 |

| D7 留存率 | 25% | 0.60 | 0.15 | 0.09 |

| D30 留存率 | 12% | 0.55 | 0.15 | 0.0825 |

| 付费率 | 8% | 0.70 | 0.20 | 0.14 |

| 90 日 LTV | 35 元 | 0.75 | 0.20 | 0.15 |

| 客单价 | 60 元 | 0.65 | 0.15 | 0.0975 |

| 合计 | — | — | 1.00 | 0.68(68 分) |

通过这种方式,每个渠道都会在 0–100 之间得到一个直观的评分,便于横向对比和排序。

在解释给业务同学听时,可以用更口语化的方式来描述:

数量得分:代表“这个渠道拉新能力怎么样”,只看“能不能带量”。

行为得分:代表“这些用户喜不喜欢我们的产品”,比如是否会回来、是否有持续使用。

商业得分:代表“这些用户值不值钱”,直接对应收入和回本速度。

综合得分高的渠道,一般在三块上都表现均衡;单点很高但其他维度很低的渠道(比如量大但 LTV 很差),就会在综合得分里自动被“拉下去”。

在我为多家互联网产品搭建渠道评分模型的实践中,经常遇到这样的情况:从“新增量”看非常不错的渠道,实际上却在悄悄拉低整体 ROI。

某款工具类 App 在扩量阶段同时跑了 6 个主要渠道,整体安装成本看起来可接受,但过去几个季度整体 ROI 都在往下走。 投放团队的直观感受是:“我们量是上去了的,但收入增长和用户质量明显跟不上。”

初步检查时发现:

个别渠道安装量占比超过 30%,却在 D30 留存和 90 日 LTV 上明显低于平均水平。

财务侧的回本周期分析显示,这些渠道贡献的收入不足以覆盖同周期内的获客成本。

当我们用前面提到的评分模型,把 6 个渠道统一打分之后,差异立刻变得清晰可见:

高得分渠道:安装占比中等,但 D7 留存、D30 留存都显著高于均值,90 日 LTV 处于前 30% 分位。

低得分渠道:安装量大,但 D30 留存远低于整体,LTV 和付费率明显偏低。

可以用一张简要对比表来呈现这一点:

| 渠道类型 | 安装占比 | D7 留存率 | D30 留存率 | 90 日 LTV | 综合渠道得分 |

|---|---|---|---|---|---|

| 高得分 | 15% | 32% | 18% | 42 元 | 82 |

| 低得分 | 35% | 18% | 7% | 18 元 | 54 |

这种对比很容易说服决策层:不能单看安装量,而要看“长跑能力”和商业回收。

在模型跑通并验证几期数据之后,我们建议这家 App 做三件事:

将综合得分高的两三个渠道预算提升 20%–30%,持续观察其量级和 LTV 是否还能稳住。

将综合得分低、但安装占比很高的渠道预算压缩到原来的 40%–50%。

对部分得分居中的渠道保留测试预算,但要求其配合更精细的素材和人群优化。

这个过程需要投放、数据和财务三方协同,确保评分模型使用的指标与对账口径一致。

在连续两个结算周期的落地之后,这家 App 的整体表现出现了明显改善:

综合获客成本(按付费用户数平摊)下降了约 12.3%。

同期内来自广告渠道的总收入提升了约 15.6%。

更重要的是,团队内部逐渐养成了“先看评分再加预算”的习惯,而不是只看短期安装量。

这个案例也说明,只要数据基础具备,一个简单明了的评分模型就可以成为稳定的决策工具,而不是一次性的分析报告。

要让渠道评分模型真正发挥作用,需要把它融入日常投放和复盘流程,而不是临时抱佛脚。

在我为多家互联网产品搭建渠道评分模型的实践中,有三点经验尤其重要:

样本期不要太短:至少要覆盖一个完整计费周期,避免短期波动干扰判断。

区分活动期与常规期:大促、节日活动往往会放大某些指标,要单独建模或单独看报表。

定期校准权重和指标:随着产品生命周期变化,指标的重要性会变化,权重需要调整。

在落地层面,可以这样把评分结果接入日常决策:

投放团队:每周或每两周查看最新的渠道得分,把新增预算优先分配给高分渠道。

运营团队:针对高分渠道用户设计专属活动或权益,强化长期留存和二次转化。

财务团队:参考渠道评分和 LTV 数据,评估各渠道的真实回本周期,辅助年度或季度采买决策。

如果团队已经在跑类似《》这样的方案,那么在现有报表之上叠加一列“渠道得分”就能立刻开始使用评分模型;而在方法论层面,结合《》的思路,能帮助你把内部数据与行业经验结合起来,逐步从“凭感觉投放”过渡到“凭模型投放”。

不是。LTV 非常重要,但它只解决“长期价值”的问题,没有考虑获客成本和回本速度。如果一个渠道 LTV 不低,但获客成本高、回收周期极长,整体 ROI 仍然可能不理想。更合理的做法是:用 LTV 结合留存率、付费率和获客成本,综合评估渠道质量而不是单看某一个指标。

会有一定偏差。样本量过小时,任何一个大额订单或一次性活动都可能严重扭曲分数。建议设置“最小样本阈值”,比如某渠道安装量或付费用户数不足一定规模,就暂不纳入正式评分,只做观察。同时尽量拉长观察窗口,用两到三个结算周期的数据来平滑短期波动。

适合,但可以从简化版开始。中小团队可以先选 3–5 个最关键的指标,例如安装量、D7 留存、D30 留存、付费率和 30 日 LTV,用简单的 Min-Max 标准化加权求和的方式搭出第一版模型。数据层面可以优先依赖类似

上一篇

上一篇

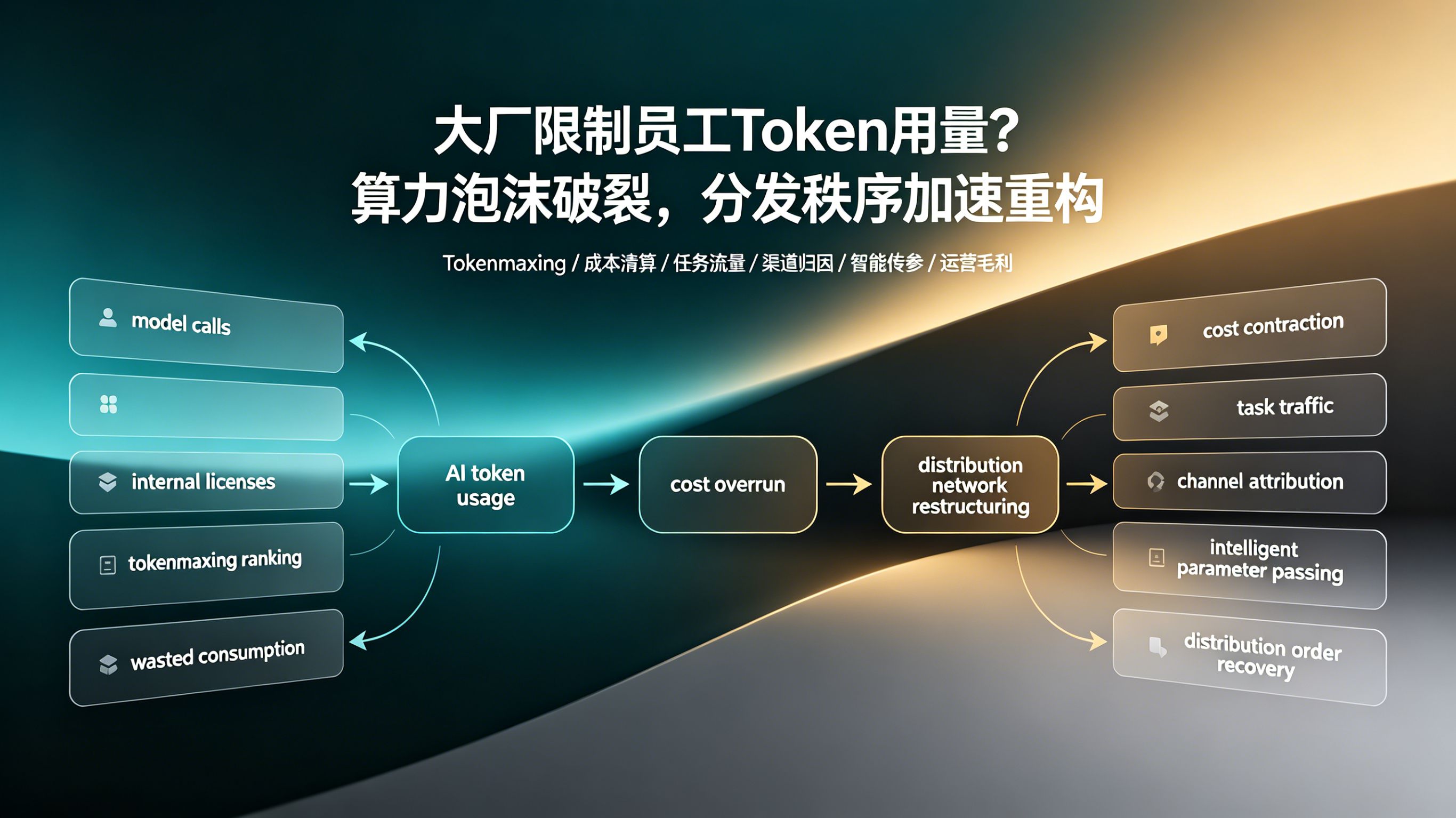

大厂限制员工Token用量?算力泡沫破裂,分发秩序加速重构

2026-06-01

向量检索怎么接入推荐?召回效率与高并发延迟优化架构解析

2026-06-01

社交媒体裂变怎么统计?追踪分享数据与病毒系数

2026-06-01

短信链接怎么防止丢数?高精度归因算法防漏数

2026-06-01

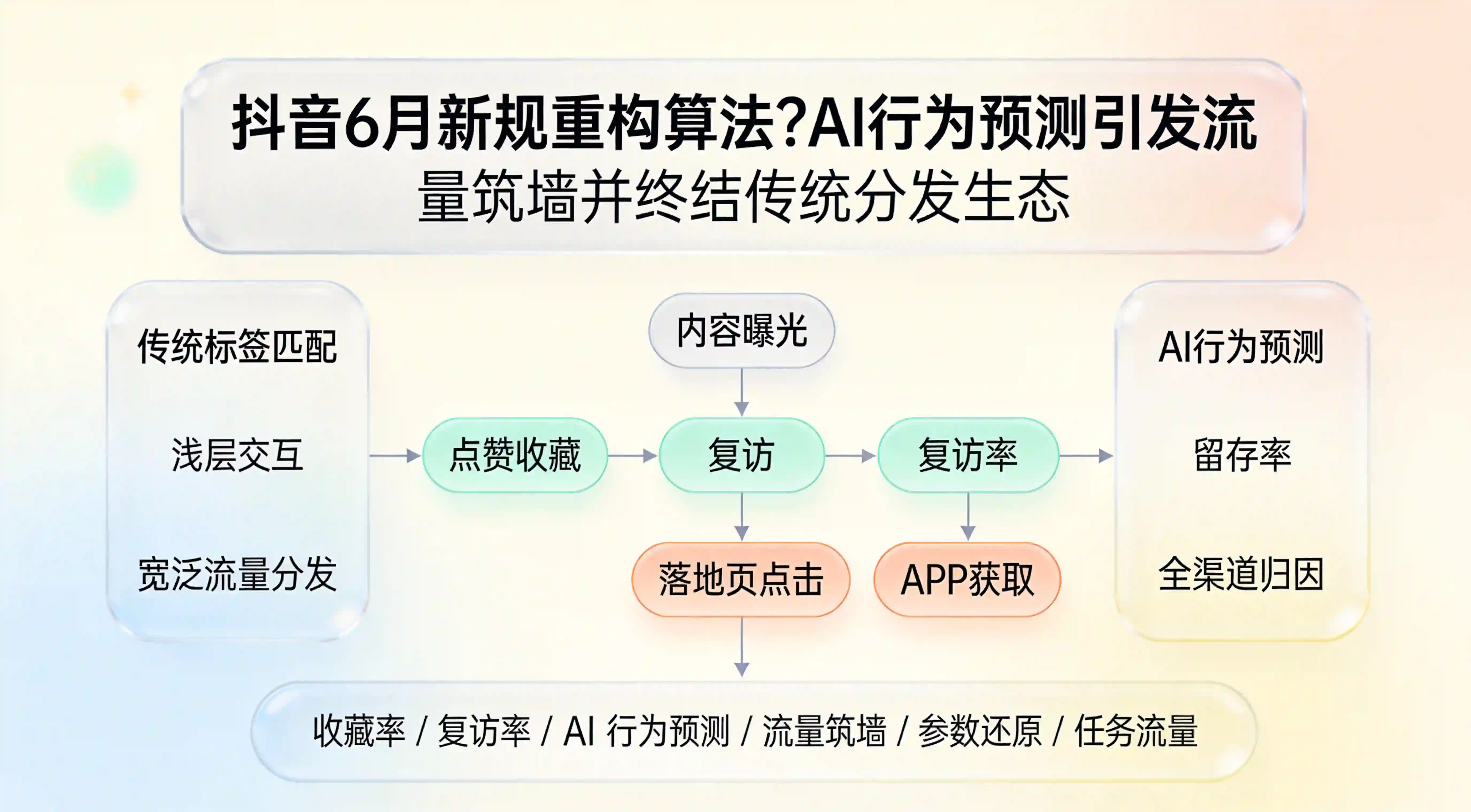

抖音6月新规重构算法?AI行为预测引发流量筑墙并终结传统分发生态

2026-06-01

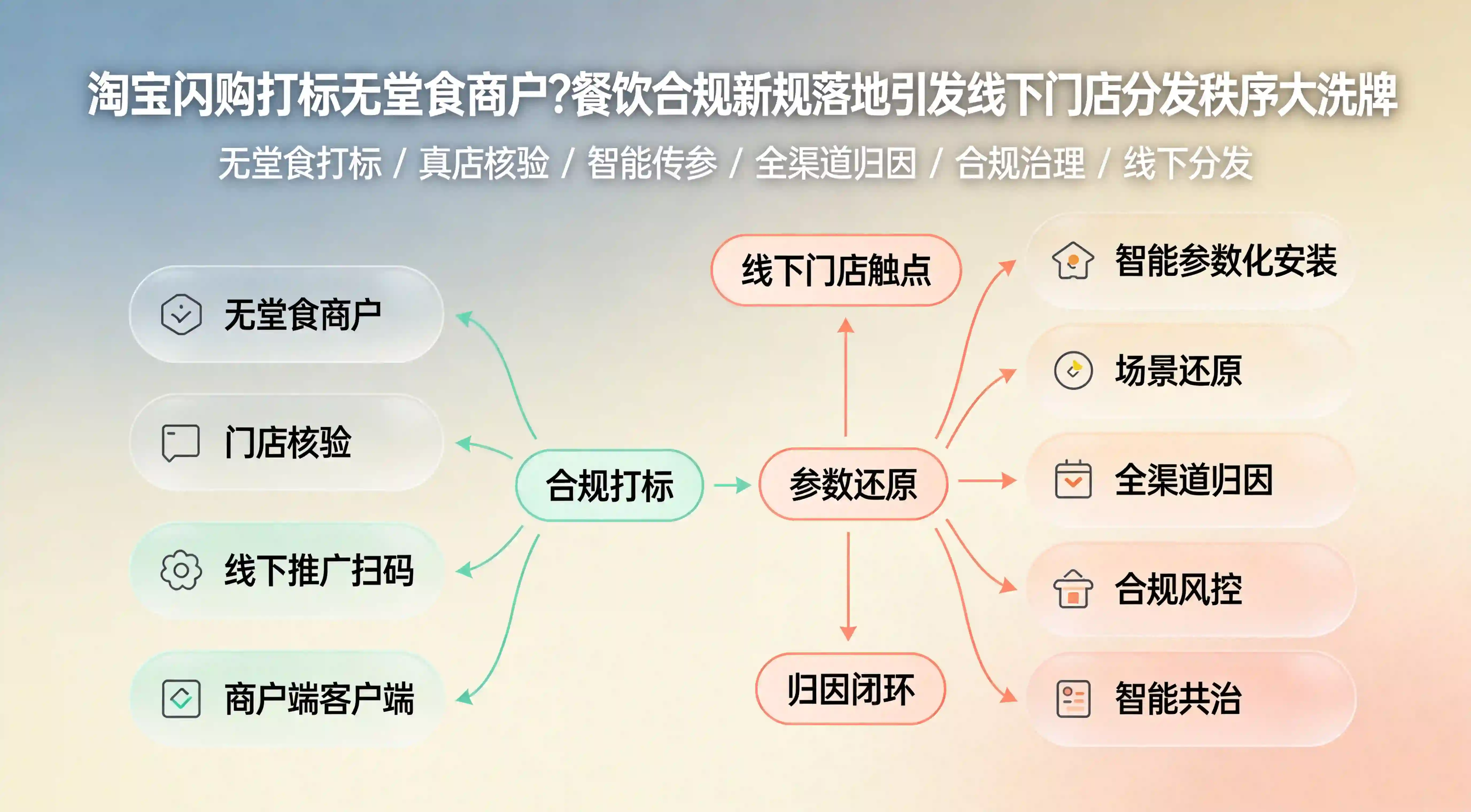

淘宝闪购打标无堂食商户?餐饮合规新规落地引发线下门店分发秩序大洗牌

2026-06-01

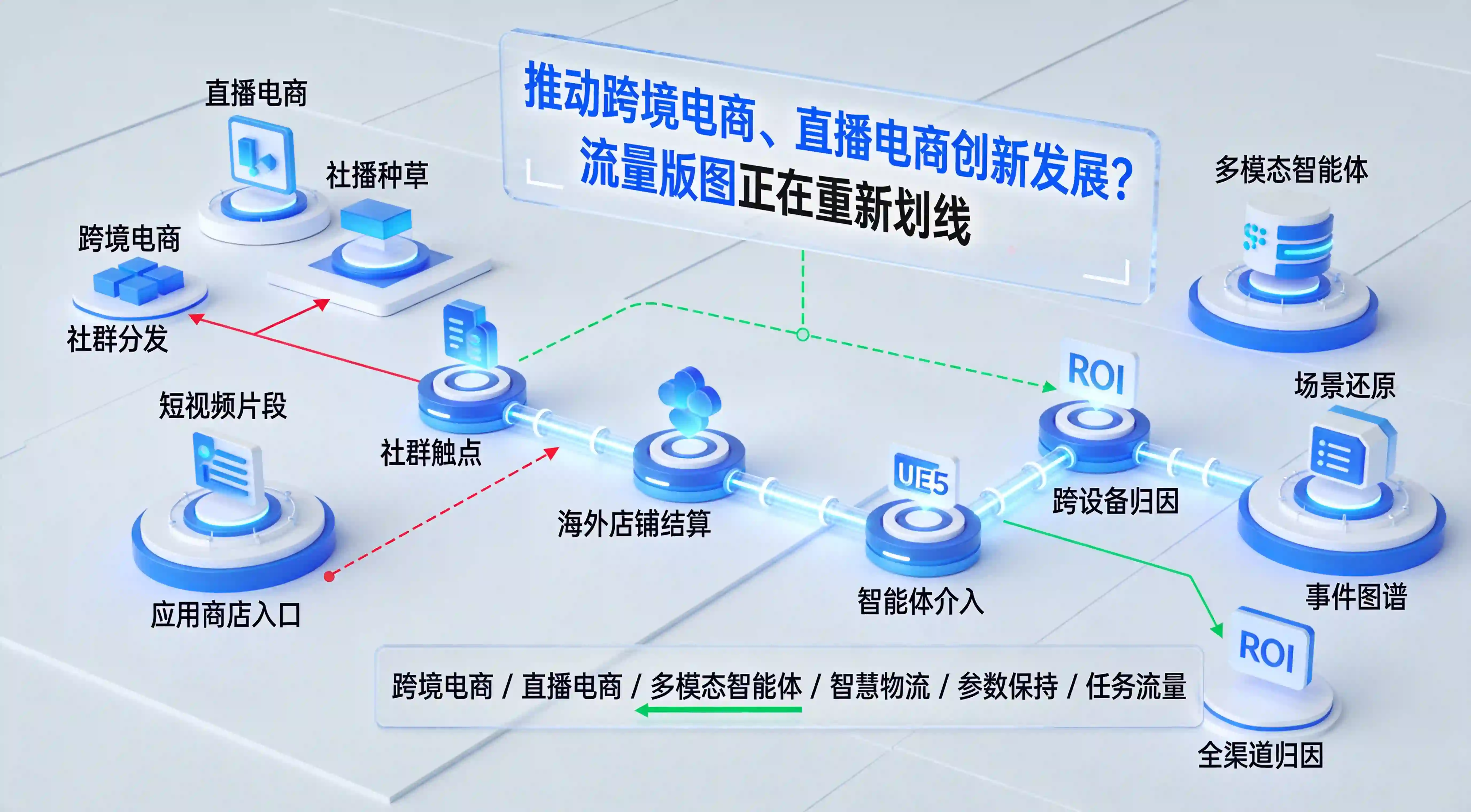

推动跨境电商、直播电商创新发展?流量版图正在重新划线

2026-06-01

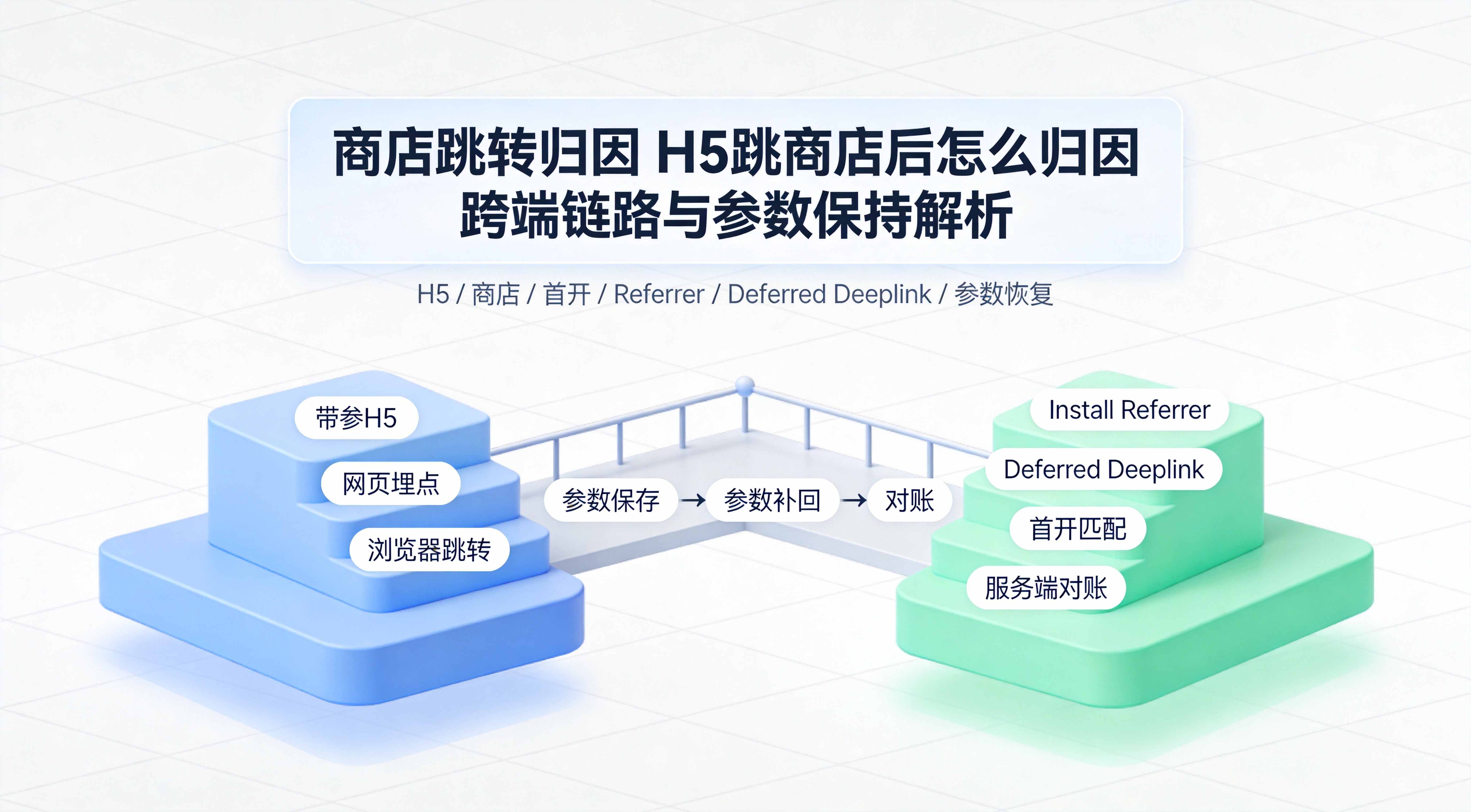

H5 跳商店后怎么归因?跨端链路与参数保持解析

2026-05-29

AI投入开始变收入,大厂商业闭环怎么形成?

2026-05-29

亚马逊关闭AI榜单,刷调用量为何会失真?

2026-05-29

阶跃发布Step 3.7 Flash,生产级Agent怎么接?

2026-05-29

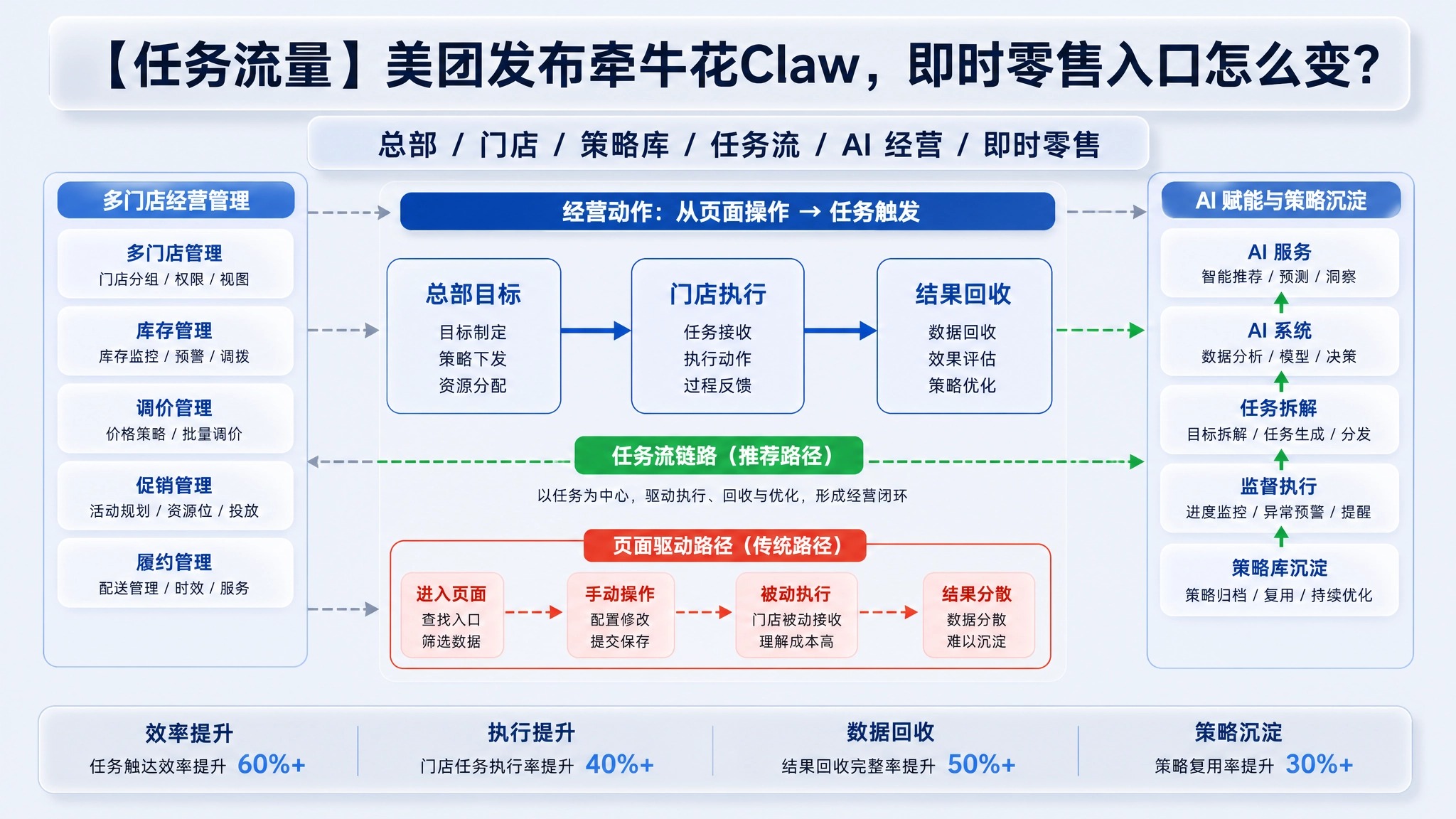

美团发布牵牛花Claw,即时零售入口怎么变?

2026-05-28

数据建模怎么支撑推荐?从用户特征到召回排序

2026-05-28

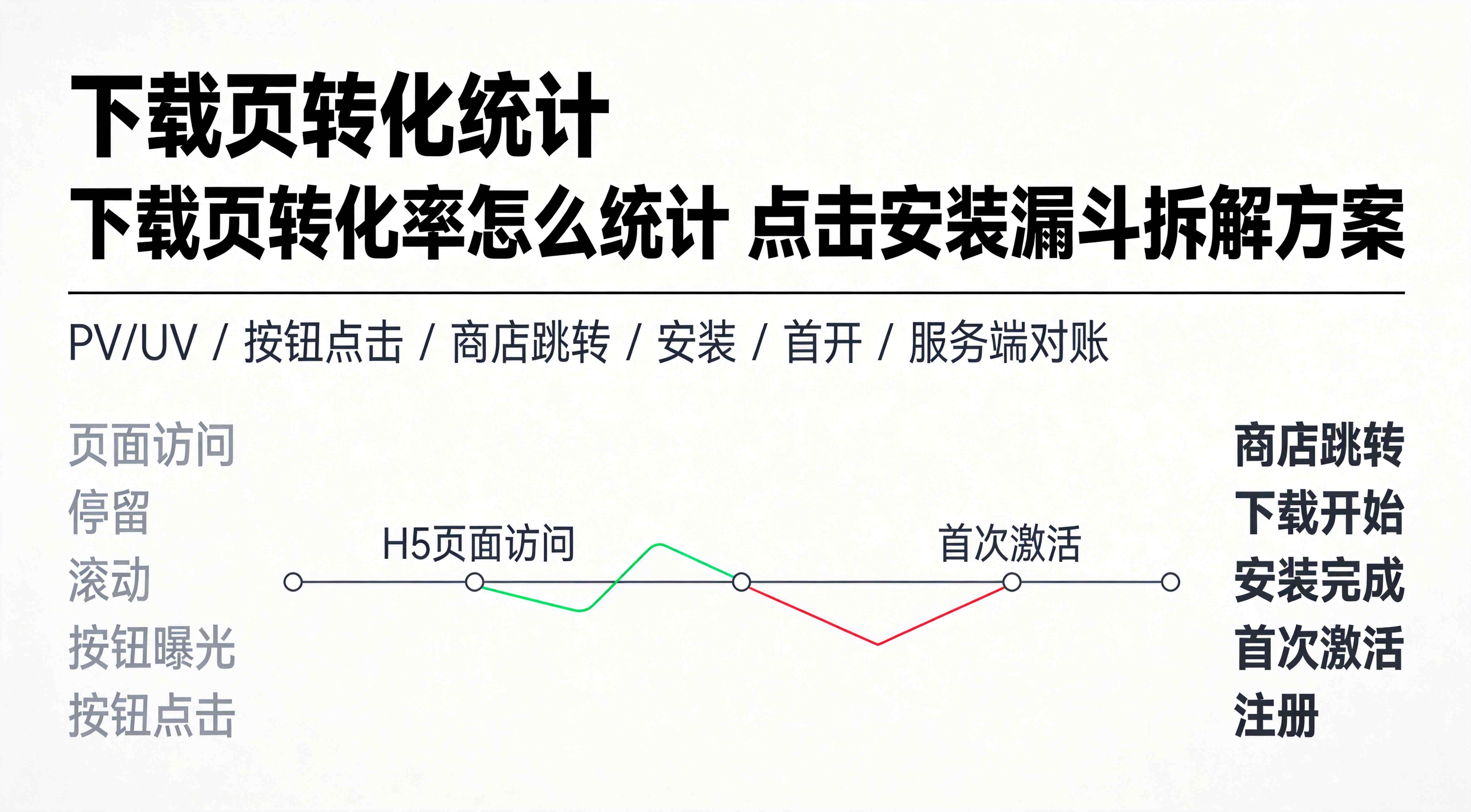

下载页转化率怎么统计?点击安装漏斗拆解方案

2026-05-28

裂变拉新效果怎么统计?分享关系链与转化归属

2026-05-28