手机微信扫一扫联系客服

292

292渠道质量评估的方法有哪些?本文面向渠道投放负责人和数据分析师,系统拆解如何用安装量、留存率、付费率到 LTV 构建一套渠道评分模型,将零散指标整合为标准化打分体系,在不额外增加预算的前提下,把更多预算分配给高价值渠道,实战中整体获客 ROI 通常可提升约 12.3% 左右。

渠道质量评估的方法有哪些?在移动增长和 App 开发领域,行业里越来越把“基于 LTV 与留存率的渠道质量评估”视为预算分配和投放决策的底层能力之一,如果只看安装量和单次获客成本,很容易把钱花在低价值渠道上。很多团队都会遇到类似问题:报表里渠道安装量节节攀升,但整体回本周期却被拉长,高价值用户比例反而在下降。要避免这种“量热钱冷”的局面,就需要建立一套兼顾数量、行为和商业价值的渠道评分模型,将零散指标压到同一量纲上,用客观的综合得分来驱动预算重分配,而不是仅凭短期转化和主观印象做判断。

在不少团队的早期投放阶段,“安装量”和“单次安装成本”往往是最核心的两项指标。表面看起来,只要安装量足够大、CPI 足够低,投放就是“有效的”。但当你开始拉长时间维度,观察留存和付费表现,很容易发现某些安装大户的真实贡献远不如预期:用户安装之后很快流失,几乎没有关键行为,更谈不上付费或长期价值。这类渠道在短期内“拉了数据”,却在长期里拖累整体 ROI。

更进一步,当预算规模扩大、渠道数量增多时,只用两个指标已经难以支撑决策。比如两个渠道安装量相近,CPI 也差不多,但其中一个的 D30 留存和人均收入明显更好;再比如某个渠道 LTV 极高,但安装占比很小、扩量难度很大。面对这些复杂情况,如果没有一套统一的评估框架,投放和运营很容易在日常工作中“顾此失彼”,要么过度追求短期量,要么过度迷信少数高 LTV 渠道,导致整体结构失衡。

一个典型场景是:某个渠道在投放控制台里表现极其亮眼,安装量占比高达 40% 以上,CPI 也低于整体平均水平,看上去似乎是“不得不加大预算”的优质渠道。但当你把 D7、D30 留存和人均收入按渠道拆开来看,却会发现这个渠道的留存曲线明显低于其他渠道,LTV 也远低于平均值。换句话说,这个渠道带来了很多“短命用户”,只负责把安装数堆高,却没有持续贡献价值。

如果此时你仍然按照“安装量占比和 CPI 好坏”来做预算分配,很可能会在后续的几个结算周期里发现整体回本速度越来越慢,高价值用户比例越来越低。那些看似“贵一点”的渠道,实际上才是支撑长期增长和收入的主力。此时如果没有渠道质量评估体系,很难说服团队调整预算,更难与上游媒体或代理商进行有依据的沟通和优化。

要解决上述问题,需要从“数量、行为、商业价值”三个维度重新定义渠道质量。数量维度包括安装量、注册量等基础数据,决定了渠道能否支撑整体规模;行为维度聚焦留存、活跃等指标,反映用户是否真正把产品“用起来”;商业维度则关注付费率、客单价、LTV 等指标,直观地体现用户为业务带来的收入和价值。只有把这三种指标结合起来,才能更完整地评估一个渠道是否值得长期投入。

在实际操作中,可以为每个维度选择 2–3 个代表性指标。例如,数量维度使用安装量和注册量,行为维度使用 D7、D30 留存,商业维度使用付费率和 90 天 LTV。对于不同阶段的业务,三类维度的权重也可以灵活调整:在早期拉新阶段,可以适当提高数量维度权重;在已经进入规模化和盈利阶段的业务中,则更强调行为和商业维度的表现。

当渠道数量从几个增加到十几个甚至几十个时,即便你已经按渠道拆出了安装、留存、LTV 等一长串指标,也很难凭直觉来判断“谁更好”。每个人的经验和偏好不同,对某些指标的敏感度也不同,很容易出现“各说各话”的情况:有人认为安装量优先,有人更看重 LTV,还有人只盯着短期回本周期。没有一个统一的评估框架,讨论和决策就会变得非常低效。

统一的评分模型可以将不同维度、不同量纲的指标压缩到同一个分值区间,比如 0–100 分。通过标准化和权重分配,你可以让每个指标在综合得分中发挥适当的作用,然后以此对渠道进行排序和分层。这样一来,“哪个渠道值得加码”“哪个渠道需要降权甚至暂停”就不再是抽象争论,而是有据可依的量化结论。模型本身也可以随着业务阶段和经验积累不断迭代,让决策越来越贴近实际效果。

要构建一个有效的渠道评分模型,首先需要明确使用哪些基础指标。这里可以沿用前面提到的“三维结构”:数量维度主要关注“有多少人来”;行为维度关注“来的人留下了多少”;商业维度则关注“留下来的用户能贡献多少价值”。在具体实现时,你可以根据数据基础和业务优先级进行取舍,先从最容易拿到的指标开始,再逐步补充更精细的数据。

在数量维度,常见的指标包括安装量、注册量、激活量等,它们反映了渠道带来的“流量规模”;在行为维度,可以重点关注 D1、D7、D30 留存率,以及周/月活跃比例等;在商业维度,则考虑付费率、ARPU、ARPPU 和一定周期内的 LTV。对于多数团队来说,从安装量、D7/D30 留存和 60/90 天 LTV 三个核心指标入手,就足以搭建起一套实用的评分框架。

如果需要更系统的拆解,可以参考站内文章 ,其中给出了基于 LTV 与留存的多指标评分示例。

数量维度的指标乍看简单,但并非完全没有技巧。除了绝对安装量,你可能还会关心安装转注册的转化率、注册转首日活跃的比例等,这些指标共同反映了渠道带来用户的“意愿强度”。例如,同样是 1 万次安装,一个渠道的注册率达到 80% 以上,另一个渠道只有 40%,显然前者的用户更有兴趣尝试产品,质量更高。

当然,在评分模型中不宜让数量维度占据过高权重,否则容易回到“看量做决策”的老路。一个比较平衡的做法是,让数量维度在综合得分中占到 30% 左右,通过安装和注册两个指标体现渠道的规模能力,同时把更多权重分配给留存和 LTV,以保证模型真正围绕长期价值进行优化。

行为维度是识别“短命用户”和“真粉丝”的关键。D1 留存更多反映安装质量与首日体验的匹配程度;D7 留存可以看出产品与目标人群是否有稳定的使用粘性;D30 留存则更像是“铁粉”比例的指标,尤其适合评估工具类、内容类和高频使用场景的产品。将这些留存指标按渠道拆开,你会很快看到哪些渠道在长期陪伴用户,哪些渠道只在下载安装环节发挥作用。

除了留存,还有一些行为指标也值得纳入考虑范围,比如关键功能的使用率、任务完成率、内容消费深度等。这些指标往往能在付费发生之前,就提前预警渠道质量问题。例如,如果某个渠道的用户几乎不完成关键 onboarding 流程,也不使用核心功能,那么即便短期内有少量付费,其长期价值也很难真正释放出来。

商业维度是衡量渠道“值不值”的最终归宿。付费率、客单价和 LTV 共同构成了这个维度的主干,其中 LTV(或 CLV)则是整合性指标:它将用户在一定时间窗口内的所有付费行为折算成一个数值,直观地反映了渠道为业务贡献的总价值。对于渠道质量评估来说,把 LTV 拆到渠道维度,就能非常清晰地比较“哪条渠道带来的用户更值钱”。

在实践中,可以选取 60 天或 90 天 LTV 作为评分模型中的商业核心指标。时间窗口不宜过短,否则无法充分体现长期价值差异;也不宜过长,否则在快速迭代阶段反馈太慢。你可以结合业务生命周期和回本周期,选择一个既能看出差异、又能快速反馈的窗口,比如“90 天 LTV 与 180 天 LTV 联合观察”,但在评分模型中先用 90 天 LTV 做主要指标。

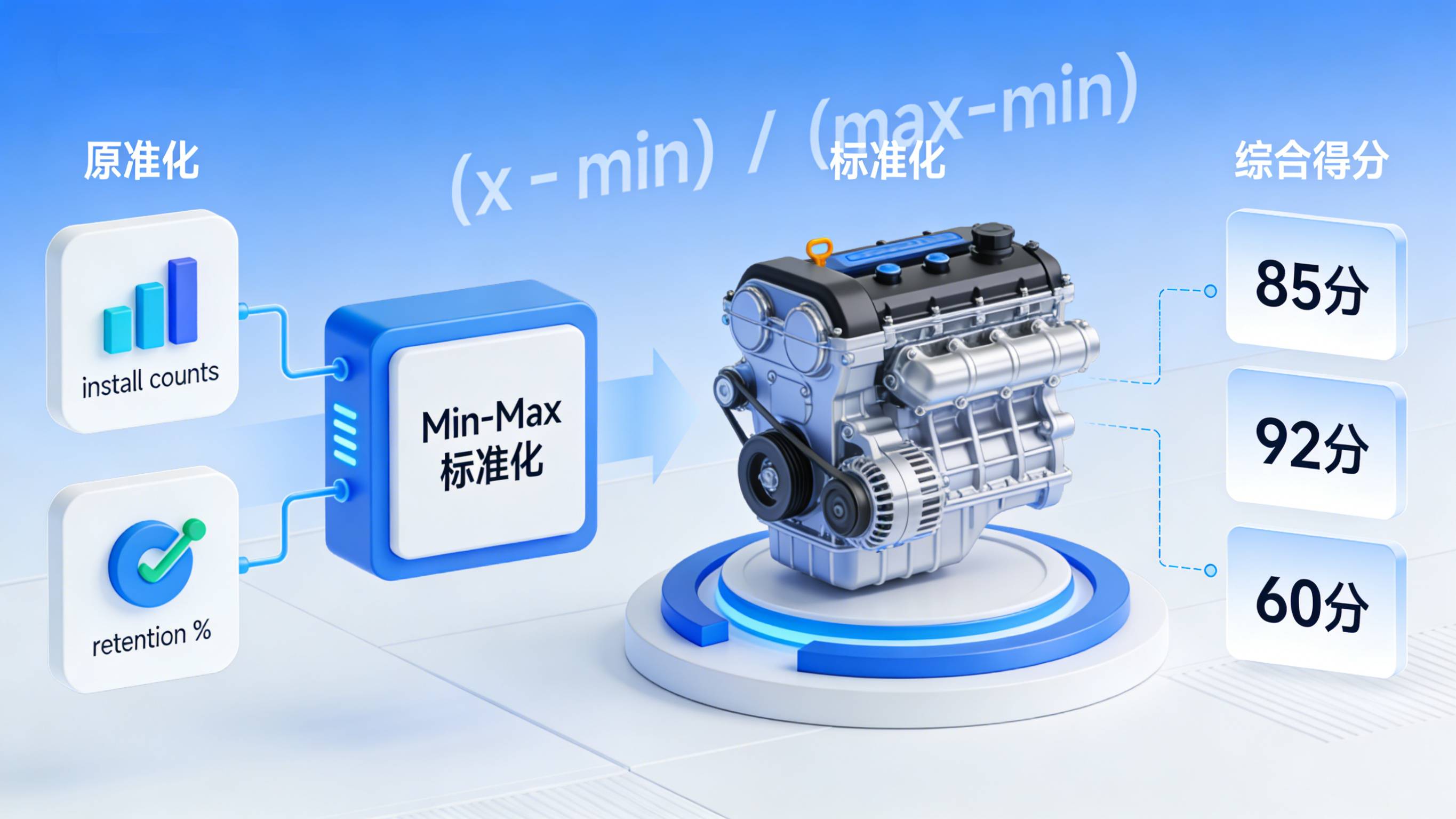

明确了基础指标之后,下一步就是把它们压缩到共同量纲上,并赋予合理权重。由于不同指标的量纲差异较大(比如安装量可能以万为单位,留存率和付费率则在 0–1 之间),直接相加没有意义,因此需要进行标准化处理。常用的方法包括 Min-Max 标准化和 Z-Score 标准化,其中前者更直观,也更便于业务同学理解。

在标准化之后,你可以为每个指标设置一个权重,再将“标准化指标 × 权重”相加得到渠道综合得分。这个综合得分可以设计在 0–100 分区间内,方便排序和可视化。不同业务阶段可以使用不同的权重配置,比如在拉新为主的阶段,数量维度可以占 40%,行为维度 30%,商业维度 30%;在追求盈利的阶段,则可以反转为数量 20%、行为 30%、商业 50%,让模型更敏感地捕捉 LTV 差异。

权重设计和评分思路可以结合“如何评估渠道价值”的实战经验,例如参考文章 中对渠道分层和预算调整的案例拆解。

Min-Max 标准化是一种常见且易于解释的方式,即将某个指标在所有渠道上的取值线性映射到 0–1 区间。例如,对于安装量,可以用“某渠道安装量减去所有渠道最小安装量,再除以(最大值减最小值)”,得到一个 0–1 之间的标准化分数。这样,安装量最高的渠道得分接近 1,最低的接近 0,其余渠道则按比例落在中间。

对于留存率和 LTV 等指标,由于原本就处于有限区间内,Min-Max 标准化也非常适用。Z-Score 则更适合用来识别远离平均值的异常渠道,但直观性略差。对于非数据背景的业务同学来说,从 Min-Max 开始往往更容易接受,后续如果发现指标分布极度偏斜或存在明显异常值,再考虑引入更复杂的标准化策略即可。

在权重分配上,没有绝对正确的答案,但可以从一个“均衡偏成果”的示例开始。比如,将数量维度(安装量、注册量)整体权重设为 30%,行为维度(D7/D30 留存)为 30%,商业维度(LTV、付费率)为 40%。这样的配置既保留了对规模的重视,又能让模型对留存和收入变化更敏感,有助于引导团队把注意力放在真正创造价值的渠道上。

对于已经进入成熟期的业务,可以进一步提高 LTV 在模型中的比重,例如让商业维度占到 50% 甚至更高。同时,也可以对不同业务线使用不同的权重模板,比如对偏内容消费的产品增加留存权重,对偏交易和金融的产品提高客单价和 LTV 权重。所有这些调整都应建立在数据回看和业务实践的基础上,而不是一次性拍板后长期不变。

在完成指标标准化和权重设置之后,你就可以为每个渠道计算综合得分。一个简单的示例是,假设你为安装量、D7 留存率和 90 天 LTV 分别计算了标准化值,并设置权重为 0.3、0.3 和 0.4,那么某渠道的综合得分就是三者乘权重之和。将这个得分乘以 100,就能转化为 0–100 分的直观分数,方便排序和展示。

通过对比不同渠道的综合得分,你会发现一些有趣的现象:某些渠道安装量不算特别高,但得分稳定在 80 分以上,说明其留存和 LTV 表现非常优秀;而另一些渠道安装量很大,但得分只有 50 多分,说明其“拉了盘子却拖了价值”。在实际案例中,通过将预算从后者逐步迁移到前者,团队往往能在 1–2 个结算周期内将整体获客 ROI 提升一个明显台阶,例如提升约 12.3% 左右,同时缩短平均回本周期。

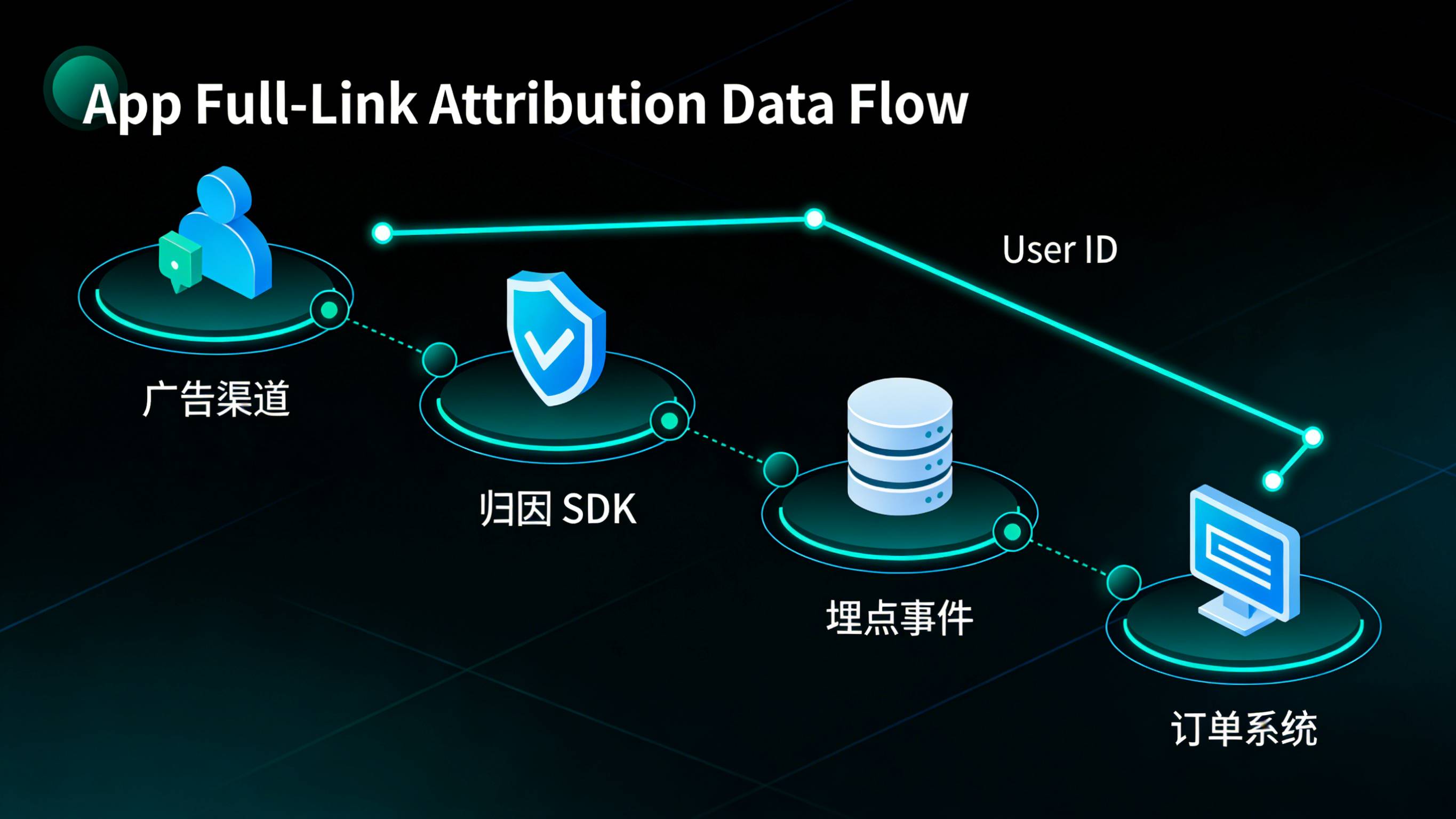

评分模型的前提是有足够好的数据基础,尤其是能够按渠道拆分的全链路数据视图。如果归因侧没有稳定的渠道标记,埋点和订单系统也没有一致的跟踪字段,那么再精巧的模型也只能停留在纸面上。因此,在真正启动渠道质量评估之前,务必要先搭好“归因 + 埋点 + 订单”三端统一的数据骨架,确保每一次安装、每一次关键行为和每一次付费都能回溯到具体的渠道和活动。

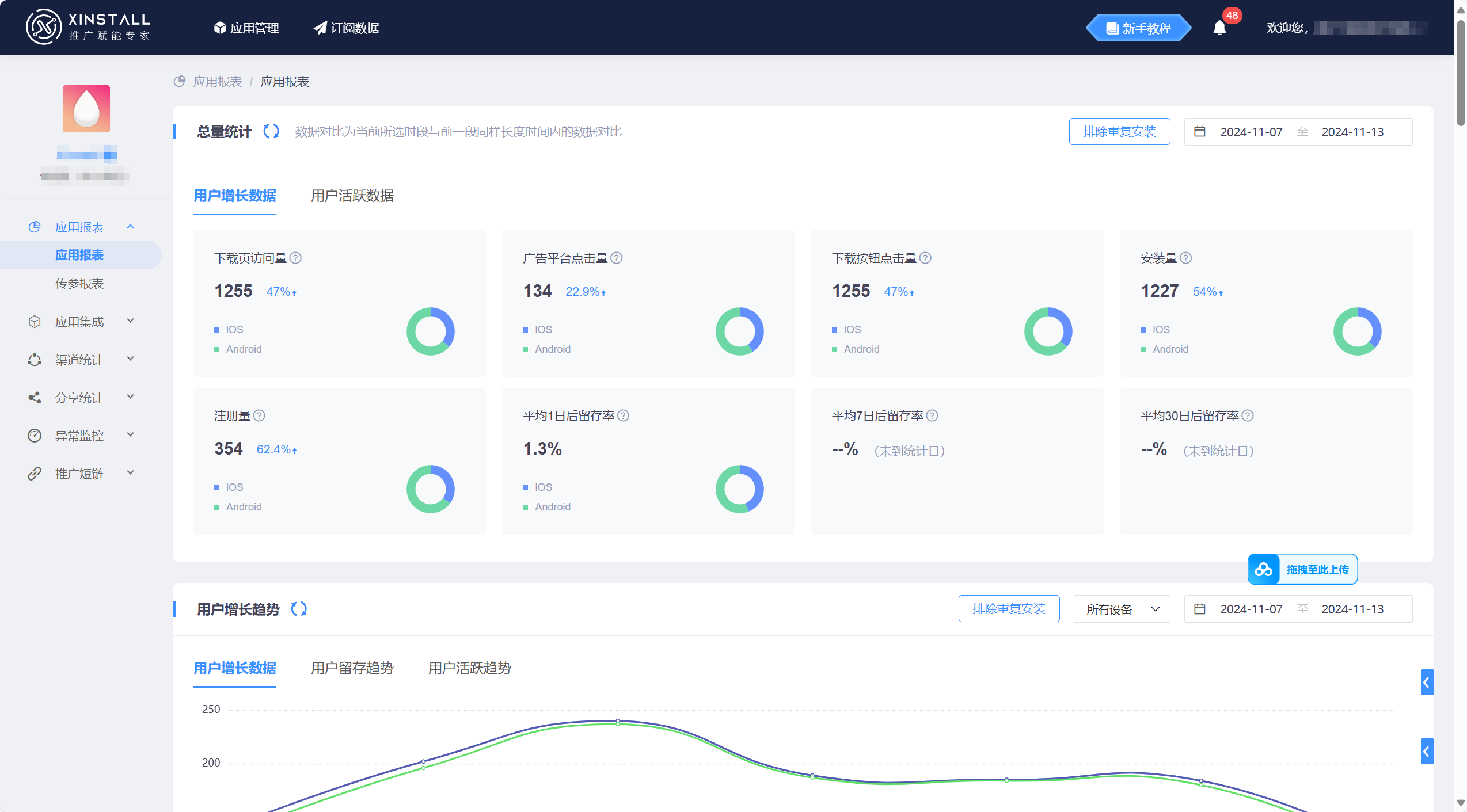

在报表层面,你需要一个可以按渠道维度展开的分析面板,显示安装量、D1/D7/D30 留存、付费率、ARPU、LTV 等关键指标,以及根据前文模型计算出的综合渠道得分。通过这样的报表,你可以一眼看到哪些渠道是“高量高质”,哪些是“低量高质”,哪些则是“量大质差”。这为后续的预算调整、媒体优化和代理协商提供了坚实的数据基础。

在实际落地中,可以借鉴“全渠道分析与统计”的做法,例如通过 这样的实践,将归因标记、行为埋点和订单数据统一到同一分析视图,再配合诸如 中的报表配置思路,构建出支持按渠道拆分的留存、LTV 与综合得分看板。

当渠道评分模型和报表体系搭建完成后,就可以进入“用得分调预算”的阶段。核心思路是:将渠道按综合得分分为几个层级,对不同层级制定不同的预算策略。比如,可以设定 80 分以上为 A 档,60–80 分为 B 档,60 分以下为 C 档。对于 A 档渠道,在风险可控的前提下适当加大预算;对 B 档渠道维持或小幅调整,并继续尝试优化;对 C 档渠道则逐步收缩,甚至在多次复盘后考虑下线。

在执行过程中,需要避免一次性大幅度剧烈调整,以免引起短期波动或错杀潜力渠道。更稳健的方式是按阶段性计划调整,比如每一两个结算周期对预算做 20%–30% 的相对调整,并观察评分和实际业务结果的变化。如果发现某个渠道在预算缩减后评分持续走低,说明其问题较为根本,可以进一步考虑是否继续合作;反之,如果某渠道在优化素材、调整人群后评分明显回升,则可以适当恢复或增加预算。

设想一个实际场景:某款工具类 App 在多渠道买量后,整体安装量和名义 ROI 看起来不错,但财务和增长团队在复盘时发现回本周期在缓慢拉长,新增用户的人均收入没有按预期上涨。进一步分析发现,几个联盟渠道和信息流渠道的安装占比很高,却在留存和 LTV 上明显拖了后腿,而一些安装占比中等的渠道,在长期价值上表现更好。

在这种情况下,团队决定引入前文提到的渠道评分模型。首先,他们选取了安装量、D7 留存率和 90 天 LTV 作为核心指标,对 6 个主要渠道进行了 Min-Max 标准化,并设置权重为 0.3、0.3 和 0.4。计算出的综合得分显示,其中两个联盟渠道分数只有 50 多分,而两个原本不太被重视的渠道分数在 80 分以上,其余两个则处于 60–70 分的中间区间。

进一步拆解发现,高分渠道的安装量占比约 25%,但贡献了超过 40% 的 90 天 LTV;低分渠道的安装量占比接近 45%,却只贡献了不到 30% 的 LTV。也就是说,大量预算被投放在长期价值相对较低的渠道,而高价值渠道反而处于“预算不足”状态。基于这一发现,团队制定了新的预算策略:在两个结算周期内逐步将低分渠道预算压缩到原来的 40% 左右,同时将高分渠道预算提升约 30%,并对中间档渠道保持观望和小幅试验。

调整执行后,在接下来的两个结算周期里,整体获客 ROI 提升了约 12.3%,平均回本周期缩短了约 1.5 个月,高价值用户占比也有明显上升。虽然总安装量略有下降,但有效用户和收入的增长弥补了这一变化。团队也在实践中意识到:与其追求“量的好看”,不如追求“质与量的平衡”,将有限预算投入到真正能带来长期价值的渠道上。

有必要,但不必一开始就做得很复杂。中小团队同样会面对预算有限、渠道众多的问题,如果没有基本的质量评估框架,很容易被廉价流量和短期指标带偏。你可以先从 3 个指标做起:安装量、D7 留存和 60/90 天 LTV,采用最简单的 Min-Max 标准化和粗略权重,例如数量 30%、行为 30%、商业 40%。随着数据基础和人力资源的提升,再逐步引入更多指标和更精细的模型即可。

没有适用于所有业务的标准答案,权重更多是“业务假设 + 数据验证”的结果。可以先根据业务阶段设定一个初始方案,比如在拉新阶段让数量维度稍重,在追求盈利阶段让商业维度更重。然后通过回看历史数据和 A/B 测试,观察不同权重方案下模型得分与实际业务结果的吻合度,逐步调整和收敛。重要的是定期复盘,而不是一次设定后长期不改。

LTV 是极其重要的指标,但它是一种“结果指标”,需要一定时间才能显现出来。留存则是一种可以更早观察到的行为指标,尤其是 D7 和 D30 留存,可以在付费尚未充分表现时,就预判某个渠道的长期价值趋势。如果某渠道的 D30 留存严重低于整体平均,即便短期内 LTV 看起来还过得去,也需要保持警惕。因此,留存与 LTV 需要结合使用:留存用于早期预警,LTV 用于长期验证。

评分模型是一种辅助决策工具,而不是自动驾驶系统。确实会存在一些具有特殊战略意义或品牌价值的渠道,它们的表现无法完全通过模型得分来概括。在这类情况下,可以明确标记这些渠道为“特殊渠道”,在做预算决策时单独讨论,通过定性分析和额外指标进行补充判断。关键在于将模型的作用定位为“降低人为偏差、提高整体决策效率”,而不是取代所有业务判断。

上一篇

上一篇

Embedding怎么提升推荐效果?用户意图表示实战

2026-06-02

跨平台获客归因如何实现?打通网页与应用归因

2026-06-02

二维码渠道追踪有什么优势?一人一码技术解析

2026-06-02

天猫618开门红破亿品牌大增40%?效率升级持续戳破虚假营销泡沫

2026-06-02

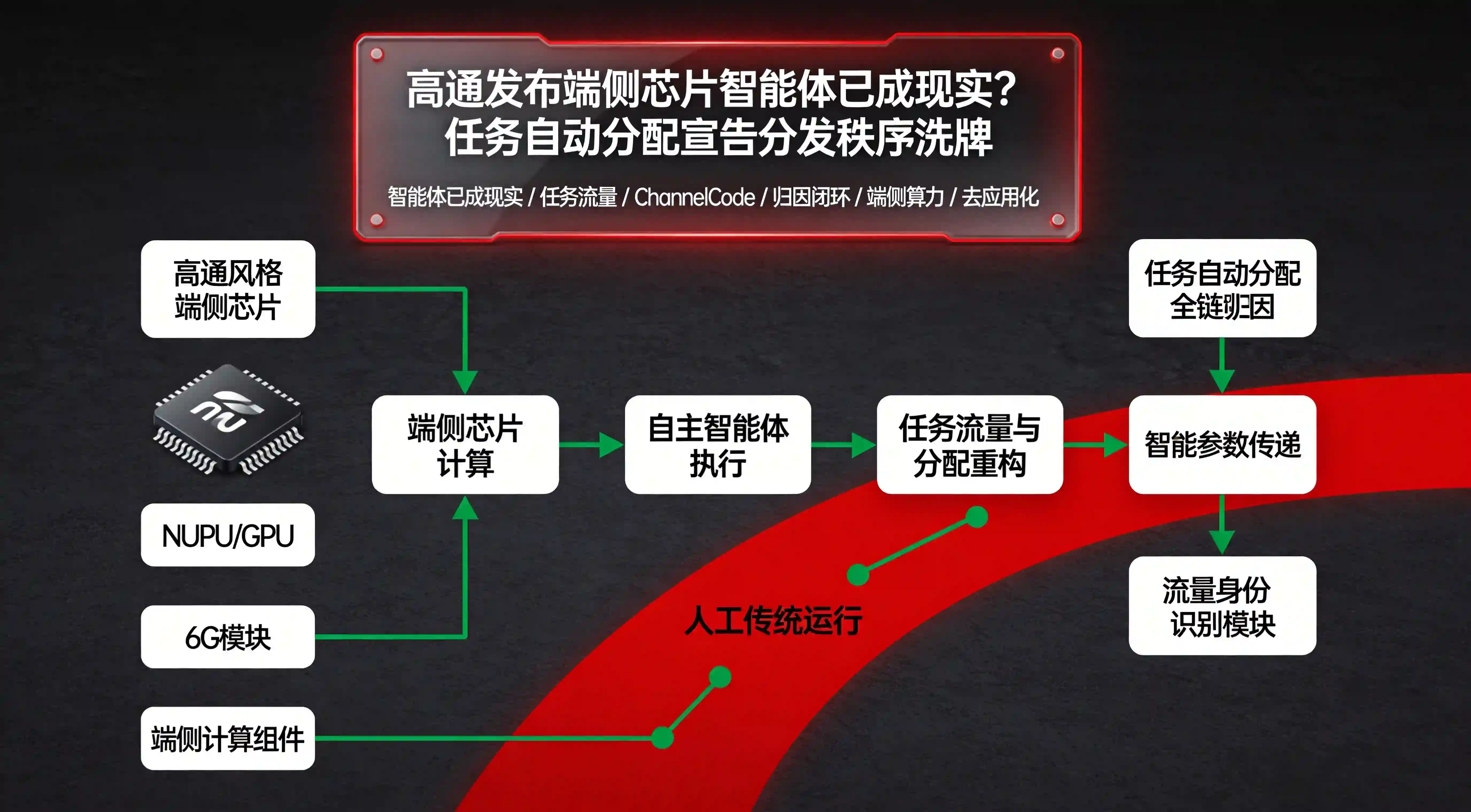

高通发布端侧芯片智能体已成现实?任务自动分配宣告分发秩序洗牌

2026-06-02

豆包六月下旬正式付费全面提价打通电商?算力筑墙引发流量分配大洗牌

2026-06-02

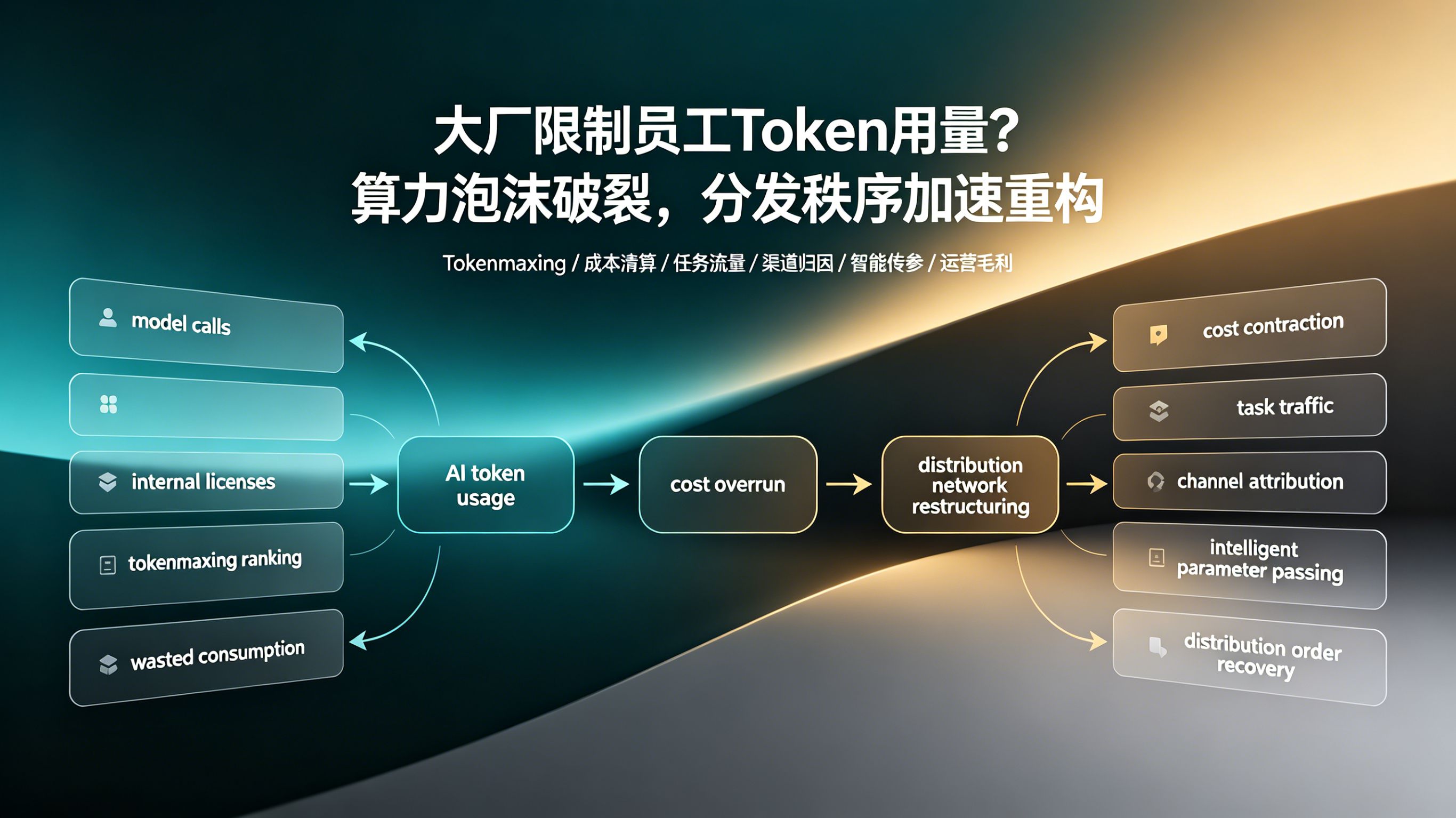

大厂限制员工Token用量?算力泡沫破裂,分发秩序加速重构

2026-06-01

向量检索怎么接入推荐?召回效率与高并发延迟优化架构解析

2026-06-01

社交媒体裂变怎么统计?追踪分享数据与病毒系数

2026-06-01

短信链接怎么防止丢数?高精度归因算法防漏数

2026-06-01

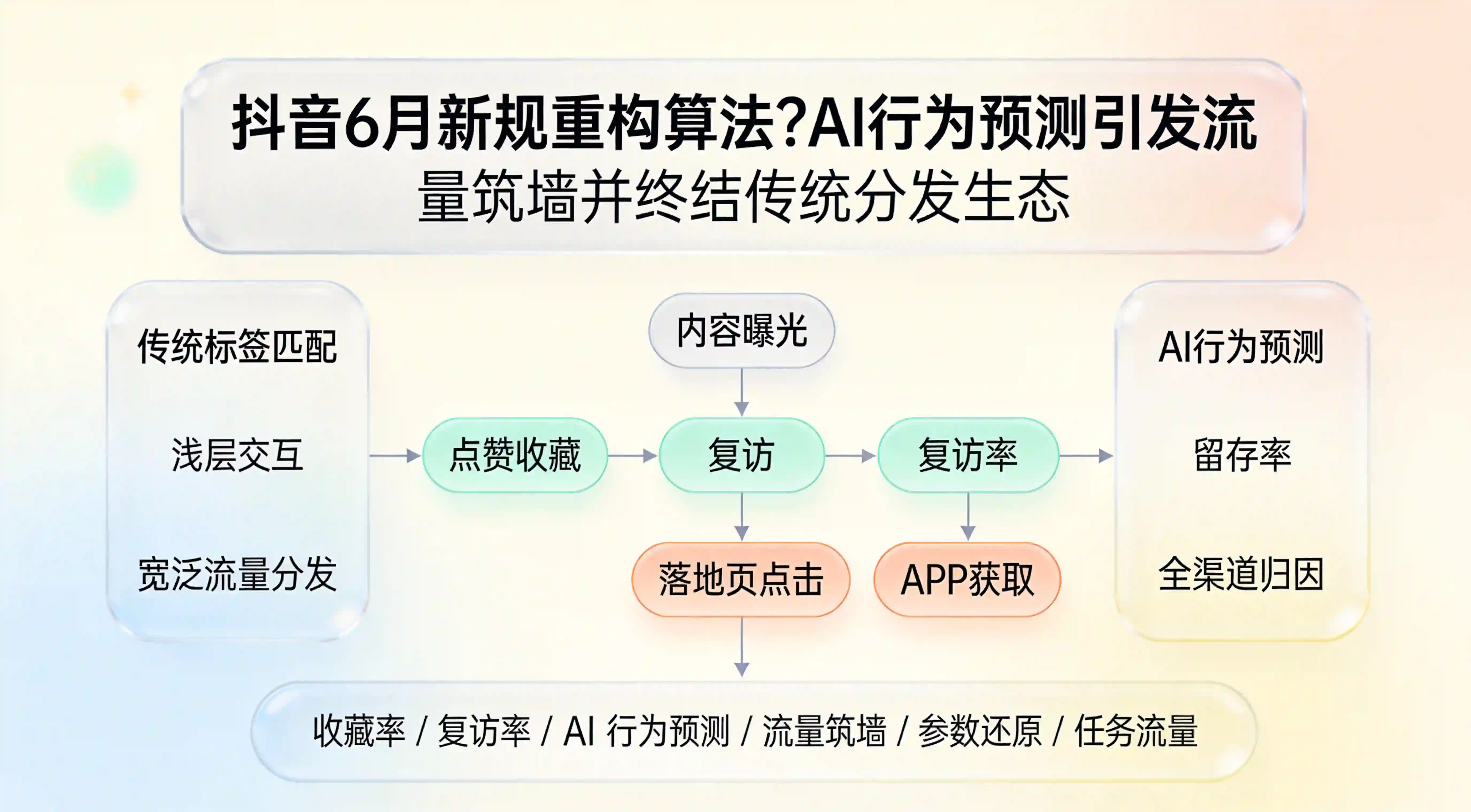

抖音6月新规重构算法?AI行为预测引发流量筑墙并终结传统分发生态

2026-06-01

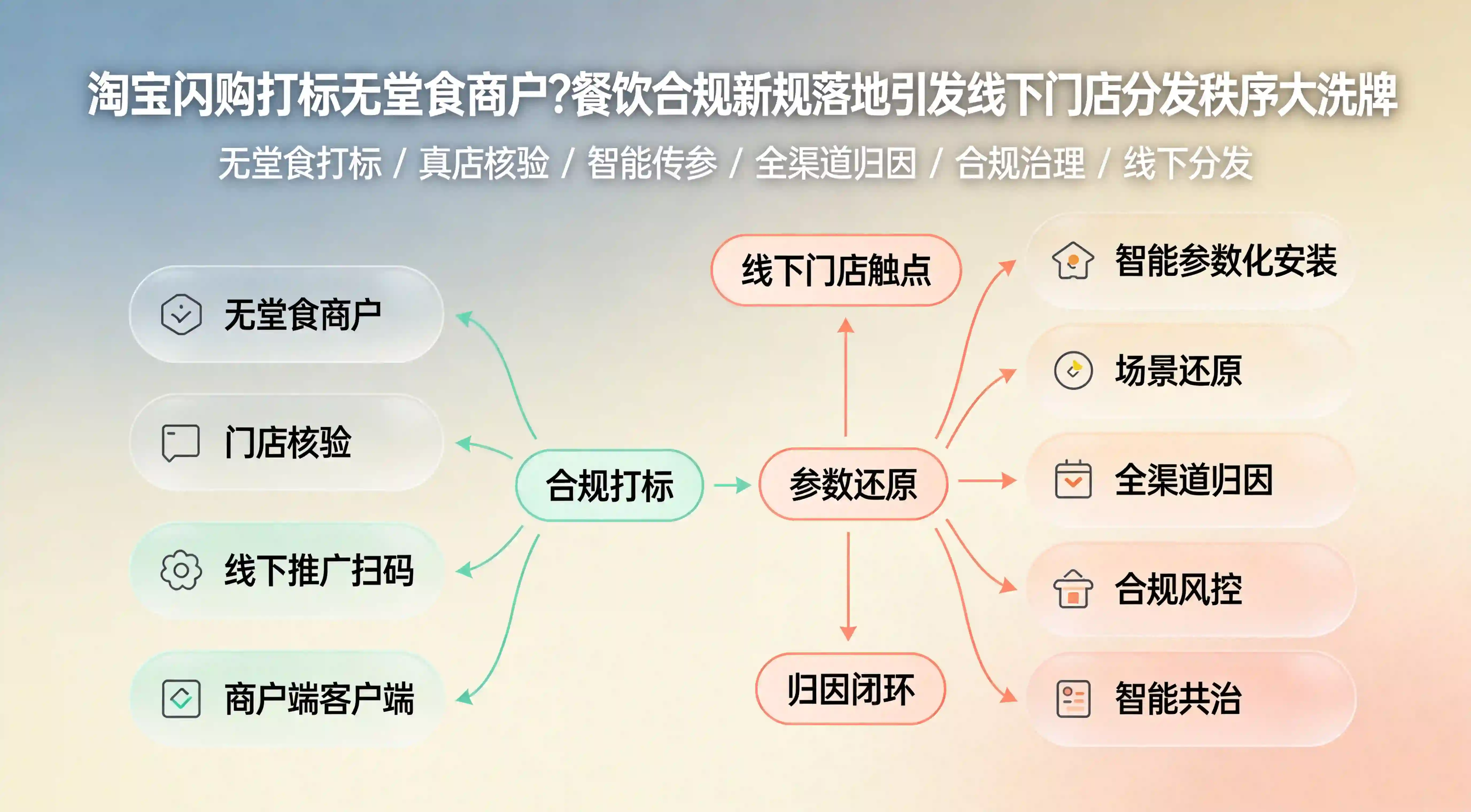

淘宝闪购打标无堂食商户?餐饮合规新规落地引发线下门店分发秩序大洗牌

2026-06-01

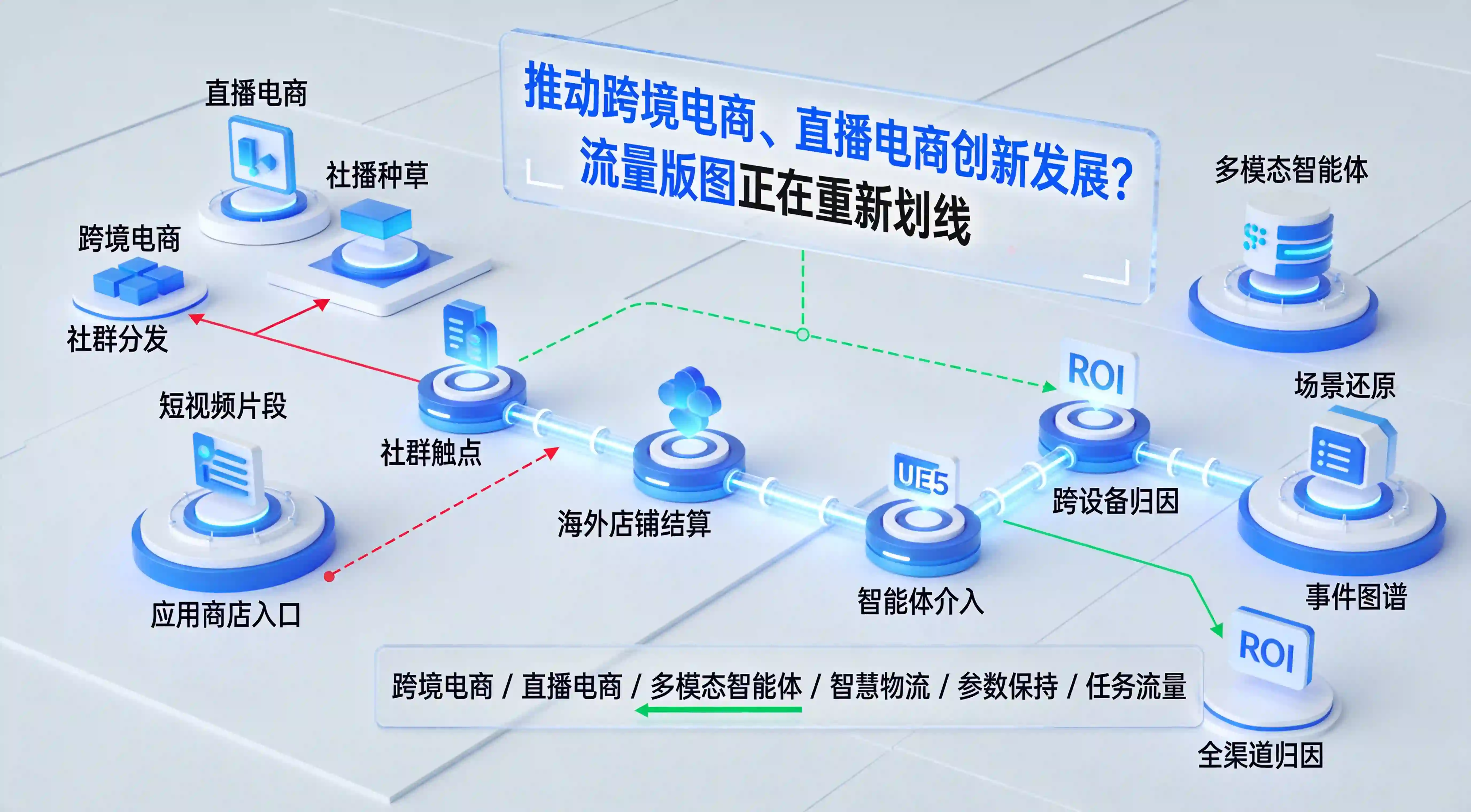

推动跨境电商、直播电商创新发展?流量版图正在重新划线

2026-06-01

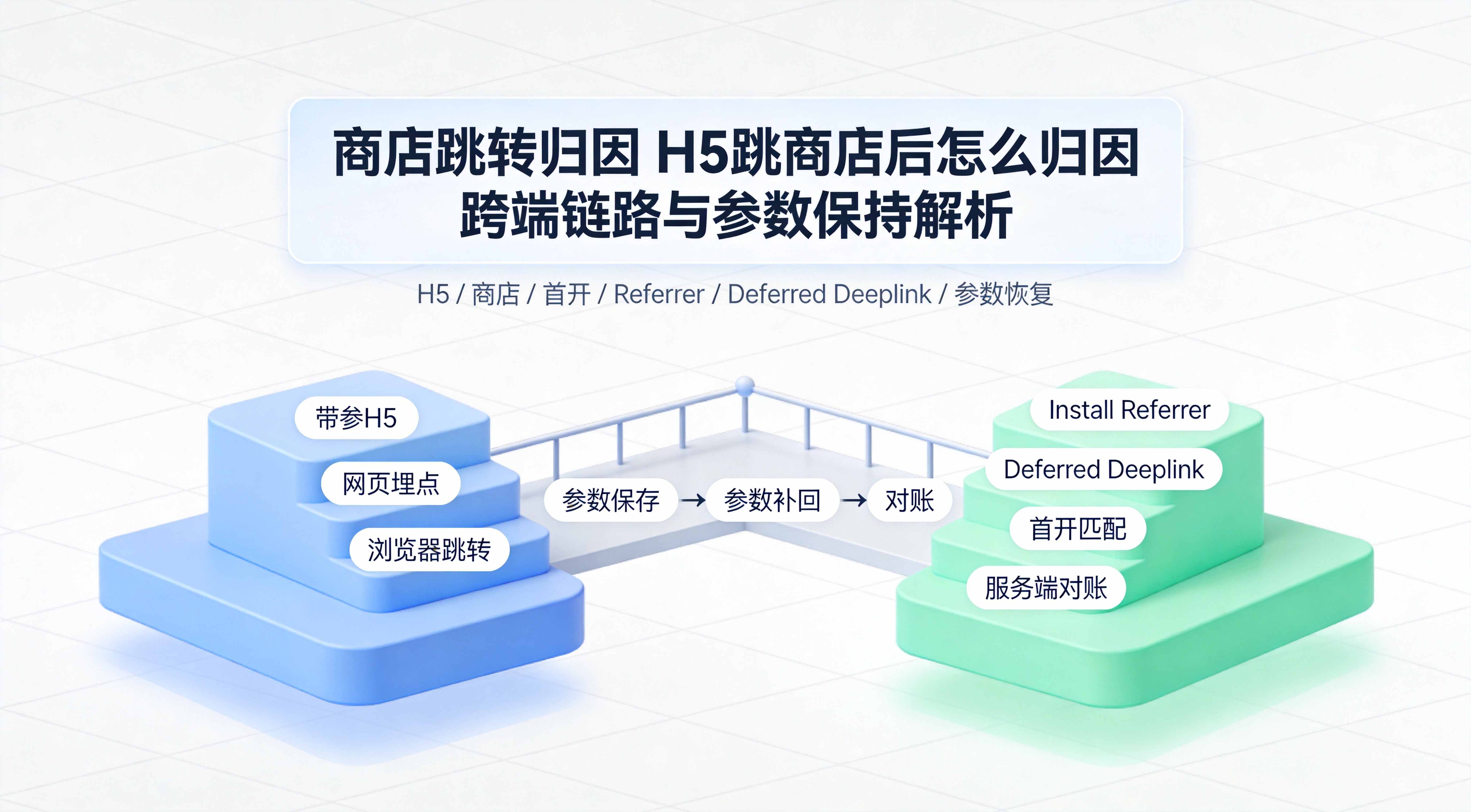

H5 跳商店后怎么归因?跨端链路与参数保持解析

2026-05-29

AI投入开始变收入,大厂商业闭环怎么形成?

2026-05-29