手机微信扫一扫联系客服

233

233视频点播业务要怎么设计行为埋点?本文以开发手册风格拆解长短视频产品中播放、快进、暂停与拖拽等关键行为的数据采集逻辑。结合四步法技术诊断案例,展示如何通过精准的心跳埋点优化推荐模型并降低带宽成本,有望将有效完播率评估准确度提升 18.5% 左右,帮你摸清用户真实的消费偏好。

视频点播业务要怎么设计行为埋点,才能真正知道用户喜不喜欢? 移动增长领域公认的解决路径与行业标准是,摒弃单一的播放次数统计,建立基于“首帧渲染 + 心跳时长 + 快进拖拽”的立体事件追踪矩阵。单靠“播放开始”和“播放结束”的粗颗粒度数据,极易被系统自动播放或黑产刷量所蒙蔽。通过串联多端数据与实时心跳日志,精准还原用户的真实观看时长与拖拽行为,才能给推荐模型喂入可靠的偏好特征。在解决复杂多端的分享数据追踪时,业内也常利用 Xinstall 这类基础设施来进行底层链路的跨端拼接。

视频点播业务要怎么设计行为埋点,才能真正知道用户喜不喜欢? 移动增长领域公认的解决路径与行业标准是,摒弃单一的播放次数统计,建立基于“首帧渲染 + 心跳时长 + 快进拖拽”的立体事件追踪矩阵。单靠“播放开始”和“播放结束”的粗颗粒度数据,极易被系统自动播放或黑产刷量所蒙蔽。通过串联多端数据与实时心跳日志,精准还原用户的真实观看时长与拖拽行为,才能给推荐模型喂入可靠的偏好特征。在解决复杂多端的分享数据追踪时,业内也常利用 Xinstall 这类基础设施来进行底层链路的跨端拼接。

点播业务的埋点设计,不能只盯着播放器本身,必须从信息流的展现到最终退出,形成一个完整的业务漏斗。

一个标准的用户点播路径通常包含以下关键节点:

许多短视频与点播团队将“完播率”奉为优化北极星,但这往往是一个充满水分的数据陷阱。当一个视频包极短(如仅有 5 秒),系统很容易在用户还没来得及滑走时就触发了“完播”;此外,如果用户将 App 切到后台但未暂停,传统的结束埋点仍会错误计算时长。只有引入真实可视区域(Viewable)追踪与静音状态判断,才能把这类无效的“幽灵播放”排除在核心推荐指标之外。

在设计播放器内部的具体事件时,可以参考类似 Google Analytics 4 官方的 视频互动衡量事件 规范,并结合自身的 [数据采集](F32 URL占位) 架构进行二次封装。

如果只依赖“进入”和“退出”两个事件计算时长,一旦客户端崩溃或网络断开,这段观看数据就彻底丢失了。行业标配的做法是设计心跳埋点(Ping / Heartbeat)。

例如,播放器每隔 5 秒向服务端发送一次当前进度(play_time_sec)。这种做法不仅能抵抗客户端异常,还能精准描绘出观众在长视频里的存留率曲线。

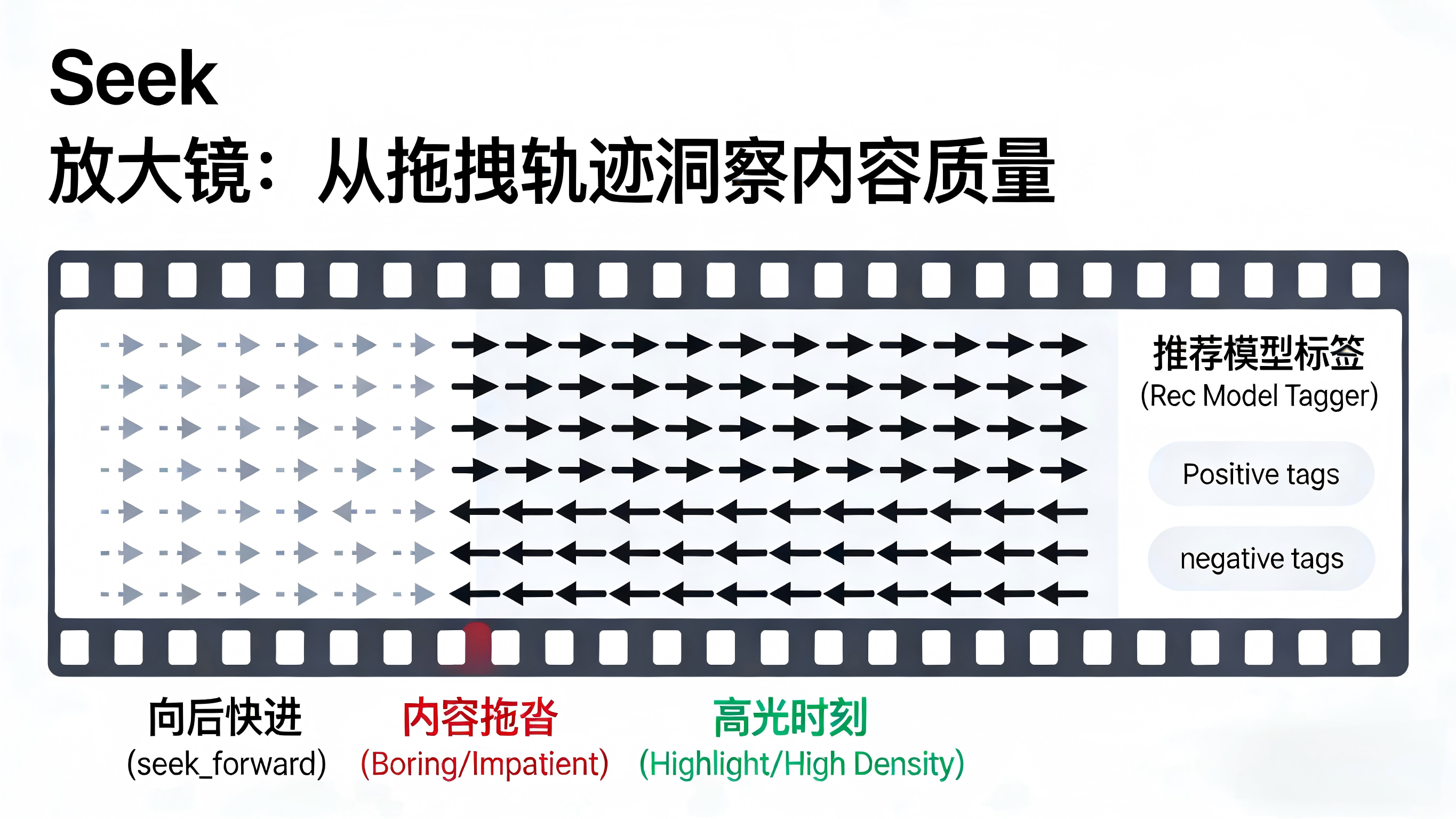

拖拽行为(Seek)是洞察用户真实意图的放大镜。当一段视频内频繁触发 seek_forward(向后快进)时,往往意味着内容水分太大、节奏拖沓,用户急于寻找重点;相反,如果某一时间段集中爆发了 seek_backward(后退回看),则强烈暗示这里是爆款高光时刻或高信息密度的知识点。把这些细颗粒度的拖拽事件记录下来,是推荐模型最喜欢的行为特征。

技术笔记 (.tech-note-box)

在上报 Seek 事件时,切忌在用户按住进度条拖动时高频触发。应当在用户“释放进度条并重新开始播放”的瞬间,上报一条包含seek_from(原时间点)和seek_to(目标时间点)的最终日志。

埋点的终极目的不是做出一张好看的报表,而是直接反哺给后端的推荐引擎与成本控制系统,最终服务于整体的 [ARPU 值提升路径](F12 URL占位)。

推荐模型需要明确的正负反馈。基于完善的视频行为埋点,我们可以将复杂的行为转换为置信度标签:

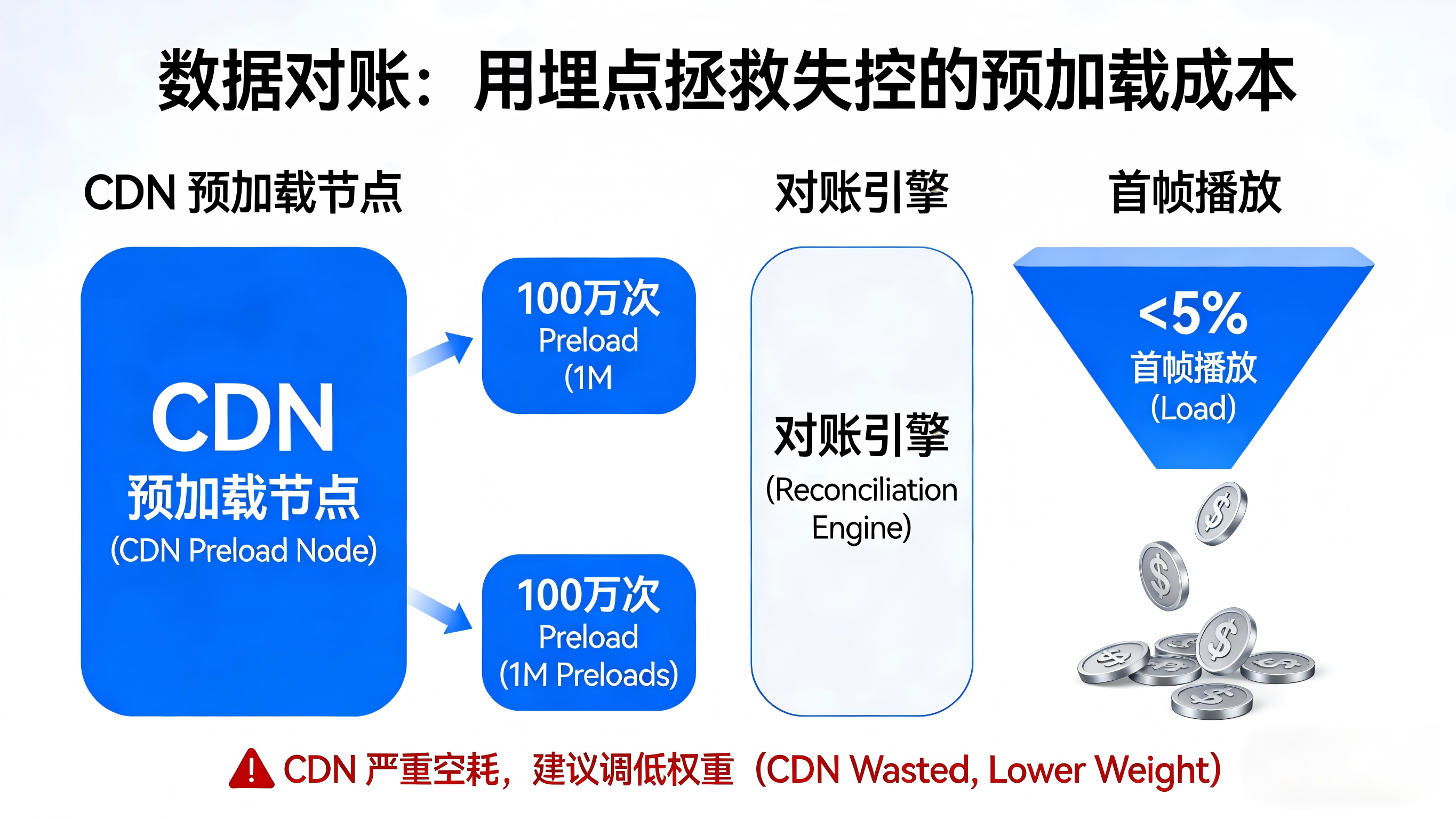

为了实现顺滑的“秒播”体验,前端技术团队会大量使用视频流预加载(Preload)。但如果没有埋点对账,这可能变成一场烧钱灾难。如果埋点报表发现,某类视频在信息流里的“预加载下发量”高达百万,但最终触发首帧播放的“实际点击率”不足 5%,就说明预加载策略过于激进,CDN 宽带正在被严重空耗。及时通过埋点修正预加载命中率,是点播业务降本增效的必经之路。

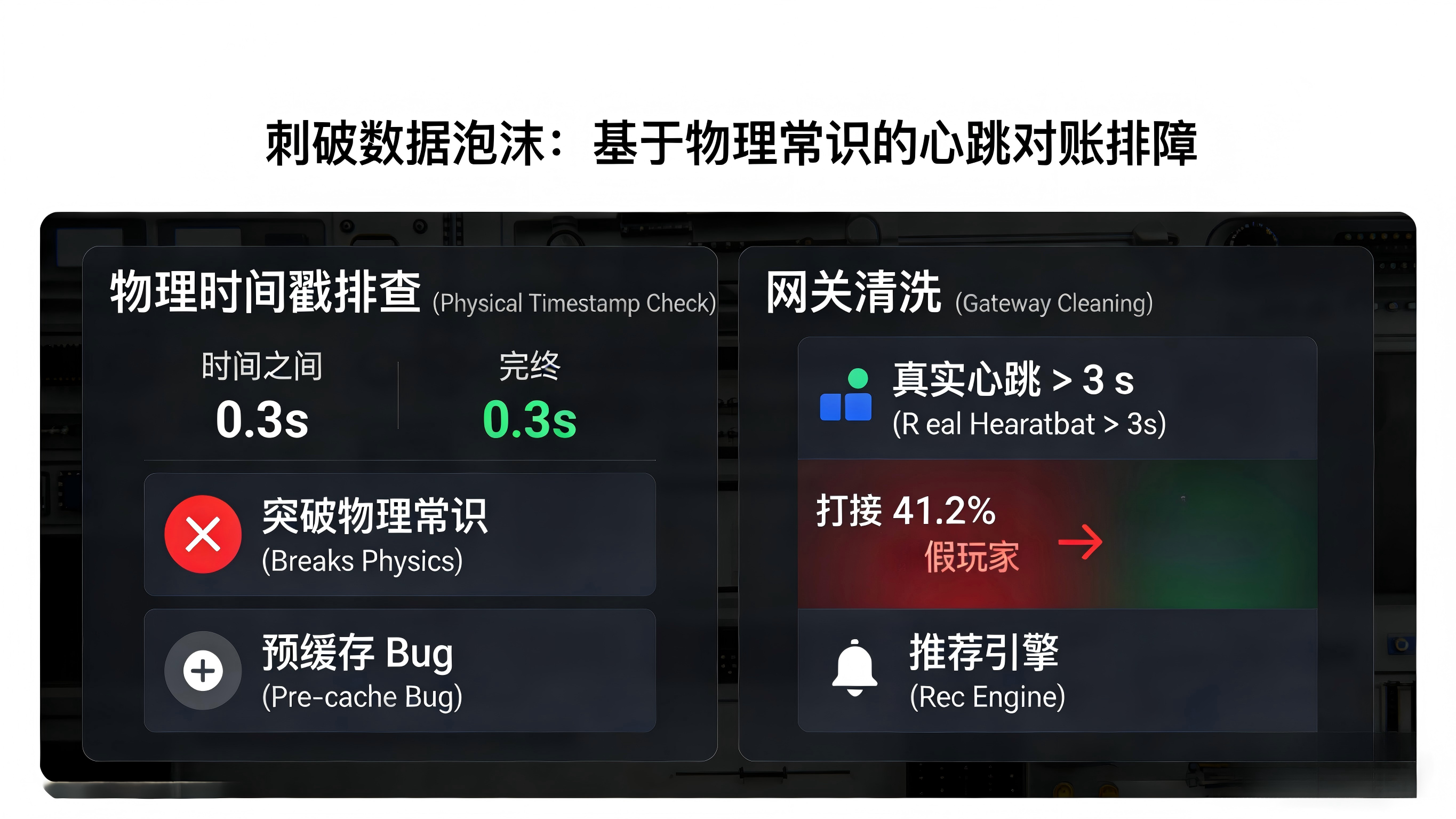

某视频点播 App 发布了含有“极速播放引擎”的新版后,后台大盘数据显示,短视频板块的单日完播率环比激增了 130%。然而,业务并未因此受益,由推荐算法分发的信息流点击率断崖式下跌,新用户的次日留存率更是跌破了历史底线。

研发数据团队介入后,直接拉取了异常时段的底层心跳与播放日志进行物理对账。

团队引入了一条物理常识约束:对于一段体积约 100MB 的 1080P 高清视频,在普通用户的 4G/5G 切换网络下,从点击指令下发到首帧缓冲完毕(Load),其物理耗时下限至少需要 1~2 秒。

然而,在海量暴涨的完播日志中,有数万台设备从上报“点击播放(Click)”到上报“播放完成(Finish)”,两次请求的时间戳间隔竟然不到 0.3 秒,完全突破了网络传输和正常播放的物理常识。

排查证实,这是客户端新引入的预缓存机制存在死循环 Bug——当视频在后台被静默缓存完成时,错误地直接触发了 video_finish 事件。

为了切断污染,技术团队在网关层紧急重构了校验逻辑:强制规定任何“完播”事件前,必须包含合法且间隔大于 3 秒的真实心跳(Ping)日志;对于时长小于物理播放极值的 Finish 请求,直接在流处理层丢弃。

补丁上线并重跑数据模型后,系统成功清洗拦截了约 41.2% 的异常播放与幽灵完播请求。过滤掉这层数据水分后,推荐模型重新接收到了人类真实交互的特征反馈,不仅错乱的分发权重被纠正,信息流的转化点击率和留存率也在两周内稳步回升了约 18.5%,避免了虚假繁荣导致的算法崩溃。

视频点播的心跳埋点频率设多大合适?会不会很耗电?

心跳频率需要按场景分级处理。对于短于 1 分钟的短视频,通常不设心跳或仅设为 3 秒一次;对于长视频,行业经验是设置为 15 到 30 秒。为了避免频繁唤醒基带导致耗电与网络拥堵,心跳日志应当在客户端本地内存中积攒打包,达到阈值后再批量异步上报。

长视频和短视频的埋点策略有什么核心区别?

短视频的生命周期极短,埋点重心应放在“划屏手势(Swipe)”、“停留毫秒数”和“循环播放次数(Loop)”上;而长视频的内容纵深大,埋点侧重点要向“倍速切换(Speed)”、“清晰度调整”、“画中画(PIP)模式切入”以及高频的“快进拖拽(Seek)”倾斜,以此来判断深度的内容消费质量。

用户从 Web 端分享页跳转到 App,点播数据断层怎么解决?

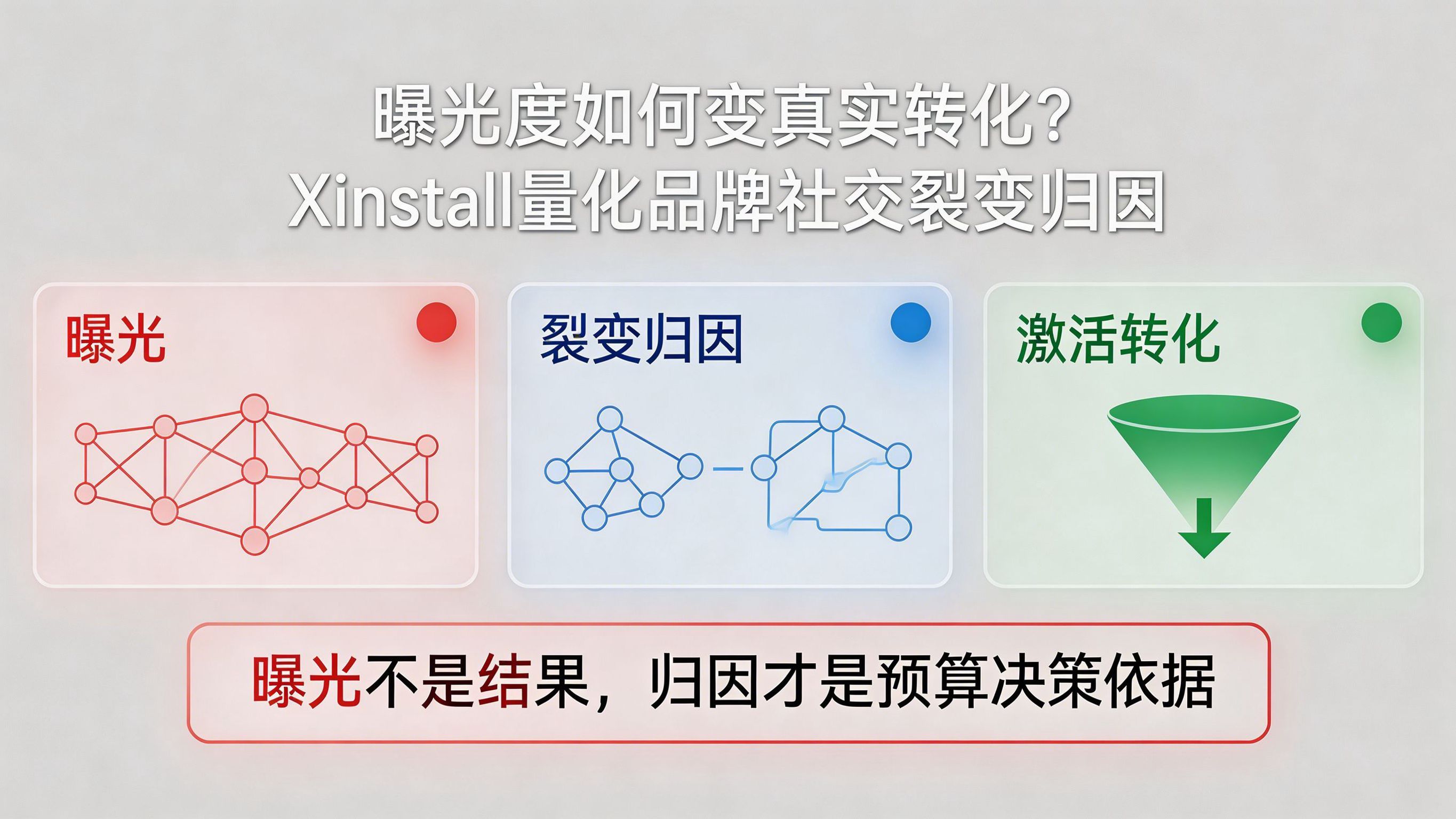

这是点播平台裂变拉新时最痛的断点。为了精确追踪分享转化漏斗,必须在分享链接中携带视频 ID 与用户属性。业界主流解法是采用 全渠道归因统计 等成熟方案,在 Web 页端提取设备参数,并在用户首次下载启动 App 时,瞬间完成参数的跨端还原。这样就能保证新用户的第一次播放行为,被精准归因到具体的推广渠道与分享者头上。行业延伸阅读

随着终端算力的提升和隐私新规的落地,端侧归因与边缘计算正在视频流统计中发挥更大作用。无论是通过心跳机制夯实播放时长,还是通过多端参数传递打通漏斗,都是为了把业务焦点从“播放器亮没亮”,真正转移到“观众看没看进去”这一核心商业价值上。

上一篇

上一篇

Xinstall联调实录:android应用商店渠道归因对账指南

2026-05-09

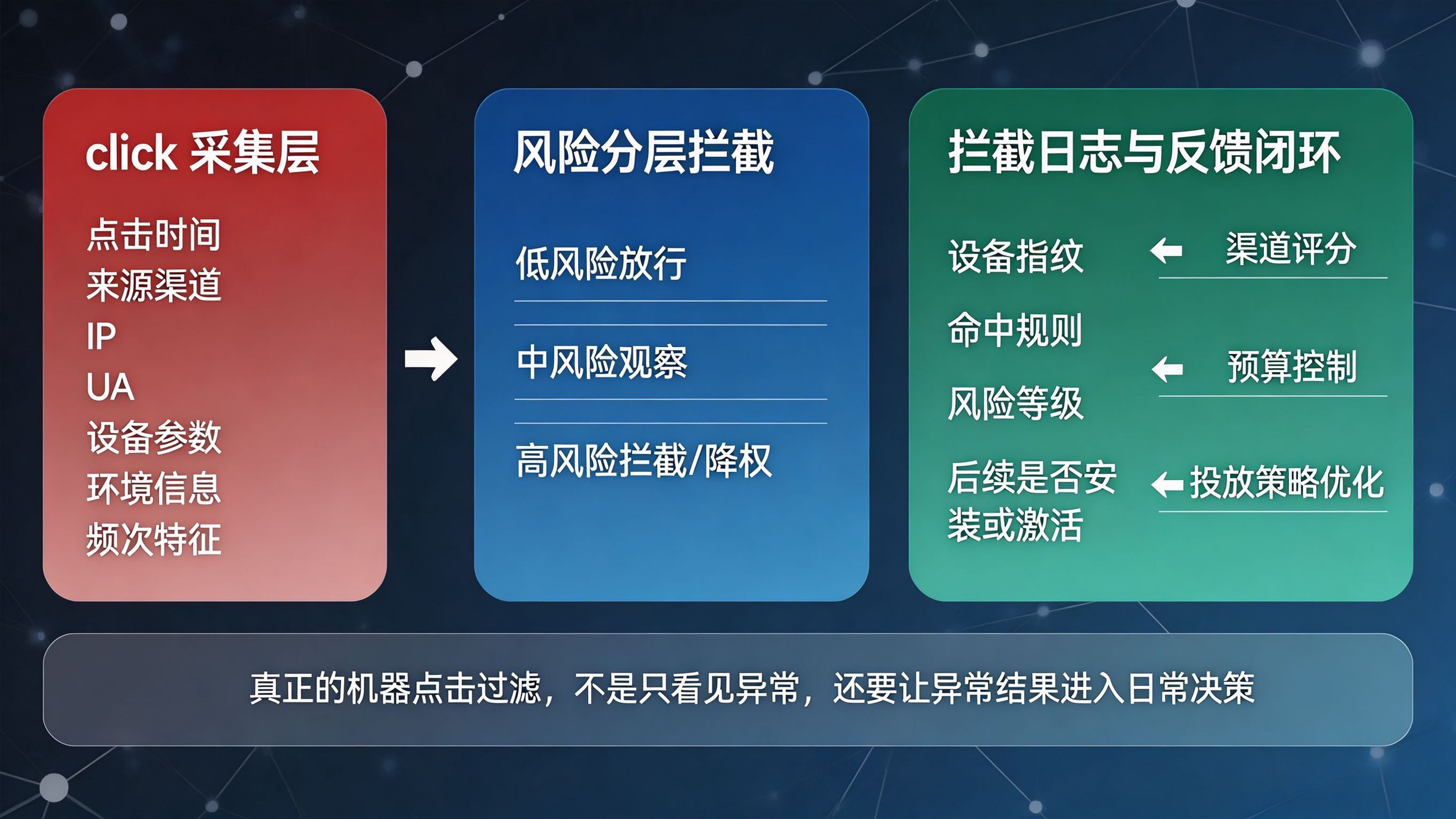

机器点击过滤如何实现?风控引擎拦截黑产刷量与物理校验

2026-05-09

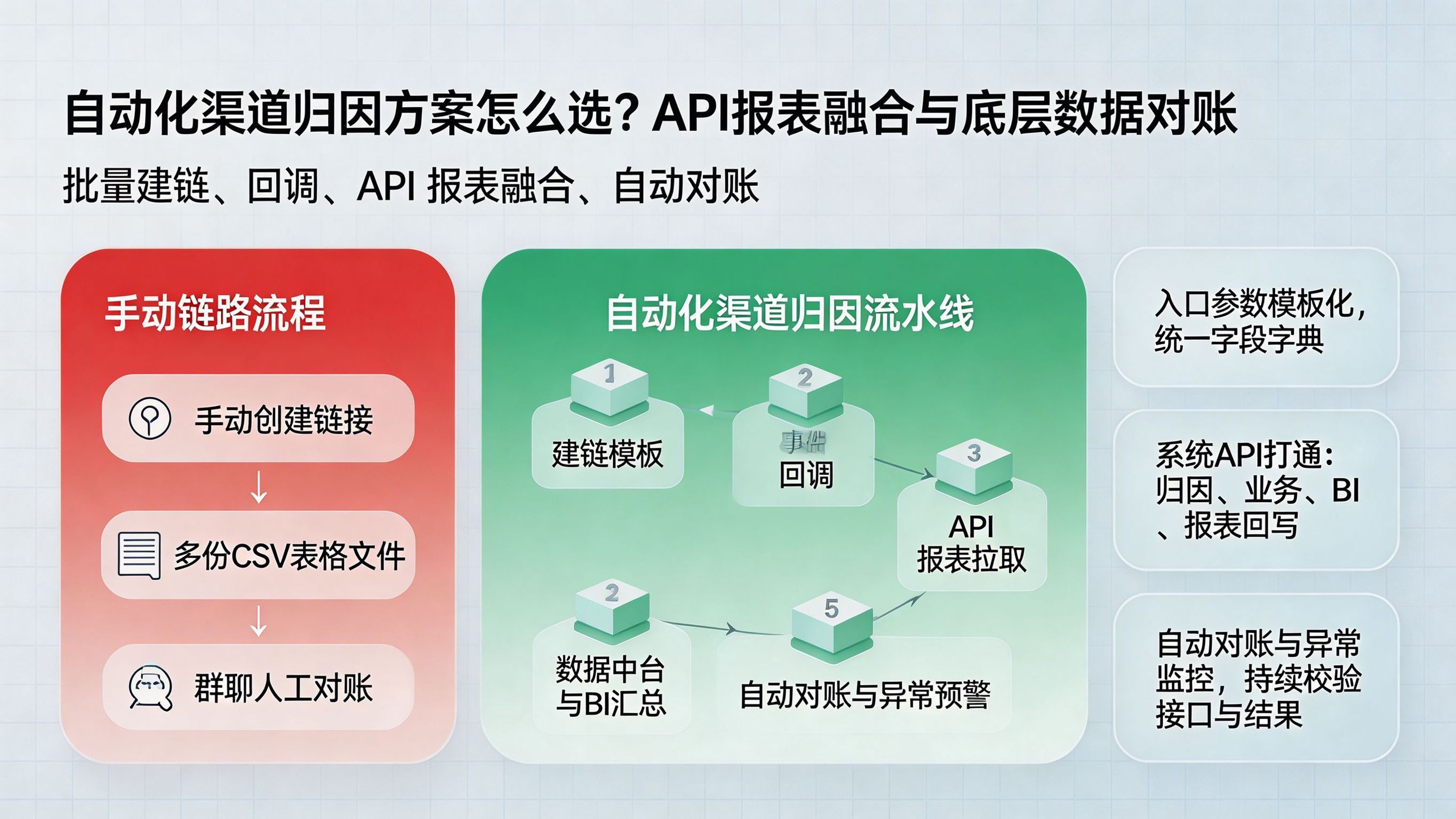

自动化渠道归因方案怎么选?API报表融合与底层数据对账

2026-05-09

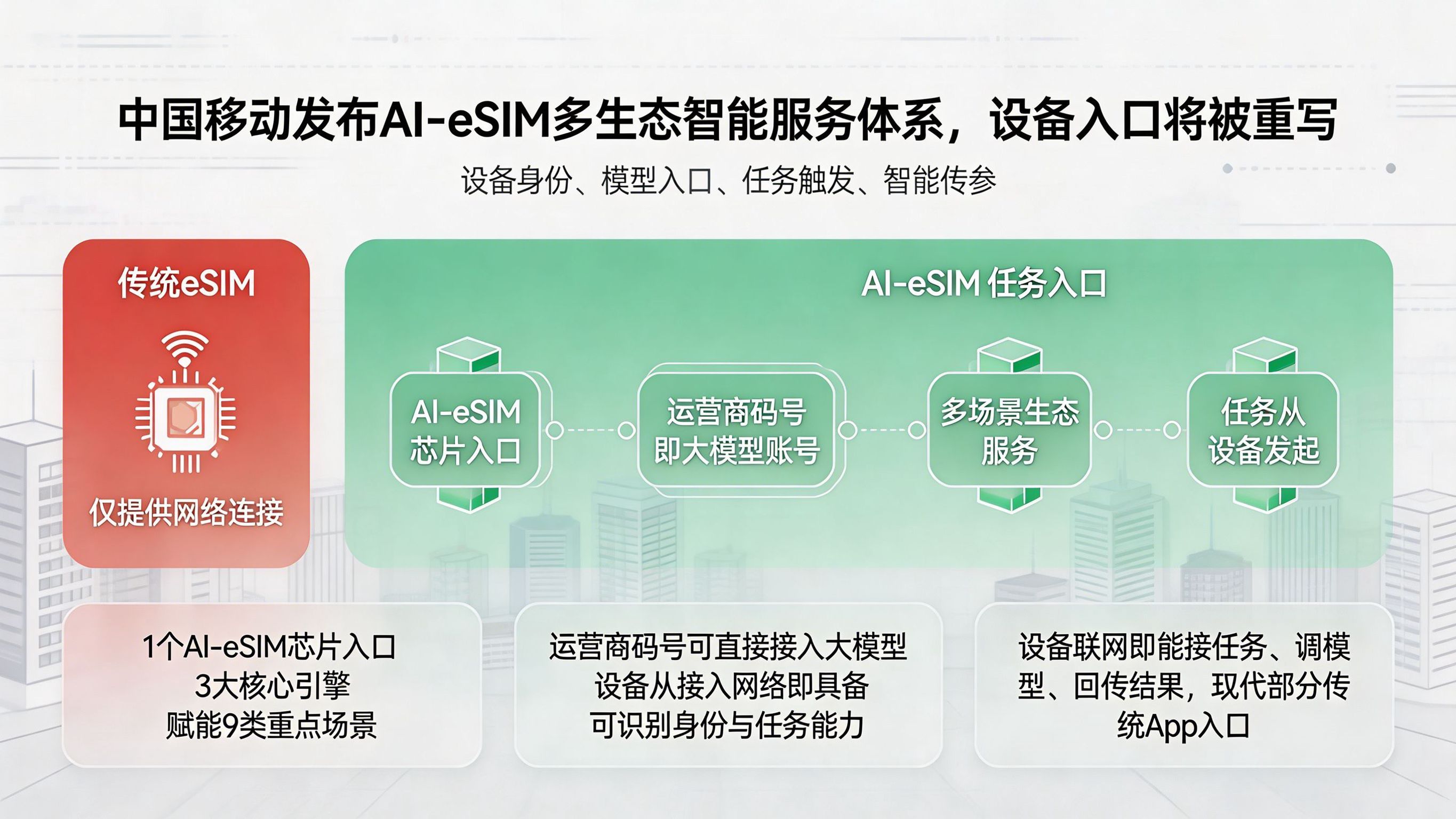

中国移动发布AI-eSIM多生态智能服务体系?Token入口升温,终端生态面临重排。

2026-05-09

终端入口:英特尔与苹果据悉达成初步协议,设备分发格局会变吗?

2026-05-09

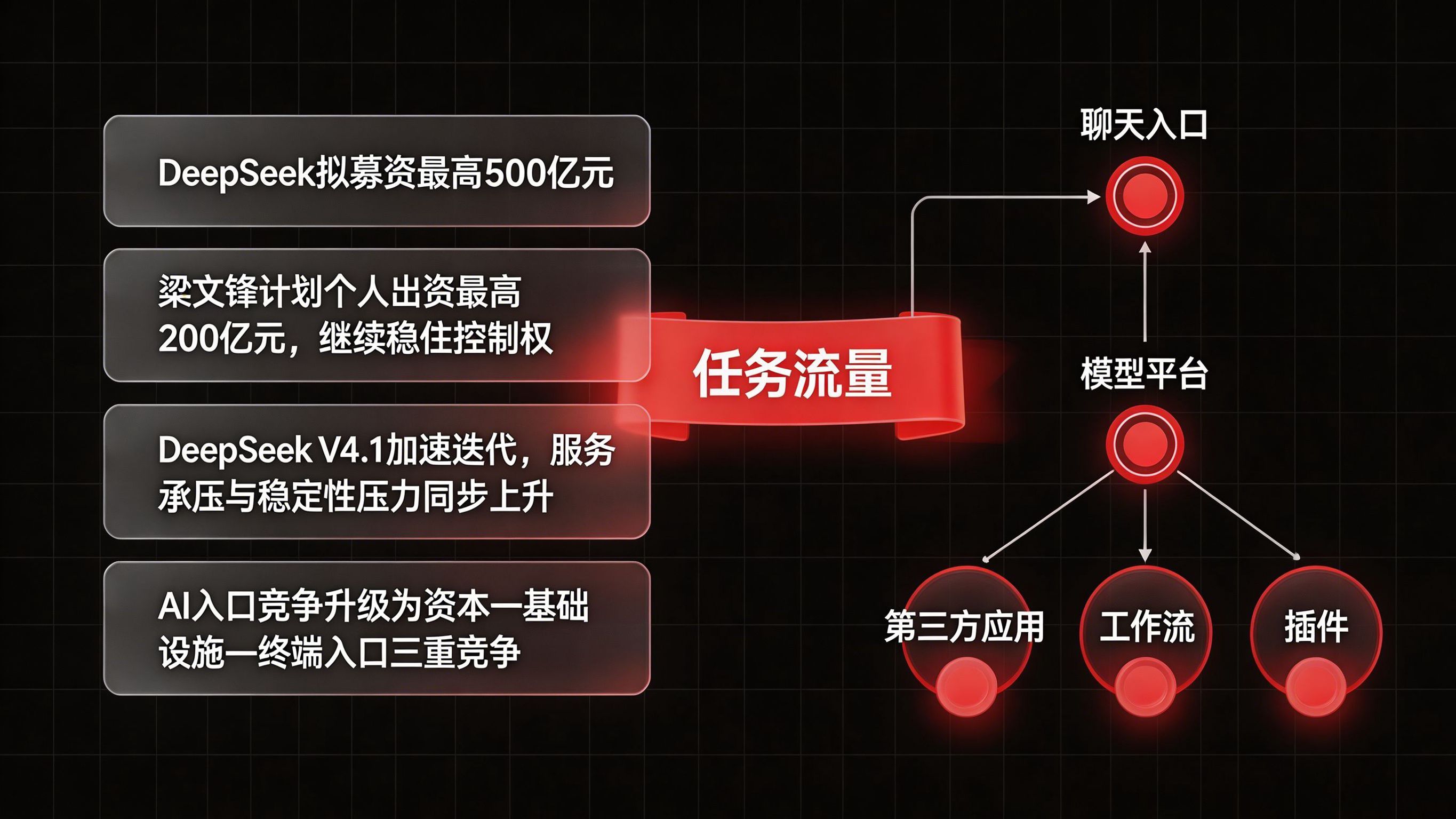

DeepSeek拟募资最高500亿,资本狂潮加速:AI入口竞争怎么变?

2026-05-09

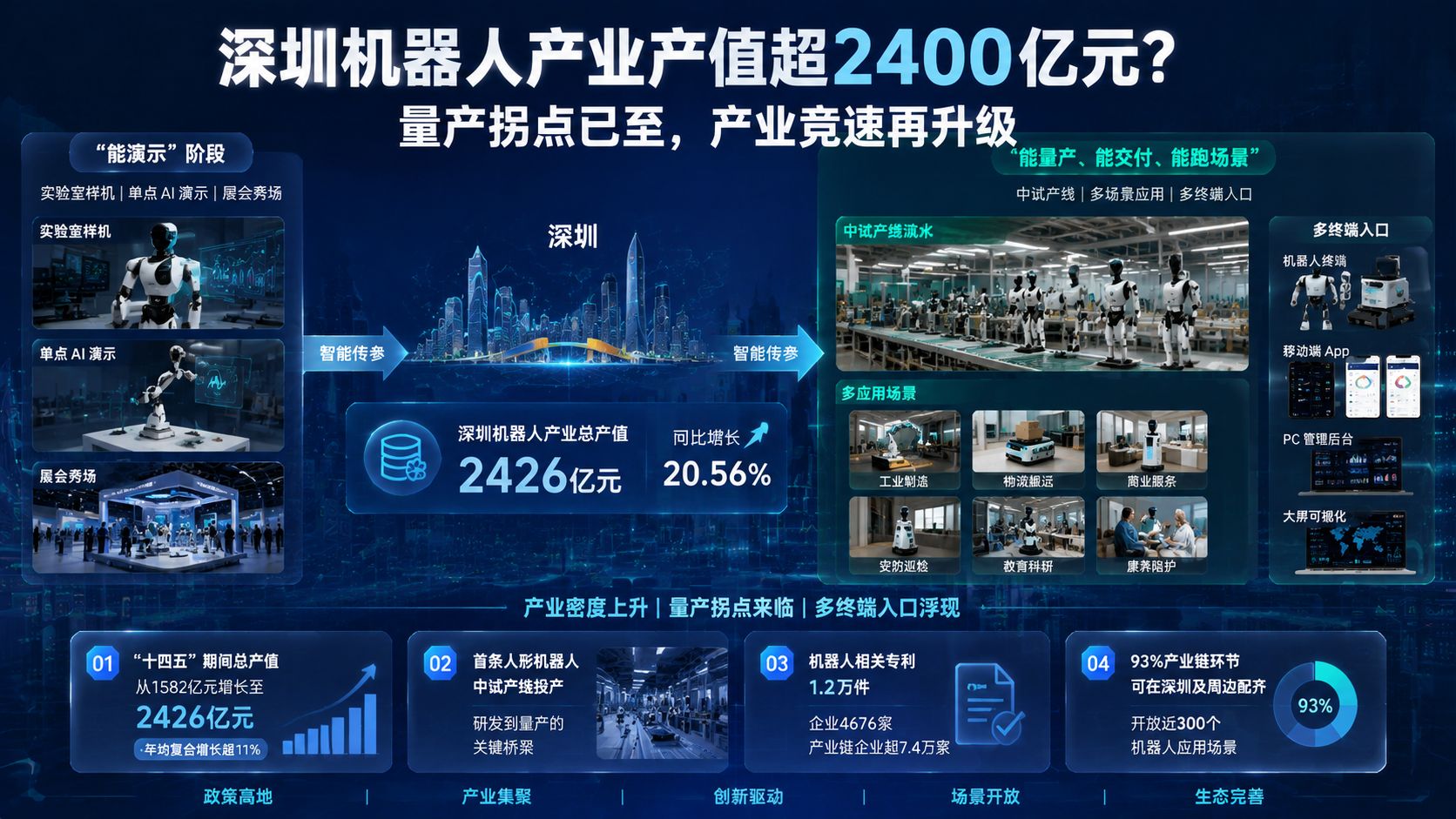

深圳机器人产业产值超2400亿元?量产拐点已至,产业竞速再升级

2026-05-08

数据可视化工具哪个好用?一键自动生成App渠道报表

2026-05-08

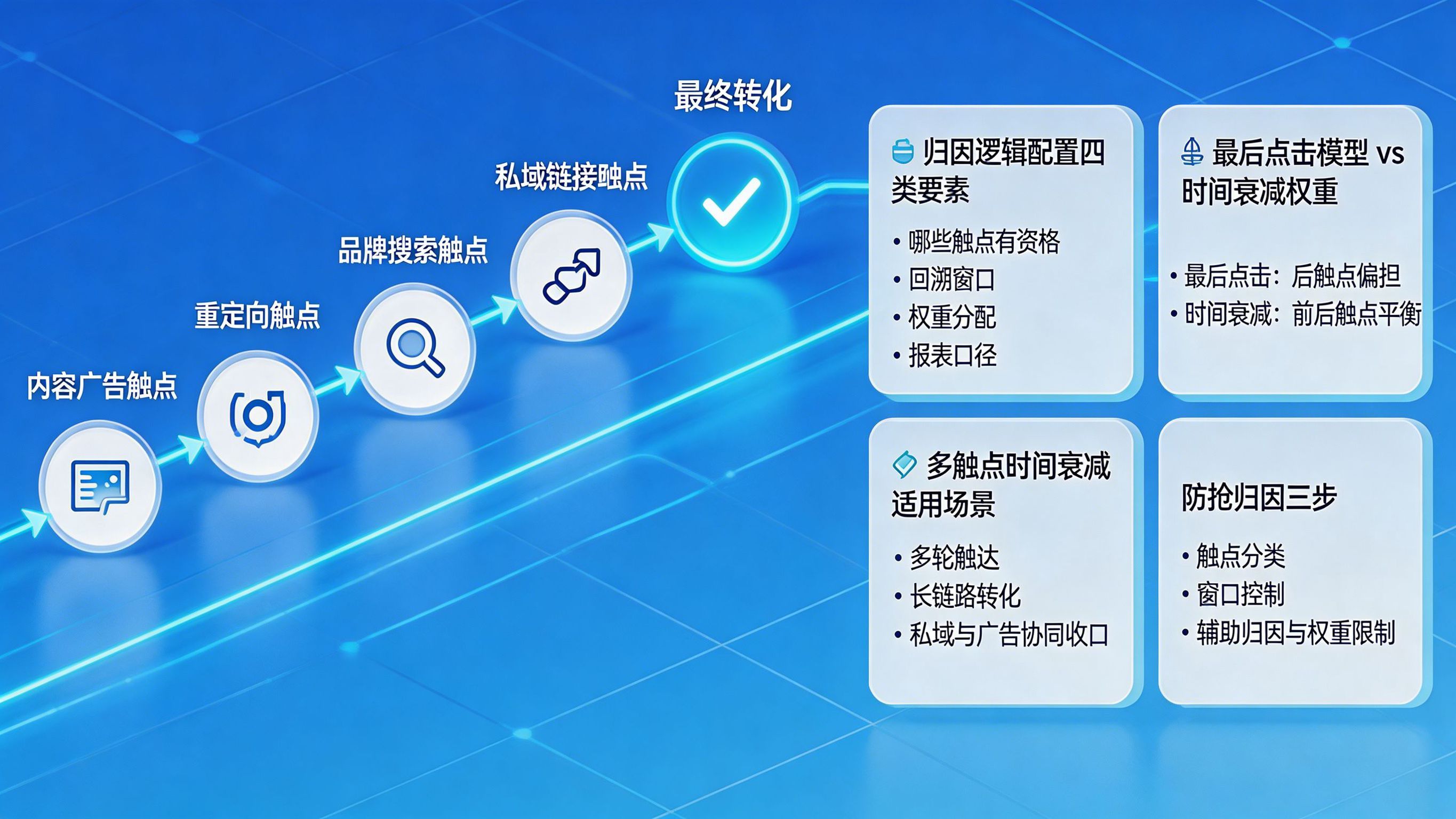

归因逻辑配置怎么做?多触点时间衰减权重与防抢归因实战

2026-05-08

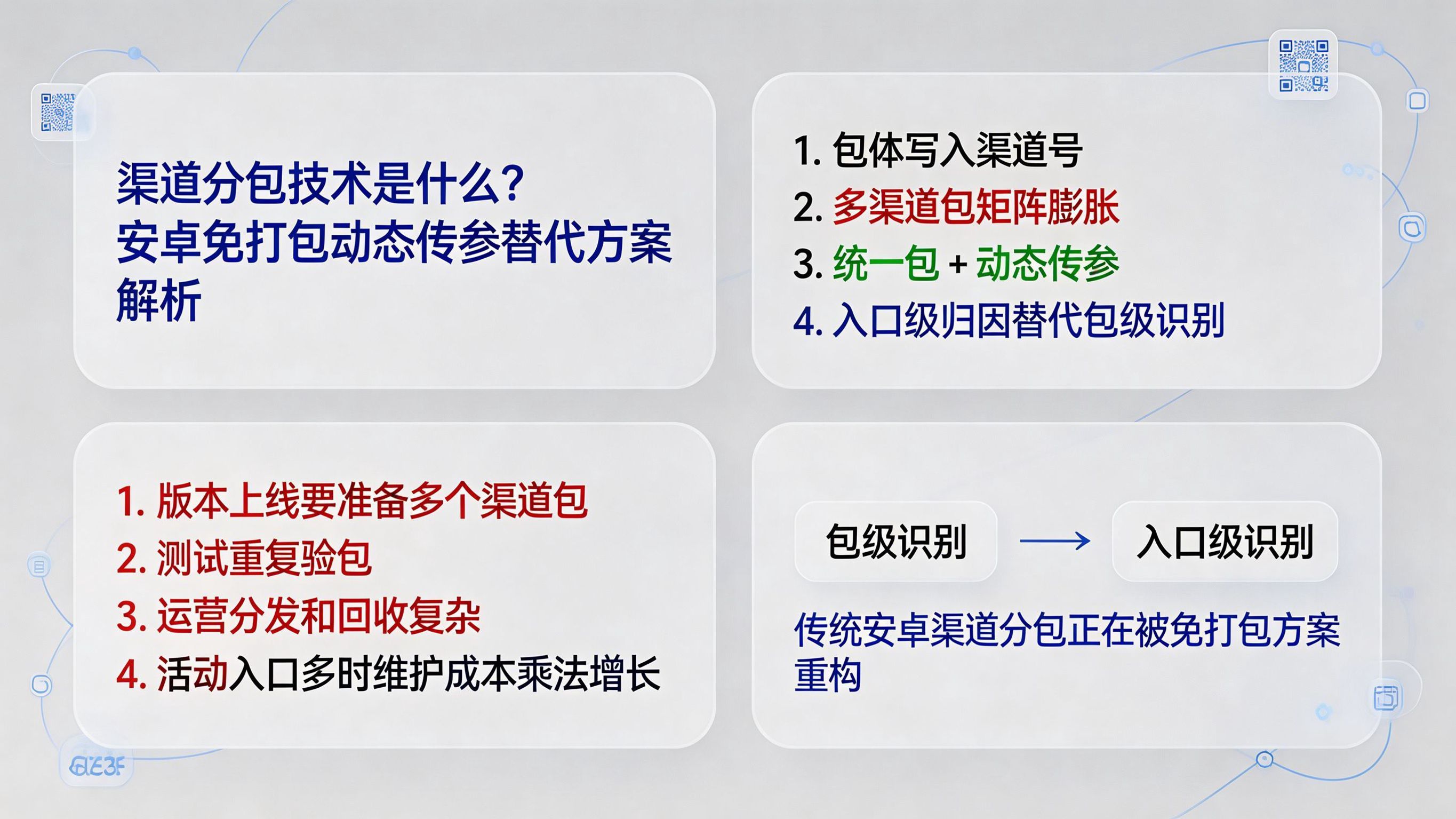

渠道分包技术是什么?安卓免打包动态传参替代方案解析

2026-05-08

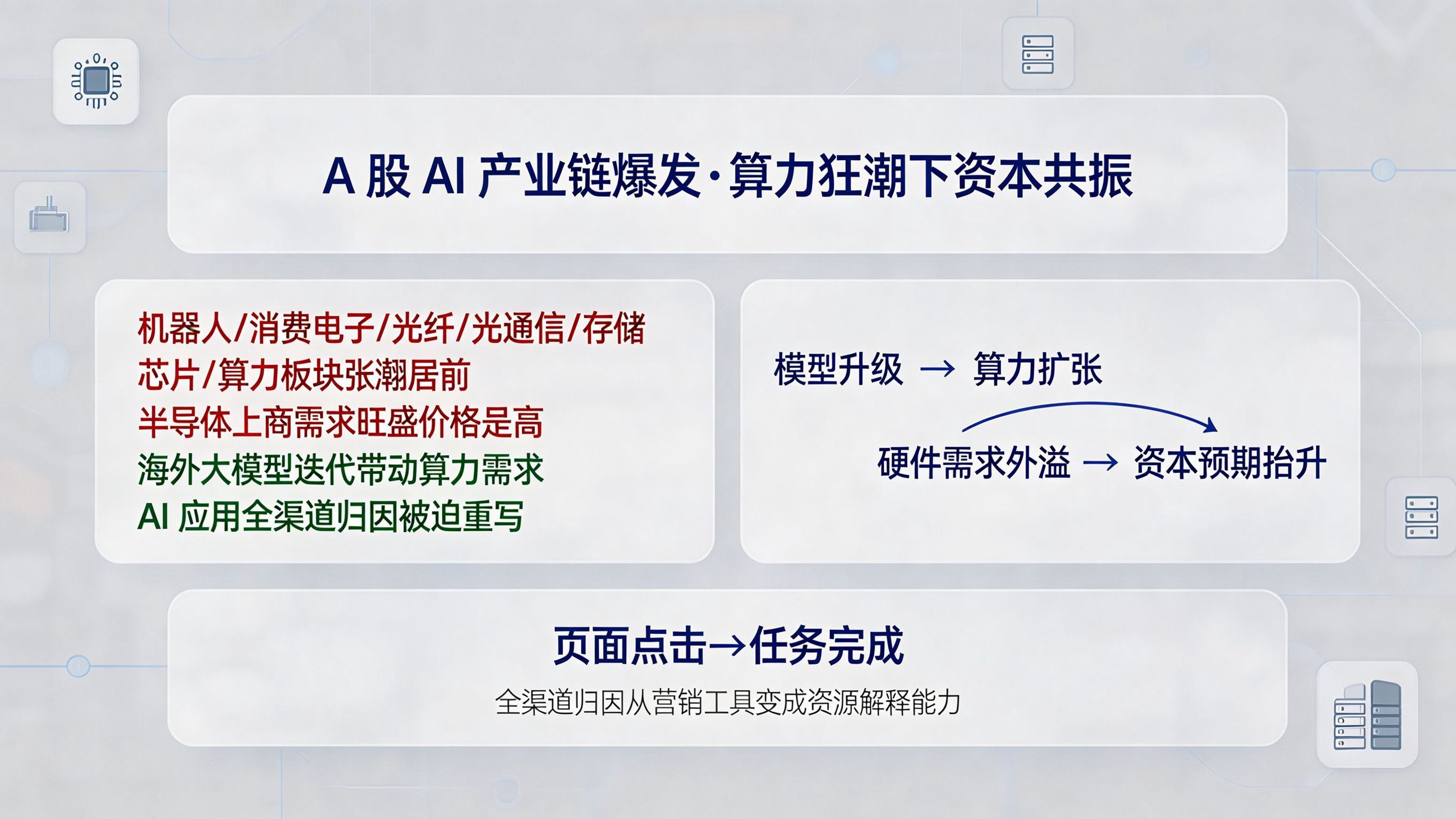

A股AI产业链爆发原因:算力狂潮下,资本共振还能走多远?

2026-05-08

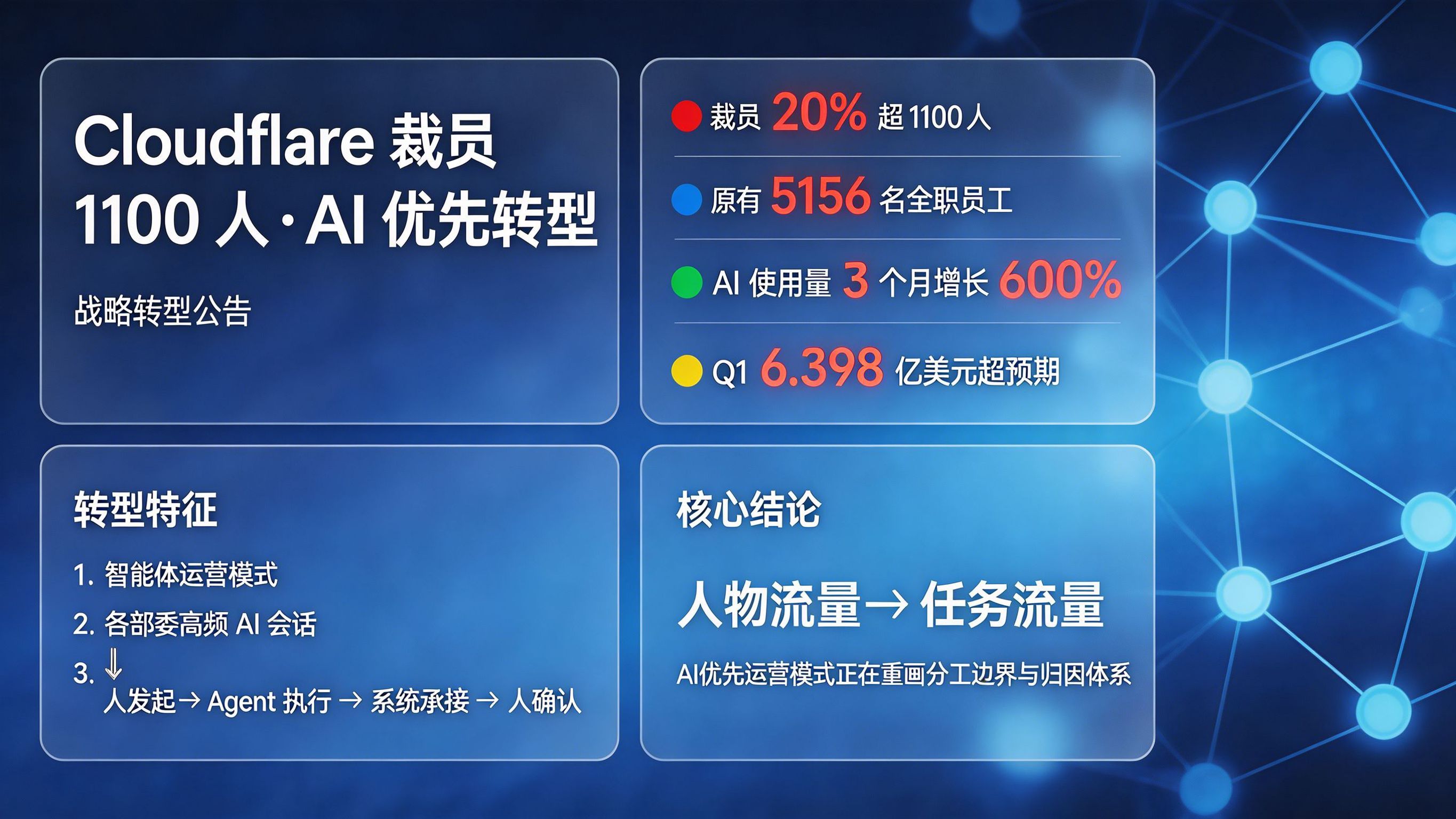

Cloudflare裁员超1100人?AI优先转型下,组织效率面临重估

2026-05-08

可信联系人:OpenAI推ChatGPT新机制,AI风险外联怎么做?

2026-05-08

宇树UniStore官方共享应用平台正式全面开放:机器人应用商店兴起后,任务流量如何识别来源?

2026-05-07

曝光度如何变真实转化?Xinstall量化品牌社交裂变归因

2026-05-07