手机微信扫一扫联系客服

469

469GPT‑5.4 被工程师在 GitHub 和 Codex 界面“意外泄露”,传闻 200 万 token 上下文、跨会话持久状态和全分辨率视觉直读,将从聊天工具跃迁为“全自动代理”。本文写给开发者和增长团队:在模型频繁换代、多模型并存的时代,App 不该一味追新,而要先把接入层、ChannelCode 和事件归因抽象好,让每一次“换模型”都能被看得清、算得明。

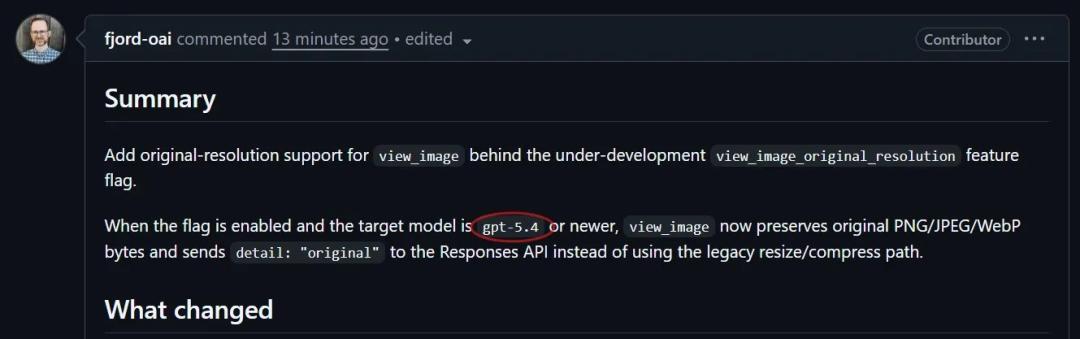

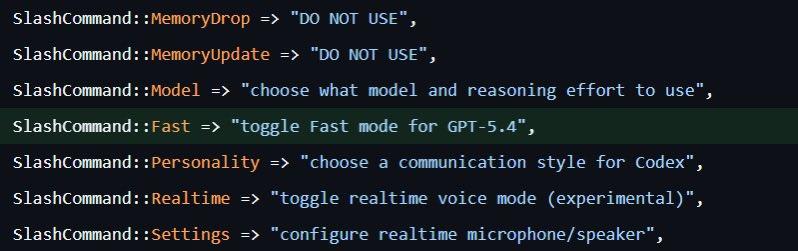

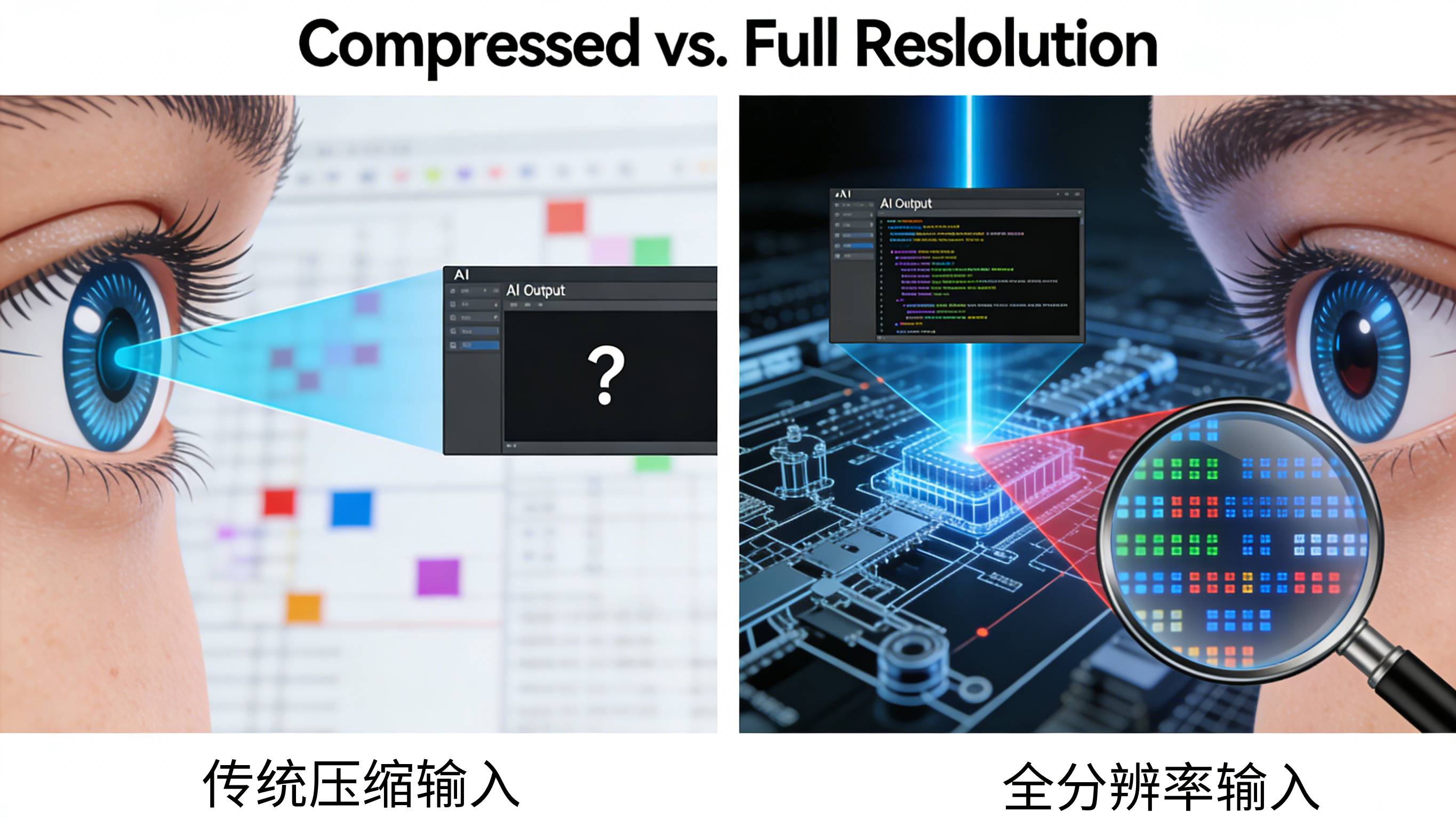

OpenAI 工程师在 Codex 的 GitHub 仓库里,不小心把「gpt‑5.4」写进了版本判断条件,又在应用的模型下拉菜单里短暂暴露了 “alpha‑gpt‑5.4”,几小时后匆忙回滚成 gpt‑5.3‑codex,相关帖子也被删除,新智元、机器之心和量子位都用“意外泄露”来形容这次风波。某博主指出,这些“擦痕”让坊间对 GPT‑5.4 正在内部测试、甚至近期上线的猜测可信度陡增。更刺激开发者的是传闻中的两大杀手锏:高达 200 万 token 的上下文窗口 + stateful AI(跨会话持久状态),以及可以绕过压缩、直接读取原始分辨率图像字节的全分辨率视觉输入。把这次升级解读为“从聊天机器人迈向真正的自动代理员工”的关键一跳。

对 App 和 B2B 产品来说,GPT‑5.4 这样的新模型当然令人兴奋,但在多模型版本频繁迭代、OpenAI 和谷歌隔三岔五就“掀桌”的节奏下,如果你的接入和归因还停留在“每换一个模型就写一堆 if/else,报表上只看到一个模糊的『AI 功能』曲线”,那追新追到最后,很可能只是给别人打工:花时间改接入、花钱买 token,却说不清楚到底哪个模型组合真正撑起了转化和留存。在这种背景下,更务实的做法,是先把接入和归因抽象好,再谈追新。

综合新智元、机器之心等多家媒体的梳理,这次 GPT‑5.4 的关键点集中在“记忆”和“状态”两件事上:

上下文窗口被传为高达 200 万 token:

这意味着可以一次性吞下大量代码仓库、长文档、多轮对话历史,而不必频繁“换对话框”;

真正有价值的是在极长上下文内仍保持较高的检索和推理准确率,而不是纯粹堆数字。

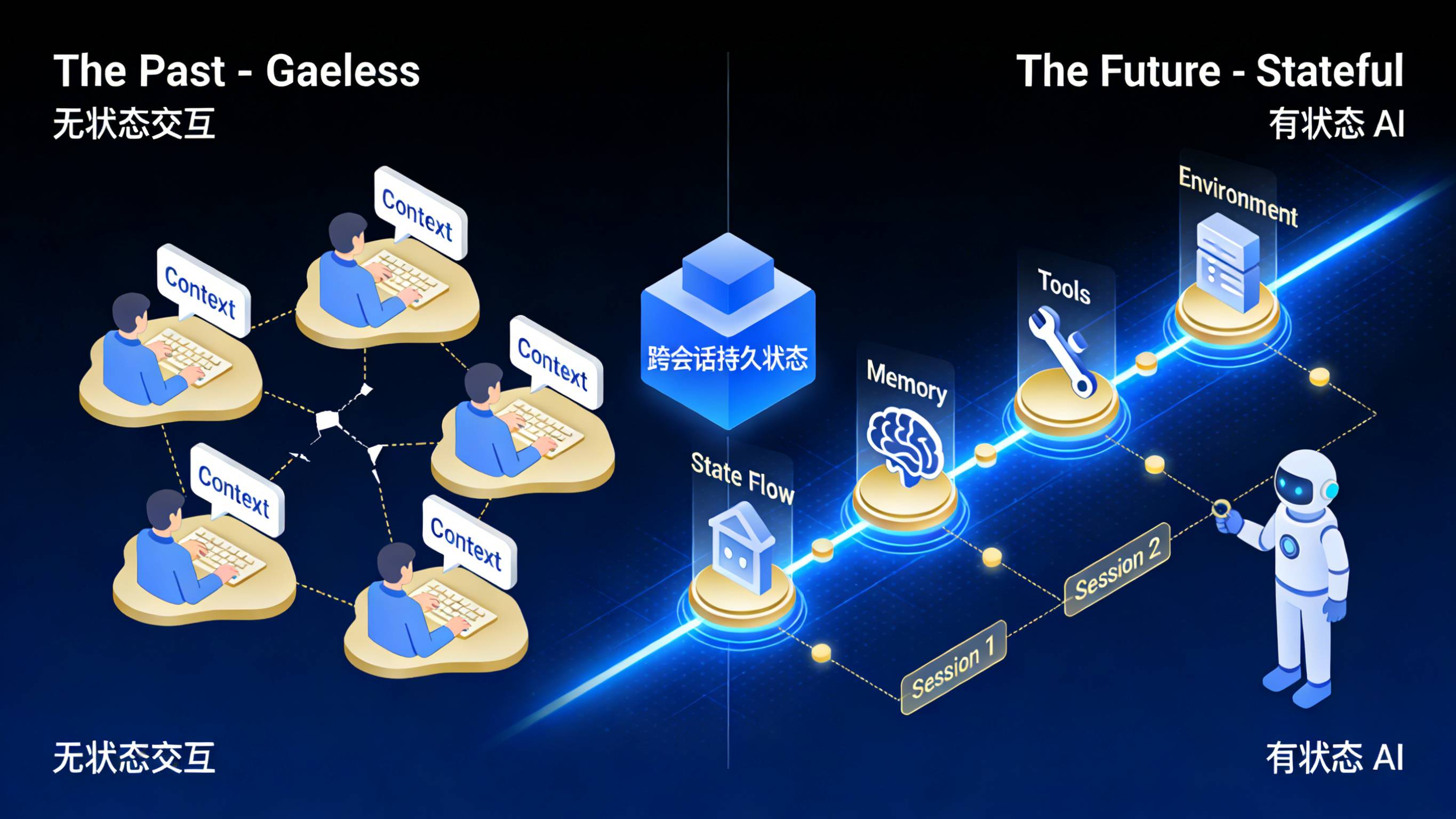

有状态 AI(stateful AI):

不再局限于“当前会话里记得你说过什么”,而是能在不同会话之间保留工作流、环境配置乃至工具调用状态;

对开发者来说,模型可以随时“接着上次的开发节奏和调试环境往下走”,不用每次新建会话都当复读机交代背景。

这让模型从“问一句、答一句的聊天对象”,变成了“认识你项目上下文、记得你偏好和代码结构的常驻协作伙伴”,离“真正的 AI 同事 / Agent 员工”又近了一步。

另一条重要线索来自被挖出的 feature flag:

OpenAI 在 Codex 的 PR 里提到一个 view_image_original_resolution 功能开关,当目标模型为 gpt‑5.4 或更高版本时,可以绕过传统图像压缩,直接让模型读取全分辨率的原始图像字节。

量子位的报道举例称,这意味着前端工程师和设计师可以直接丢极其精细的 UI 设计稿或复杂工程原理图给模型,模型可以在像素级别进行分析,而不是对模糊压缩图胡编乱造。

这对图形界面、工业设计、医学影像、地图和复杂图表等场景非常关键:

过去你必须做强预处理、抽特征、降采样,模型看到的是“压缩后的近似世界”;

现在有机会让模型直接看到原始细节,从而支持更精细的理解和生成。

对 App 来说,这意味着:UI/原型评审、可用性分析、复杂报表解读、图像搜索等功能模块,都有可能因为全分辨率输入而被重写。

这次 GPT‑5.4 的“意外泄露”,本质上延续了过去一年里几家头部模型厂商的节奏:

OpenAI:从 GPT‑4.x 到 GPT‑5.x 再到一堆子型号(Flash、Pro、Codex 等),产品线不断拉长;

谷歌:Gemini 3.x 系列高频更新,不断在速度/价格/能力上调整位置;

Anthropic、MiniMax 等也在用 Sonnet、Haiku、M2.5 之类的组合抢占不同价位档。

对大多数 App 和 SaaS 来说,真实日常是:

接入时写了一堆“如果是 gpt‑5.2 就走这条逻辑,如果是 3.1 就那样 fallback”;

每次平台上新一个版本,研发要重新评估、调参、改代码、发版;

在报表上,只看到一个叫“AI 助手”的功能 PV/UV/转化,但看不到背后哪一个模型、哪一种组合在发挥作用。

如果继续沿着这种“每上一个新模型就手动接一次”的路径走下去,GPT‑5.4 这种代际升级越多,你的技术债和统计噪音就越多。

很多团队现在的埋点和报表,仍然停留在:

“AI 功能使用次数”,或者“AI 助手带来的订单量”;

最多再按“国家/渠道/版本号”拆一拆。

在多模型环境下,这其实制造了一个很大的幻觉:

你看到“AI 功能整体曲线在上升”,以为是“功能越来越受欢迎”;

但实际上,有可能只是因为你换成了一个更快的模型、调整了价格、或者平台侧给你推了更多免费调用;

哪一个模型组合真正推动了留存和付费,很难用这类粗粒度报表看出来。

多模型时代的关键,不是“拼谁接得多”,而是:用统一的接入与归因抽象,让你能随时回答“哪一种模型/参数/价格组合,在什么流量下,真正创造了价值”。

从工程角度,最直接的建议是:不要在业务代码里到处写具体模型名。你可以:

抽象出一层“模型网关”或“LLM Provider”,对外只暴露逻辑名称,比如:

MODEL_LOGIC_FAST_CHAT

MODEL_LOGIC_DEEP_REASONING

MODEL_LOGIC_LONG_CONTEXT

MODEL_LOGIC_FULL_RES_VISION

在这层网关里,根据配置(而不是写死)映射到具体模型:

今天 MODEL_LOGIC_LONG_CONTEXT 映射到某个 Gemini/Claude;

明天你可以把它切到 GPT‑5.4,而上层调用不动。

同时,在这个网关层:

统一埋点:

每一次调用记录逻辑模型名、实际模型名、版本、温度、max_tokens、上下文长度等;

与 ChannelCode 结合:

把“这次调用来自哪个渠道的用户,用的是哪种模型逻辑”一起打到事件里。

这样,当你上线 GPT‑5.4 或其他新模型时:

不需要改散落在业务里的大量 if/else,只改配置或极少的适配代码;

可以很快做 A/B:同一逻辑模型名下,把一部分流量切到 GPT‑5.4,看真实指标变化。

多模型场景不是孤立存在的,它一定叠加在不同渠道来的用户上:

有的渠道是“高意图 B 端用户”,更适合用贵但稳的模型;

有的是“轻度 C 端用户”,用便宜快的模型就够了。

这时,ChannelCode 的作用是:

让你在事件层同时知道:

流量是从哪里来的(渠道、活动、场景);

当前请求用了什么逻辑模型(fast / deep / long_context / full_res_vision)。

例如,你可以设计类似的组合字段:

channel=SEO-AI-WORKFLOW-ARTICLE + model_logic=LONG_CONTEXT;

channel=PAID-ADS-TRIAL-ENTRY + model_logic=FAST_CHAT;

channel=PARTNER-INTEGRATION-OPENCLAW + model_logic=AGENT_TOOLING.

这样,当你把 LONG_CONTEXT 或 FULL_RES_VISION 映射到 GPT‑5.4 时,后续在数据仓里就可以:

分渠道对比“GPT‑5.4 上线前后”指标变化;

确认在某些渠道/场景下,新模型带来的提升是否配得上成本增加;

而不是只看到“整体指标有点变好/变坏”,但说不清原因。

在事件模型上,建议至少为每次 LLM 调用增加以下维度:

模型维度:

model_logic(你的逻辑名,例如 LONG_CONTEXT / FAST_CHAT);

model_vendor(openai / google / minimax / deepseek 等);

model_name(gpt‑5.2‑pro、gpt‑5.4、claude‑4.6 等);

model_version(内部自定义版本号,用来区分配置变化)。

场景维度:

scene(文案生成 / 代码补全 / 报表分析 / UI 评审 / Agent 工作流);

channel(前文的 ChannelCode);

entry(功能入口,比如“首页 AI 按钮”“文档右侧悬浮条”“聊天窗口快捷指令”等)。

这些字段不需要全部一开始就做到极致,但至少:

每次调用有一个清晰的 model_logic 和 model_vendor;

能把结果(成功/失败/时延/费用/用户行为)与这些维度关联起来。

等 GPT‑5.4 真正上线时,你就可以:

对比“同一个场景下,不同模型逻辑 + 供应商组合”的表现;

找出真正的“甜点组合”:例如 “低成本模型 + 特定提示 + 小工具 + 限制上下文” 就足够解决 80% 的问题。

在数据仓或 BI 工具中,可以为多模型接入专门做一张看板,关注:

按模型逻辑划分的核心指标:

成功率、平均响应时间、平均 token 成本;

用户行为(功能完成率、二次使用率、转化);

按模型供应商 + 版本划分的表现:

在相同 model_logic 和 scene 下,哪家的模型组合表现更好;

按渠道 + 模型逻辑组合划分的表现:

某些渠道可能更适合“轻量快答”,另一些更适合“深度解析”。

这样,当你考虑是否要在某个场景、某条渠道上全面切换到 GPT‑5.4 时,可以基于真实数据而不是单纯的“发布会震撼”和“朋友圈风评”做决策。

对产品和增长来说,GPT‑5.4 这样的新模型当然值得尝试,但它本质上应该被视为:

你现有增长和产品策略中的一个“优化算子”;

而不是“新的增长战略本身”。

换句话说:

你的核心增长问题依然是:谁是高价值用户?他们从哪里来?在什么场景下真正需要 AI?

GPT‑5.4 只是在既定场景中,把“解决问题的质量、速度和成本曲线往前推了一点”。

如果没有 ChannelCode、智能传参与事件模型这些基础设施支撑,你即便接上了 GPT‑5.4,也很难说清:

到底是新模型带来的提升,还是你顺手做了交互优化;

哪条渠道和哪种场景组合,真的最适合用它。

最后一点建议:

尽量不要为多模型接入另起炉灶搞一套“专用实验系统”;

而是把“模型逻辑和供应商”当成你现有 A/B 框架中的一个实验维度。

例如:

在现有实验平台中,把 model_logic=LONG_CONTEXT 下的 10% 流量切到 GPT‑5.4,其余留在现有模型;

用同一套指标体系(转化、留存、满意度等)评估效果;

如果表现稳定优于 baseline,再滚动扩大流量。

这样,你在“追新”的同时,也能保持整个指标体系的连续性,不会出现“因为换了一次模型,所有历史数据都难以对比”的尴尬。

在 GPT‑5.4 真正官宣、放量之前,对大多数 App 和 B 端产品来说,最值得投入的是三件基础工程:

抽象一层“模型网关/适配层”,用逻辑名而不是写死具体模型名,让每一次模型更新都变成配置和少量适配,而不是全线重构。

用 ChannelCode 和智能传参,把“不同渠道 + 不同模型逻辑”的组合清晰打在事件里,确保每一次“换模型”的效果都能在统一报表中被看清。

在数据仓和实验平台里,为多模型接入留出一块“效果看板”和实验维度,让你可以用现有指标体系评估 GPT‑5.4 这样的新版本,而不是被发布会节奏左右。

上一篇

上一篇

Embedding怎么提升推荐效果?用户意图表示实战

2026-06-02

跨平台获客归因如何实现?打通网页与应用归因

2026-06-02

二维码渠道追踪有什么优势?一人一码技术解析

2026-06-02

天猫618开门红破亿品牌大增40%?效率升级持续戳破虚假营销泡沫

2026-06-02

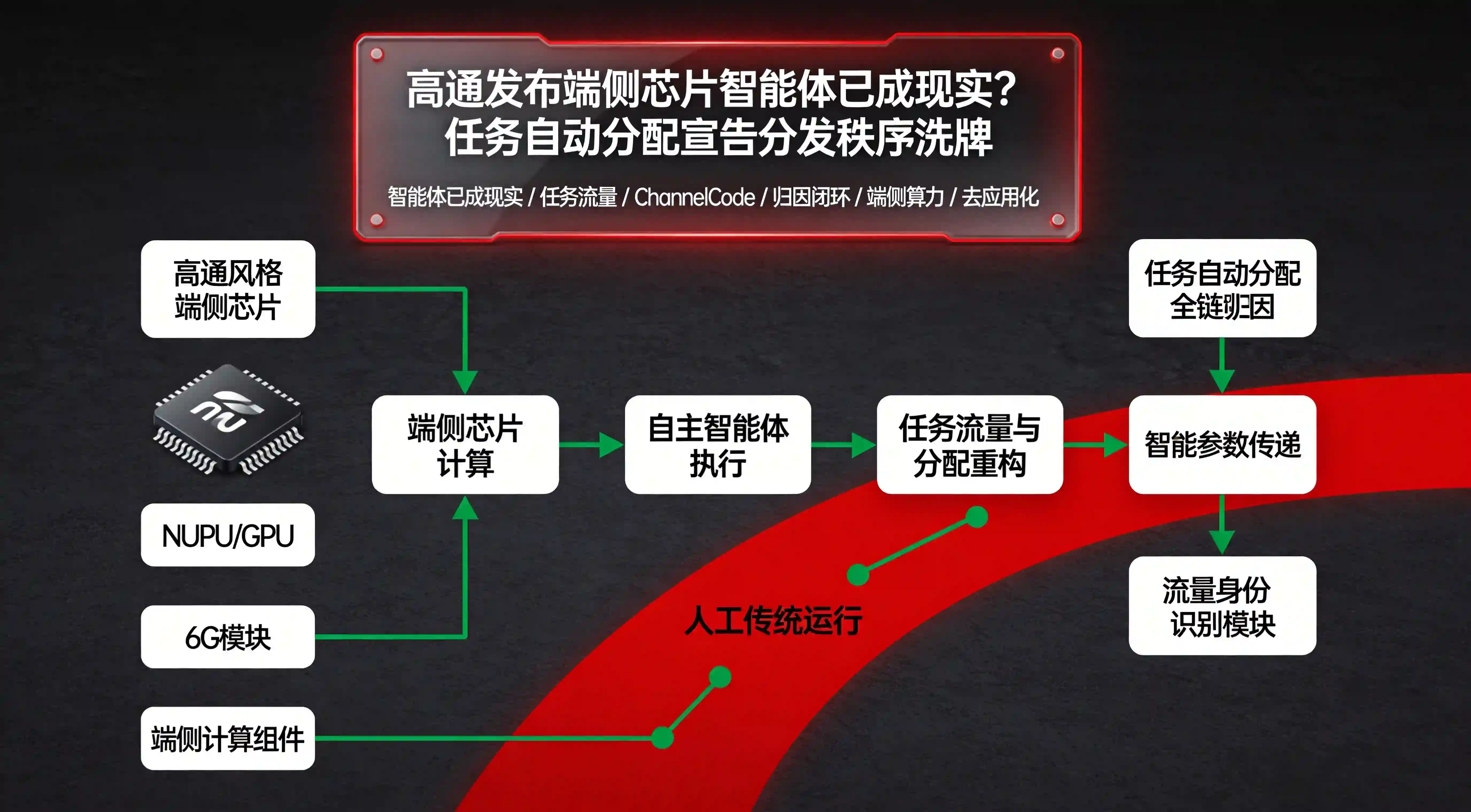

高通发布端侧芯片智能体已成现实?任务自动分配宣告分发秩序洗牌

2026-06-02

豆包六月下旬正式付费全面提价打通电商?算力筑墙引发流量分配大洗牌

2026-06-02

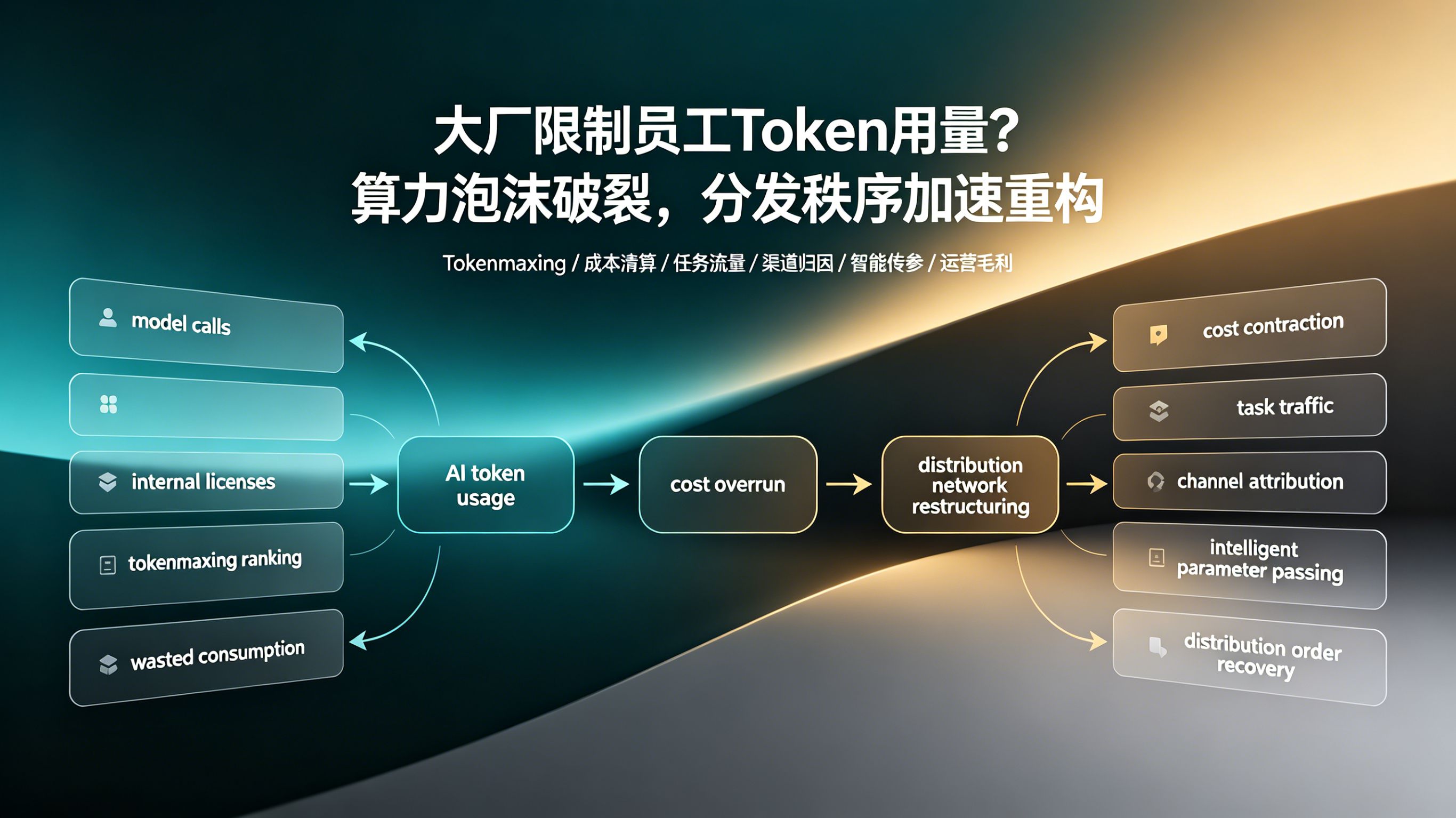

大厂限制员工Token用量?算力泡沫破裂,分发秩序加速重构

2026-06-01

向量检索怎么接入推荐?召回效率与高并发延迟优化架构解析

2026-06-01

社交媒体裂变怎么统计?追踪分享数据与病毒系数

2026-06-01

短信链接怎么防止丢数?高精度归因算法防漏数

2026-06-01

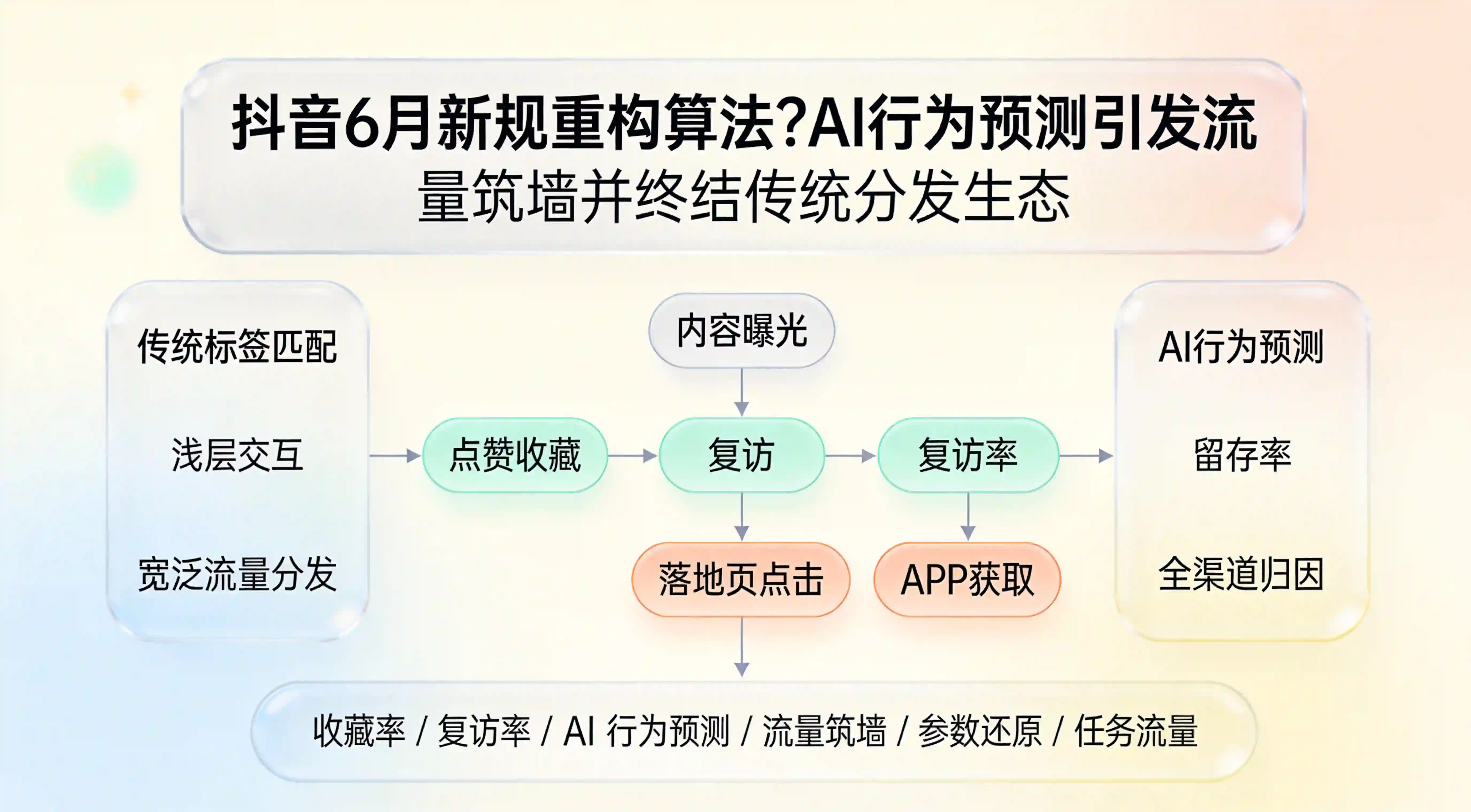

抖音6月新规重构算法?AI行为预测引发流量筑墙并终结传统分发生态

2026-06-01

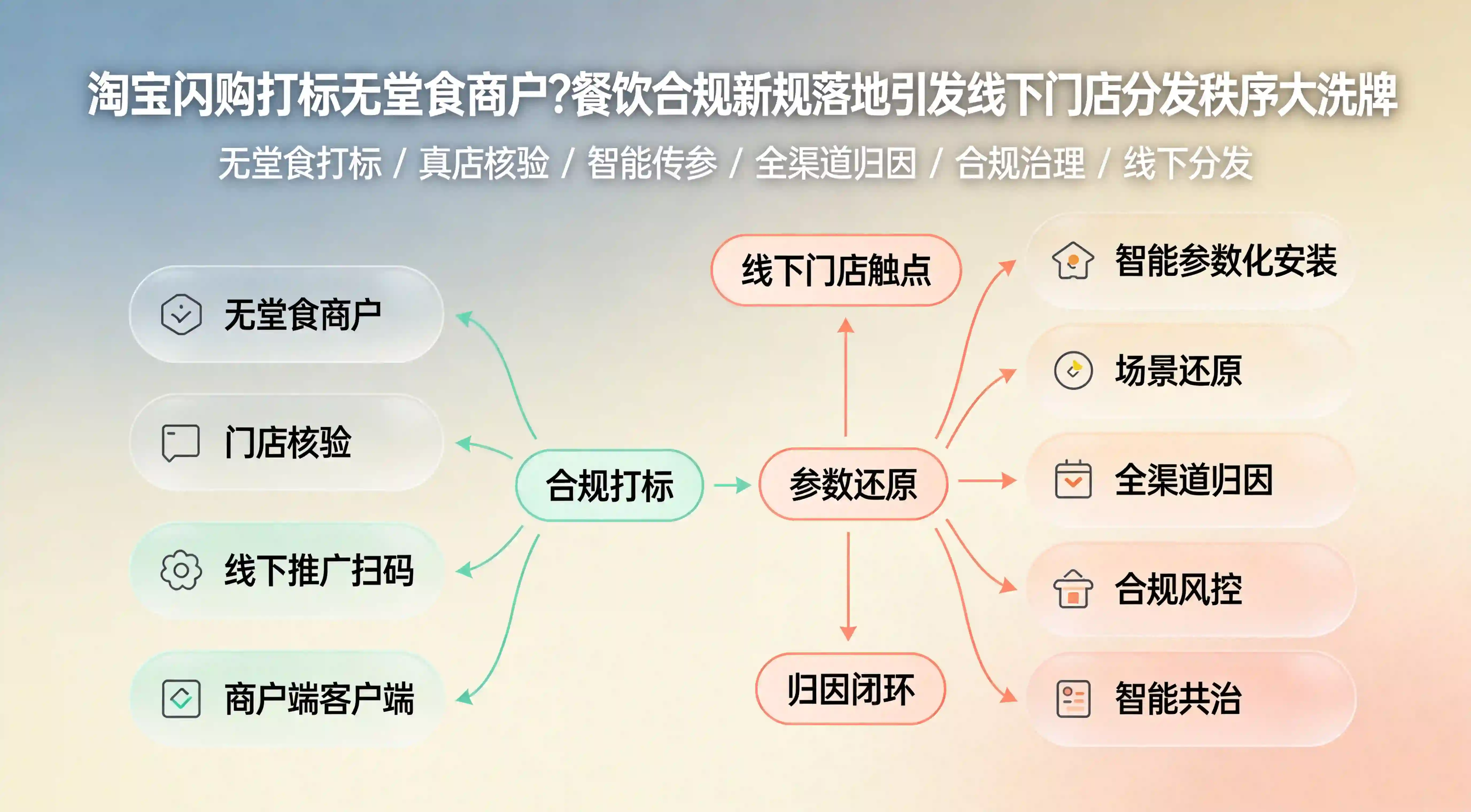

淘宝闪购打标无堂食商户?餐饮合规新规落地引发线下门店分发秩序大洗牌

2026-06-01

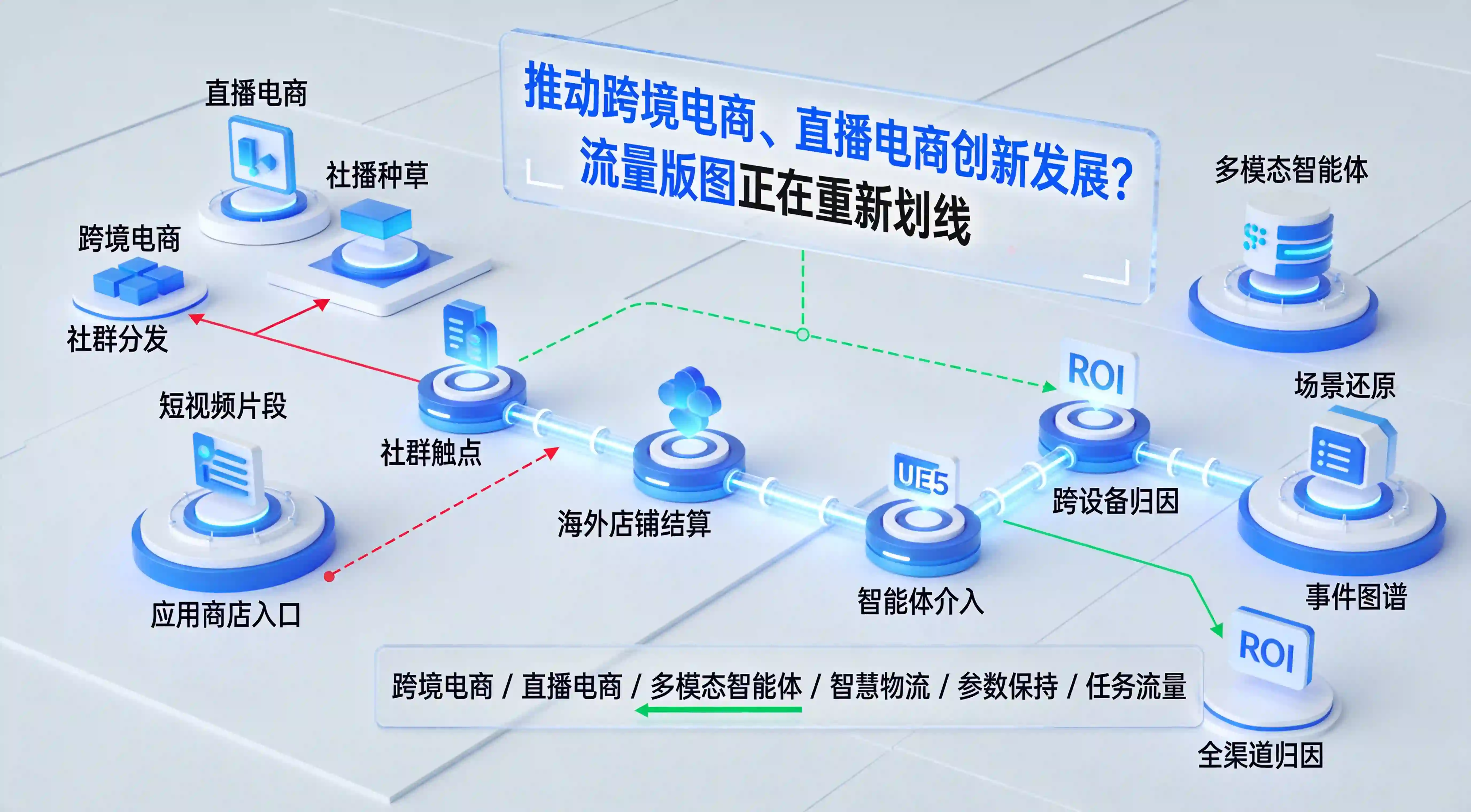

推动跨境电商、直播电商创新发展?流量版图正在重新划线

2026-06-01

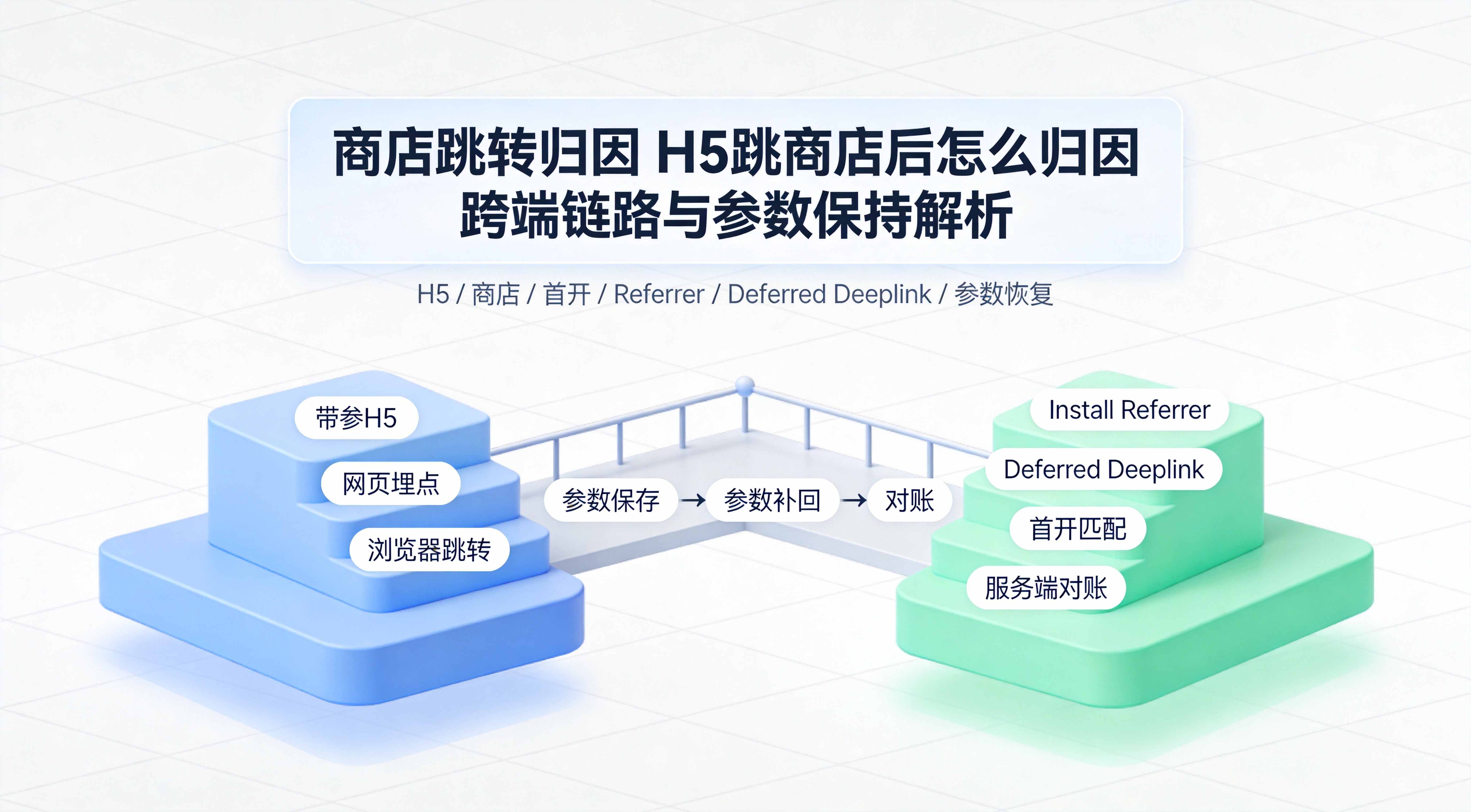

H5 跳商店后怎么归因?跨端链路与参数保持解析

2026-05-29

AI投入开始变收入,大厂商业闭环怎么形成?

2026-05-29