手机微信扫一扫联系客服

309

309亚马逊豪掷 500 亿美元押注 OpenAI、有状态运行时和自研芯片,AI 正从“单模型调用”走向“多云多 Agent 协同”。这篇写给开发者与增长团队:在 AI Agent 带来新流量的时代,App 到底怎么才能看清真实来源。

亚马逊刚刚给 OpenAI 开出了一张高达 500 亿美元的支票,同时把自家 Trainium 芯片、Amazon Bedrock、Frontier 平台绑在了一起,试图把“云 + 芯片 + 模型 + 智能体”做成一条完整赛道。OpenAI 则承诺在 AWS 上消耗 2 吉瓦 Trainium 算力,把新的有状态运行时环境和智能体平台 Frontier 放在 AWS 生态中去跑。这不是一笔单纯的财务投资,而是在告诉开发者和 B2B 团队:未来大量用户请求,会先经过云端的 AI Agent,再被转发到你的 App。问题是——当流量被智能体“转一手”之后,你还认得出它们是谁、从哪儿来、真正值不值钱吗?

在最新公布的合作细节中,亚马逊和 OpenAI 对外强调了两个关键设施:

有状态运行时环境(Stateful Runtime Environment)

由 OpenAI 模型驱动,在 上提供。

能够让模型访问算力、内存和身份等要素,可以记住上下文、保留历史任务、跨工具与数据源协同,并按需获取算力。

设计目标是支撑“持续性的项目和工作流”,而不是一次问答就结束。

OpenAI Frontier 平台(由 AWS 作为独家第三方云分发渠道)

支持机构构建、部署、管理“AI 智能体团队”。

智能体之间共享上下文,有内置治理和企业级安全能力,可以直接跑在真实业务系统上,而不需要客户自己管底层基础设施。

这意味着,过去那种“后端简单调一个模型 API”的模式,正在被更复杂的形态替代:

多个智能体在后台协同,持久维护上下文;

它们会主动去访问内部系统、外部 API 和第三方 App;

用户看到的只是一层统一的“助手/工作流界面”,背后到底调用了你几次接口,很容易被隐藏。

亚马逊这一轮调整的另一个关键词是“低成本”。

新的 AI 负责人 Peter DeSantis 非常直接地说了句:“AI 存在严重的成本问题。”

Trainium(训练)和 Inferentia(推理)两条自研芯片路线,被用来搭建一个“更便宜、更高性价比的模型运行底座”,目标是让客户以低于竞品 50% 左右的推理成本,跑定制模型。

面向企业侧,亚马逊推的是 Nova 系列和 Nova Forge 这类“便于定制、成本可控”的模型与工具,而不是追求每次都要在榜单上碾压对手的大模型。

结合 OpenAI 这次合作,可以看到亚马逊的基本盘:

一边用大手笔投资绑定 OpenAI、强化 AWS 在“前沿智能体平台”的位置;

一边继续押注自研芯片和定制模型,用“更便宜的算力 + 更贴业务的模型”构建差异化。

对开发者和 App 团队来说,重要的不是这些品牌名,而是一个简单事实:

未来你接触到的用户请求,很可能既来自 OpenAI 的智能体团队,又跑在 AWS 的 Nova 模型上,用的还是 Trainium 芯片,全程由云端 Agent 转发,真正触达你 App 的那一跳,只是整条链路的一小部分。

过去的典型模式是:

App 或服务自己选择一个模型供应商(OpenAI / Anthropic / 其他),在后端通过 API 接入;

在业务层面,用户行为路径大致还是“广告/搜索 → 你的落地页/应用 → 你的后端模型调用”;

大部分归因工作集中在“用户怎么来到你的应用”这一段。

在多云多 Agent 的新架构里,路径会变成另一种形态:

用户对某个“超级助手”或企业内部的 AI 工作台发起请求;

云端的智能体团队决定调用哪些模型和工具,其中一部分是 OpenAI Frontier 提供的 Agent,一部分是跑在 AWS Nova 或第三方云上的模型;

这些智能体根据上下文,从多个系统和 App 拉取数据、触发操作,最终把结果合并后展示给用户。

对你的 App 来说,最大的变化在于:

你可能完全看不到最初的用户是谁、问了什么,只看到一个来自“某个 Agent”的 API 调用;

同一条用户任务,可能在一天内多次触达你的 App,而你不一定知道它们属于同一个“工作流”;

有些智能体跑在 AWS,有些跑在别的云或本地环境里,你看到的只是散落在各云上的一堆调用记录。

这带来两个非常现实的归因难题:

入口被“代理”了

原本清晰的用户入口(广告、搜索、Push、系统推荐等)被智能体接管,很多实际决策是由 Agent 替用户做的。

你的日志里只看到“某个 Agent 调用了接口并触发了一次核心行为”,而看不到它是因为哪条广告、哪次对话、哪个任务链路。

路径被“切碎”了

用户的一次业务闭环,可能跨越多个云、多种模型和多个 App:

例如:在企业 Copilot 中发出指令 → Agent 调你的 CRM → 又调你的支付 App → 再写回内部 BI。

在你的视角里,这只是几次独立的 API 调用,你并不知道它们属于同一条任务链,也不清楚应该把“功劳”算在谁的头上。

如果还用“最后点击 + 单一渠道 + 单一设备 ID”的老旧归因方法,多云多 Agent 时代的流量,会呈现出一种状态:

报表看上去热闹:调用多、活跃高;

真正有效的入口与路径,却越来越难被识别出来。

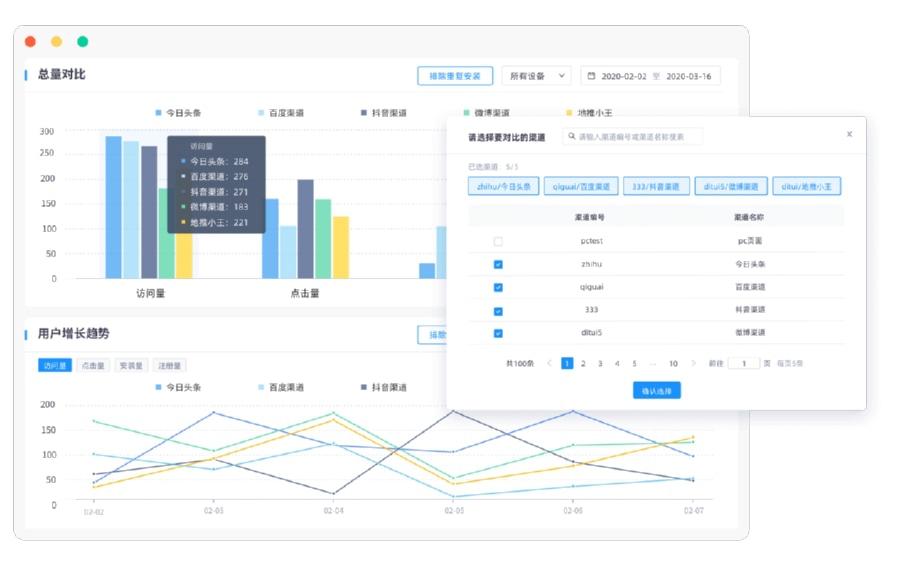

在多云多 Agent 环境里,第一步是把 Agent 本身当成“渠道”来管理。 除了给广告、落地页、OEM、线下场景设计渠道编号 ChannelCode 之外,还可以扩展出一套 Agent 维度的标识体系,比如:

AgentCode=AWS-FRONTIER-SALES-COPILOT:

表示来自 OpenAI Frontier 上、为销售团队服务的智能体。

AgentCode=BEDROCK-NOVA-CUSTOMER-SUPPORT:

表示跑在 Amazon Bedrock / Nova 上的客服 Agent。

AgentCode=INTERNAL-RAG-AGENT-LEGAL:

表示企业内部某个法务检索与起草 Agent。

在调用你的 App 时,约定:

所有来自 Agent 的调用必须带上 AgentCode;

如果调用是因为某个特定入口(如特定工作流、特定技能、某个 Bot 的特定“工具”),则继续叠加 ChannelCode:

例如:ChannelCode=FRONTIER-WORKFLOW-Q1-REPORT。

这样,你在日志里看到的就不再是“某个匿名请求”,而是:

来自哪一个智能体(AgentCode);

通过哪一个入口/工作流被触发(ChannelCode);

进而可以在数据仓里区分不同智能体与不同路径的质量。

当 AI 智能体开始给你的 App 导流时,用户入口不再只是应用商店和广告,还包括:

企业 Copilot 面板中嵌入的 App;

SaaS 产品中的“推荐工具”列表;

OpenAI Frontier 或 AWS 控制台中某个 App Catalog 的入口。

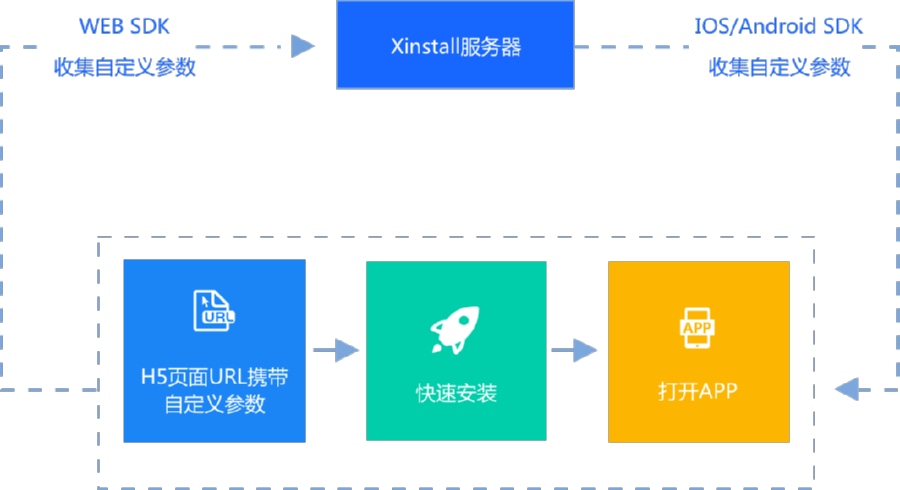

在这些场景里,可以像对待传统广告一样,对每一个入口设计带参数的体验链接,并使用智能传参安装:

对 Web / App 入口:

为每个 Agent + 工作流生成专属链接,例如:

https://yourapp.com/install?agent=FRONTIER-SALES&scene=lead_qualify&channel=FRONTIER-WORKFLOW-Q1

通过 或类似能力,把这些参数在安装/拉起过程中带到 App 内。

在 App 首启和 Deeplink 拉起时:

解析并持久化这些参数:

cloud=aws / cloud=onprem;

agent_code=FRONTIER-SALES-COPILOT;

scene=lead_qualify;

channel=FRONTIER-WORKFLOW-Q1。

决定首启体验或页面跳转:

直接打开对应业务模块或模板(如某个看板、某个表单);

用不同的引导文案、功能聚焦来匹配 Agent 背后的任务类型。

有了这层智能传参和参数还原能力之后,你就可以在用户维度回答一个关键问题:

这个用户,是被哪个云上的哪一个智能体,在什么任务场景下带进来的?

流量真正变复杂的是数据层:同一位用户,可能在一周内通过多个 Agent、多条工作流、多朵云触达你的 App。粗暴的 UV / 调用次数统计已经看不出真相,需要在数据仓里同时维护两张图:

调用图(Service Call Graph)

顶点:云(AWS、其他)、Agent、你的服务、外部系统;

边:调用关系(包括 Agent → App、App → Agent、App → 其他服务);

属性:每条调用的耗时、错误率、转化触发情况。

用户旅程图(User Journey Graph)

顶点:用户关键行为(入口点击、App 安装、首启、登录、关键任务完成);

边:行为之间的时间顺序,以及背后的 AgentCode、ChannelCode 等。

在实践中,可以这样做:

将 Agent 调用日志与 App 行为日志统一进入数据仓;

按用户 ID + AgentCode + ChannelCode 重建跨天、跨多云的会话;

在分析层面:

计算不同 Agent 所在云(例如 AWS Frontier Agent vs 其他云 Agent)的转化率与 LTV;

比较同一业务场景下,不同智能体组合(多 Agent vs 单 Agent)的效果差异;

识别出“偷懒”或“无效调用”的智能体行为(调用多、产出少),给到业务团队进行策略调整。

在新的架构下,你的 App 不只是给用户用的 UI,更是给智能体调用的一组“工具函数”。从工程视角看,需要尽早考虑:

对外暴露一套清晰、稳定的 API 或 Tooling 接口,让不同云上的 Agent 能以标准协议调用;

在接口协议中预留 AgentCode 与 ChannelCode 字段(例如通过 Header 或参数),方便在后端链路中贯穿;

在安全层面:

区分“人调用”和“Agent 调用”的权限与速率;

对 Agent 行为增加限流、配额与审计,以防“聪明的 Agent”误操作或滥用你的服务。

当 AWS 成为 OpenAI Frontier 的独家第三方云分发渠道,越来越多企业会在这些平台上搭自己的“超级助手”,你的 App 很可能就是这些助手背后的一块拼图。对增长来说,这些智能体应该被当成:

新的渠道类型(类似“系统内推荐位”“SaaS 内部 App Store”);

可以谈合作、可以做运营、可以调优话术和路径的“流量入口”。

结合渠道编号 ChannelCode 和智能传参:

你可以像管理广告投放一样,管理“来自某个智能体工作流的新增与转化”;

可以通过 A/B 测试不同话术、不同 Agent 配置方式对你 App 的影响;

在多云场景下,比较来自不同云上 Agent 的长期质量。

多云多 Agent 这套东西,对普通 App 来说是不是太远了? 短期看,最先感受到变化的是 B2B SaaS、企业内部系统以及深度接入云生态的工具型 App。但从中期看,越来越多 C 端服务也会通过平台智能体被调用(例如云笔记、协作工具、知识类 App 等),提早为“被 Agent 调用”和“被云端工作流导流”预留好接口和归因埋点,会显著降低未来接入成本。

如果我们只接一个云(比如只用 AWS),还需要考虑多云归因吗? 即便你只直接使用一家云服务商,你的用户和合作伙伴很可能在其他云、其他 Agent 平台上运行他们的系统。这些系统调你的 App 时,路径已经天然是“多云协同”的形态。在数据视角和归因建模上,提前把“云 + Agent + ChannelCode”这三个维度纳入设计,是为未来保留扩展空间。

终端/平台都在争做 AI 入口,我们在归因上到底要信谁的数据? 无论是 AWS、OpenAI Frontier,还是其他云与终端厂商,它们的报表都会从“自己的视角”解释流量价值。自建一套围绕 ChannelCode、AgentCode 和事件图的归因体系,不是为了否定平台,而是为了:

把不同来源的报表放在同一口径下对比;

在多云多 Agent 的复杂路径中,找到对你业务真正有价值的那一段;

在预算和资源分配时,掌握自己的判断权。

从“云老大是否掉队”的质疑,到 500 亿美元押注 OpenAI、有状态运行时和 Trainium3/4 芯片,亚马逊这次给出的答案很直接:它不打算单纯在最强通用模型榜单上卷,而是要在“多云多 Agent + 定制模型 + 低成本算力”这条路上拉开差距。

对 App 和 B2B 产品团队来说,真正重要的不是谁家模型分最高,而是:

你的用户越来越多是通过智能体和工作流访问你;

这些智能体越来越多跑在不同云、不同平台上;

你要有办法在这张复杂网络里认出“谁在给你带来真实价值”,再决定下一步要和谁深化合作。

在多云多 Agent 时代,能把渠道编号 ChannelCode、AgentCode、智能传参和全链路事件图打好地基的团队,会有更大概率在看似混沌的 AI 浪潮中,看清楚自己的那条清晰增长曲线。

上一篇

上一篇

Embedding怎么提升推荐效果?用户意图表示实战

2026-06-02

跨平台获客归因如何实现?打通网页与应用归因

2026-06-02

二维码渠道追踪有什么优势?一人一码技术解析

2026-06-02

天猫618开门红破亿品牌大增40%?效率升级持续戳破虚假营销泡沫

2026-06-02

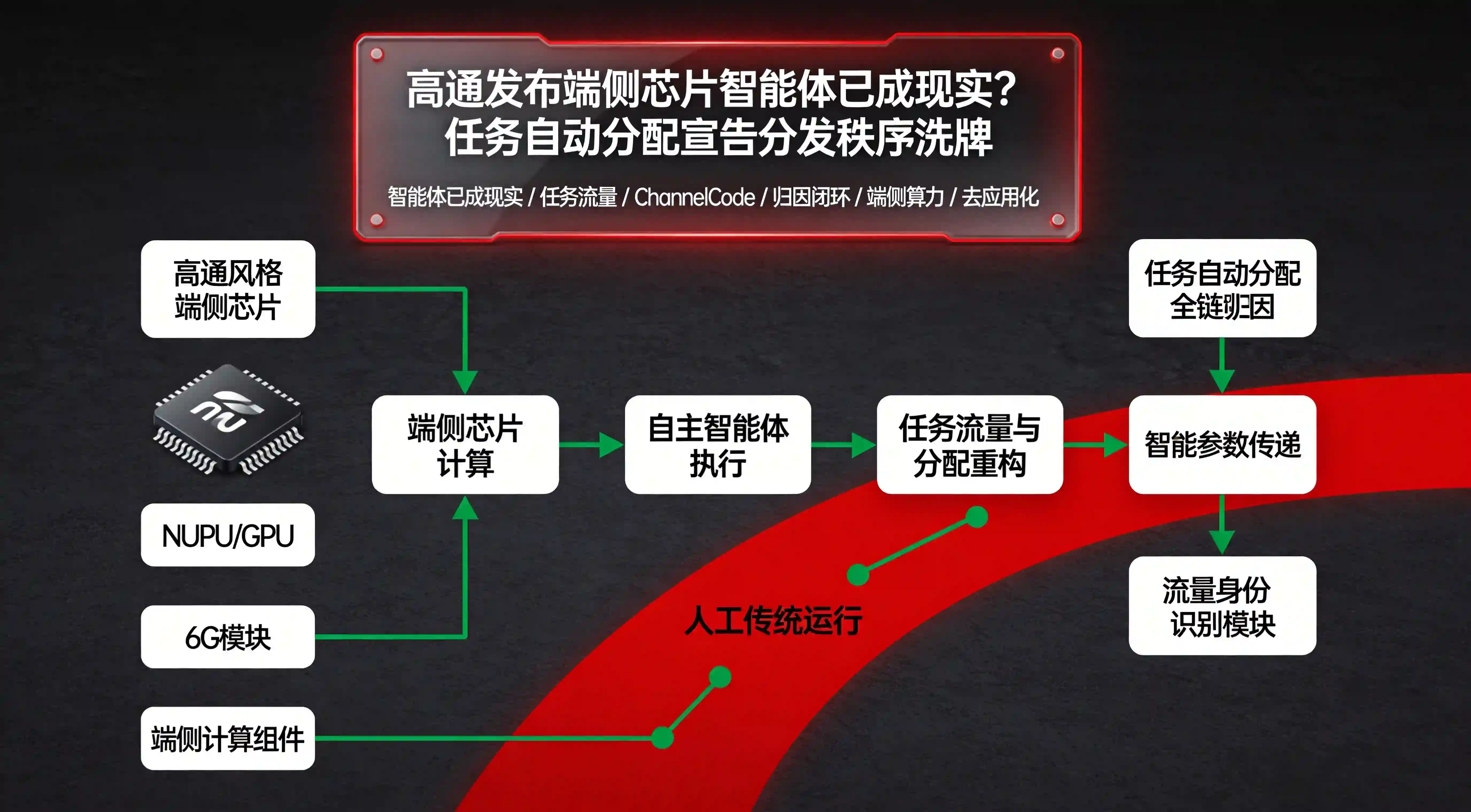

高通发布端侧芯片智能体已成现实?任务自动分配宣告分发秩序洗牌

2026-06-02

豆包六月下旬正式付费全面提价打通电商?算力筑墙引发流量分配大洗牌

2026-06-02

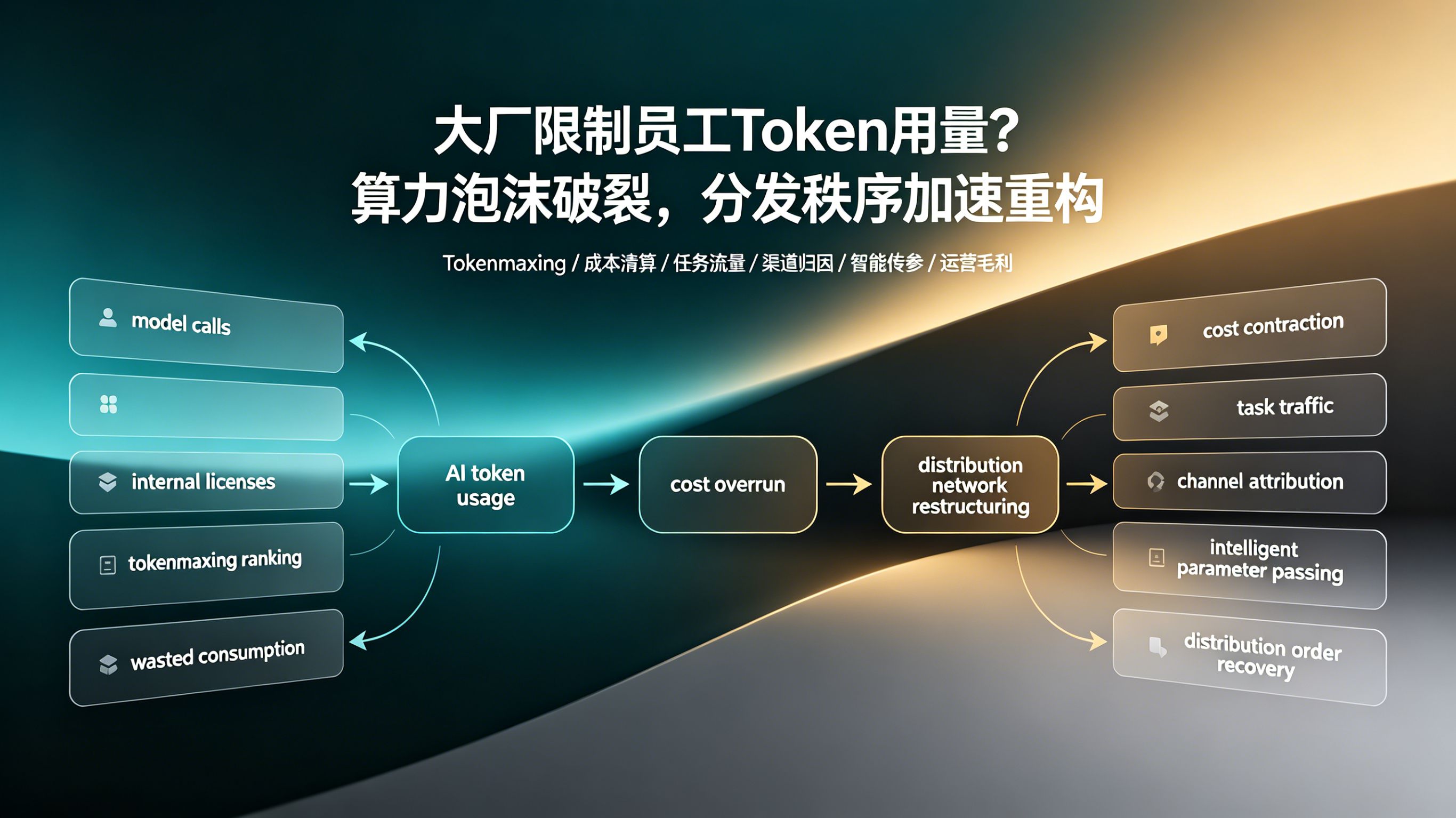

大厂限制员工Token用量?算力泡沫破裂,分发秩序加速重构

2026-06-01

向量检索怎么接入推荐?召回效率与高并发延迟优化架构解析

2026-06-01

社交媒体裂变怎么统计?追踪分享数据与病毒系数

2026-06-01

短信链接怎么防止丢数?高精度归因算法防漏数

2026-06-01

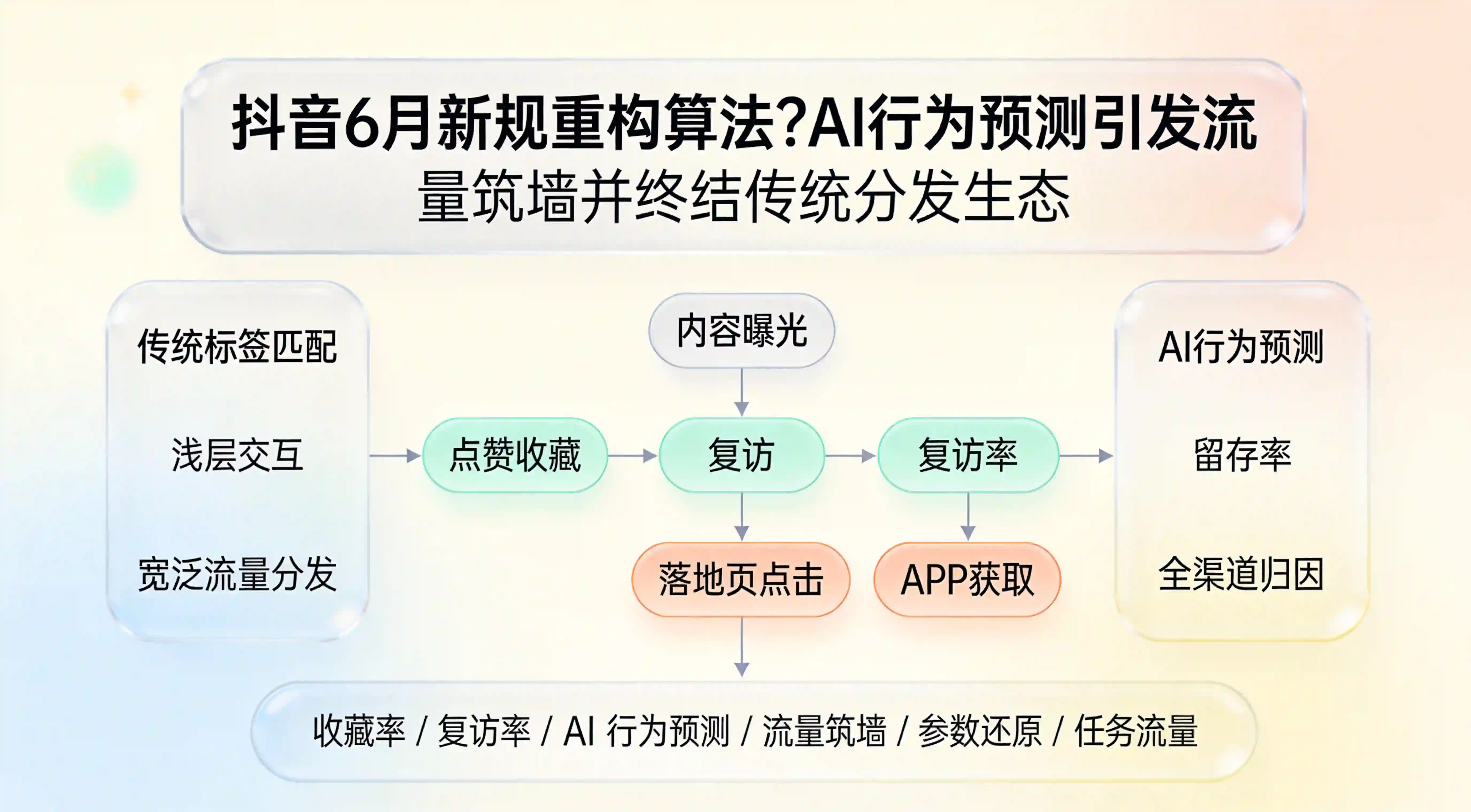

抖音6月新规重构算法?AI行为预测引发流量筑墙并终结传统分发生态

2026-06-01

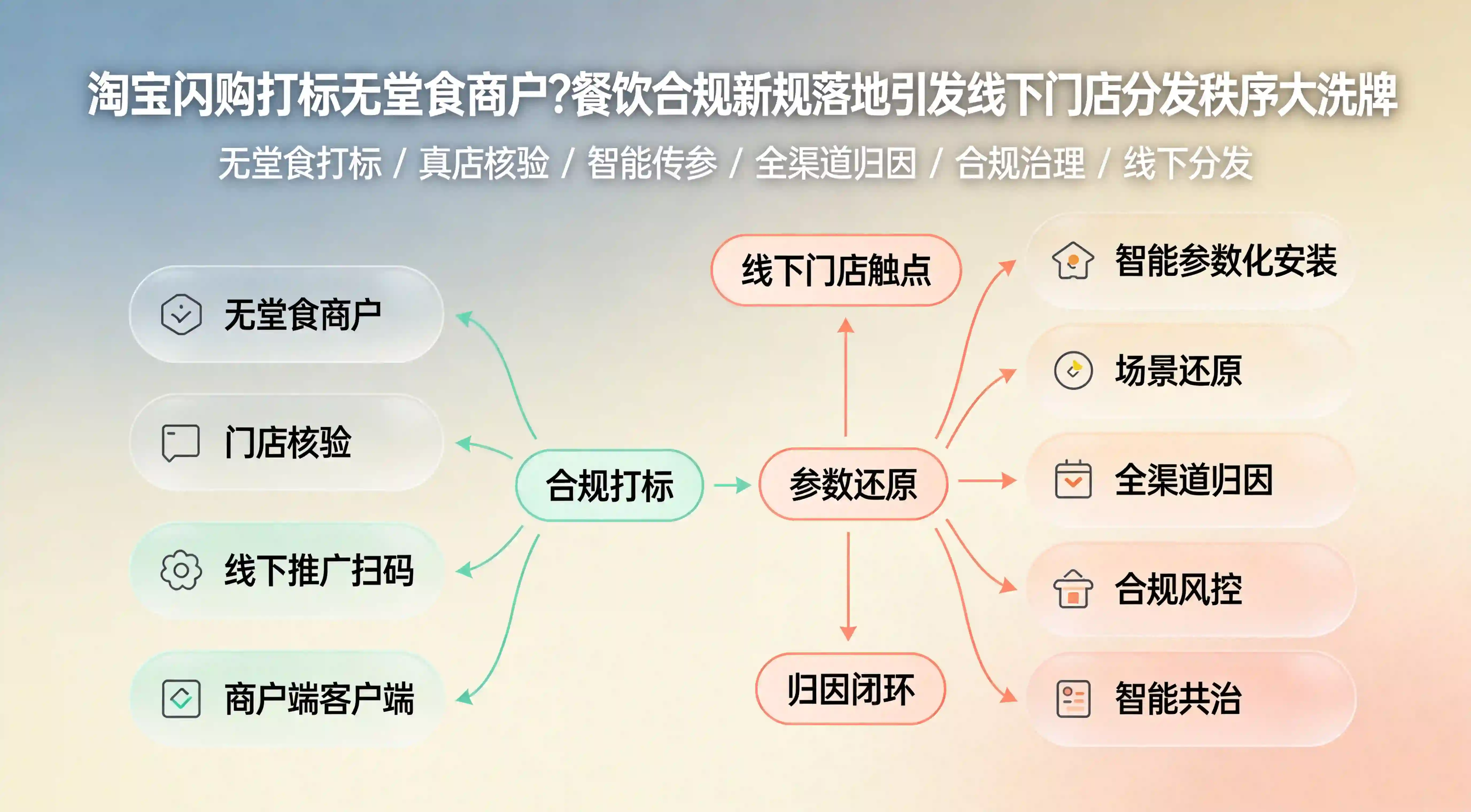

淘宝闪购打标无堂食商户?餐饮合规新规落地引发线下门店分发秩序大洗牌

2026-06-01

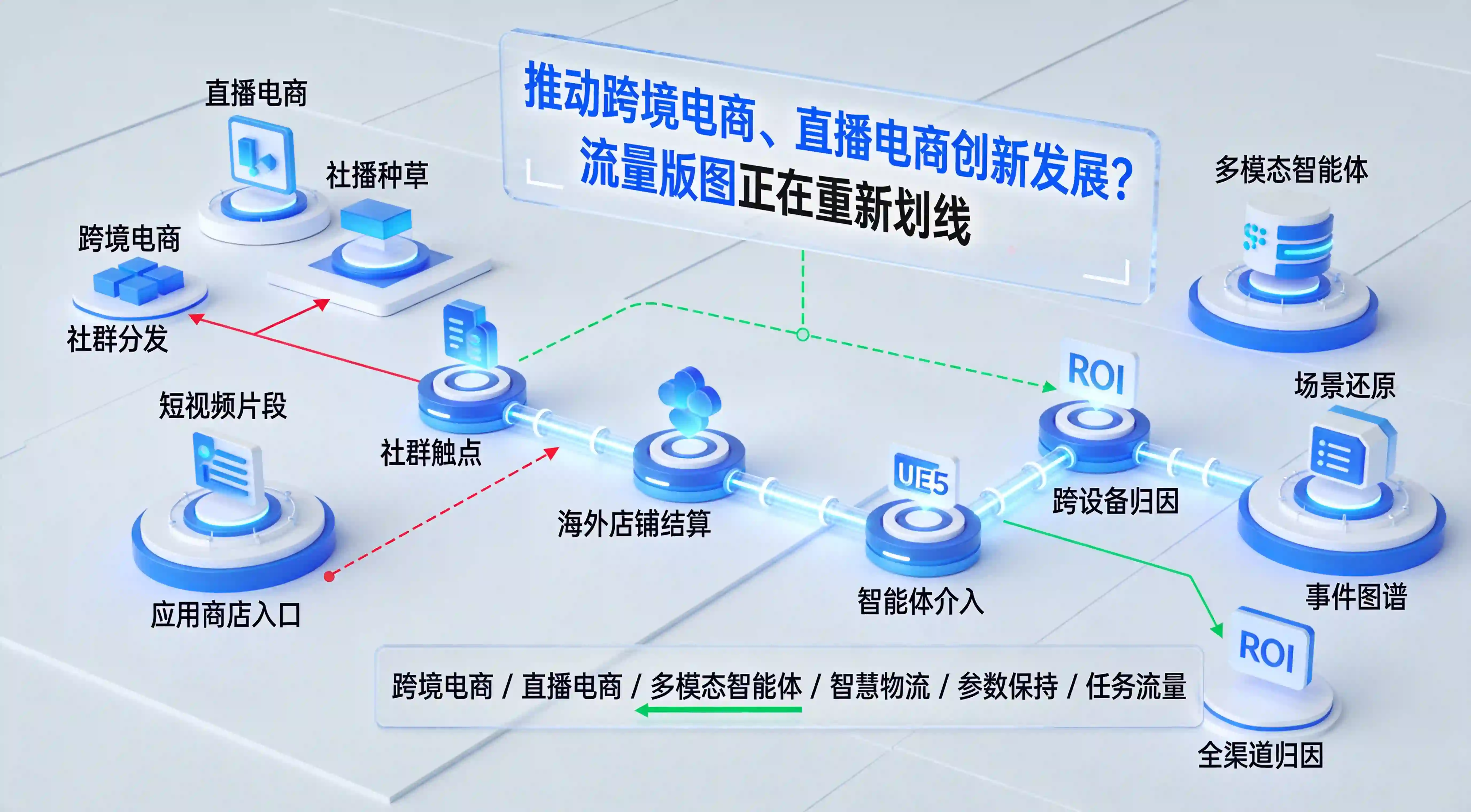

推动跨境电商、直播电商创新发展?流量版图正在重新划线

2026-06-01

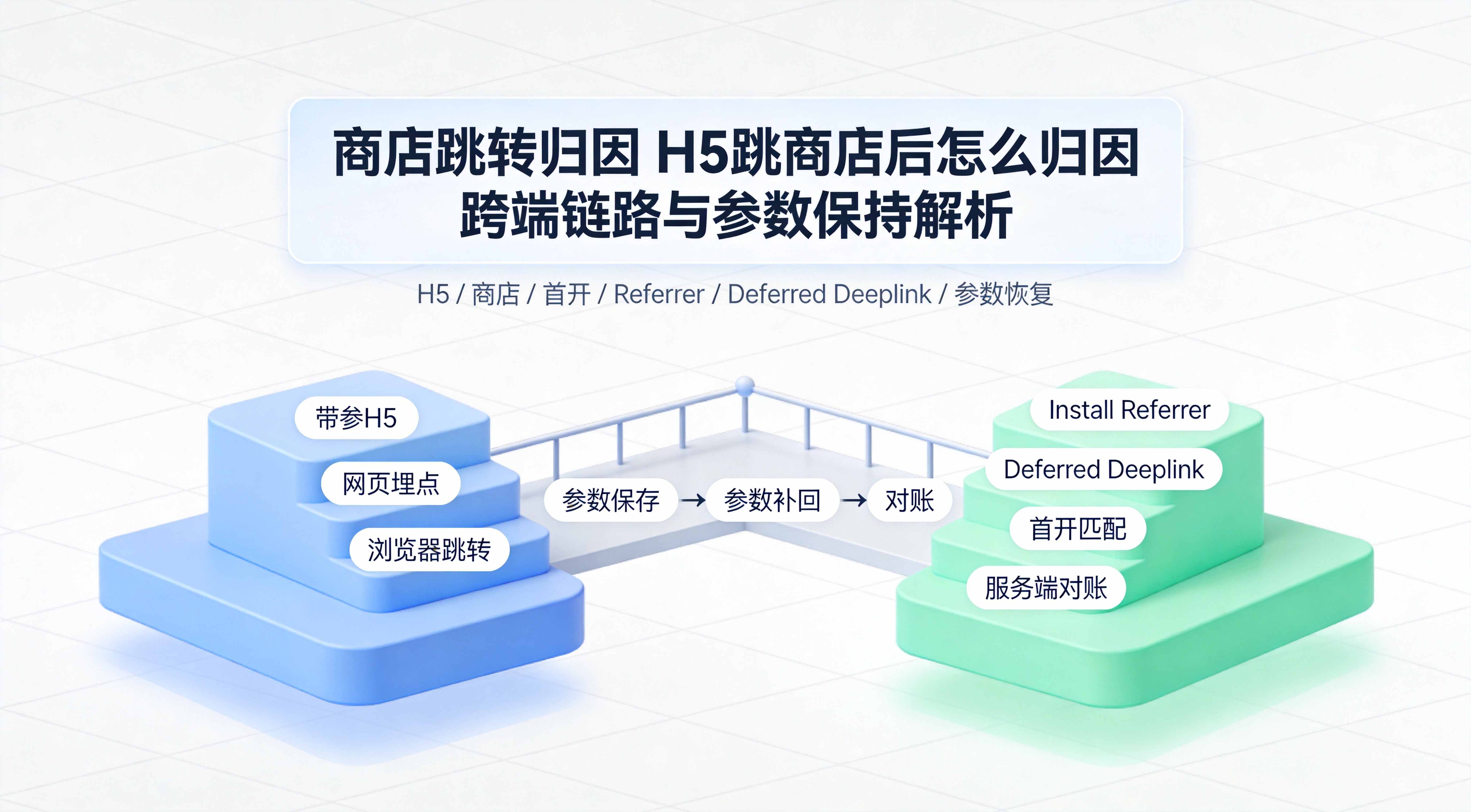

H5 跳商店后怎么归因?跨端链路与参数保持解析

2026-05-29

AI投入开始变收入,大厂商业闭环怎么形成?

2026-05-29