手机微信扫一扫联系客服

124

124阶跃星辰上线Step 3.5 Flash 2603模型,新增低推理模式降Token消耗56%。Agent工作流爆发下,如何全链路追踪开发者任务与成本?

阶跃星辰上线Step 3.5 Flash 2603模型,低推理模式(low think mode)Token消耗骤降56%,专为Coding与Agent框架优化。当“按需分配”重塑AI流,开发者如何跨终端追踪任务流量与分发成本?

阶跃星辰上线Step 3.5 Flash 2603模型,低推理模式(low think mode)Token消耗骤降56%,专为Coding与Agent框架优化。当“按需分配”重塑AI流,开发者如何跨终端追踪任务流量与分发成本?

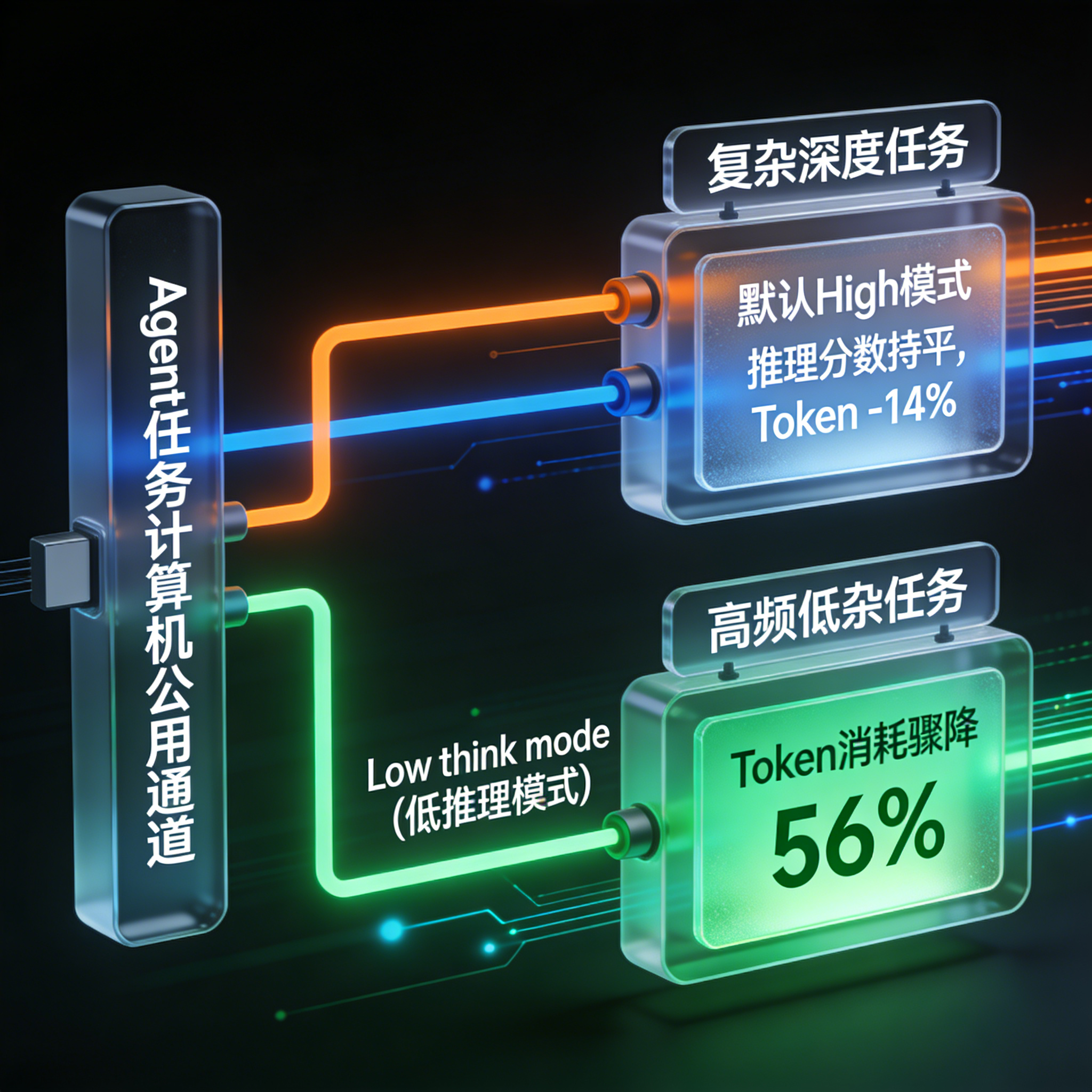

4月2日,阶跃星辰面向Step Plan用户开放该版本。官方测试显示,默认High模式分数持平、Token降14%;切至Low模式再降56%。阶跃星辰上线 Step 3.5 Flash 新版本,新增低推理模式 团队观察到Agent场景大量高频低杂任务,通过“复杂用重型、高频用轻量”避免每步“深度思考”,精细化迭代提升响应与灵活性。

对App开发者和平台方,模型矩阵细分加速Agent普及:但调用链变长、模式频繁切换,从唤起到执行的转化归因成新痛点。

Step 3.5 Flash 2603以极低成本主打Agent中间件流。

优化版延续高响应;新增低推理模式降56% Token消耗;默认模式降14%且分数不减。

专门针对这两大框架优化稳定性和Token效率;满足用户“重型+轻量”组合调用的工作流需求。

火山豆包Token破120万亿验证B端扩张,阶跃星辰的“快上加快”则从工具向生产力基建进化。

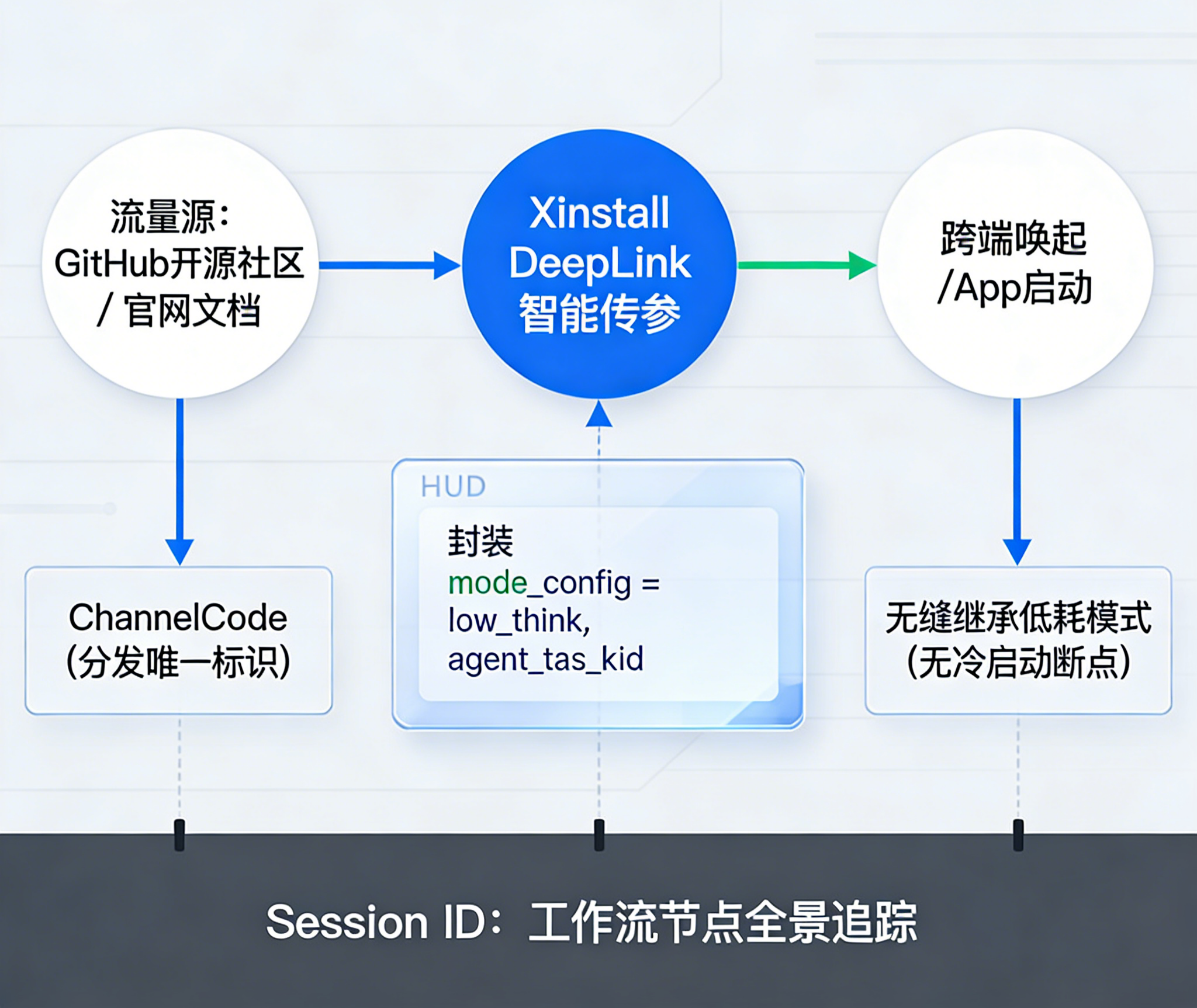

Agent工作流碎片化:下载IDE插件/唤起App端,来源是GitHub还是官网?多模态推理链中,“轻/重模型切换”参数丢失中断;API分发层级多,无法追踪“具体场景贡献的Token流量与ROI”。

传统统计无法拆解多模式复合调用的转化路径。

问题:开发者经多渠道获取Agent工具,流量源混杂。

做法:下载/集成接口嵌入ChannelCode,标记开源社区或文档推广等。《亚马逊 AI 战略升级?多云多 Agent 时代 App 该怎么认清流量真身》

好处:精准剥离“开发者增长流量”,指导投放。

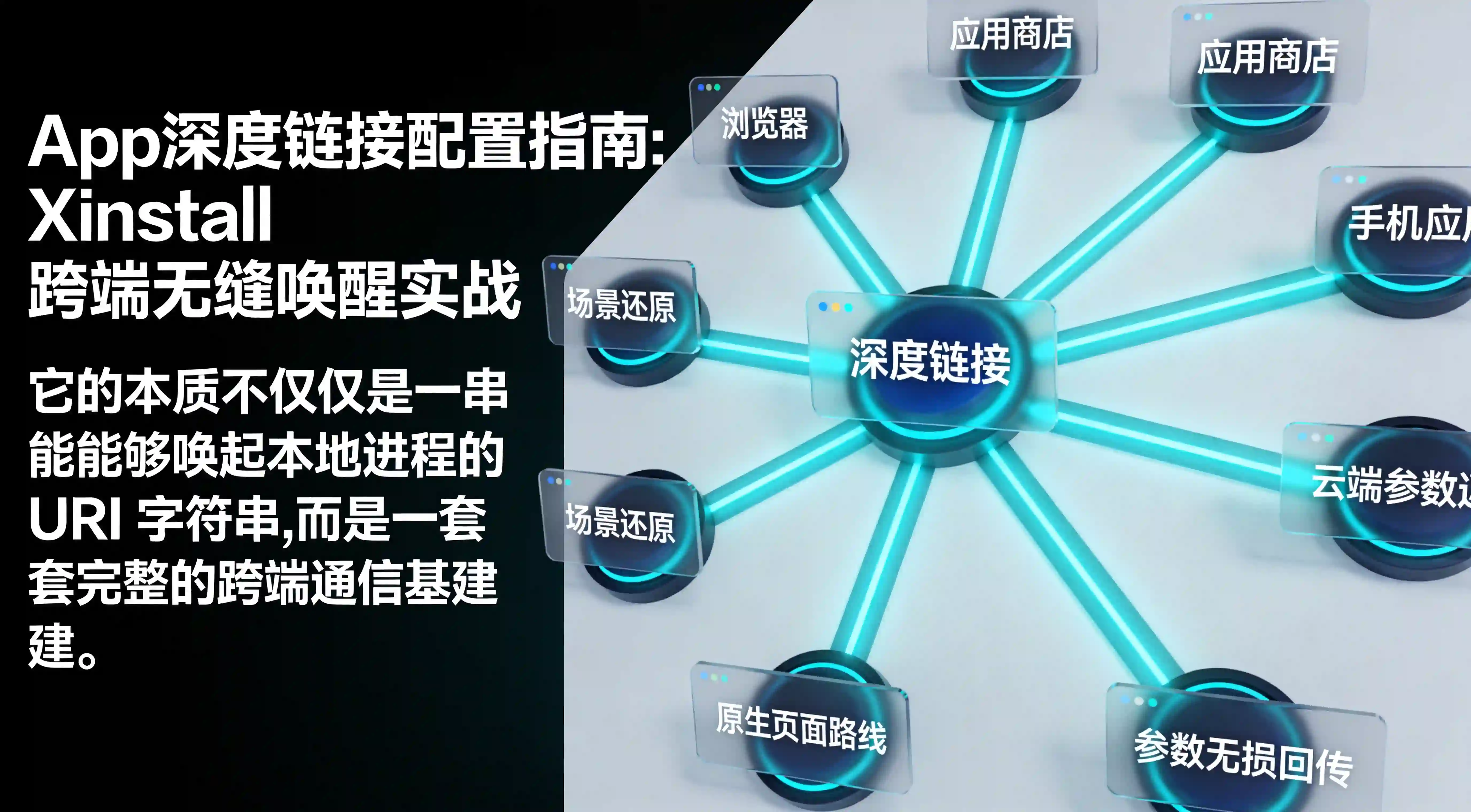

问题:跨平台启动时,low_think设置与上下文易丢失。

做法:DeepLink封装mode_config、agent_task_id,智能传参安装还原。《智能体分发时代 App 安装传参逻辑的底层重构》

好处:App/插件启动即进入低耗模式,避免冷启动断点。

问题:复合调用链(轻-重-轻)的转化ROI不清。

做法:Session ID串联触发->中间推理->结果输出全流程。

好处:可视各节点的成本与效率,优化计费模型。

注:本文探讨的Agent任务分发归因属于前瞻延展。目前高度定制链路尚未标准实现,如有需求,欢迎联系 Xinstall 客服探讨研发。

面向开发 / 架构团队:

预留think_mode、task_complexity字段,支持流式传参;测试新版API兼容性。

面向产品 / 增长团队:

将低成本模式作为获客钩子,建立ChannelCode统计;挖掘高频场景流量红利。

新增低推理模式降56% Token消耗,专为Coding和Agent框架优化。

Agent流中,复杂环节用重型模型,高频中间步骤用此轻量模型,免去无效深度思考。

官方称默认High模式下推理分数基本持平,且Token已降14%。

大模型正从单纯比拼参数,转向“快/省/稳”的精细化管线基建(如豆包破120万亿Token)。

Step 3.5 Flash 2603低耗模式,加速AI从工具箱融入流水线。

App团队需用全链归因穿越调用黑箱,捕捉Agent爆发红利。

上一篇

上一篇

如祺出行首曝四类数据版图?真实场景升温,具身智能开始抢数据地盘

2026-05-18

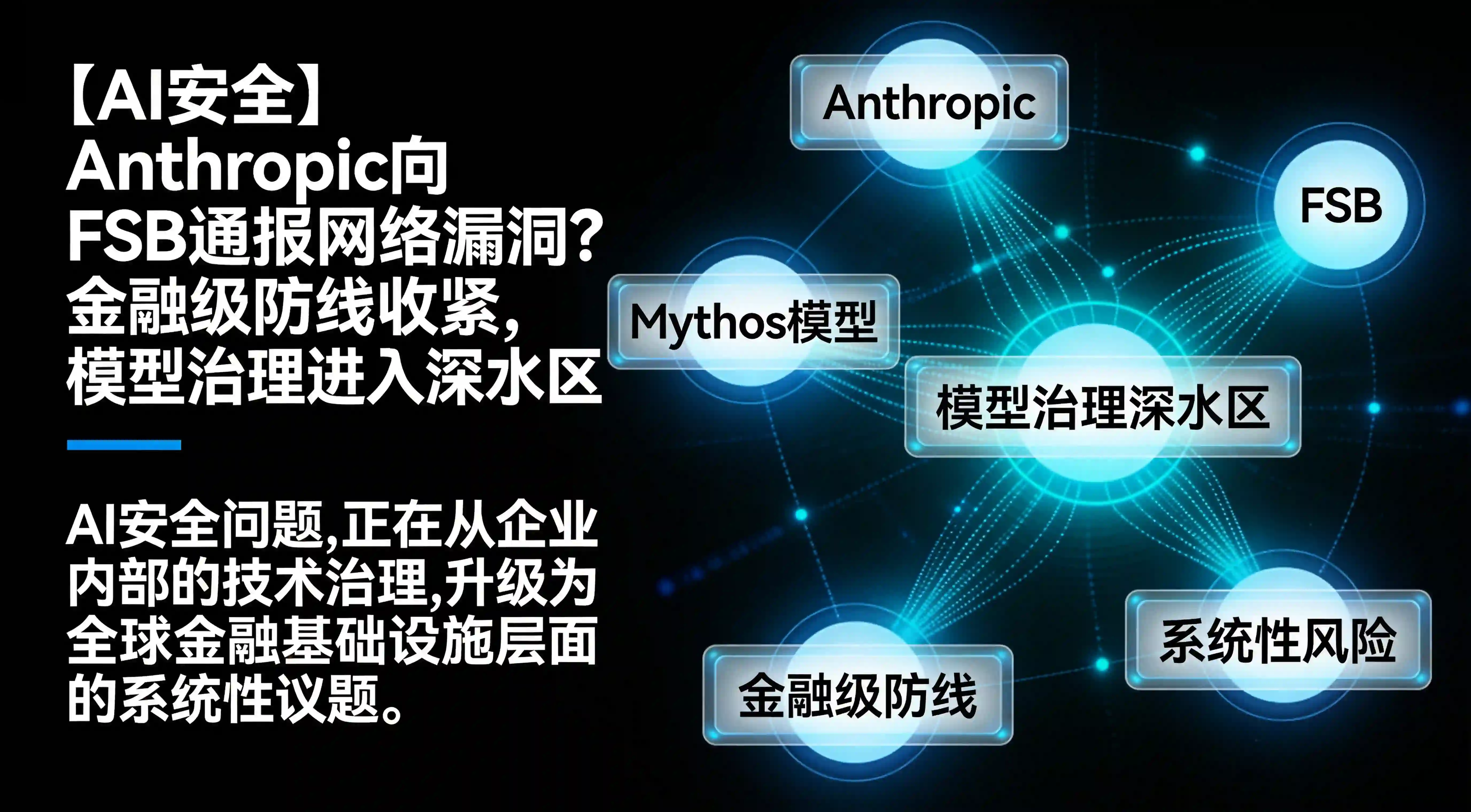

Anthropic向FSB通报网络漏洞?金融级防线收紧,模型治理进入深水区

2026-05-18

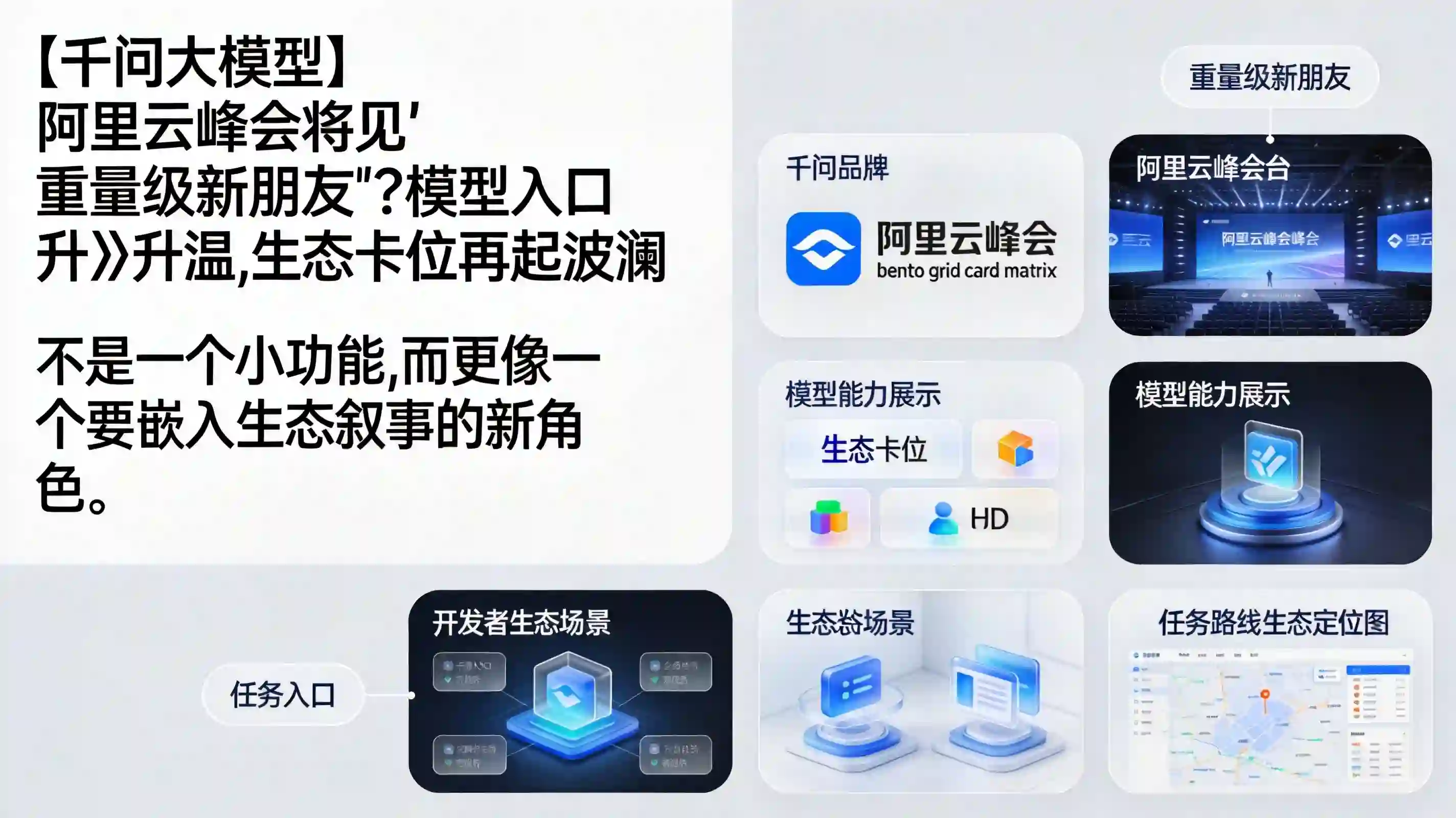

阿里云峰会将见“重量级新朋友”?模型入口升温,生态卡位再起波澜

2026-05-18

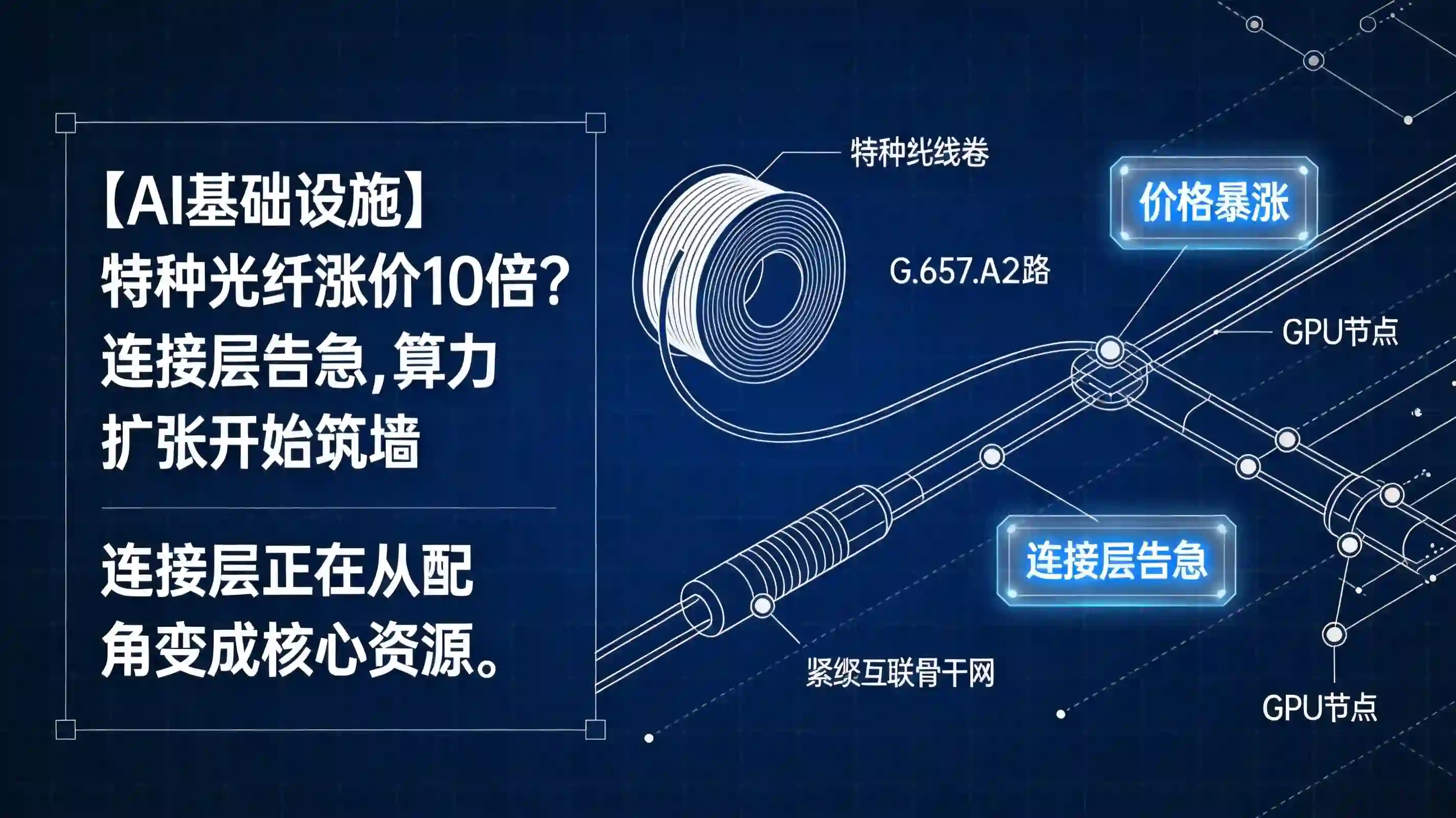

特种光纤涨价10倍?连接层告急,算力扩张开始筑墙

2026-05-18

App深度链接配置指南:Xinstall跨端无缝唤醒实战

2026-05-18

场景化渠道追踪怎么做?线下网吧与电梯动态传参归因实操

2026-05-18

H5用户行为追踪指南解析:跨端网页跳转App漏斗JS埋点

2026-05-18

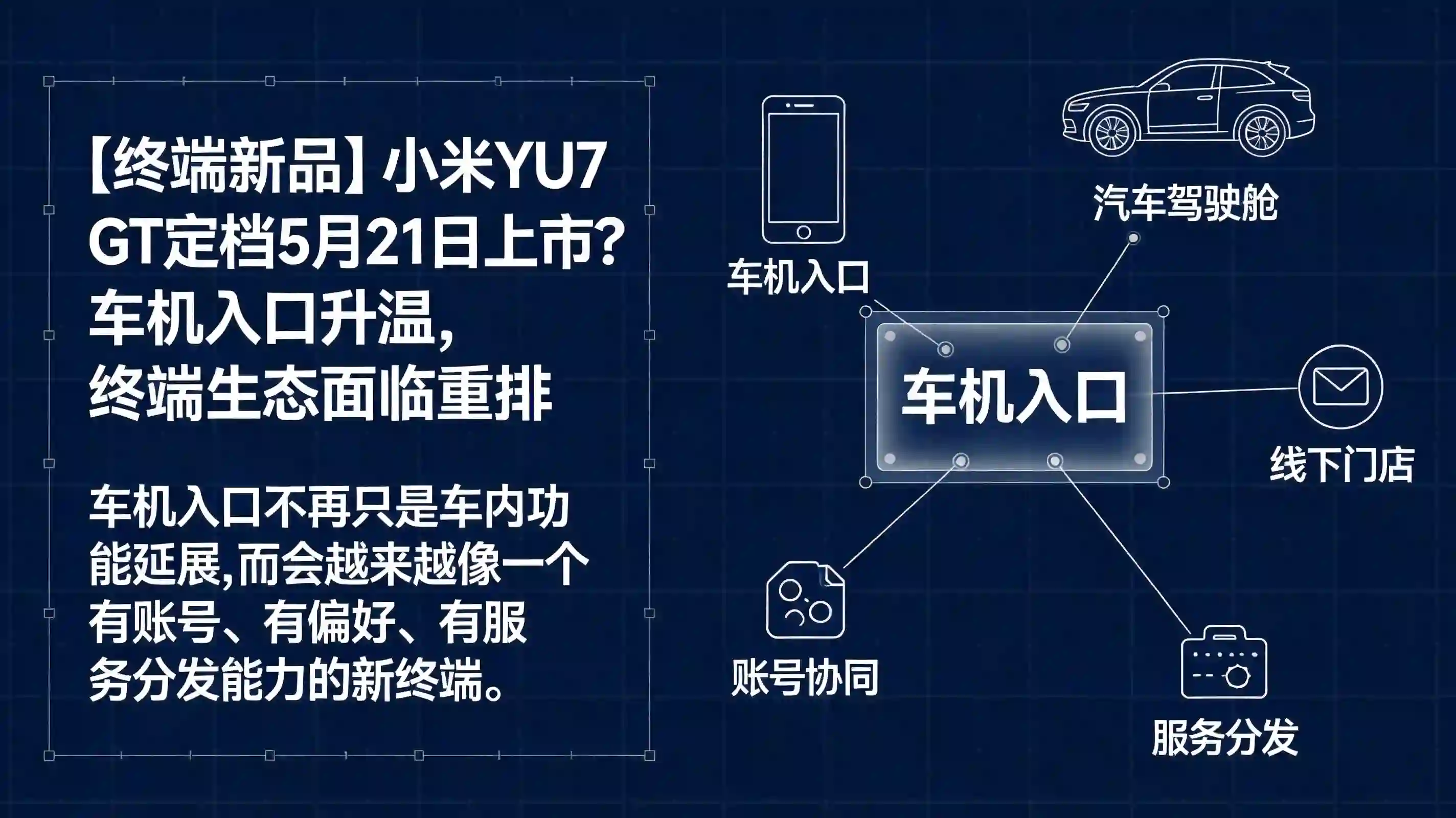

小米YU7 GT定档5月21日上市?车机入口升温,终端生态面临重排

2026-05-18

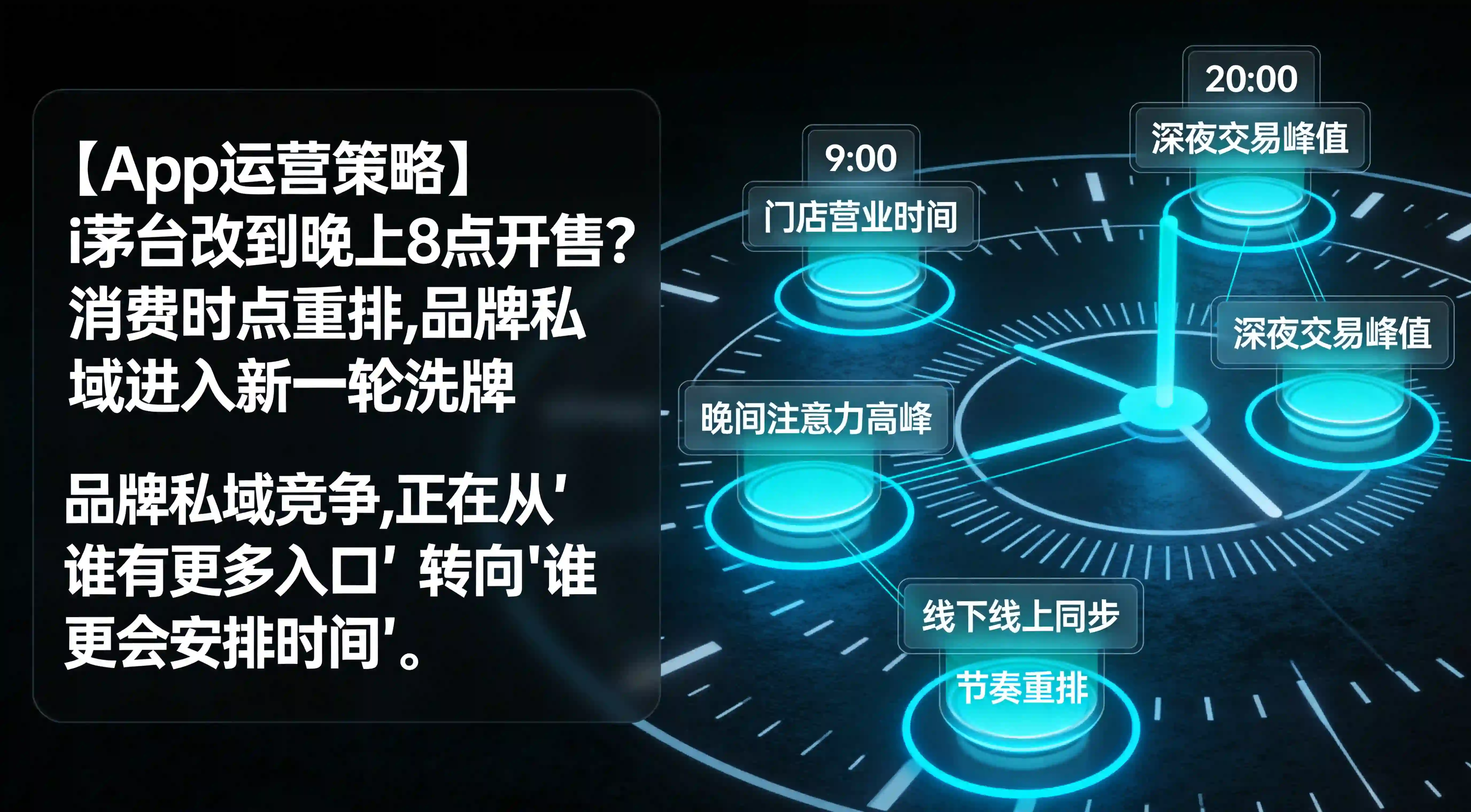

贵州茅台改到晚上8点开售?消费时点重排,品牌私域进入新一轮洗牌

2026-05-18

AI数据中心挤爆光纤产能?连接层吃紧,算力竞赛开始筑墙

2026-05-18

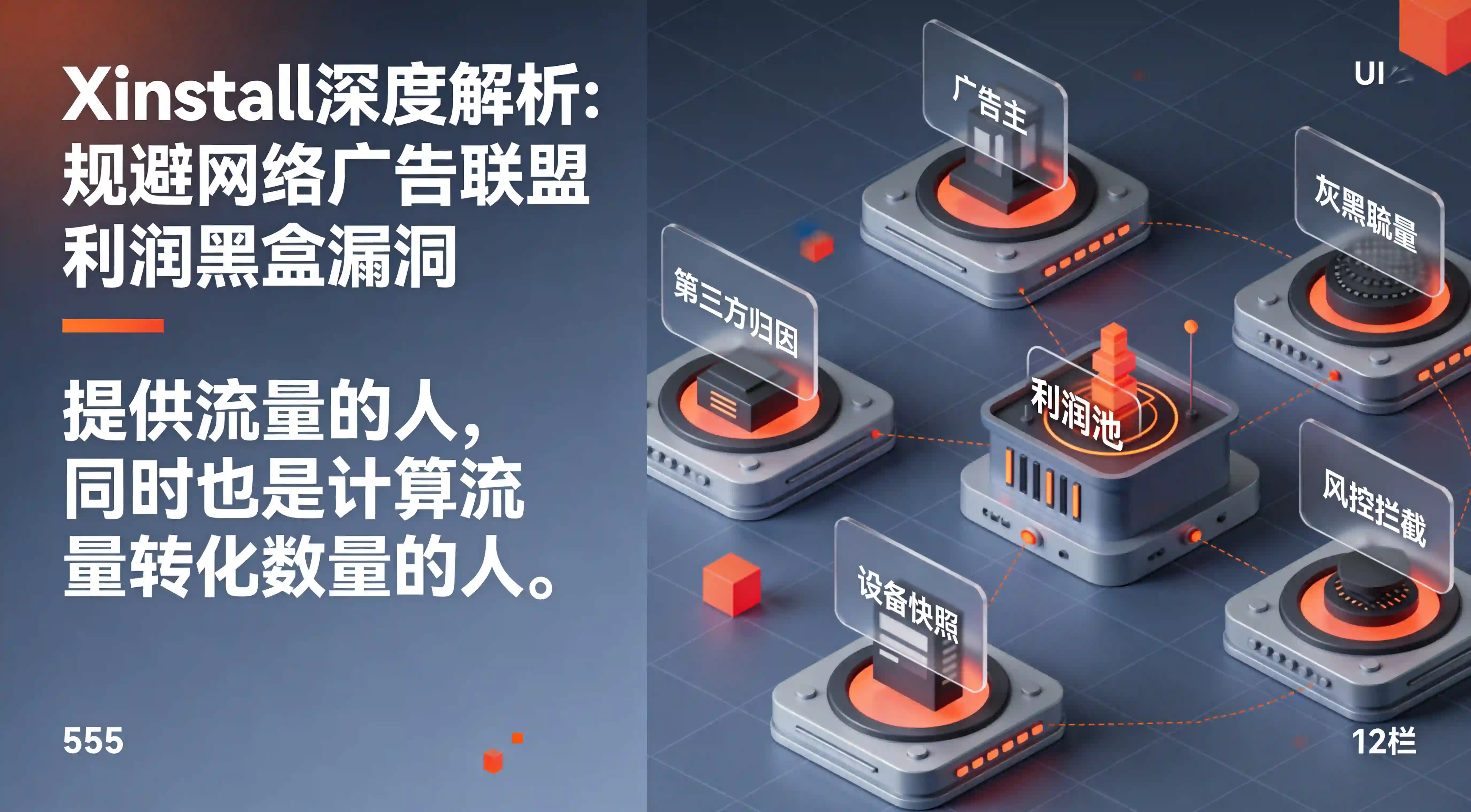

Xinstall深度解析:规避网络广告联盟利润黑盒漏洞

2026-05-15

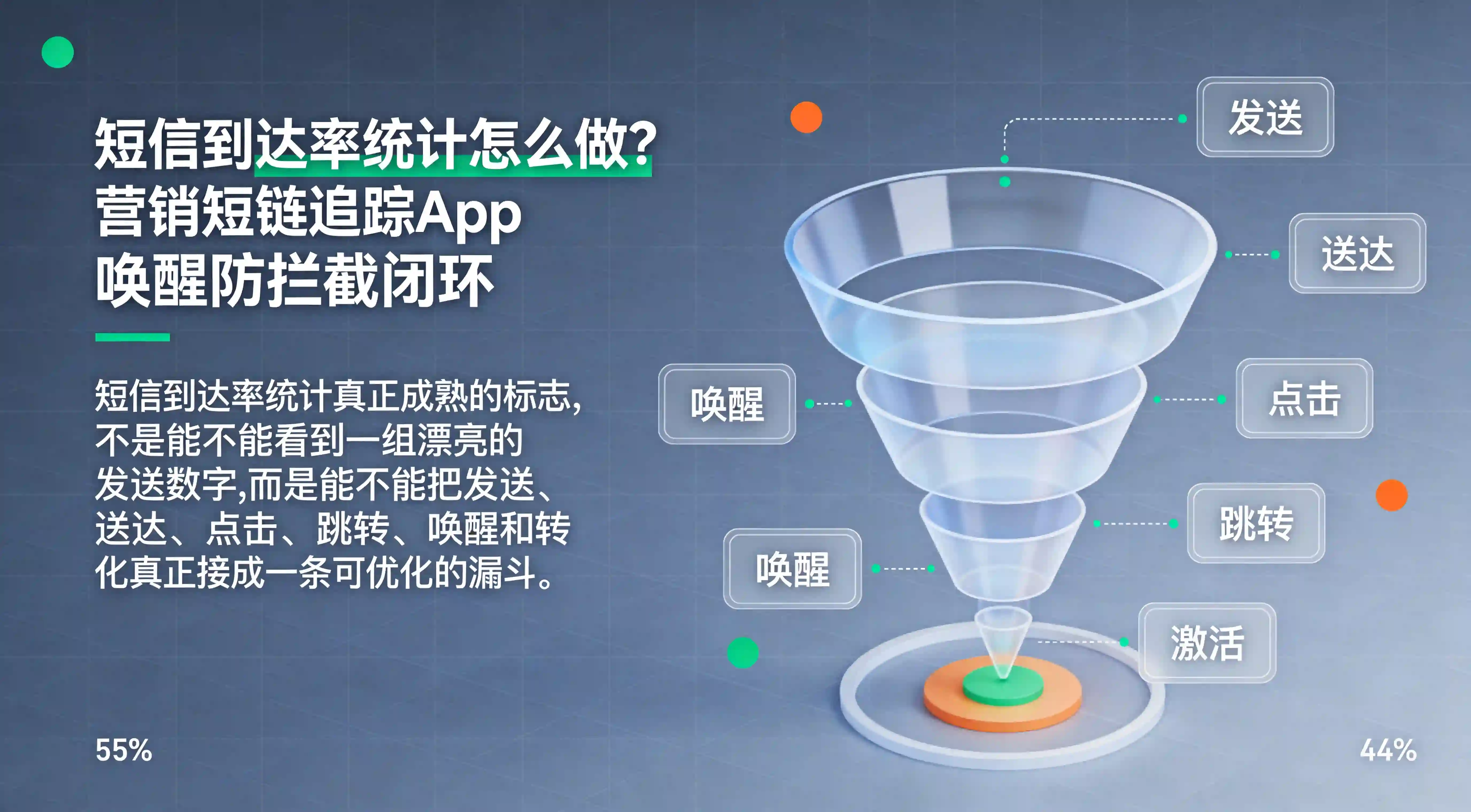

短信到达率统计怎么做?营销短链追踪App唤醒防拦截闭环

2026-05-15

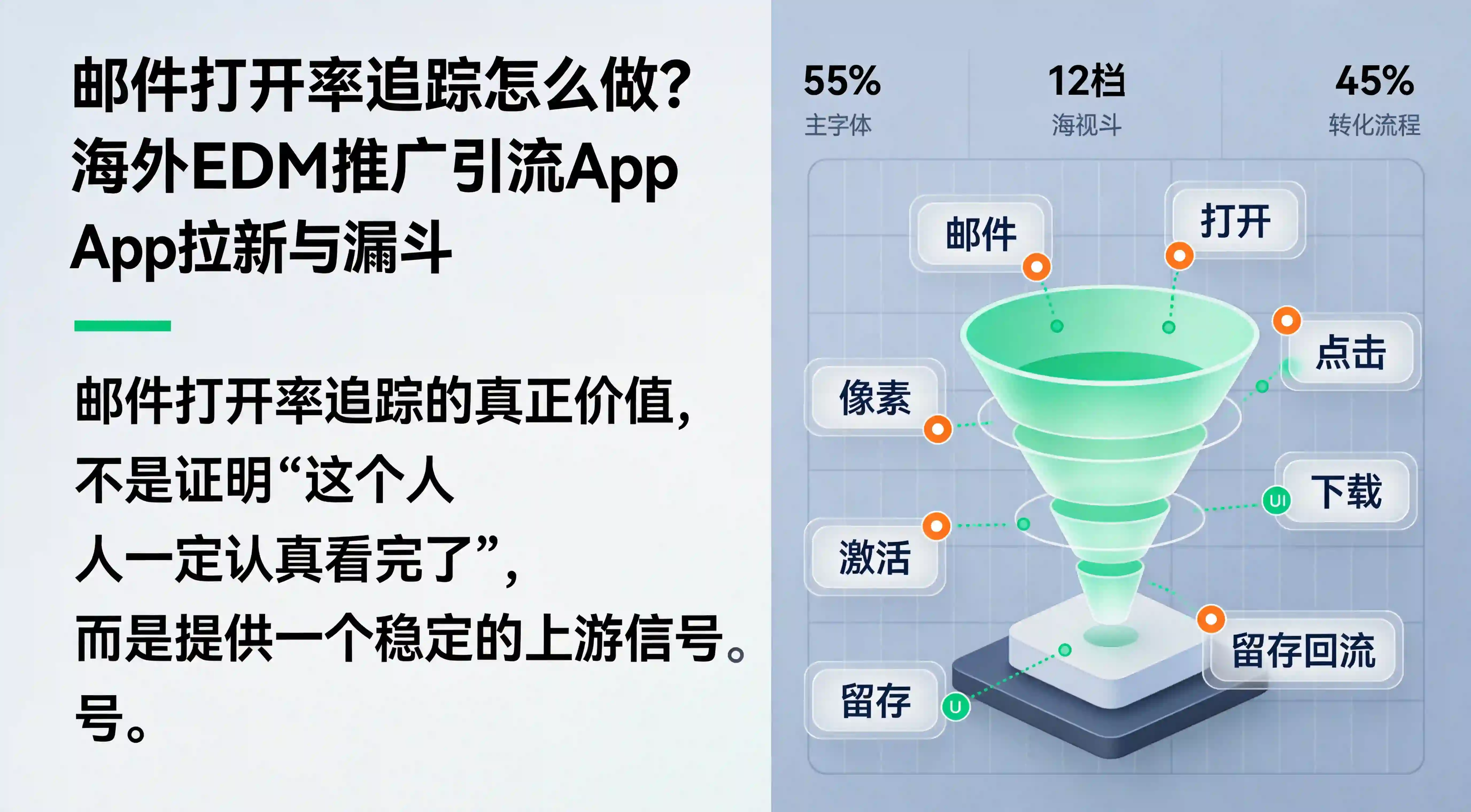

邮件打开率追踪怎么做?海外EDM推广引流App拉新与漏斗

2026-05-15

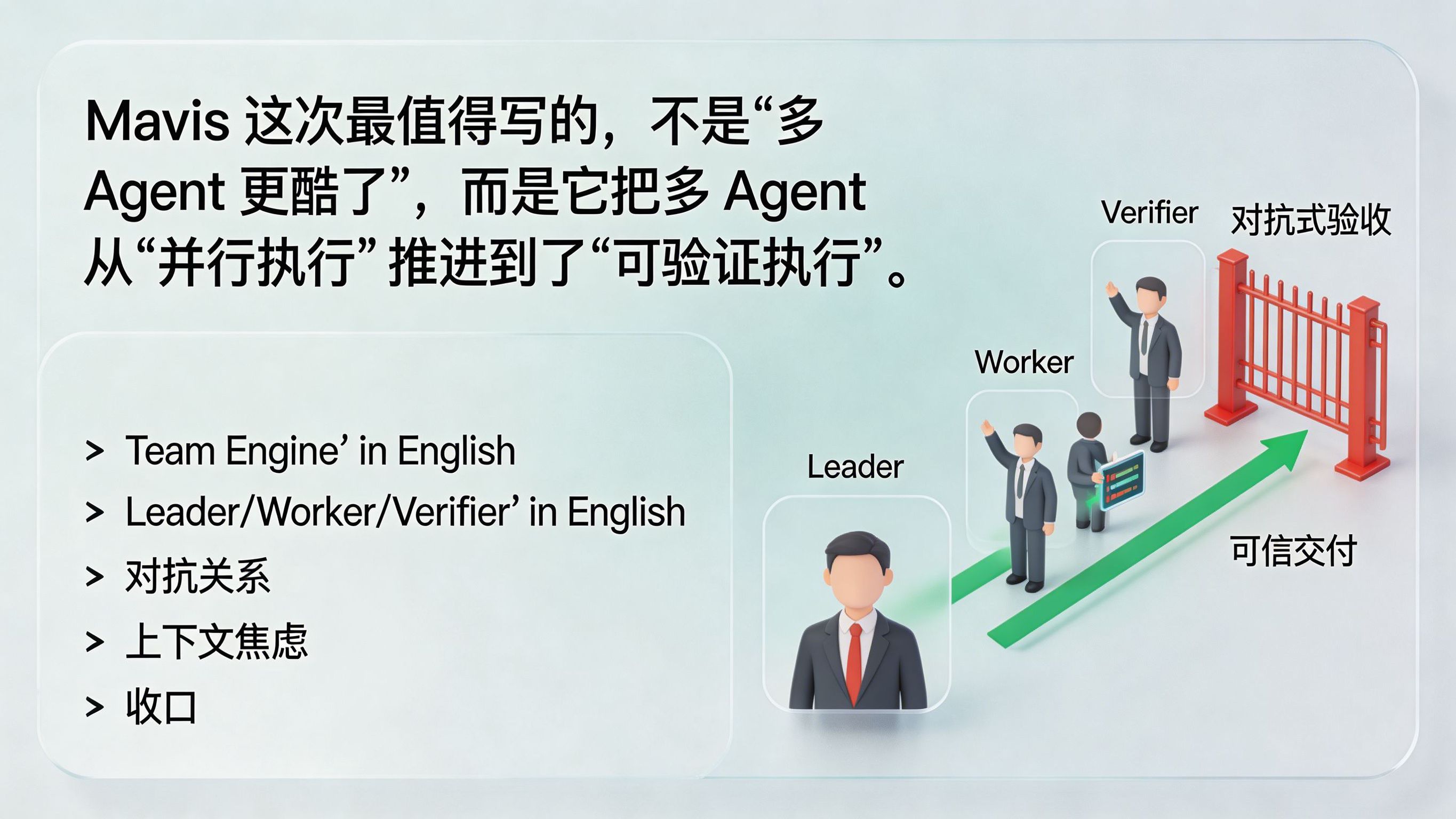

MiniMax推出Mavis?多Agent开始从“会分工”走向“会互相验收”

2026-05-15

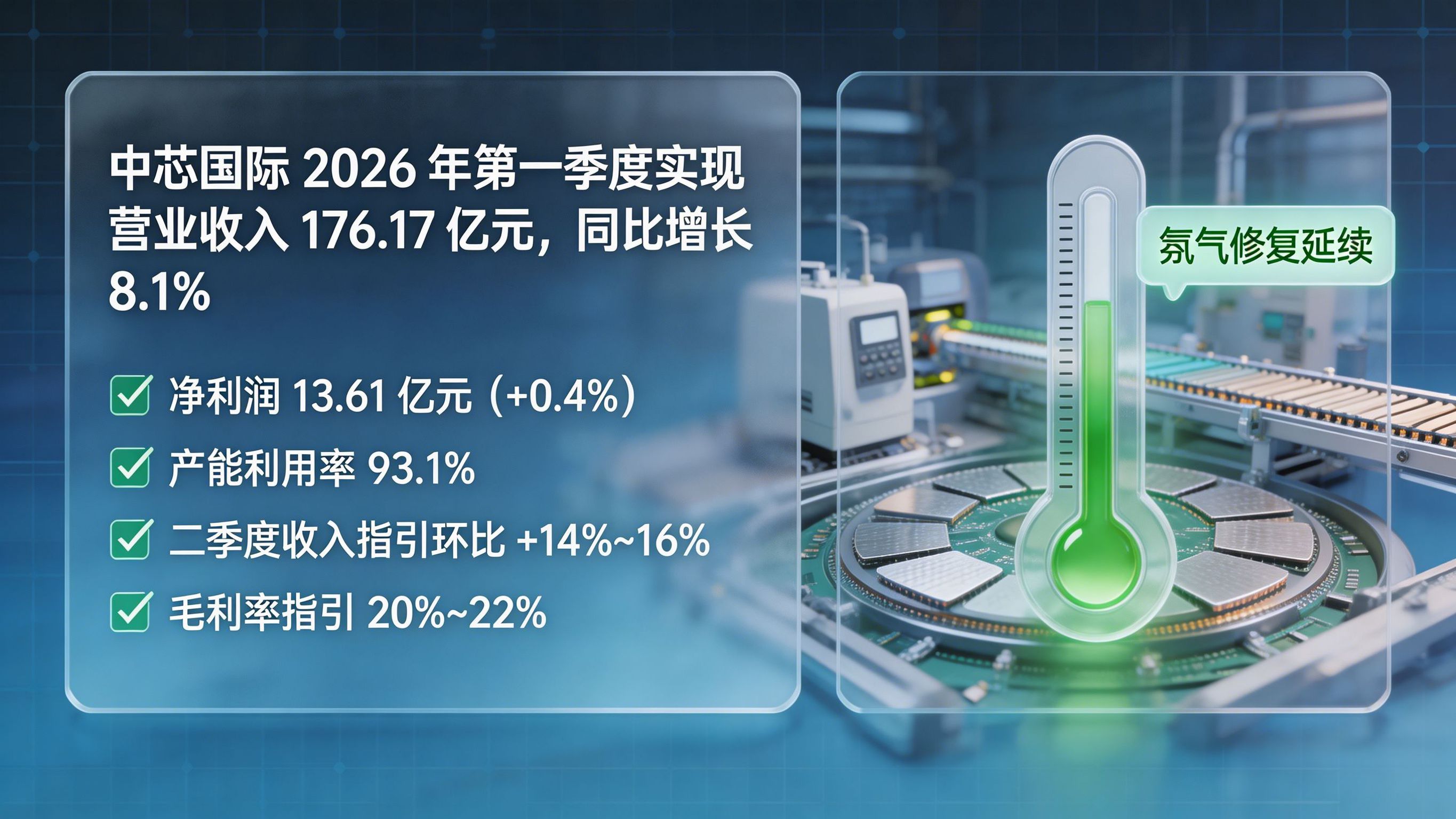

中芯国际一季度营收增长8.1%?国产芯片景气修复仍在延续

2026-05-15