手机微信扫一扫联系客服

184

184谷歌TurboQuant压缩KV缓存6倍,内存股暴跌。开发者复现浪潮中,如何追踪多平台模型分发与任务归因?

谷歌TurboQuant将AI推理内存压缩至1/6,内存股暴跌引发“DeepSeek时刻”,但开发者复现热潮下,模型分发归因成新痛点。

谷歌TurboQuant将AI推理内存压缩至1/6,内存股暴跌引发“DeepSeek时刻”,但开发者复现热潮下,模型分发归因成新痛点。

3月26日谷歌论文预热ICLR 2026,TurboQuant用PolarQuant+QJL实现3-bit零损KV缓存压缩,H100 GPU加速8倍,支持超长上下文/大批量。谷歌迎来“DeepSeek 时刻”!TurboQuant 引爆 AI 圈、全球开发者疯狂复现:6 倍无损压缩,内存股集体暴跌! 闪迪跌11%、希捷8%、西部数据7%,Cloudflare CEO称拉低AI成本;摩根士丹利澄清仅推理缓存,非HBM/训练。

对App开发者,压缩降本加速部署,但多云分发追踪缺失:复现链从哪来、参数如何继承?

TurboQuant论文引爆,压缩仅限KV缓存,但开发者复现火热。

PolarQuant极坐标量化+QJL变换,压缩至1/6;H100上4-8倍吞吐,长上下文无溢出。仅推理,非权重HBM/训练。

闪迪-11%、希捷-8%、超威/西部数据/美光-7%。Cloudflare CEO赞极致效率降成本,摩根士丹利指仅提升单GPU批处理,非总存储减。

论文预热即引爆,开发者复现验证,预示AI部署门槛降。

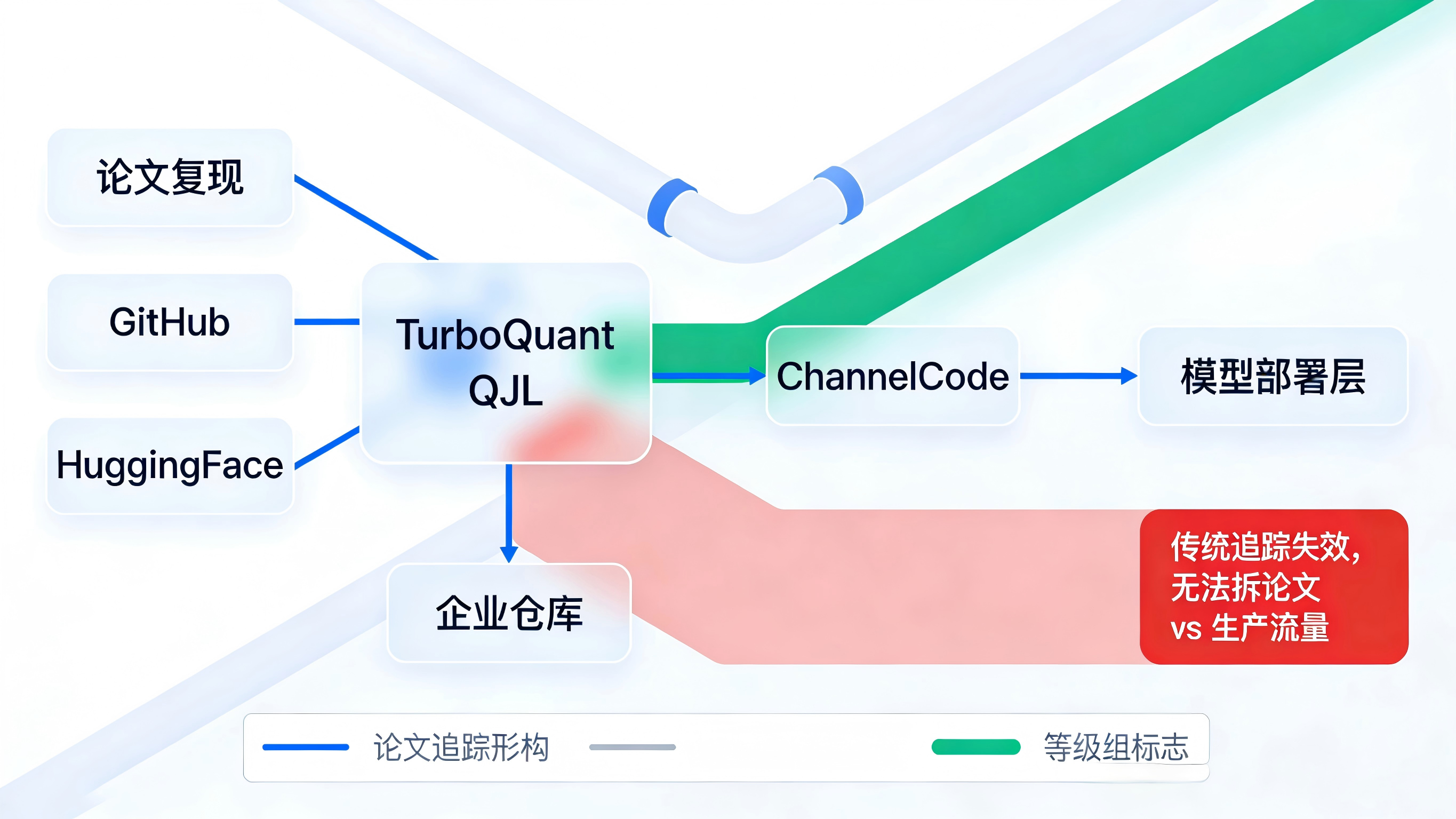

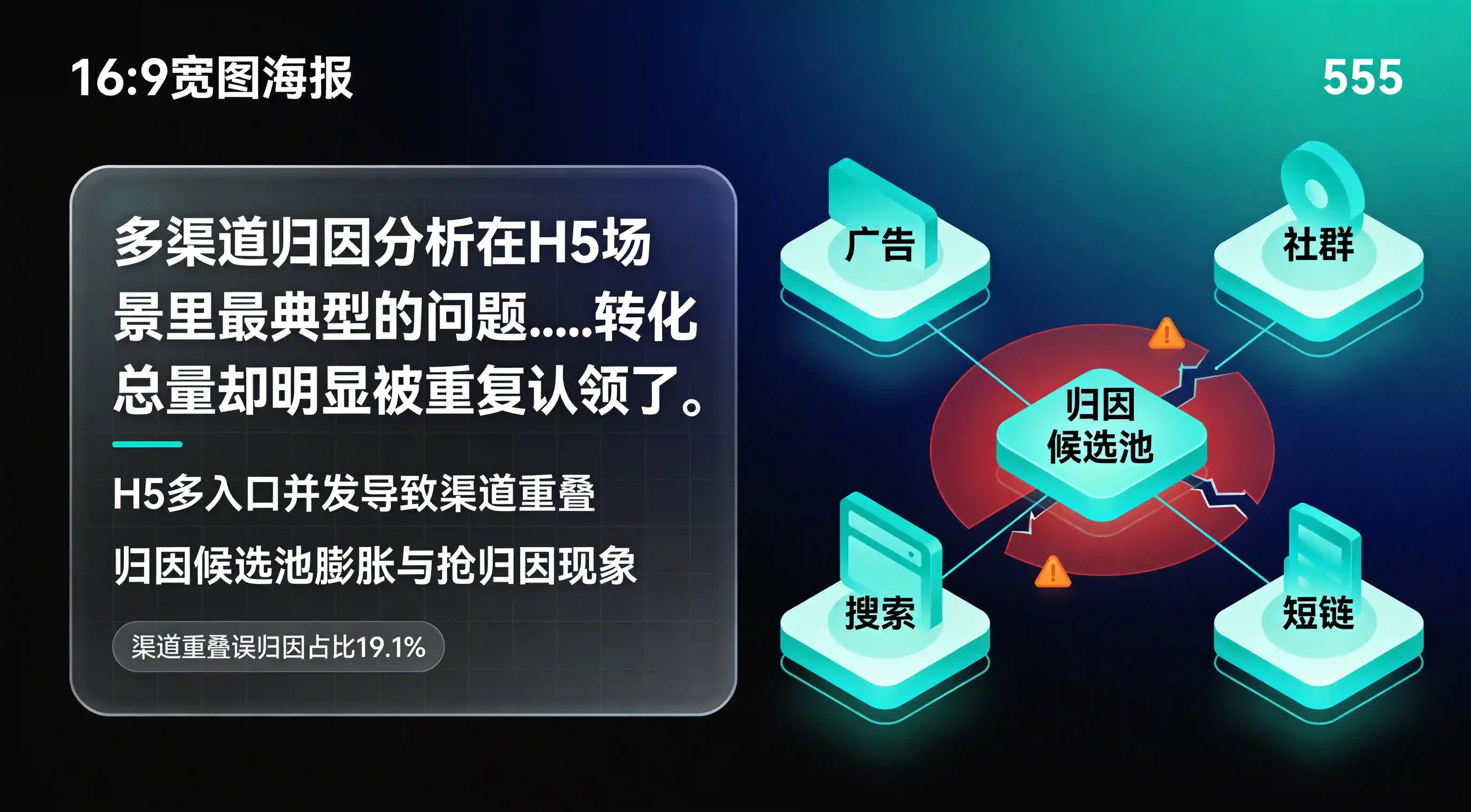

TurboQuant降本,模型从云端推本地/边缘:复现任务跨GitHub/HuggingFace/企业仓库,参数(量化精度、上下文ID)丢了重配;多GPU批处理,来源混杂不知ROI。

传统追踪失效,无法拆“论文复现 vs 生产部署”流量。

问题:论文/复现平台多入口,模型部署源不明。

做法:下载/部署接口嵌入ChannelCode,标记TurboQuant复现等。《亚马逊 AI 战略升级?多云多 Agent 时代 App 该怎么认清流量真身》

好处:统计“压缩模型任务流量”,指导多云合作。

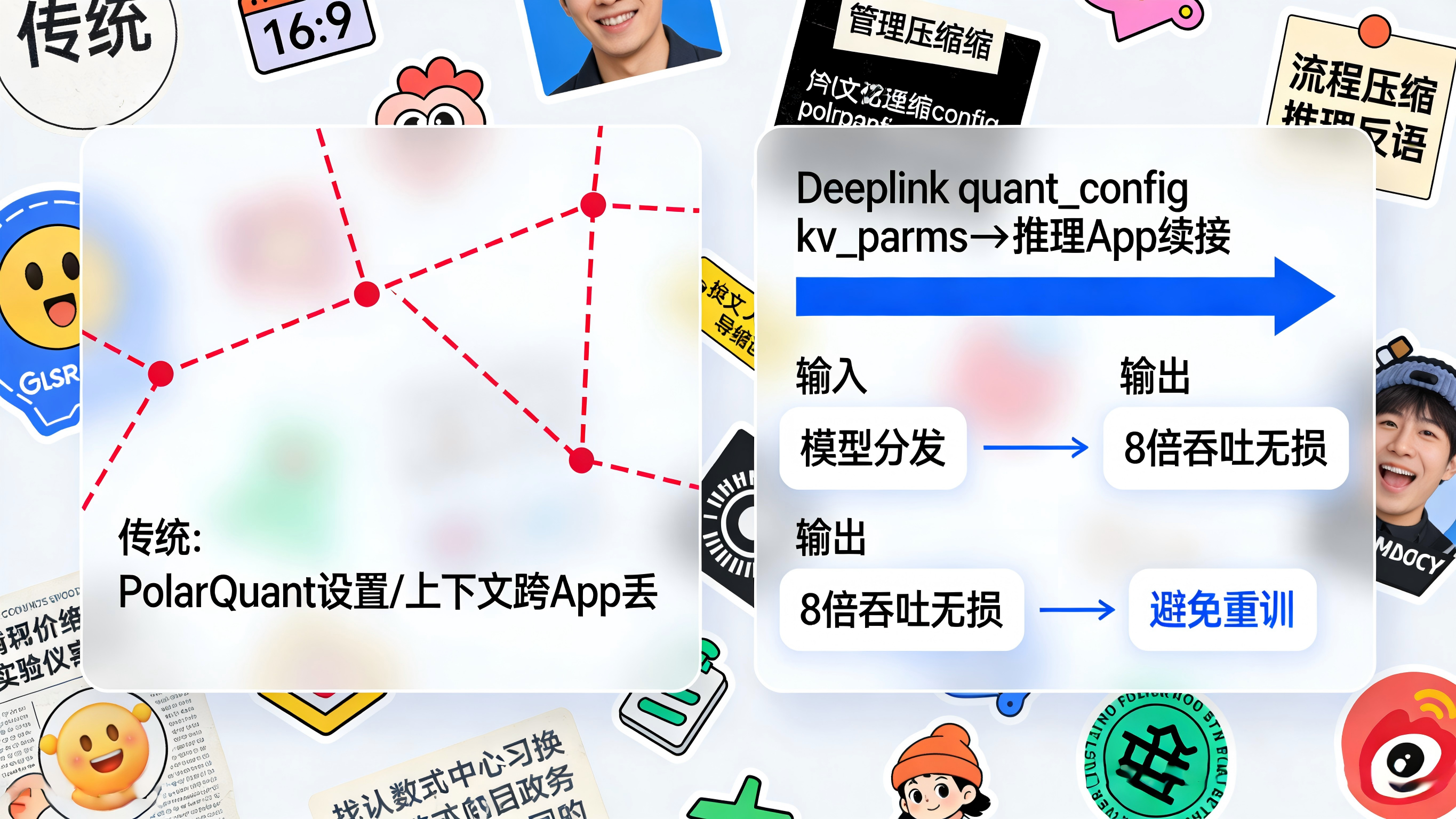

问题:PolarQuant设置/上下文跨App丢。

做法:DeepLink封装quant_config、kv_params,智能传参安装还原。《智能体分发时代 App 安装传参逻辑的底层重构》

好处:推理App启动续接,避免重训。

问题:8倍吞吐多任务断裂。

做法:Session ID云端还原。

好处:可视“复现下载->部署->推理加速”路径。

注:本文探讨的AI模型分发归因属于前瞻延展。目前高度定制链路尚未标准实现,如有需求,欢迎联系 Xinstall 客服探讨研发。

面向开发 / 架构团队:

预留model_source、quant_bits字段,支持KV传参。测试TurboQuant兼容。

面向产品 / 增长团队:

压缩为分发渠道,建立ChannelCode统计。复现热抢模型流量。

仅KV缓存3-bit零损,1/6内存;H100 4-8倍吞吐,长上下文/大批量。

市场误读为总存储减,实际仅推理加速;DeepSeek式效率拉低成本预期。

否,仅推理KV缓存,非权重HBM/训练。

ICLR 2026发布,无具体时间表。

TurboQuant降本,AI从云向边缘,模型分发碎片化。

App团队需渠道归因穿越压缩黑箱,捕捉复现红利。

上一篇

上一篇

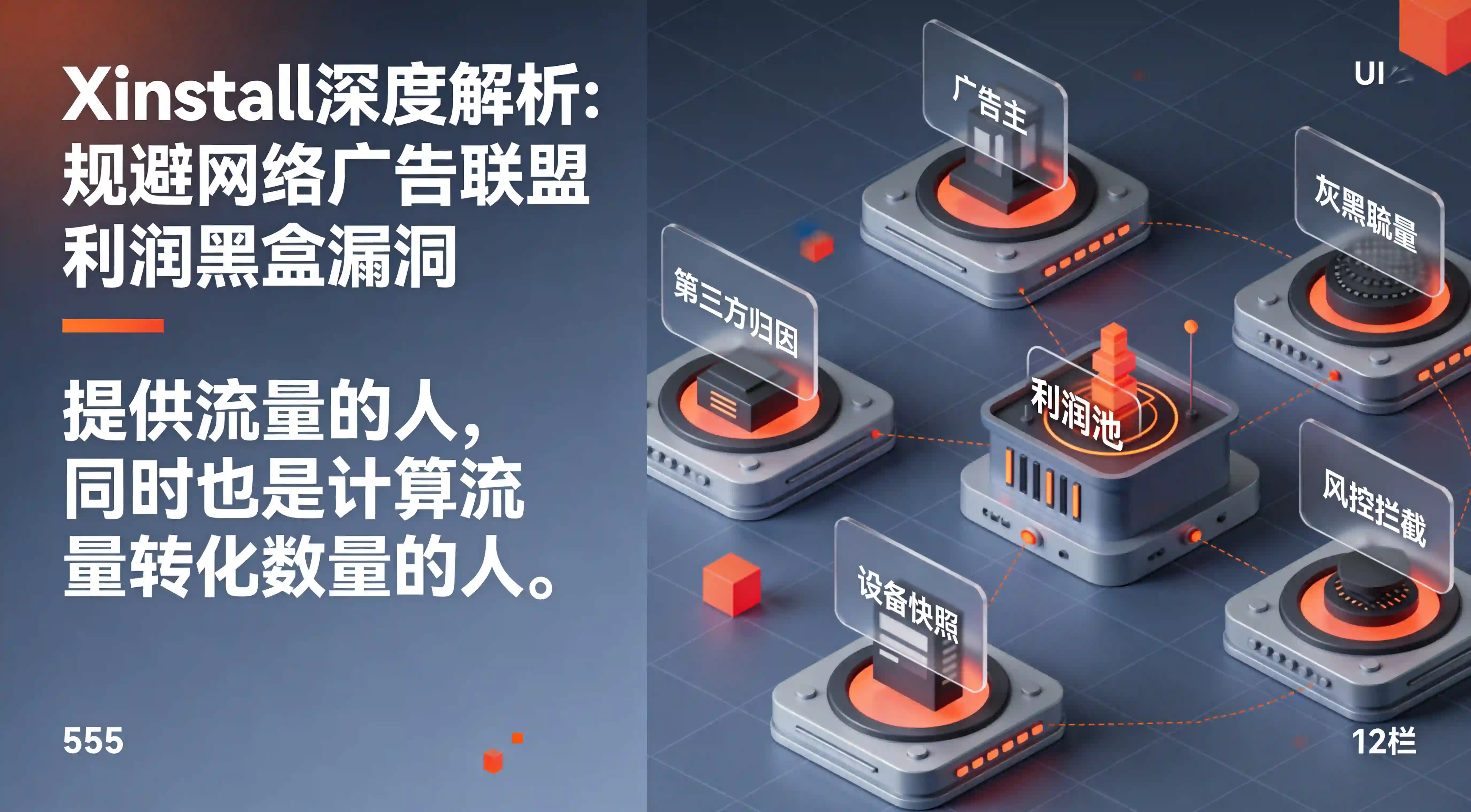

Xinstall深度解析:规避网络广告联盟利润黑盒漏洞

2026-05-15

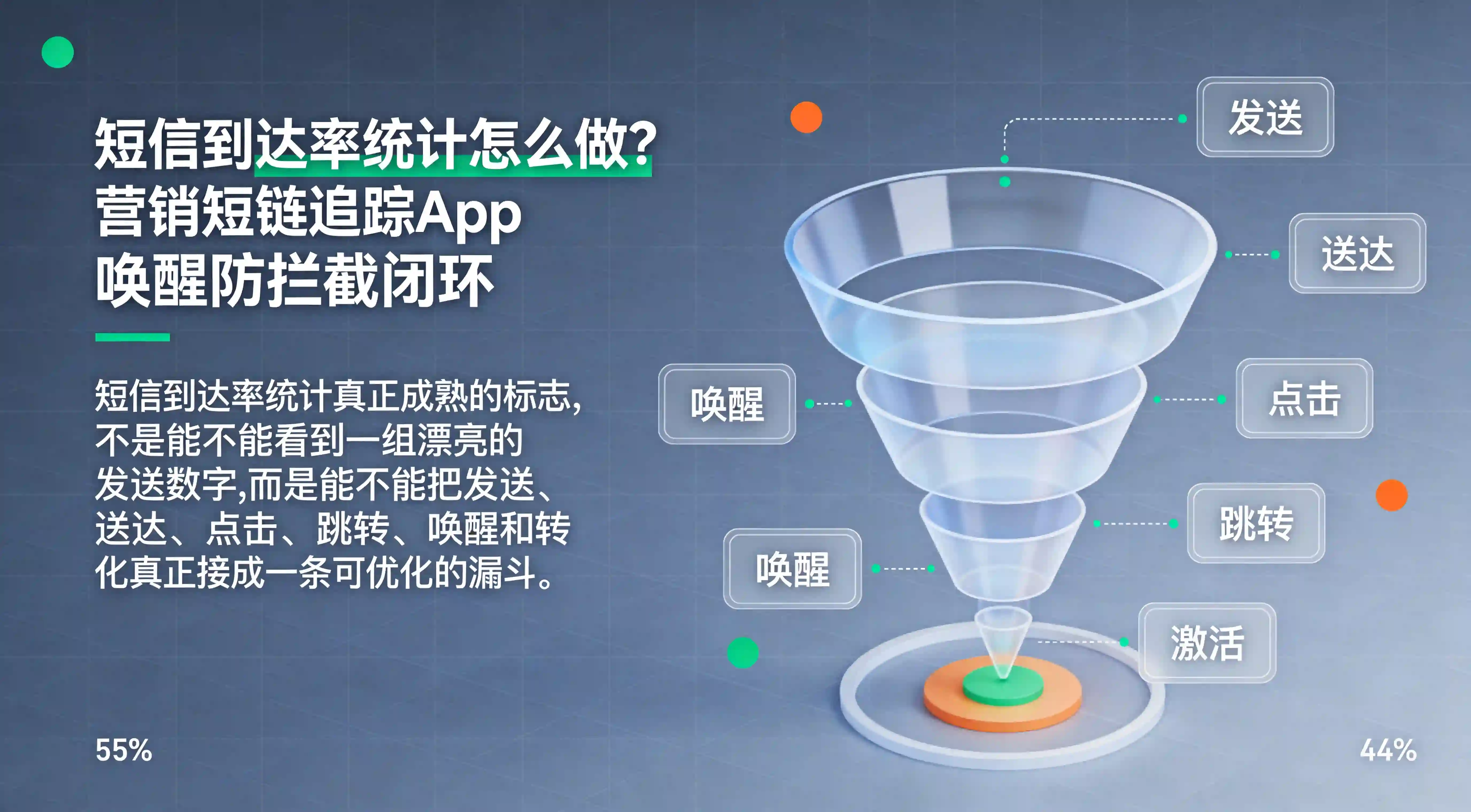

短信到达率统计怎么做?营销短链追踪App唤醒防拦截闭环

2026-05-15

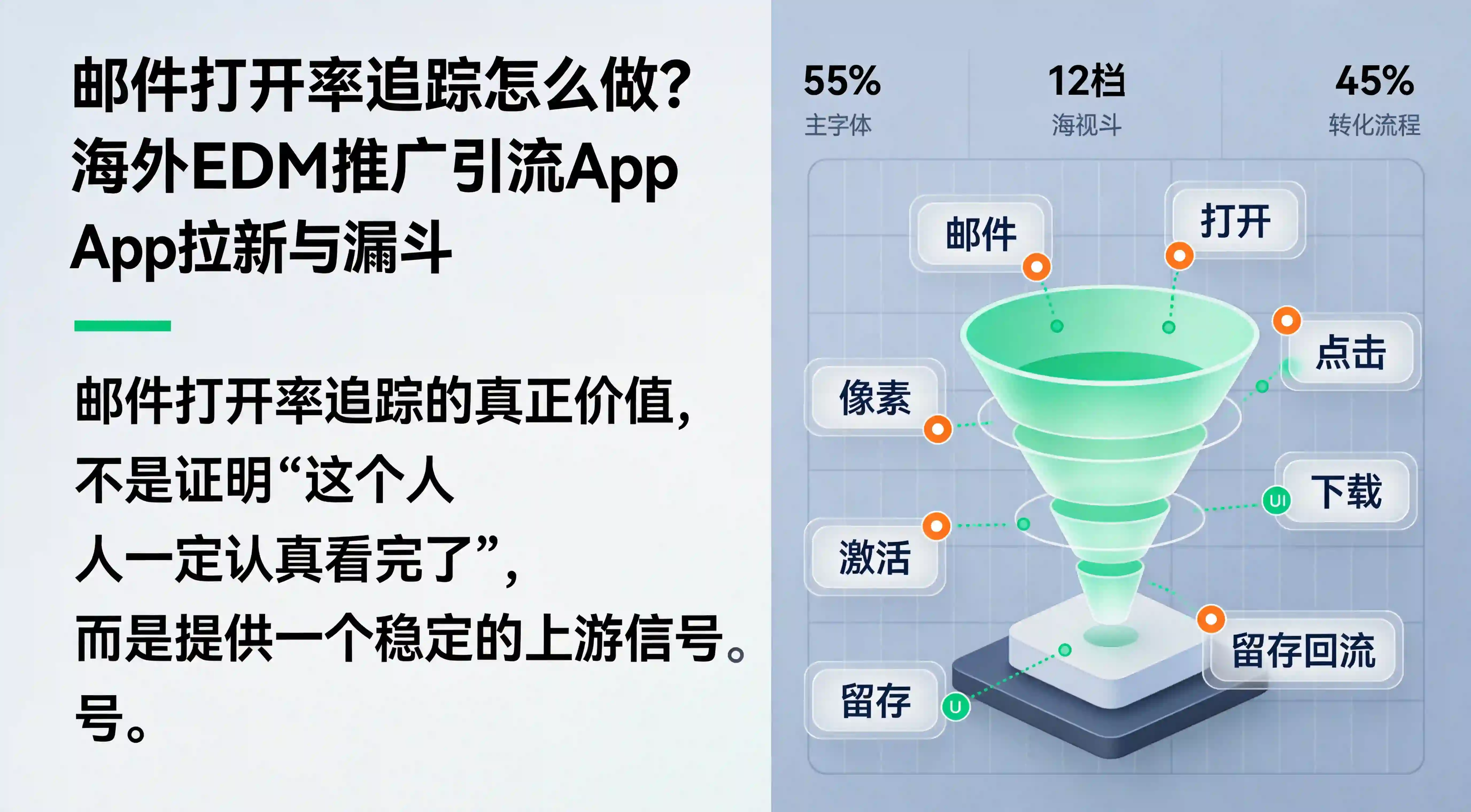

邮件打开率追踪怎么做?海外EDM推广引流App拉新与漏斗

2026-05-15

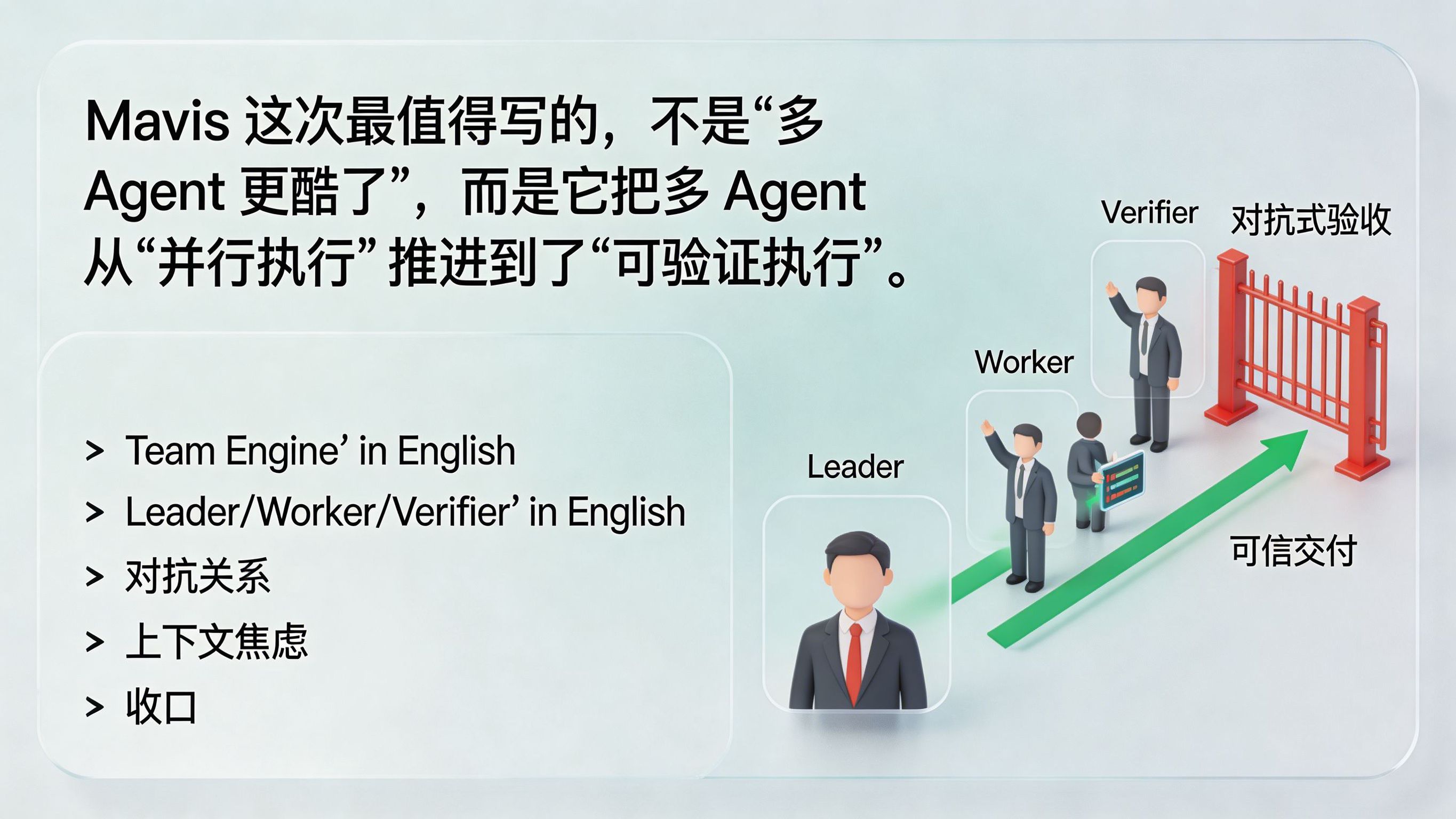

MiniMax推出Mavis?多Agent开始从“会分工”走向“会互相验收”

2026-05-15

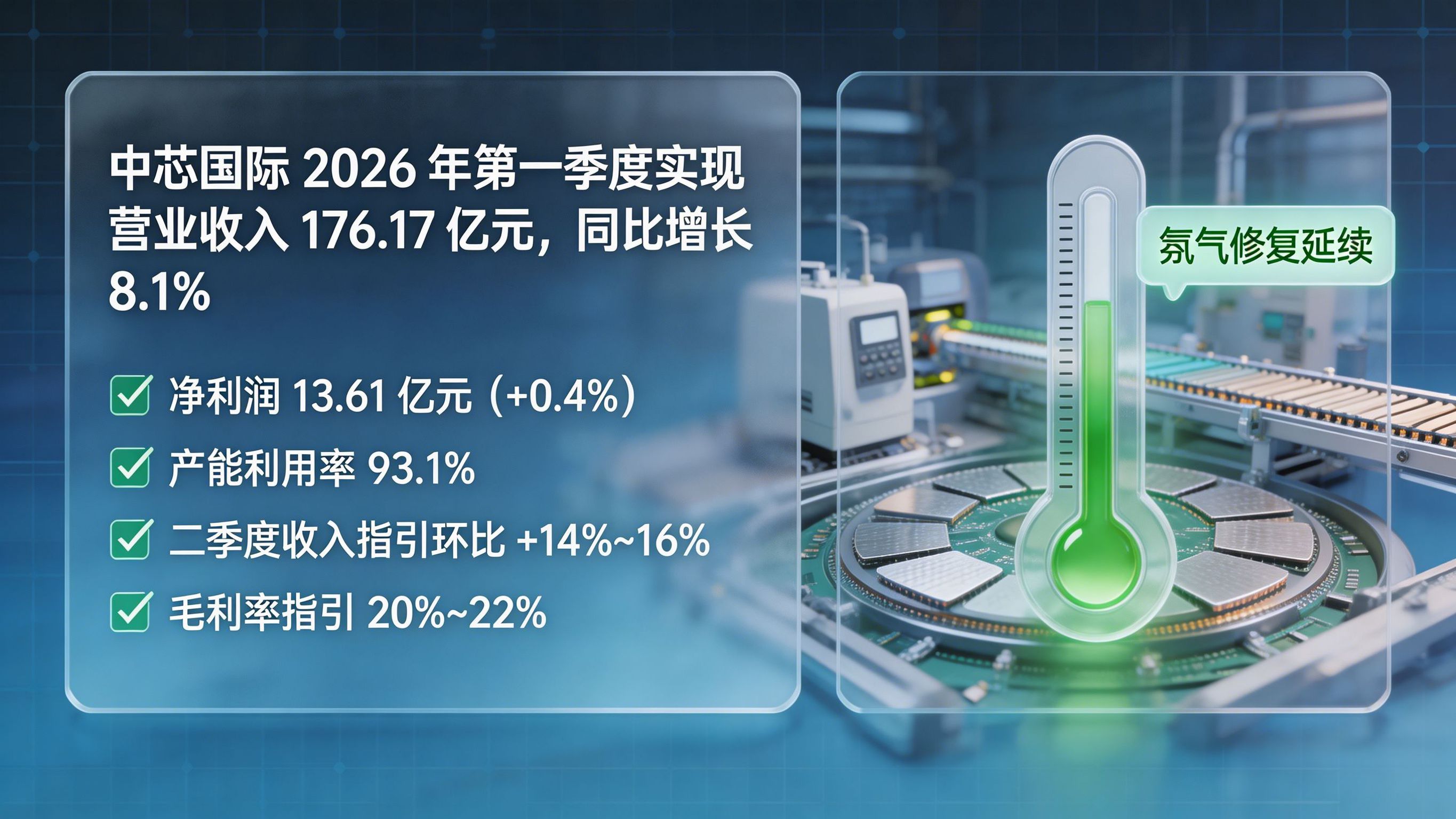

中芯国际一季度营收增长8.1%?国产芯片景气修复仍在延续

2026-05-15

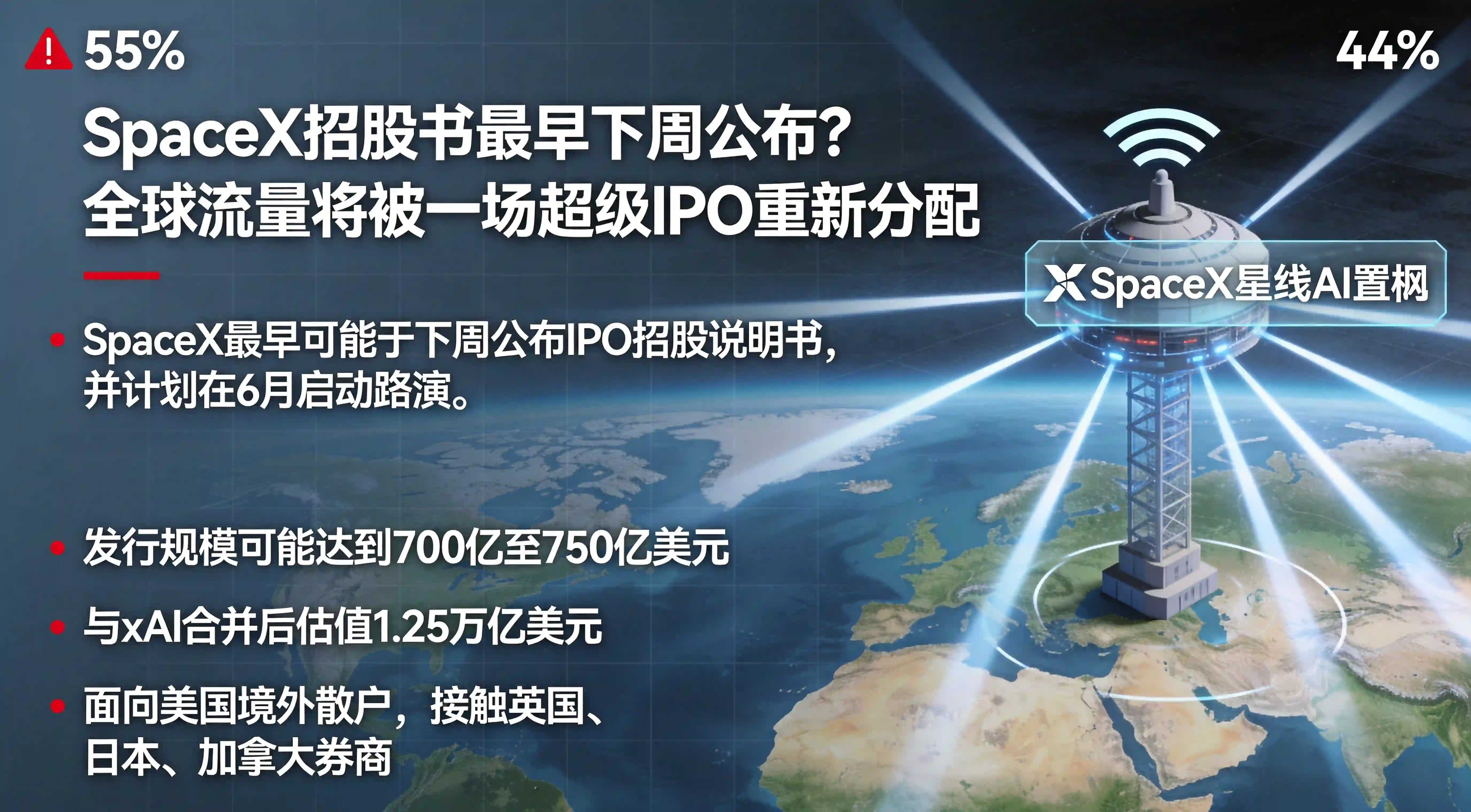

SpaceX招股书最早下周公布?全球流量将被一场超级IPO重新分配

2026-05-15

大数据分析平台怎么搭?Xinstall海量日志ETL处理实战

2026-05-14

微信活动统计怎么做?私域H5防封跳转与精准引流归因架构

2026-05-14

广告安全策略怎么制定?防底层数据篡改与加密传输接口

2026-05-14

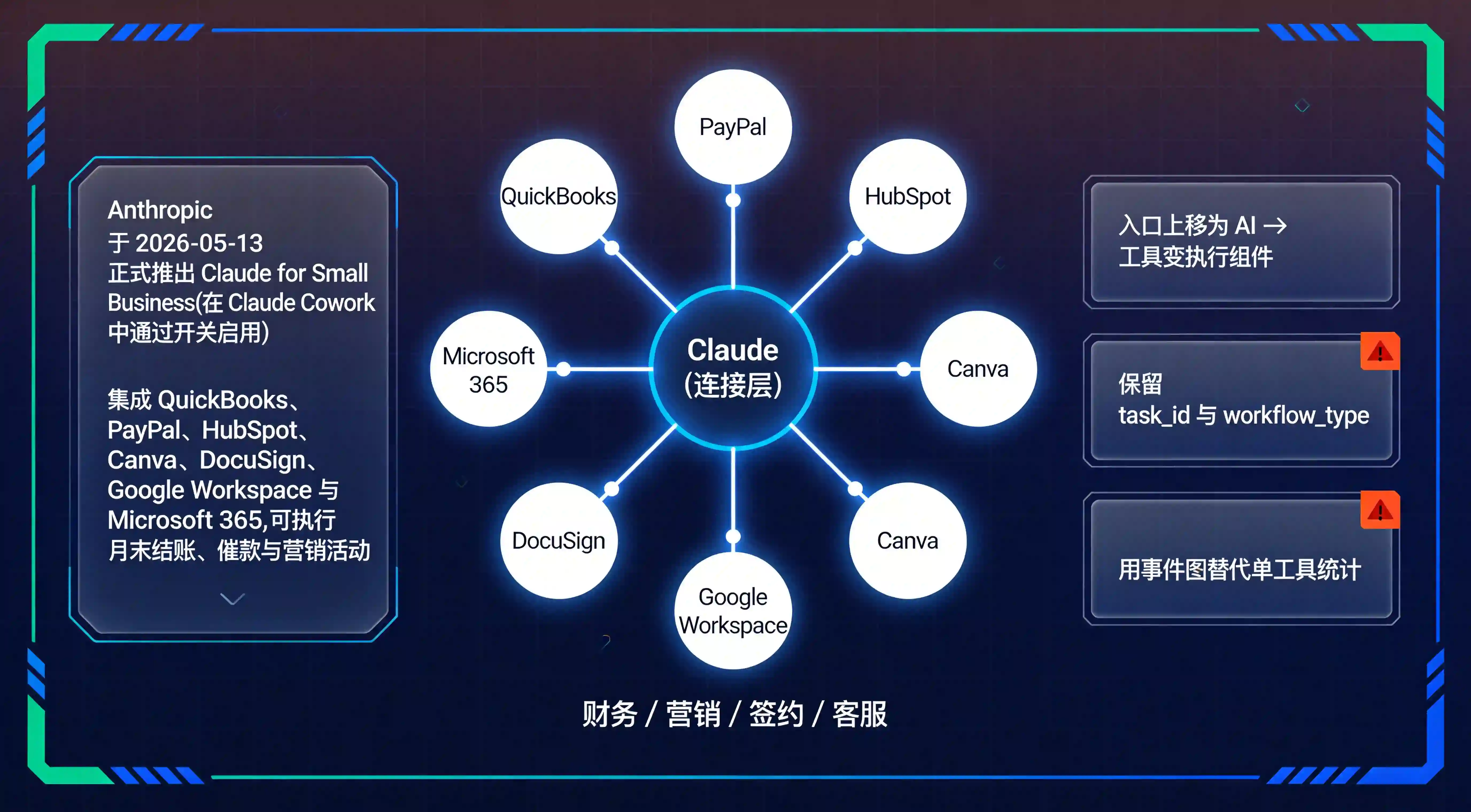

Claude for Small Business来了?AI下沉加速,企业入口再分化

2026-05-14

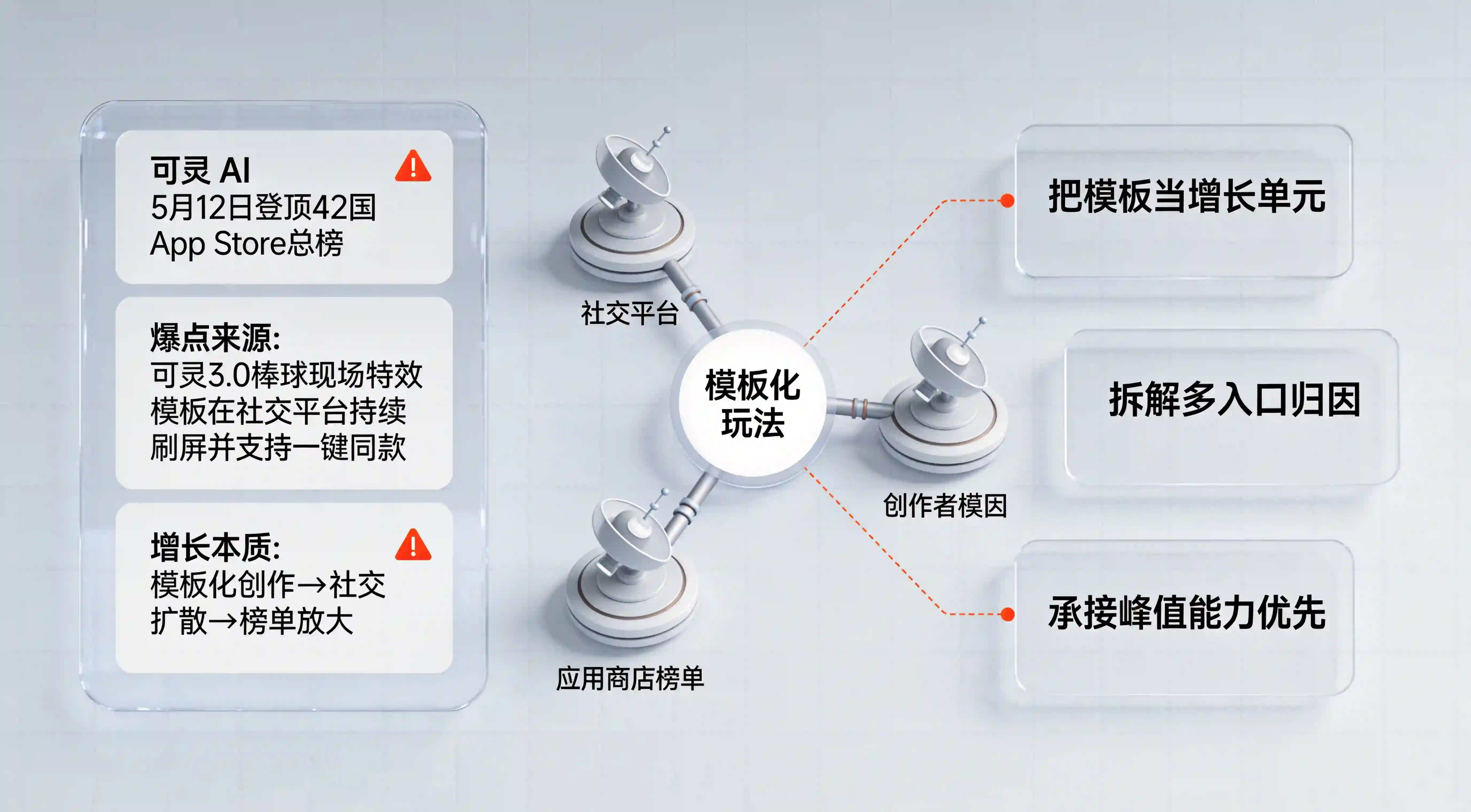

可灵AI登顶42国App Store总榜?全球流量外溢,出海入口生变

2026-05-14

谷歌发布安卓 AI 系统:系统入口前移,分发格局开始改写?

2026-05-14

媒体作弊监控怎么防?净化广告投放对账流的实时核销方案

2026-05-13

百度搭子DuMate正式亮相?统一入口升温,Agent分发开始变天

2026-05-13

微信已读和访客功能“已焊死”?熟人社交边界收紧,私域规则不会变

2026-05-13