手机微信扫一扫联系客服

4

4DeepSeek V4成OpenClaw默认模型后,默认分发位、会议语音入口与浏览器任务链同步前置,开发者和增长团队面临4.2倍级别的入口解释压力。

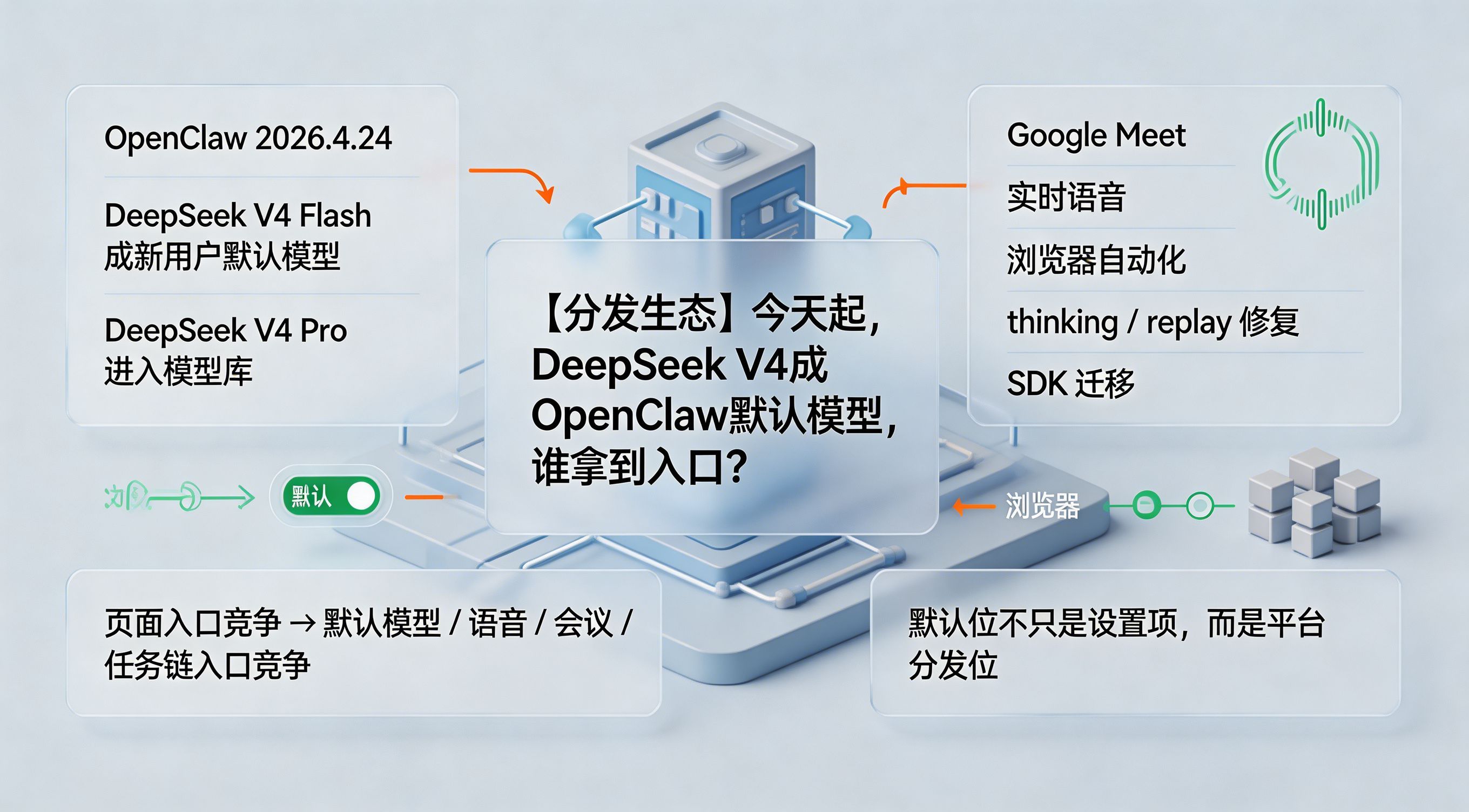

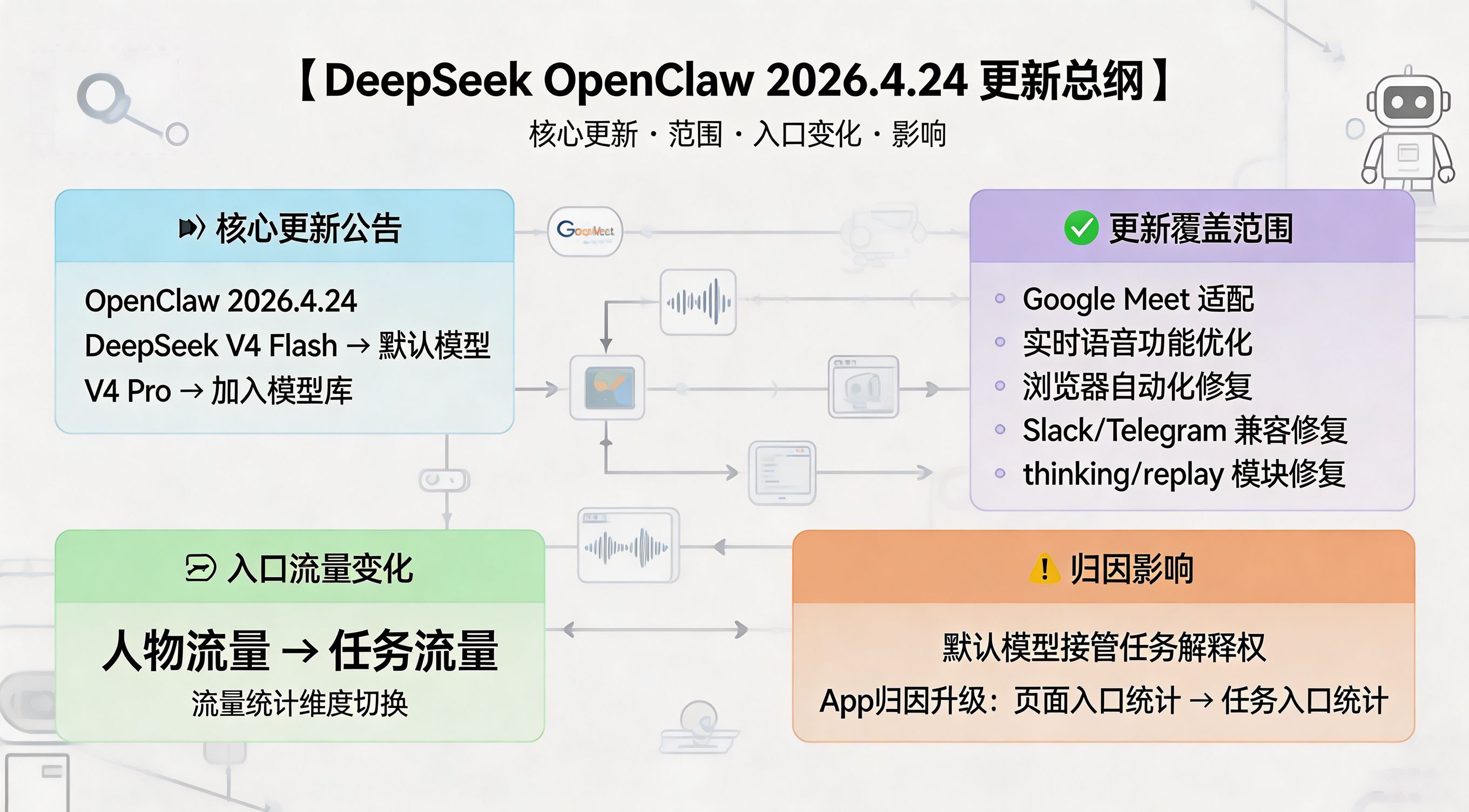

今天起,DeepSeek V4 成为 OpenClaw 默认模型,这看起来像是一次模型层更新,真正被改写的却是智能体平台里的默认入口和分发顺序。对 App 开发者、产品经理和增长负责人来说,这件事最值得警惕的不是“谁更聪明”,而是【分发生态】正在从页面入口竞争,转向默认模型、语音入口和任务链入口的重新分配。

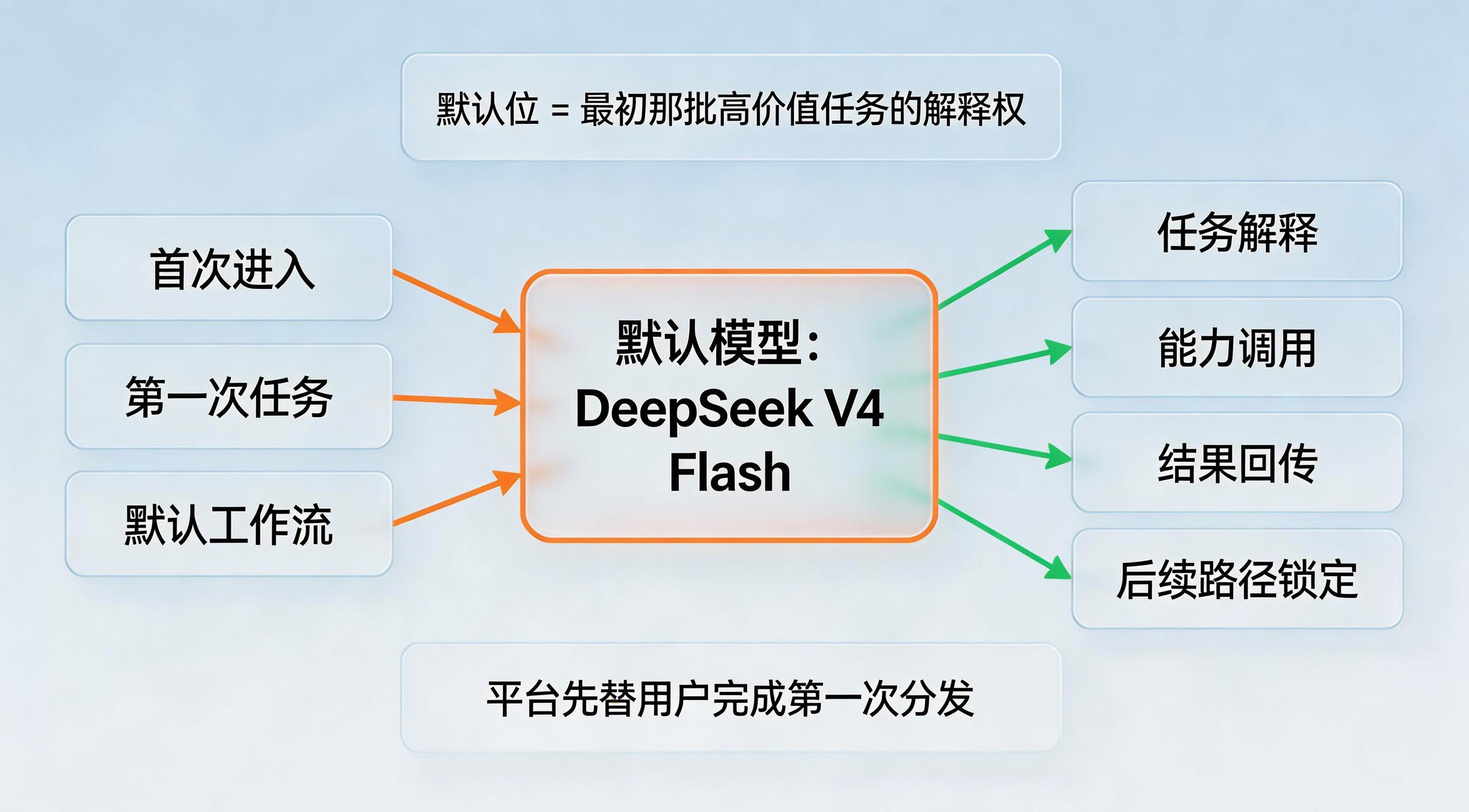

4 月 26 日,多家媒体转引 OpenClaw 2026.4.24 版本更新信息称,平台已接入 DeepSeek V4 双版本,其中 DeepSeek V4 Flash 成为新用户默认模型,V4 Pro 同步进入模型库。今天起,DeepSeek V4成OpenClaw默认模型! 今天,OpenClaw能用DeepSeek-V4了!还设成了默认模型 这意味着,更新后的 OpenClaw 用户第一次进入系统、第一次发起任务、第一次用默认路径跑工作流时,最先接触到的“智能体大脑”已经变成 DeepSeek V4 Flash。

很多人会把“默认模型”理解成一个可切换设置,但在平台层面,它更接近一个分发位。 搜索产品有默认搜索框,手机系统有默认浏览器,应用商店有默认推荐位;同样,在 Agent 平台中,默认模型决定了大部分首次体验和默认任务会先走哪条能力路径。谁拿到默认位,谁就拿到最初那批高价值任务的解释权。

搜索产品有默认搜索框,手机系统有默认浏览器,应用商店有默认推荐位;同样,在 Agent 平台中,默认模型决定了大部分首次体验和默认任务会先走哪条能力路径。谁拿到默认位,谁就拿到最初那批高价值任务的解释权。

从媒体传播语境看,这次事件也明显被包装成“中国开源模型站上全球热门 Agent 框架 C 位”。席卷全球AI圈!DeepSeek-V4成OpenClaw默认模型 这种叙事当然有它的情绪价值,但如果从产品和增长角度看,更关键的问题其实不是“谁上了 C 位”,而是“C 位意味着什么流量和任务会被优先吸走”。

公开报道里,DeepSeek V4 Pro 被描述为 1.6 万亿总参数、49B 激活参数的 MoE 架构大模型,而 DeepSeek V4 Flash 则是 284B 总参数、13B 激活参数,同样采用 MoE 架构,主打更快、更便宜,但在 Max 模式下推理能力接近 Pro 版本。今天起,DeepSeek V4成OpenClaw默认模型! 两个模型都支持 100 万 token 上下文,并采用 MIT 协议开源,这让它们天然更适合进入强调工具调用与长上下文的 Agent 平台。

默认模型从来不是“最强那个”自动获胜,而是“最适合作为第一入口”的那个更容易上位。平台默认项要承担的是广泛的第一触达任务:既要够快,又要便宜,还得足够稳,最好还能在大多数场景里不出大错。DeepSeek V4 Flash 的组合优势,恰好符合这个逻辑。DeepSeek 全新系列模型DeepSeek-V4 预览版正式上线并同步开源

从这个角度看,这次默认位调整更像一次平台级路由重排。用户未必主动去比较 Flash 和 Pro,也不一定先研究模型参数,但默认路径已经替他们完成了第一次分发。也就是说,在真正的使用习惯形成之前,平台已经先帮某个模型拿走了注意力和任务机会。

如果只看社交媒体热闹,这次更新最大的传播点是 DeepSeek V4 成了默认模型;但如果看公开更新信息,真正能决定 OpenClaw 是否继续往工作流平台走下去的,反而是那些不容易出圈的工程修补。报道提到,OpenClaw 这次修复了 DeepSeek 在多轮工具调用中的 thinking 和 replay 行为问题,尤其针对 reasoning_content 缺失导致的 provider replay 检查错误进行了补位处理。今天,OpenClaw能用DeepSeek-V4了!还设成了默认模型 OpenClaw接入DeepSeek-V4,设为新用户默认模型

这类细节看着很底层,但对 Agent 产品却是分水岭。因为一个模型会回答问题,不等于它能稳定撑住长链路任务。OpenClaw 的核心场景已经不是单轮聊天,而是连续调用浏览器、会议、语音、文件和插件。如果模型在任务第七步崩掉,再强的首轮回答也无法变成真实生产力。

所以,DeepSeek V4 被放到默认位,不是单独成立的动作,它背后还伴随着长链路稳定性的工程兜底。这件事的实际含义是:平台不是在给一个模型做流量扶持,而是在尝试把它真正变成工作流系统的“首选大脑”。

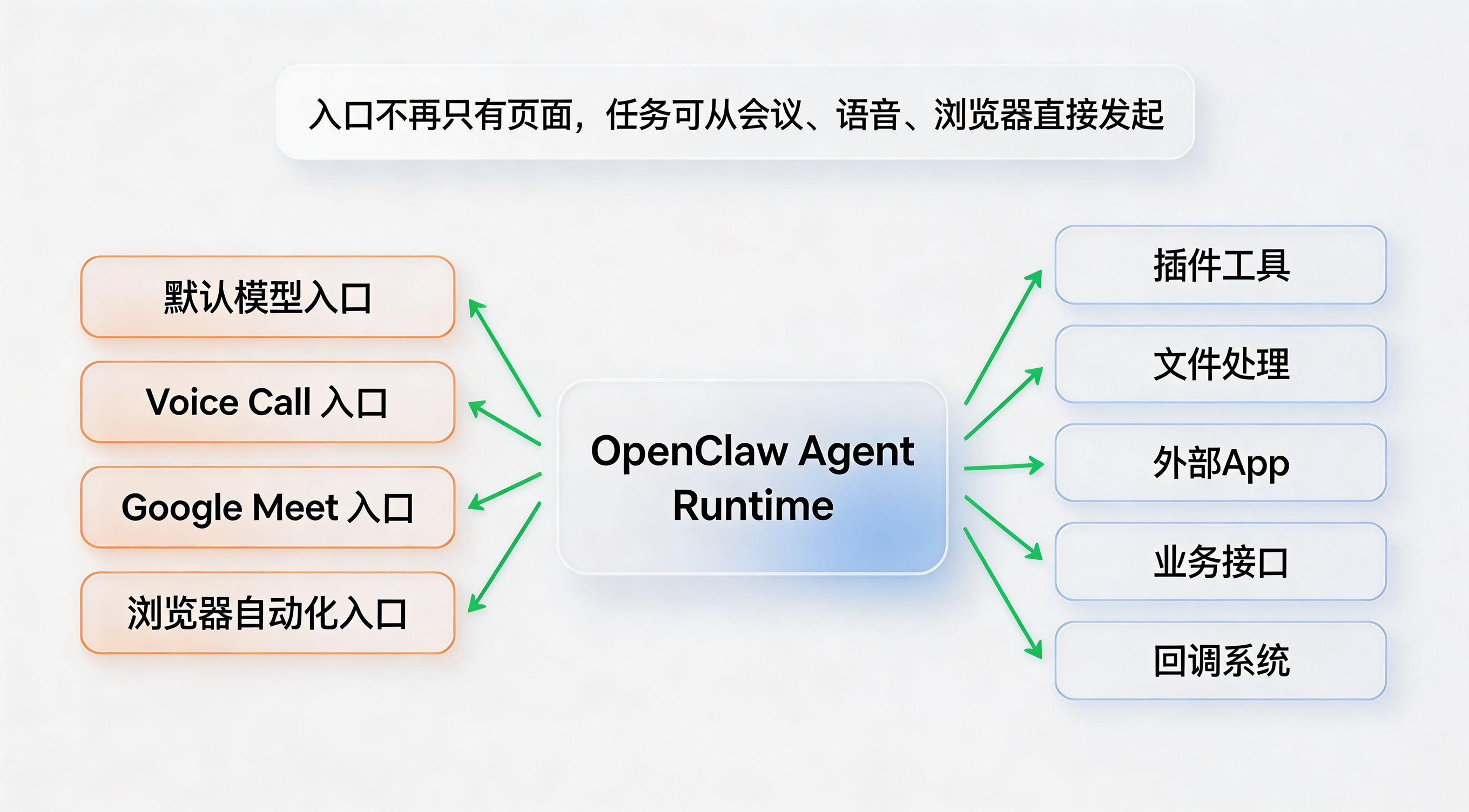

这轮更新最容易被低估的,是它并没有停在模型层。公开材料显示,Google Meet 被加入 OpenClaw,成为 bundled participant plugin,并支持个人 Google 账号授权、显式会议 URL 加入、Chrome 和 Twilio 实时传输,以及会后处理录音、转写、智能笔记、参会人会话和历史会议记录扫描等能力。今天起,DeepSeek V4成OpenClaw默认模型

这意味着,会议对 OpenClaw 来说不再只是“记录场景”,而是一个真实的任务节点。它能进入、参与、处理、沉淀并回查会议内容,也就是说,会议本身开始具备“被 Agent 调用”的属性。过去很多 AI 会议助手更像一个附属插件,现在 OpenClaw 是在把会议变成一级运行环境。

实时语音的推进同样关键。公开更新内容提到,Talk、Voice Call 和 Google Meet 都可以使用实时语音循环,电话或会议中的问题能通过 openclaw_agent_consult 交给后台 Agent 处理,再由 Agent 调用工具、组织答案并以语音形式返回。今天起,DeepSeek V4成OpenClaw默认模型 这说明 OpenClaw 正在把语音做成一级入口,而不再只是文本框的附属壳层。

浏览器自动化部分也在继续补短板,包括 viewport coordinate clicks、managed automation、existing-session automation、更长的 action budget、浏览器 profile 的 headless 独立设置,以及 Meet 标签页的复用与恢复能力。今天,OpenClaw能用DeepSeek-V4了!还设成了默认模型 这些改动本身不一定成为热点,但它们决定了平台是否能稳定执行任务。对一个正在从聊天产品走向工作流系统的 Agent 来说,模型、会议、语音和浏览器必须一起推进,分发生态才会真正发生重心偏移。

OpenClaw 这次更新还做了另一件重要但不性感的事:降低启动负担、整理插件边界。公开材料提到,模型列表改为静态目录,provider index、cache、onboarding 和 listing 可以在不加载 provider runtime 的情况下工作;插件侧更多信息从 manifest 暴露,descriptor-only setup contract 也更明确。OpenClaw接入DeepSeek-V4,设为新用户默认模型

与此同时,SDK 也发生了破坏性变化。OpenClaw 移除了旧的 api.registerEmbeddedExtensionFactory(…) 兼容路径,转向 api.registerAgentToolResultMiddleware(…),并增加插件兼容性 registry 和迁移记录,用于管理 SDK、配置和 runtime 的弃用路径。今天起,DeepSeek V4成OpenClaw默认模型 这说明平台在主动清理早期快速扩张留下的接口债。

为什么这件事重要?因为真正成熟的【分发生态】从来不只靠“模型火不火”,而靠平台能不能承载越来越多的插件、入口和工作流。只有底层结构足够轻,入口足够稳定,默认位才有实际价值。否则,平台把用户分过去了,系统却接不住,那默认位也只是表面流量。

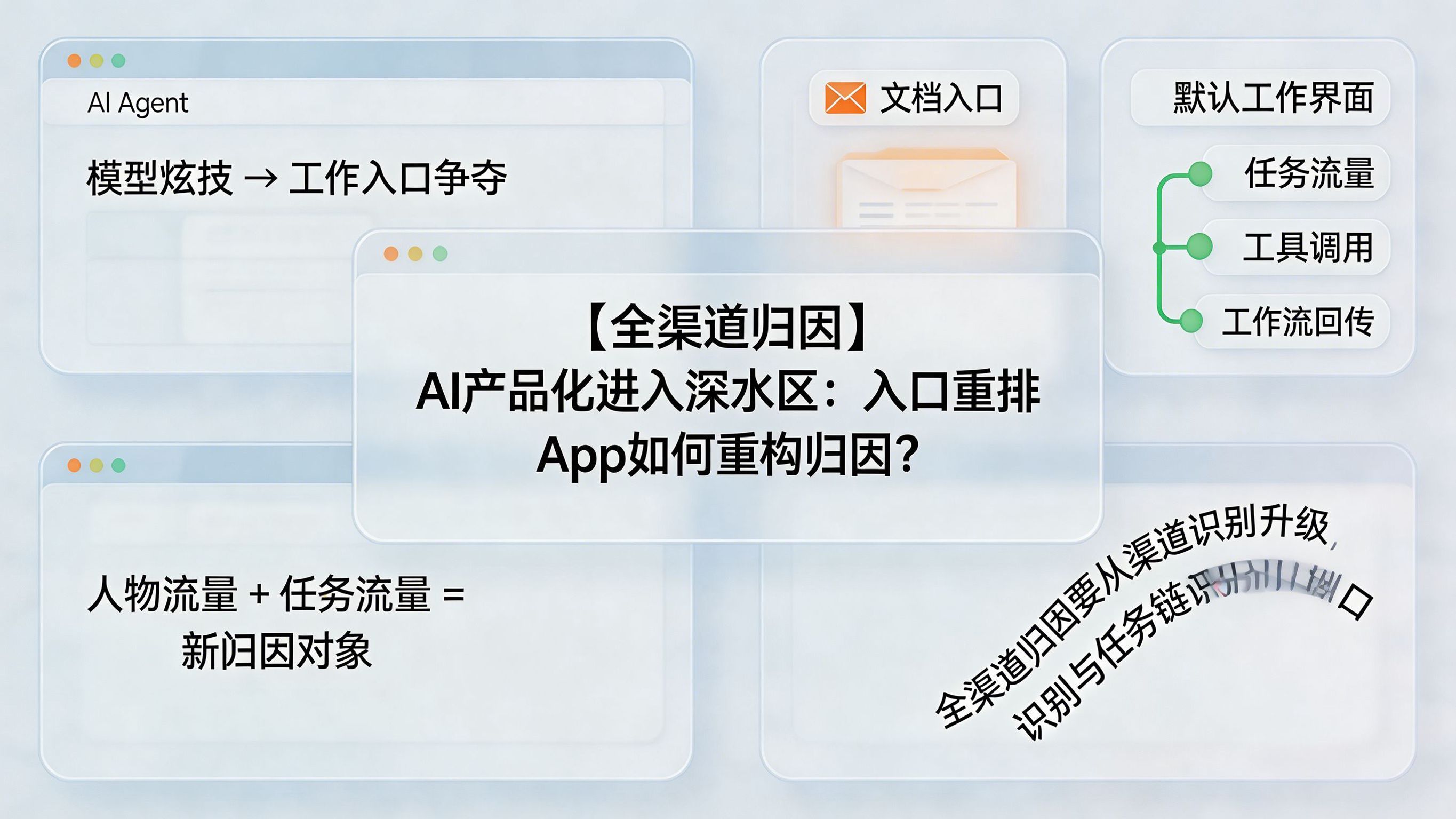

普通用户看这条新闻,最容易得出的结论是“OpenClaw 更强了,DeepSeek 上位了”。但对 App 团队来说,更棘手的问题其实是:以后很多流量,到底还是不是“人”带来的?

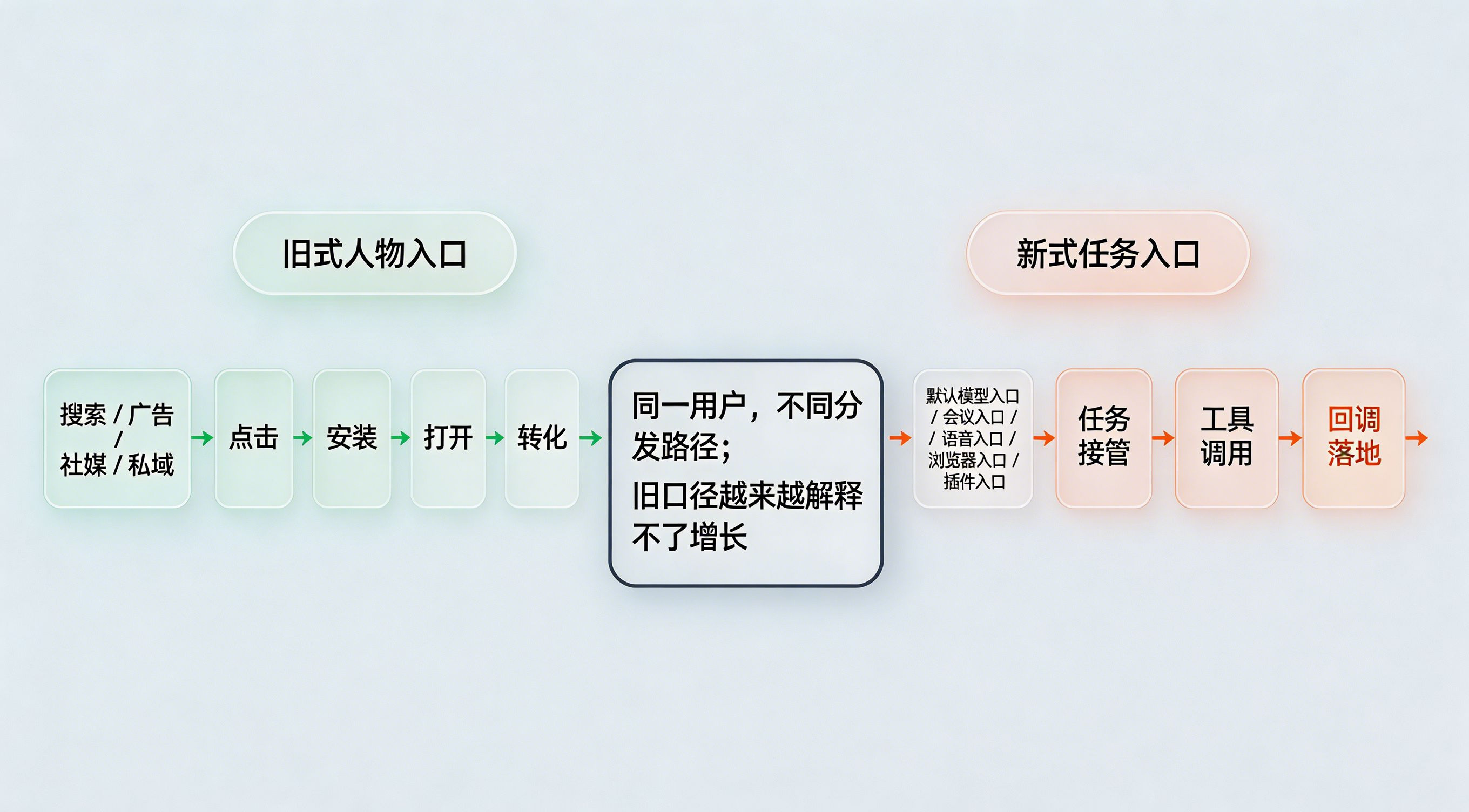

过去 App 的增长逻辑大多围绕显性入口展开。用户从搜索、广告、社媒、私域或者推荐位进来,点链接、安装、打开、转化,链路虽然长,但主体相对清晰。可到了 OpenClaw 这种 Agent 平台里,入口开始变得更隐蔽。用户可能不是自己点进 App,而是在会议里提出一个问题、在电话里触发一个需求、在浏览器任务里发起一个动作,随后由默认模型接管,再串起工具调用和结果回传。

也就是说,原本清晰的“人物入口”正在被拆成更多层次:默认模型入口、语音入口、会议入口、浏览器入口、插件入口。这些入口表面上都服务同一个用户,但在数据系统里,它们已经对应完全不同的分发路径。如果企业仍然只用“自然流量”“站内活跃”“渠道转化”这种粗粒度口径去看,就会越来越难解释到底是谁在制造增长。

这就是认知落差真正出现的地方。普通人看到的是模型能力升级,开发者面对的是入口解释权开始被平台默认项拿走。默认模型切换后,任务可能更容易完成,语音和会议入口可能更高频,浏览器自动化可能更稳定。报表会显示活跃变多、任务变多、转化变多,但团队未必知道,这到底是用户变多了,还是平台默认分发逻辑变了。

对 xinstall 视角来说,这条新闻最重要的地方不是“DeepSeek 很强”,而是 OpenClaw 这个 Agent 平台的默认位,正在重新组织任务流动方式。当平台开始替用户先决定第一条路径,后续的安装归因、入口识别和全渠道统计,就必须开始围绕“默认入口”而不是“显式点击”重新设计。

问题:很多团队在做归因时,只给广告位、活动页、私域二维码做渠道标记,却没有给默认模型入口、语音入口、会议入口这类新型任务入口建立独立编号。结果是,来自 OpenClaw 的不同任务被混在同一类“自然来源”里,后续根本分不清哪一层在放量。

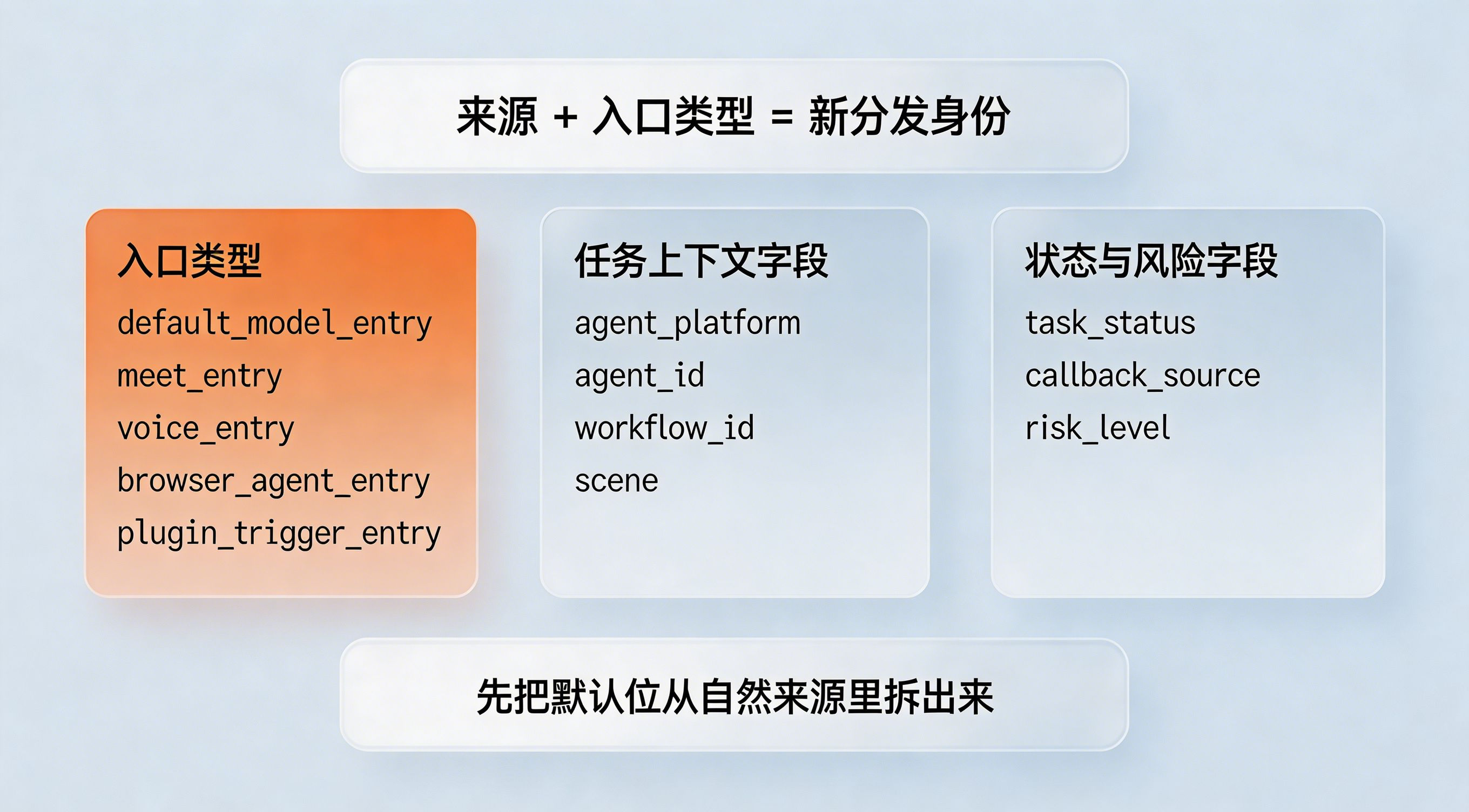

做法:可以借助 渠道编号 ChannelCode 的思路,把渠道从“投放来源”扩展为“来源 + 入口类型”的组合身份。例如,将 default_model_entry、meet_entry、voice_entry、browser_agent_entry、plugin_trigger_entry 等纳入统一编号体系,再补充 agent_platform、agent_id、workflow_id、scene、risk_level 等字段。这样,平台看到的不只是“OpenClaw 带来一次行为”,而是“OpenClaw 里的哪一类入口带来了哪一种任务”。

带来的好处:当某个入口突然放量时,团队能快速判断是默认模型切换带来的任务增长,还是会议与语音场景被激活;当某段链路异常时,也能更快知道问题出在平台分发、工具调用,还是用户实际操作。对今天的【分发生态】来说,第一步不是谈效果,而是先把入口身份定义出来。

问题:Agent 平台里最容易丢失的不是一次点击,而是任务语境。用户可能在 Google Meet 里问了一个问题,或者在 Voice Call 里发起一个请求,最后却由外部 App 或服务完成执行。到了落地系统里,通常只剩下一次调用,至于它是从哪来的、属于什么场景、前面发生过什么,常常已经不可见。

做法:这时,智能传参安装 的价值就不只是“记录安装来源”,而是保住任务上下文。更合适的方式,是把 source_channel、scene、workflow_id、agent_platform、task_type、meeting_id、voice_session_id 等关键参数一路带到安装、首启、拉起或回调阶段,让后续系统仍然知道这次行为原本属于哪条任务链。具体思路上,可以参考 xinstall 在《智能体分发时代 App 安装传参逻辑的底层重构》中的方法,把“安装携参”升级成“任务上下文携参”。

带来的好处:产品团队能按任务场景做差异化承接,增长团队能识别默认位带来的任务和用户主动行为的差异,数据团队则能把激活、留存和回访放回原始任务语境里理解。注:本文讨论的部分跨 Agent 平台上下文承接、复杂任务链路参数还原等方向,属于对未来分发趋势的前瞻性技术延展与思考,例如私域任务链识别、跨平台一键拉起、多入口任务承接等。此类高度定制化链路在不同业务中的成熟度不一,具体推进仍需结合实际系统架构评估。

问题:传统漏斗很擅长描述“曝光—点击—安装—注册—付费”,却不擅长解释“默认模型接管—会议触发—浏览器执行—插件返回—外部系统承接”这种路径。可在 OpenClaw 这种平台里,后者正在变得越来越常见。如果还沿用旧模型,团队看到的只会是结果,无法知道入口是怎么变化的。

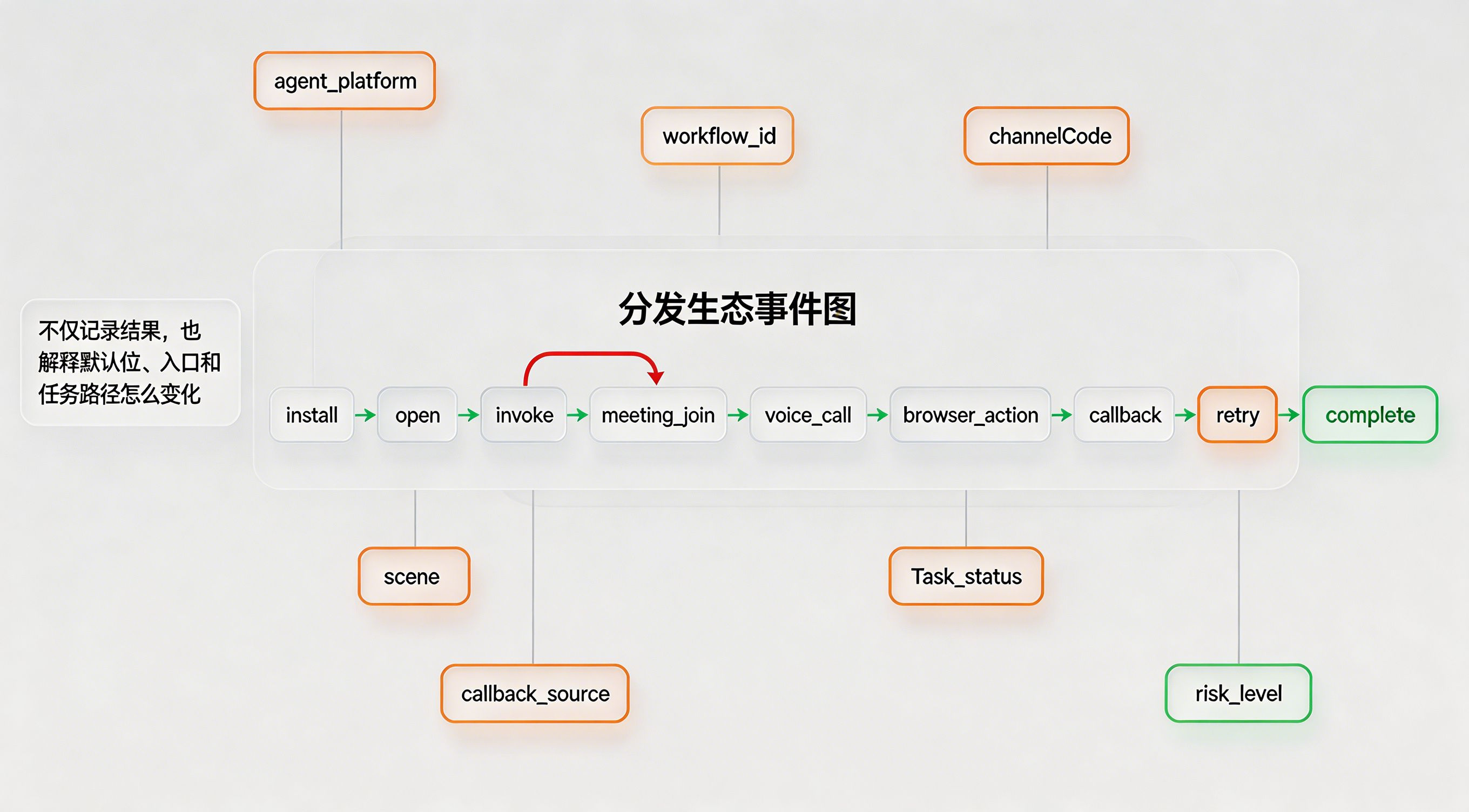

做法:需要在数据层建立统一事件图,把人物流量和任务流量放到一个框架中看。围绕 install、open、invoke、meeting_join、voice_call、browser_action、callback、retry、complete 等节点建模,并补充 agent_platform、workflow_id、channelCode、scene、task_status、callback_source、risk_level 等字段。对于多平台、多云、多 Agent 的复杂场景,也可以参考 xinstall 在《亚马逊 AI 战略升级?多云多 Agent 时代 App 该怎么认清流量真身》和《OpenClaw 引爆智能体分发:AI 个人助理重构 App 参数传参安装范式》中提到的思路:不要只看用户从哪里来,更要看任务从哪里来、经过哪里、最终落到哪里。

带来的好处:团队不只是知道“转化多了”,还能知道是哪个入口推动的;不只是知道“失败率高了”,还能知道失败发生在默认模型解释、会议接入、语音回路还是浏览器执行。归因系统也就从结果记录器,逐渐变成任务路径解释器。

如果你的业务未来会承接来自 OpenClaw、语音助手、会议 Agent 或浏览器自动化的任务,开发团队现在就应该预留足够的任务字段。因为默认模型一旦开始替用户做第一层分发,很多原来靠页面行为推断的逻辑就会失效。

建议优先预留这些字段:

这些字段未必一上来都能全部使用,但如果接口设计里完全没有这层意识,后续很多问题只能靠经验猜。

增长团队最容易误判的,是看到默认模型切换后任务量上涨,就直接把它解读成用户偏好增强。实际上,很多增长可能来自平台把默认位给了更适合 Agent 任务的模型,也可能来自语音与会议入口更顺了,或浏览器自动化更稳定了。这是分发逻辑变了,不一定是用户需求本身更强了。

因此,产品和增长团队至少要同步做三件事:

对多数团队来说,最危险的并不是 DeepSeek V4 太强,而是平台默认入口已经变了,自己的报表却还停留在旧世界。

从公开报道看,DeepSeek V4 Flash 相比 Pro 版本更轻、更快、更便宜,同时仍保留较强推理能力和 100 万 token 上下文支持,因此更适合作为新用户默认路径。今天起,DeepSeek V4成OpenClaw默认模型! 对一个强调任务执行与实时响应的 Agent 平台来说,默认位更看重综合体验,而不是绝对参数规模。

因为它同时把 Google Meet、实时语音、浏览器自动化、插件架构和 SDK 迁移一起推进了。换句话说,OpenClaw 更新的不是单个能力模块,而是从模型层、入口层到运行时层的一整套执行体系。今天,OpenClaw能用DeepSeek-V4了!还设成了默认模型 OpenClaw接入DeepSeek-V4,设为新用户默认模型

最大的变化是会议从“记录对象”变成“任务节点”。OpenClaw 不只是做会后转写和笔记,而是能把会议接入到完整 Agent 工作流里,让会议成为任务发起、参与、沉淀和回查的一部分。今天起,DeepSeek V4成OpenClaw默认模型

因为默认模型会天然接住大量首次任务和默认任务,而这些任务后续可能经由语音、会议、浏览器或插件继续扩展。原来只围绕显式点击设计的归因体系,很难解释这些任务链的真实入口,所以【分发生态】变化会直接传导到归因解释权。

从更大的行业趋势看,DeepSeek V4 成为 OpenClaw 默认模型,不只是一次模型接入新闻,更是 Agent 平台竞争逻辑变化的缩影。以前大家争的是模型榜单、参数规模和单点能力;现在更重要的是谁能拿到默认位、谁能把会议和语音做成一级入口、谁能把浏览器和插件系统稳定嵌进工作流。默认模型、语音入口和任务链正在一起重写智能体平台的权力分布。

对 App 和 B 端团队来说,现在正是重新定义入口和分发口径的窗口期。因为一旦 Agent 平台开始替用户完成第一层选择,旧式页面入口模型就会越来越解释不了真实增长。未来真正关键的,不只是模型强不强,而是谁能看清任务从哪里开始、在哪条路径被默认分发、最后落在哪个业务节点。对今天的开发者和操盘手而言,【分发生态】已经不再只是平台竞争的话题,而是决定入口解释权、流量解释权和增长判断力是否继续成立的核心变量。

上一篇

上一篇

AI产品化进入深水区:入口重排,App如何重构归因?

2026-04-27

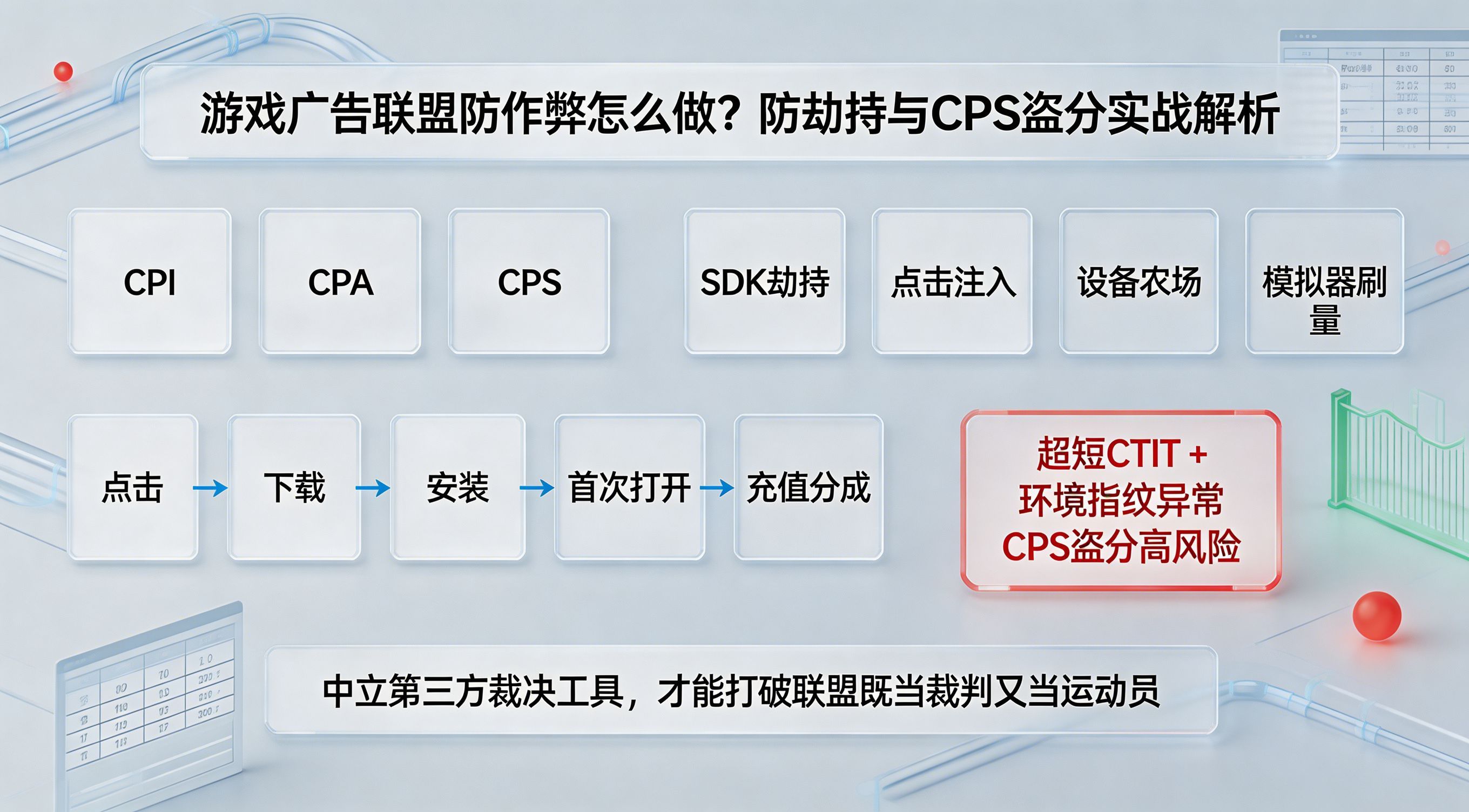

游戏广告联盟防作弊怎么做?防劫持与CPS盗分实战解析

2026-04-27

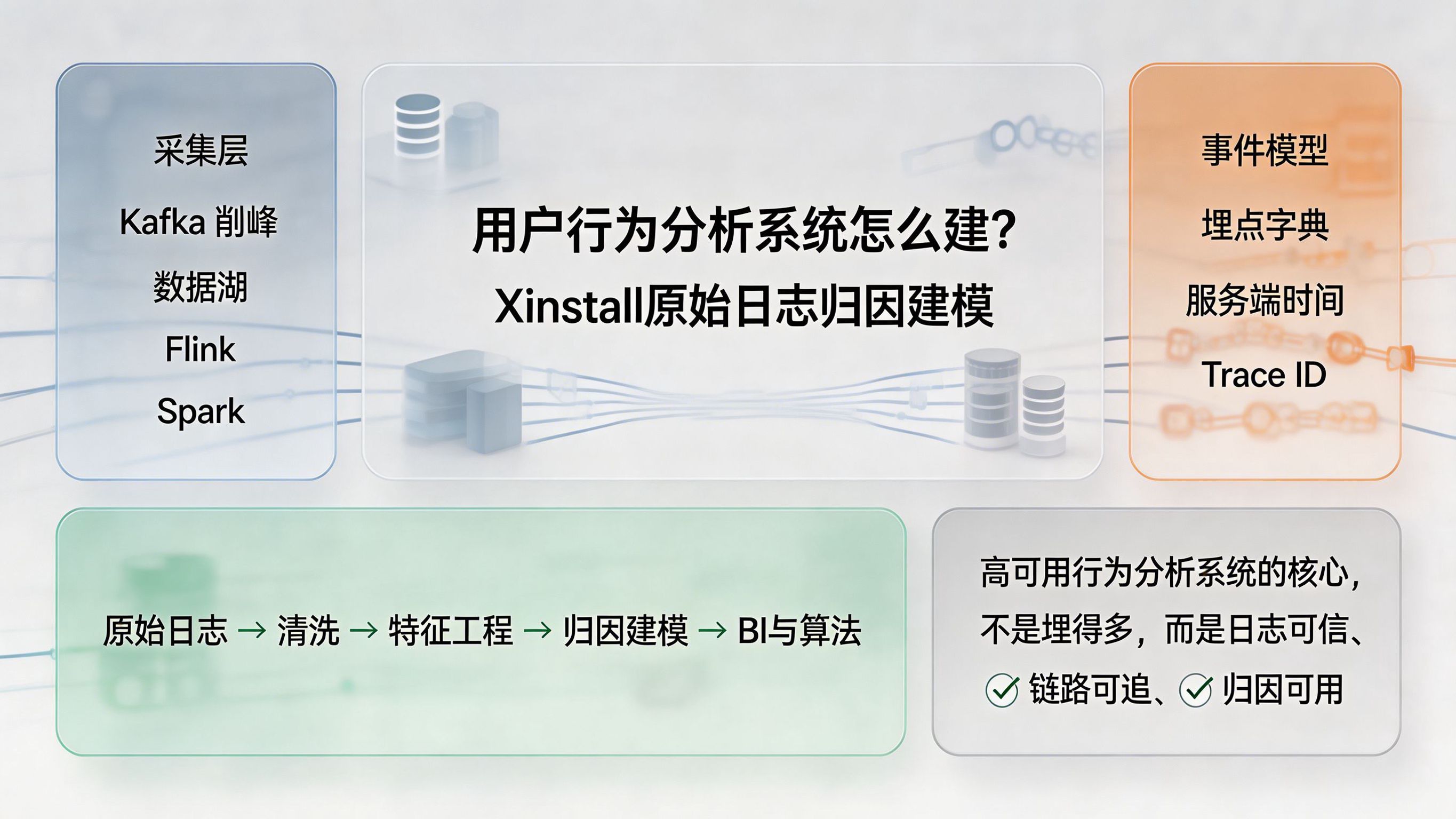

用户行为分析系统怎么建?Xinstall原始日志归因建模

2026-04-27

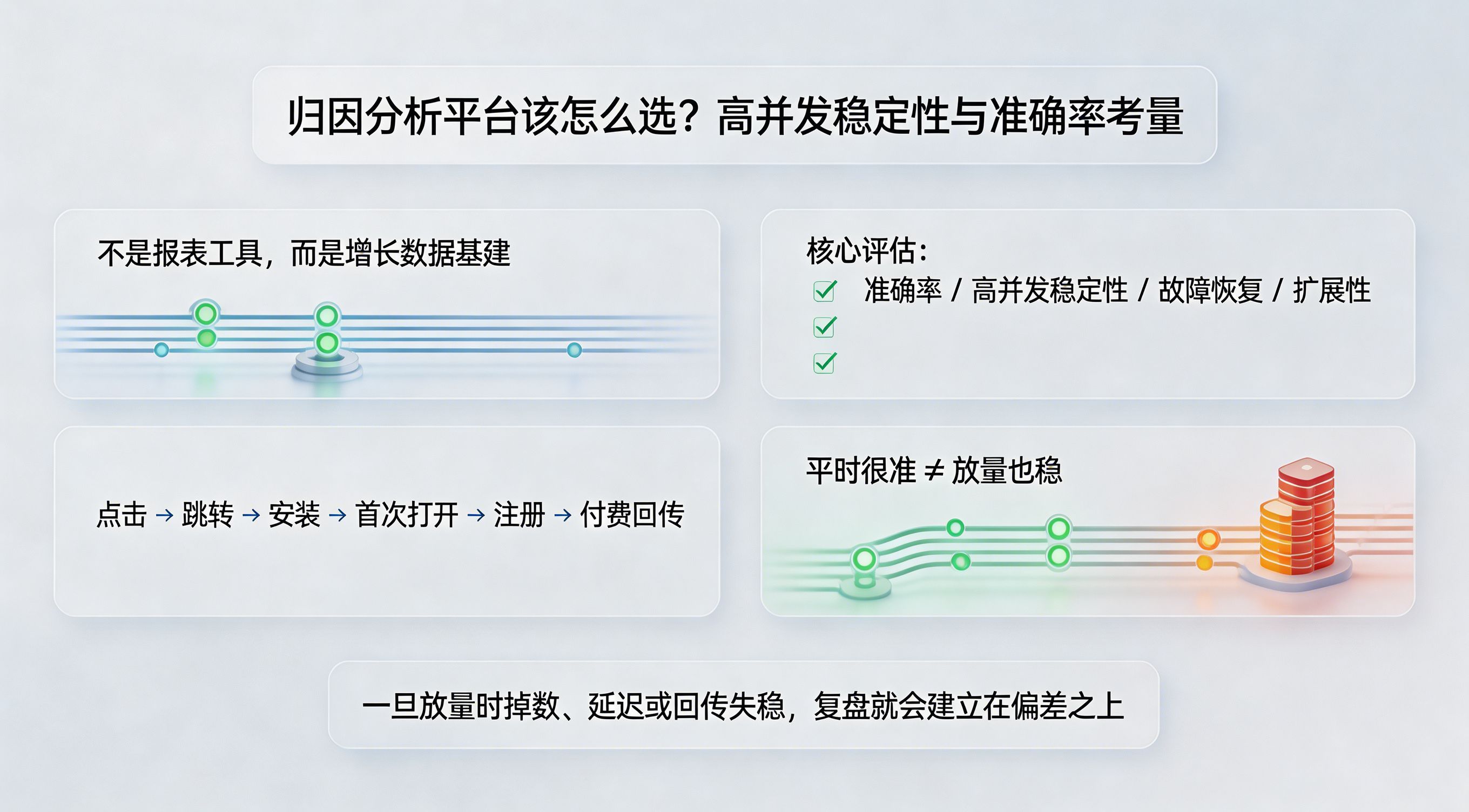

归因分析平台该怎么选?高并发稳定性与准确率考量

2026-04-27

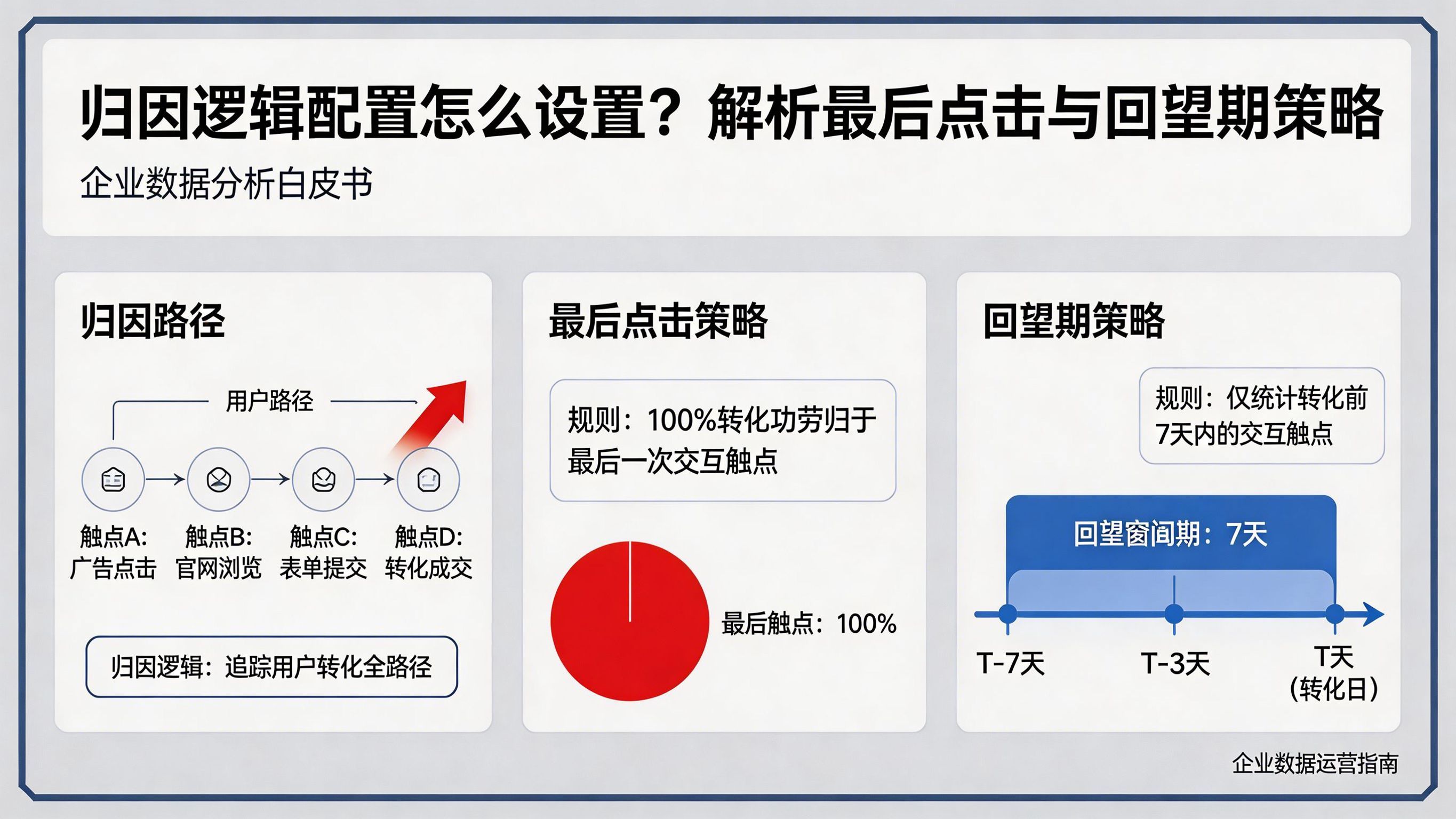

归因逻辑配置怎么设置?解析最后点击与回望期策略

2026-04-27

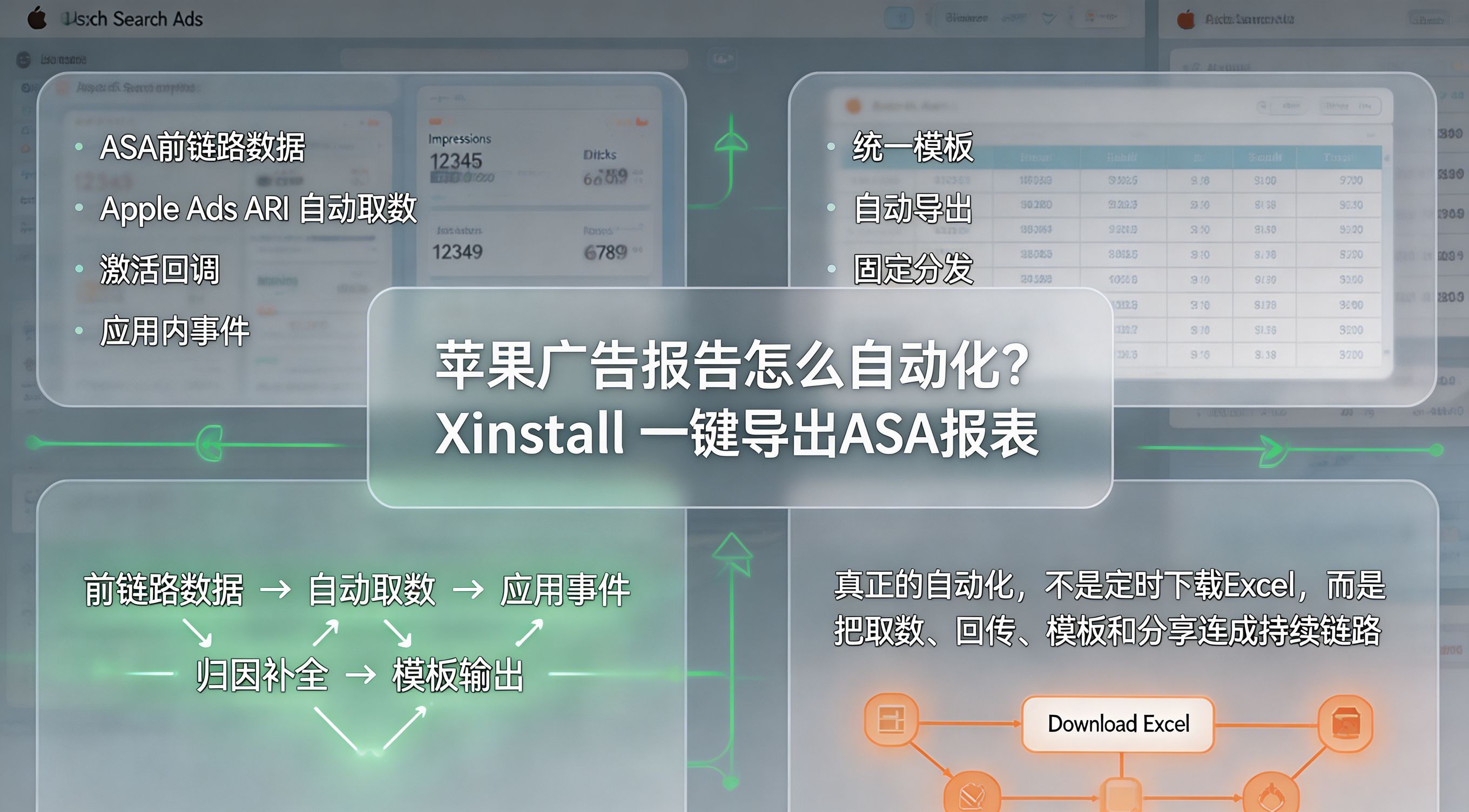

苹果广告报告怎么自动化?Xinstall 一键导出ASA报表

2026-04-27

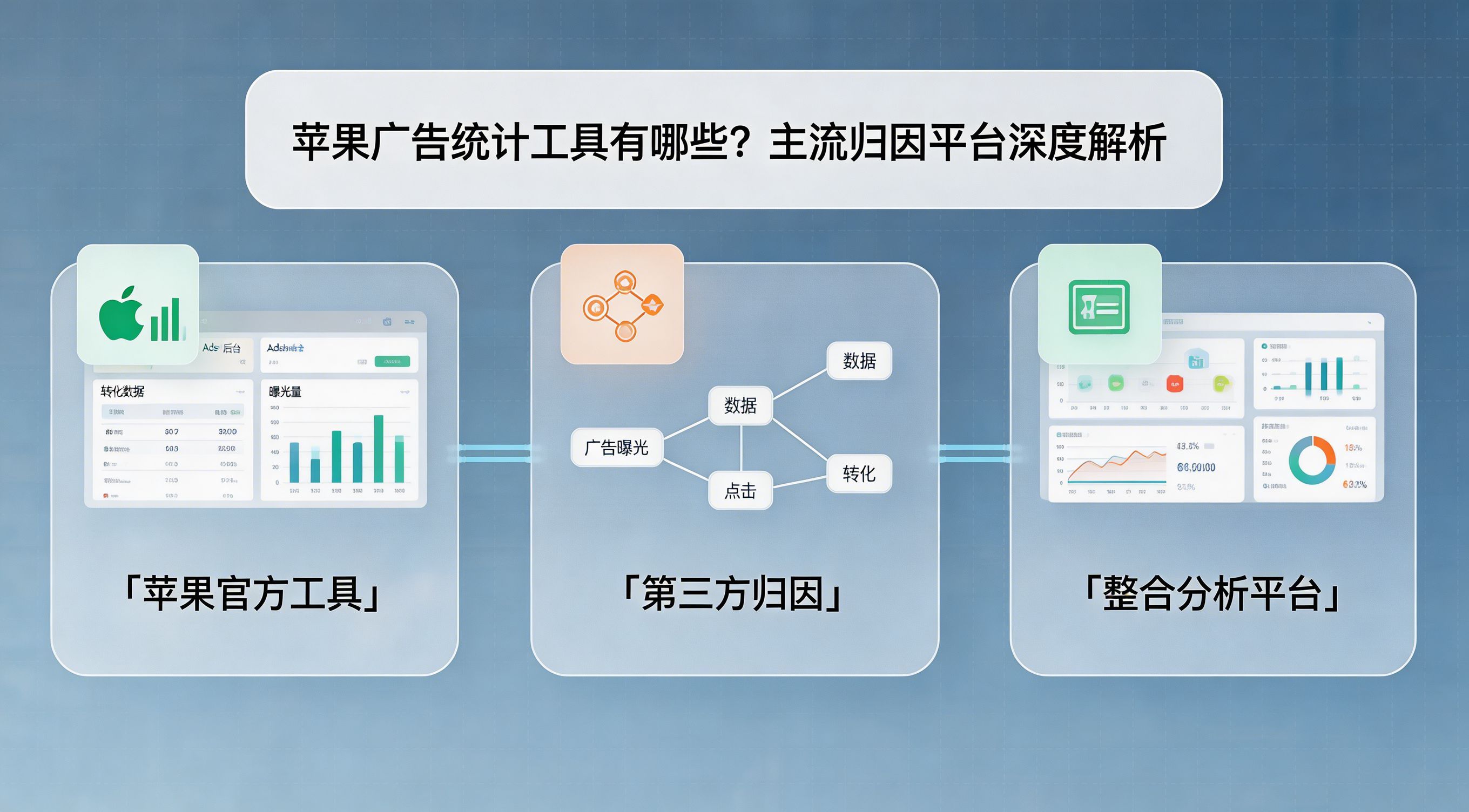

苹果广告统计工具有哪些?主流归因平台深度解析

2026-04-27

DeepSeek V4成OpenClaw默认模型:入口重排,App如何重构归因?

2026-04-27

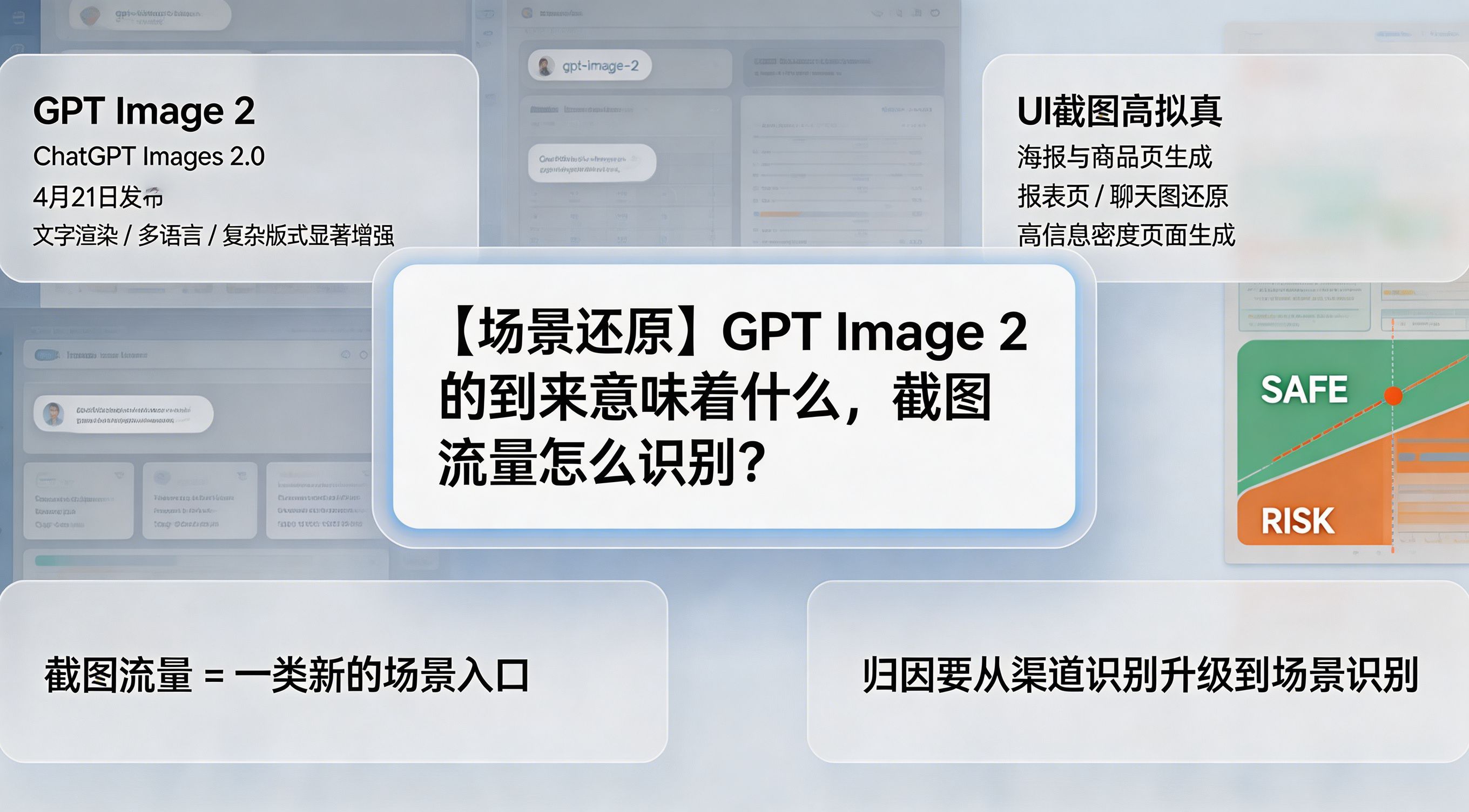

GPT Image 2 的到来意味着什么:素材造假,App如何重构归因?

2026-04-27

DeepSeek V4成OpenClaw默认模型:入口重排,App如何重构归因?

2026-04-27

如何统计iOS推广效果?多维归因解决苹果统计盲区

2026-04-24

WPS多维表格升级:AI协作高频化后,App怎么承接任务入口?

2026-04-24

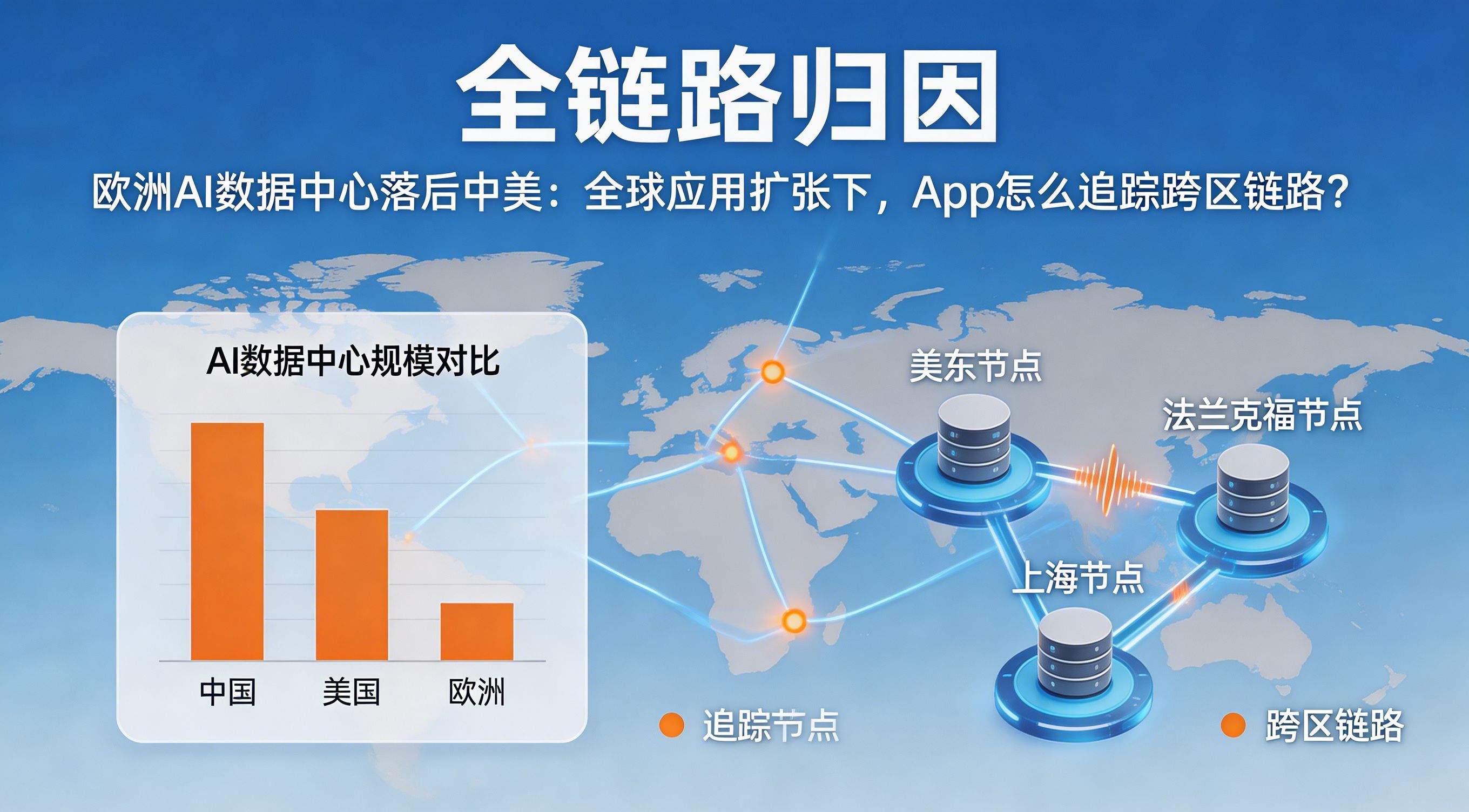

欧洲AI数据中心落后中美:全球应用扩张下,App怎么追踪跨区链路?

2026-04-24

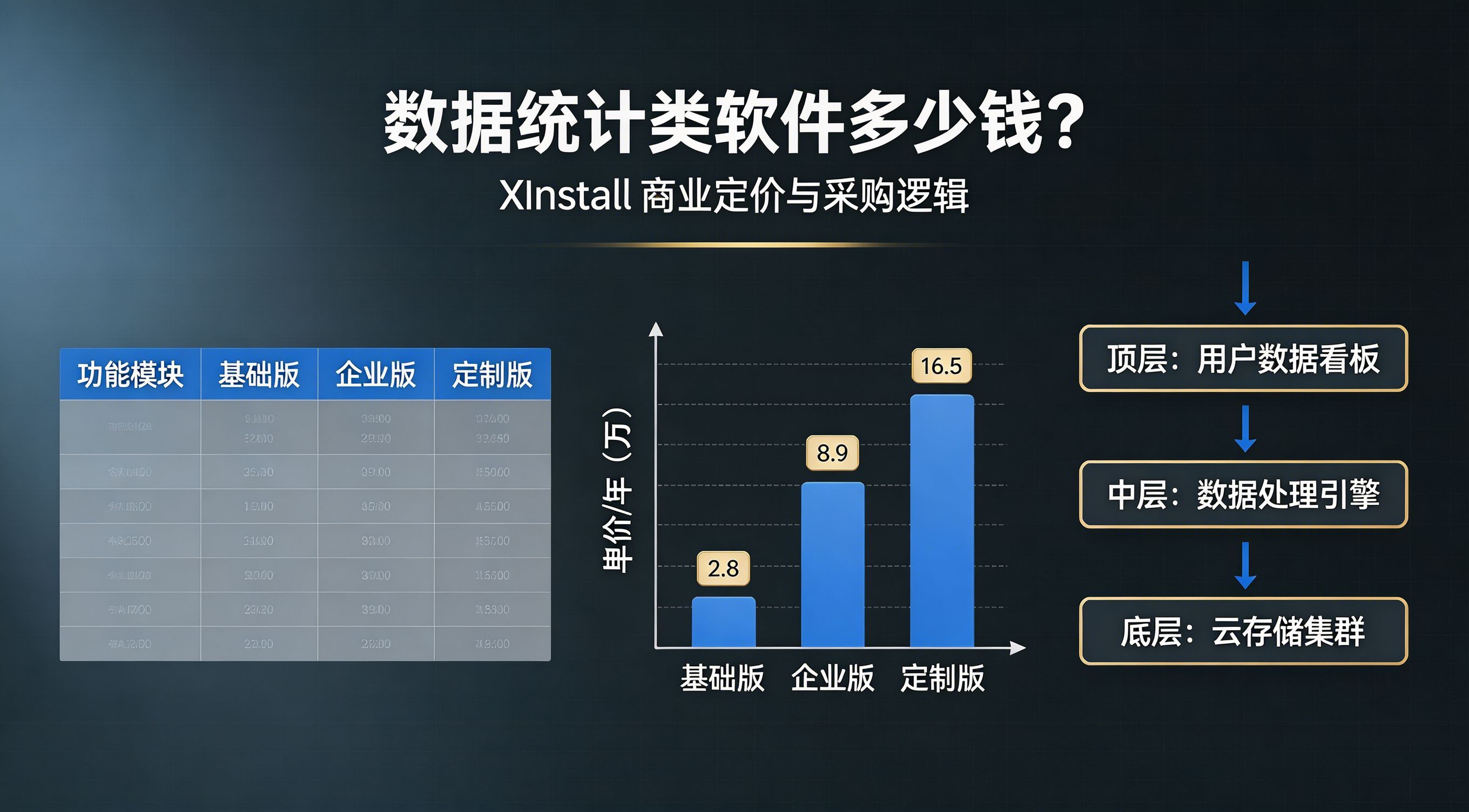

数据统计类软件多少钱?Xinstall商业定价与采购逻辑

2026-04-24

苹果广告追踪如何避坑?解析 ASA 归因常见数据陷阱

2026-04-24