手机微信扫一扫联系客服

3

3OpenClaw将DeepSeek V4 Flash设为默认模型后,会议、语音与浏览器任务链被同时前置,开发者和增长团队面临4.7倍级别的归因复杂度抬升。

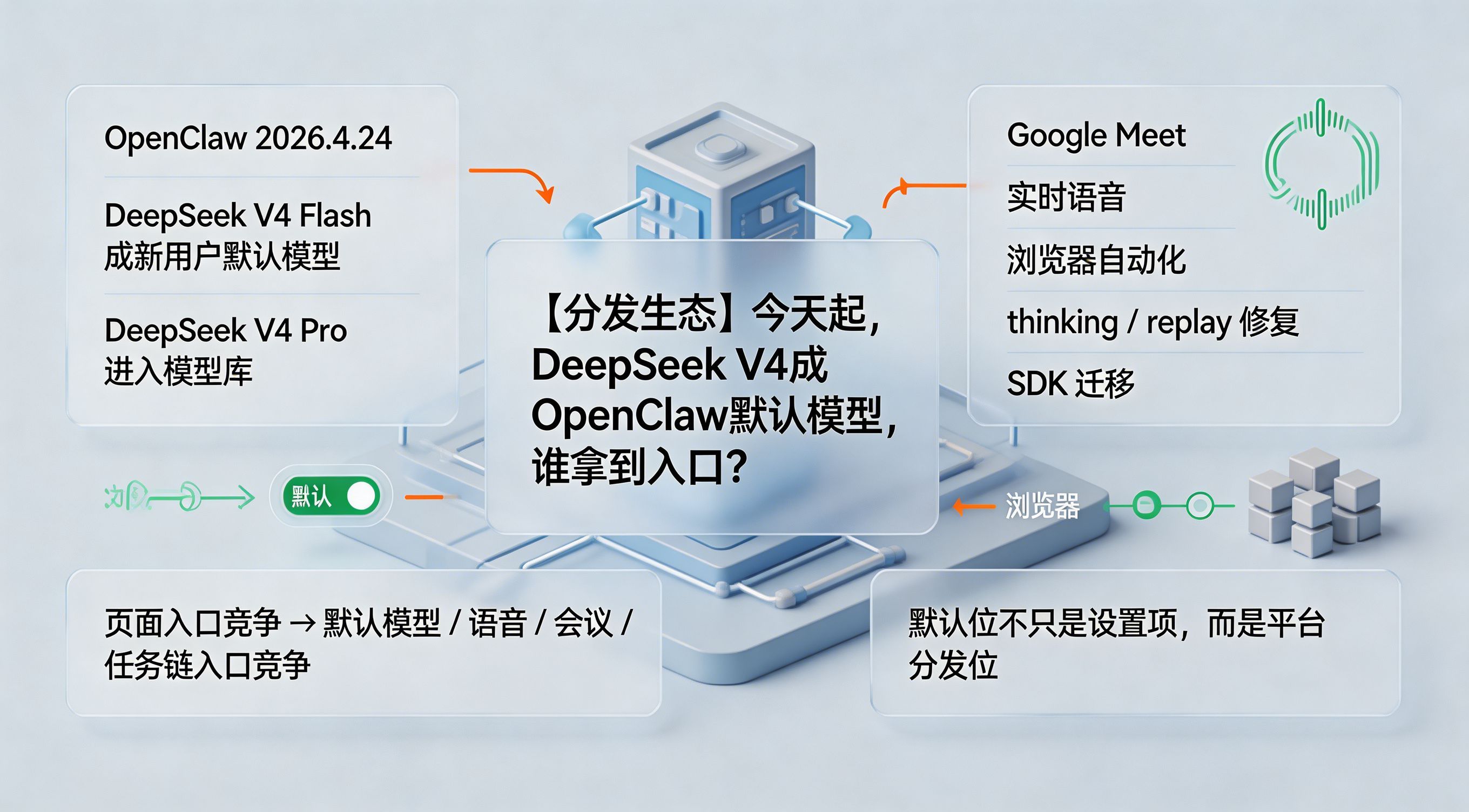

OpenClaw 把 DeepSeek V4 Flash 设成默认模型,这看起来像是一次模型层升级,真正会让 App 团队感到压力的,却是【任务流量】开始被默认入口重写。对开发、产品和增长团队来说,接下来最难解释的,可能不再是谁点进了 App,而是谁在默认模型接管后发起了任务、把任务送进了哪条链路、又在哪一步完成了转化。

OpenClaw 把 DeepSeek V4 Flash 设成默认模型,这看起来像是一次模型层升级,真正会让 App 团队感到压力的,却是【任务流量】开始被默认入口重写。对开发、产品和增长团队来说,接下来最难解释的,可能不再是谁点进了 App,而是谁在默认模型接管后发起了任务、把任务送进了哪条链路、又在哪一步完成了转化。

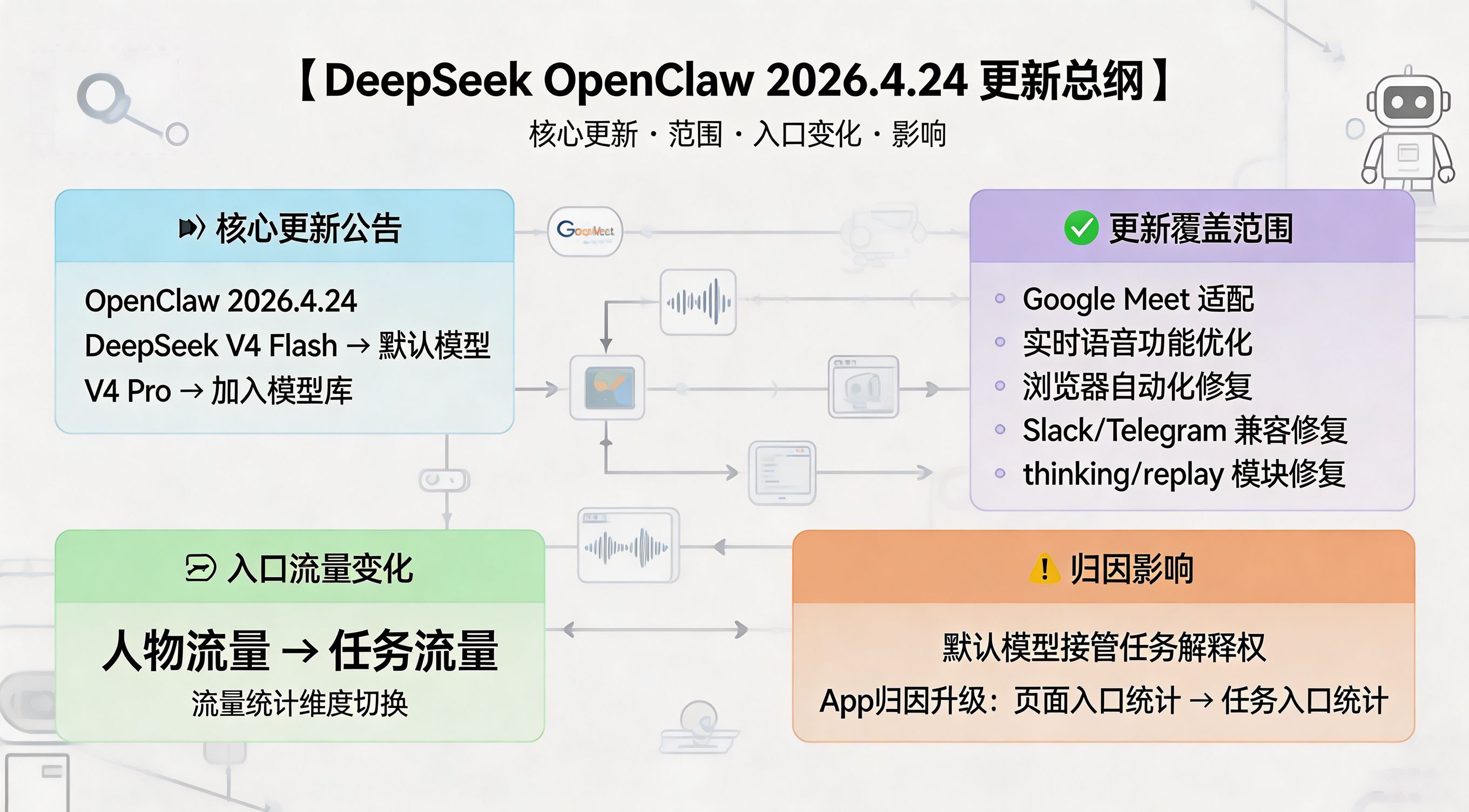

4 月 25 日起,多家媒体披露 OpenClaw 更新到 2026.4.24 版本,正式接入 DeepSeek V4 Flash 和 DeepSeek V4 Pro 两个版本,其中 DeepSeek V4 Flash 被设为新用户默认模型,V4 Pro 同步进入模型库。今天起,DeepSeek V4成OpenClaw默认模型! 席卷全球AI圈!DeepSeek-V4成OpenClaw默认模型 这意味着大量首次使用、默认对话与默认任务调用,都会优先走向 DeepSeek V4 Flash 的能力路径。

如果只看传播层,这似乎只是“DeepSeek V4 上了 OpenClaw”。但结合更新内容来看,这轮变化远不止模型切换。OpenClaw 同时推进了实时语音通话、浏览器自动化增强、Google Meet 接入、Slack 与 Telegram 修复,以及会话和 TTS 相关改动。席卷全球AI圈!DeepSeek-V4成OpenClaw默认模型 Releases · openclaw/openclaw 也就是说,模型、入口和运行时是一起变的,这更像一次工作流系统升级,而不是简单的底座换代。

从平台演进逻辑看,这种“默认位”变化格外值得重视。因为默认模型不是一个普通参数,它天然就是平台分发位。过去大家争的是首页入口、推荐位、预装位、搜索位;今天在 Agent 平台里,谁拿到默认模型,谁就拿到了最初那批高频任务的解释权和执行权。

公开报道显示,DeepSeek V4 Flash 与 V4 Pro 都采用 MoE 架构,并支持 100 万 token 上下文能力。今天起,DeepSeek V4成OpenClaw默认模型! 媒体转述中给出的参数是:DeepSeek V4 Pro 总参数约 1.6 万亿、激活参数 49B;DeepSeek V4 Flash 总参数约 284B、激活参数 13B。今天起,DeepSeek V4成OpenClaw默认模型! 从产品策略上看,Flash 被放到默认位并不意外,因为默认模型看重的不是能力上限本身,而是速度、成本、稳定性和多任务承接平衡。

一些技术解读还提到,DeepSeek V4 在长上下文场景中的效率改进非常明显,尤其在 KV Cache 与单 token 计算成本方面做了优化,这使它更适合被嵌进高频使用、持续调用的 Agent 场景中。Deepseek-V4 技术报告 这类优化对 OpenClaw 很关键,因为 OpenClaw 的核心场景早就不只是对话,而是多步骤调用工具、跨窗口处理上下文、持续执行任务。

换句话说,DeepSeek V4 Flash 被设成默认位,不只是因为它“更强”,而是因为它更适合做平台第一接触点。谁更适合做默认项,谁就更有机会塑造用户对整个平台的第一印象,也更有机会吃到后续的默认任务分发。

这次更新里,一个容易被忽略、但对 Agent 产品更重要的点,是 OpenClaw 修复了 DeepSeek 在连续工具调用中的 reasoning_content 缺失和 replay 检查相关问题。公开报道提到,新版本通过补齐相关占位逻辑,让 DeepSeek V4 Flash 和 V4 Pro 在多轮工具调用和长链路任务中更稳定。今天,OpenClaw能用DeepSeek-V4了!还设成了默认模型 刚刚,OpenClaw大更新:正式接入DeepSeek V4

这类修复之所以重要,是因为今天的 Agent 平台真正的体验瓶颈,往往不在第一轮回答,而在第六步、第七步以后还能不能继续跑下去。一个模型如果只能在文本框里表现出色,却在浏览器调用、会议接入、插件返回、上下文切换时频繁掉线,那它就很难真正成为生产级 Agent 的默认大脑。

所以这次 OpenClaw 升级真正释放的信号是:平台正在把“模型能力”转化成“任务承载能力”。一旦平台竞争开始围绕长链路稳定性展开,那么默认模型切换的影响就不再局限于回答质量,而会直接改写任务完成率、任务时长和任务回传效果。

OpenClaw 2026.4.24 版本中,Google Meet 被加入为内置参与插件,支持实时语音通话、会议接入和会后处理。席卷全球AI圈!DeepSeek-V4成OpenClaw默认模型 Releases · openclaw/openclaw 公开信息还提到,系统能够处理会议记录、录音、转写、智能笔记和历史 conference records,并支持导出为 Markdown 等格式。今天,OpenClaw能用DeepSeek-V4了!还设成了默认模型

这意味着会议不再只是被记录,而是成为一个可以被 Agent 接入、参与、处理和回查的工作节点。过去很多 AI 会议工具主要停留在“转写”和“总结”层;而 OpenClaw 这次的变化,是把会议放进了完整任务系统,让会议也成为任务发起环境。

与此同时,实时语音循环能力正在进入更完整的 Agent 调用链。公开信息显示,Talk、Voice Call 和 Google Meet 可调用完整 OpenClaw Agent,电话和会议里的问题可以被转交给后台 Agent 处理,再通过工具调用与语音反馈返回。OpenClaw 2026.4.24 summary: Voice got smarter 这说明文本框之外,电话和会议已经变成新的任务入口。

浏览器自动化部分也在补工程短板,包括坐标点击、existing-session automation、更长 action budget 以及浏览器恢复机制等。刚刚,OpenClaw大更新:正式接入DeepSeek V4 这些改动传播性不强,但它们会直接影响 Agent 是否能持续工作。对工作流系统来说,这些“难看但关键”的能力,往往比参数更决定真实可用性。

普通用户看这条新闻,最直观的感受往往是“OpenClaw 更强了”“DeepSeek 被推上了默认位”。但对 App 团队来说,更紧迫的问题其实是:以后到底是谁在发起任务?

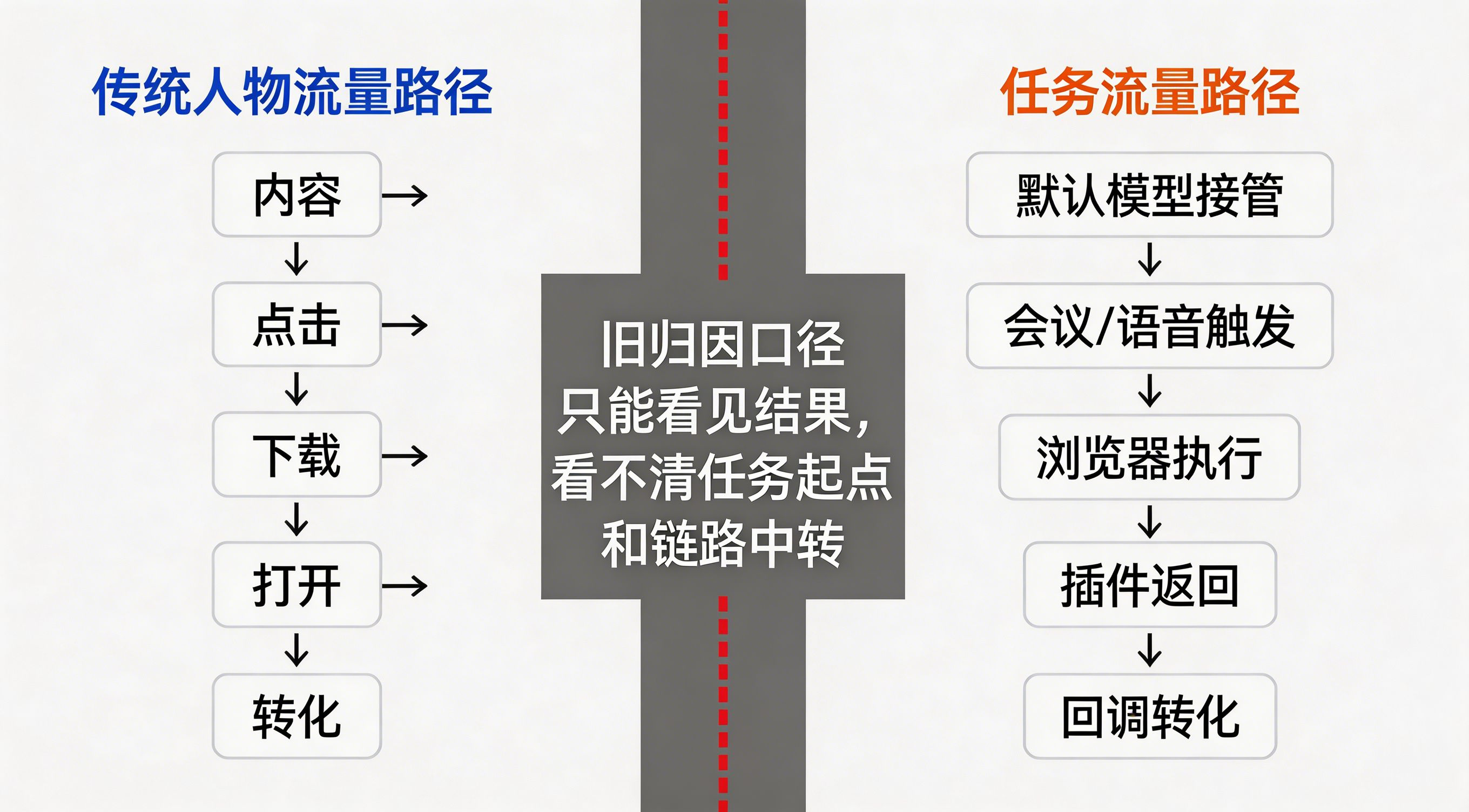

传统 App 归因默认人物流量占主导。用户看到内容、点击链接、下载安装、打开应用、完成转化,链路虽然复杂,但行为主体比较清晰,入口也相对显式。可到了 OpenClaw 这种平台,情况开始变化。任务可能先由默认模型理解,再经由语音、会议、浏览器自动化或插件系统执行,最后才把结果投递给某个 App、H5 页面或业务接口。

这时,前台看上去还是“用户在使用”,后台真正跑的却可能是一条完整的任务链。人物流量和【任务流量】开始混在一起,而旧的统计口径往往分不清这两者。一个看似普通的活跃提升,到底是用户更爱用了,还是默认模型切换后任务执行链更通畅了?一个转化率变高,到底是产品更顺了,还是语音和会议入口把用户意图预先筛选过了?

问题还在于,OpenClaw 这类平台不是只改一个点,而是模型默认位、Google Meet、Voice Call、浏览器自动化一起变。也就是说,一个后台“转化”可能同时涉及多个潜在入口:默认模型入口、会议入口、语音入口、浏览器任务入口。平台报表如果只记录结果,不记录任务起点和链路中转,团队最后就只能看见热闹,看不清门道。

所以这条新闻真正让 App 团队紧张的,不是模型强弱,而是解释权变化。普通人在看模型排名,开发者要面对的是:默认模型开始接管任务解释,页面不再是唯一入口,链路也不再由用户手动一步步完成。归因体系如果不变,就会慢慢失去解释现实的能力。

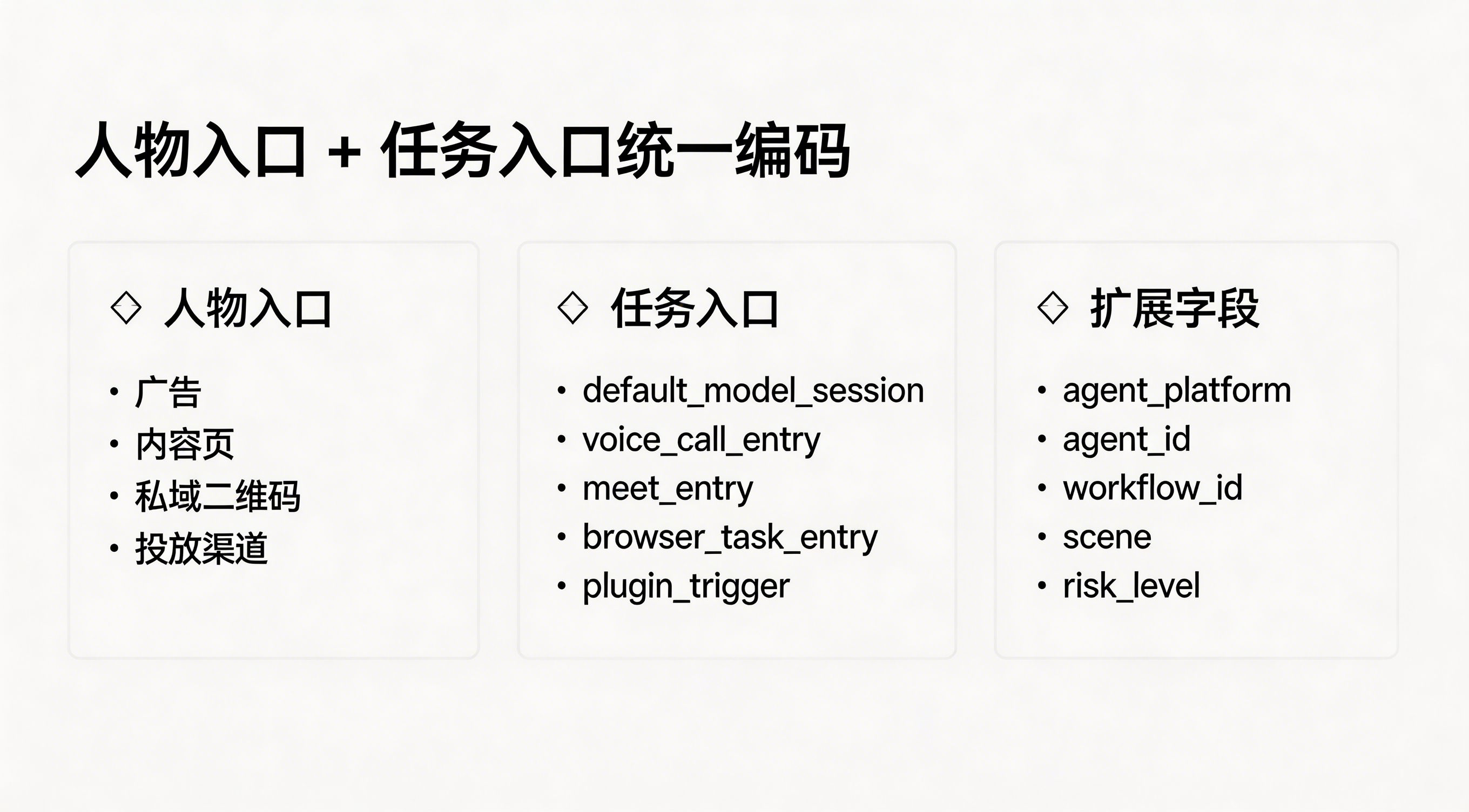

问题:很多团队至今还只给广告、内容页、私域二维码和投放渠道做编号,却没有为默认模型入口、语音入口、会议入口和浏览器自动化入口建立统一标识。结果所有来自 Agent 平台的行为,最后都可能被笼统记进“自然流量”或“App 内流量”。

做法:可以借助 渠道编号 ChannelCode 的思路,把入口重新定义为“人物入口 + 任务入口”的统一体系。比如,把 default_model_session、voice_call_entry、meet_entry、browser_task_entry、plugin_trigger 这类入口都纳入统一编码,再结合 agent_platform、agent_id、workflow_id、scene、risk_level 等字段做补充。这样,团队统计的就不再只是“OpenClaw 来源”,而是能细分到“OpenClaw 里到底是哪条任务路径带来的结果”。

带来的好处:当业务波动时,团队可以快速判断是某个默认位变化引发了任务量提升,还是某个语音/会议场景开始放量。对今天的 Agent 平台来说,【任务流量】第一步不是分析结果,而是先把入口编码清楚。

问题:Agent 最容易丢的不是点击,而是语境。用户可能在电话里提出需求,在会议里触发一个流程,或由默认模型自动接管某个任务,然后再跳转到某个 App 里继续处理。可一旦任务穿过多个系统,最先丢掉的往往就是“为什么触发、从哪里触发、属于哪类场景”这些最有价值的信息。

做法:这时,智能传参安装 的核心价值就体现出来了。更合理的方式,是把 source_channel、scene、task_type、workflow_id、agent_platform、meeting_id 等关键参数,通过受控方式保留下来,让安装、首启、拉起或后续回调阶段仍然知道任务原点在哪里。实现思路上,可以参考 xinstall 在《智能体分发时代 App 安装传参逻辑的底层重构》里提出的方法,把“链接携参—安装—首启—参数还原”重新放回智能体场景中理解。

带来的好处:产品能按任务场景设计承接页,增长能识别哪些结果来自会议链路、哪些来自语音任务,数据团队也能把安装、激活和转化重新放回任务语境中分析。注:本文讨论的部分跨 Agent 场景上下文保留、复杂任务链的参数还原等方向,属于对未来分发趋势的前瞻性技术延展与思考,例如多入口任务归因、跨平台一键拉起、私域场景参数保真等。当前此类高度定制化链路未必都属于统一标准化能力,具体推进仍需结合业务架构评估。

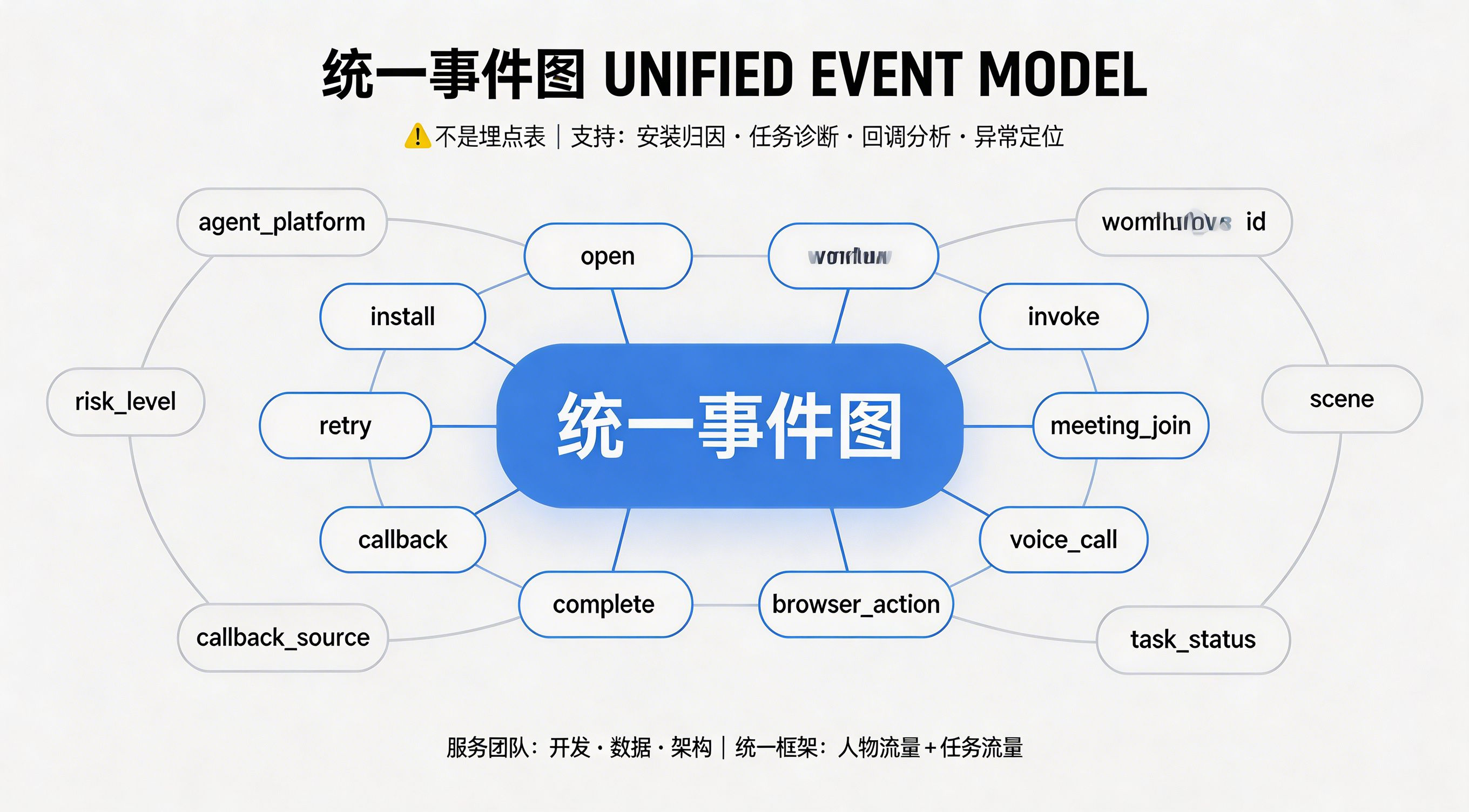

问题:传统埋点模型更擅长描述“曝光—点击—安装—打开—转化”这类人物路径,却很难解释“默认模型接管—会议触发—浏览器执行—插件返回—回调入库”这种任务链。结果就是,后台看见了一堆成功和失败,却看不出它们到底卡在了哪一层。

做法:更合适的方式,是在数据仓或归因层建立一张统一事件图,把人物流量和【任务流量】都放进去。围绕 install、open、invoke、meeting_join、voice_call、browser_action、callback、retry、complete 等事件建模,并补充 agent_platform、workflow_id、channelCode、scene、task_status、callback_source、risk_level 等字段。对于多 Agent、多系统场景,也可以参考 xinstall 在《亚马逊 AI 战略升级?多云多 Agent 时代 App 该怎么认清流量真身》和《OpenClaw 引爆智能体分发:AI 个人助理重构 App 参数传参安装范式》中的方法,重点不是只看“人从哪里来”,而是看“任务从哪里来、经过哪里、最后落到哪里”。

带来的好处:团队不只是知道转化变多了,还知道是人物流量增长了,还是默认模型切换后任务执行效率变高了;不只是知道失败率提升了,还能定位失败是出在会议接入、语音回路还是浏览器自动化。归因系统也会因此从“结果统计器”升级成“任务诊断器”。

如果你的业务未来会承接来自 OpenClaw、语音助手、会议 Agent 或浏览器自动化的流量,开发团队现在就要把任务字段预埋进去。因为一旦任务流真正放量,再靠日志回捞和人工拼接补链路,成本会极高,而且通常补不全。

建议优先预留这些字段:

这些字段不一定一开始全部用满,但如果架构上完全没预留,后面很多问题只能靠猜。

增长团队最容易误判的,就是把所有活跃增长都当成产品吸引力变强了。但在 OpenClaw 这种环境里,一部分增长可能来自默认模型切换,一部分来自会议和语音入口前置,一部分来自浏览器自动化更稳定。它们提升的是任务完成率,不一定是人物流量同步上涨。

因此,产品和增长团队至少要同步做三件事:

对于大部分团队来说,现在最危险的不是模型太快,而是流量结构已经变了,自己却还在用旧的解释框架。

从公开报道看,DeepSeek V4 Flash 兼顾速度、成本和较强推理能力,更适合作为默认路径承接大规模首次交互和常规任务。今天起,DeepSeek V4成OpenClaw默认模型! 对 OpenClaw 这类强调实时交互和多工具调用的平台来说,默认位看重的是综合体验,而不只是单次能力上限。

因为这轮更新同时覆盖了实时语音、Google Meet 接入、浏览器自动化增强、Slack/Telegram 修复和插件运行时调整。公开更新信息已经表明,这是一轮从模型层一直延伸到运行时层的系统升级。席卷全球AI圈!DeepSeek-V4成OpenClaw默认模型 Releases · openclaw/openclaw

最关键的变化是会议从“记录场景”升级成“任务节点”。系统不仅能参与会议、做转写和笔记,还能把会议接入完整 Agent 链路,让会议成为任务发起、处理和结果沉淀的一部分。今天,OpenClaw能用DeepSeek-V4了!还设成了默认模型

因为默认模型会天然接住大量首次任务和默认任务,而这些任务可能进一步经由会议、语音、浏览器和插件发起。原来只围绕页面点击建立的归因模型,很难解释这些任务链的真实来源,所以人物流量和【任务流量】必须被拆开看。

从行业视角看,DeepSeek V4 成为 OpenClaw 默认模型,真正的意义不只是中国开源模型拿到了一个平台入口位,而是 Agent 平台的“默认项”开始像过去的首页推荐位、系统预装位一样重要。谁拿到默认模型,谁就更可能先接住用户的第一批问题、第一批任务和第一批高价值调用;谁能继续把语音、会议和浏览器前置,谁就更有机会把智能体从聊天工具推进成工作流底座。

对 App 和 B 端团队来说,这也是一个非常现实的窗口期。因为一旦默认模型、会议入口和语音入口开始共同塑造行为路径,旧式埋点与旧式渠道报表就会越来越难解释真实增长。未来真正有价值的,不只是判断某个模型强不强,而是能否把人物流量、任务链路和跨系统回传重新拼成一张可解释的业务地图。对今天的开发者和操盘手而言,【任务流量】已经不是一个概念词,而是决定入口解释权、归因解释权和增长判断力能否继续成立的基础变量。

上一篇

上一篇

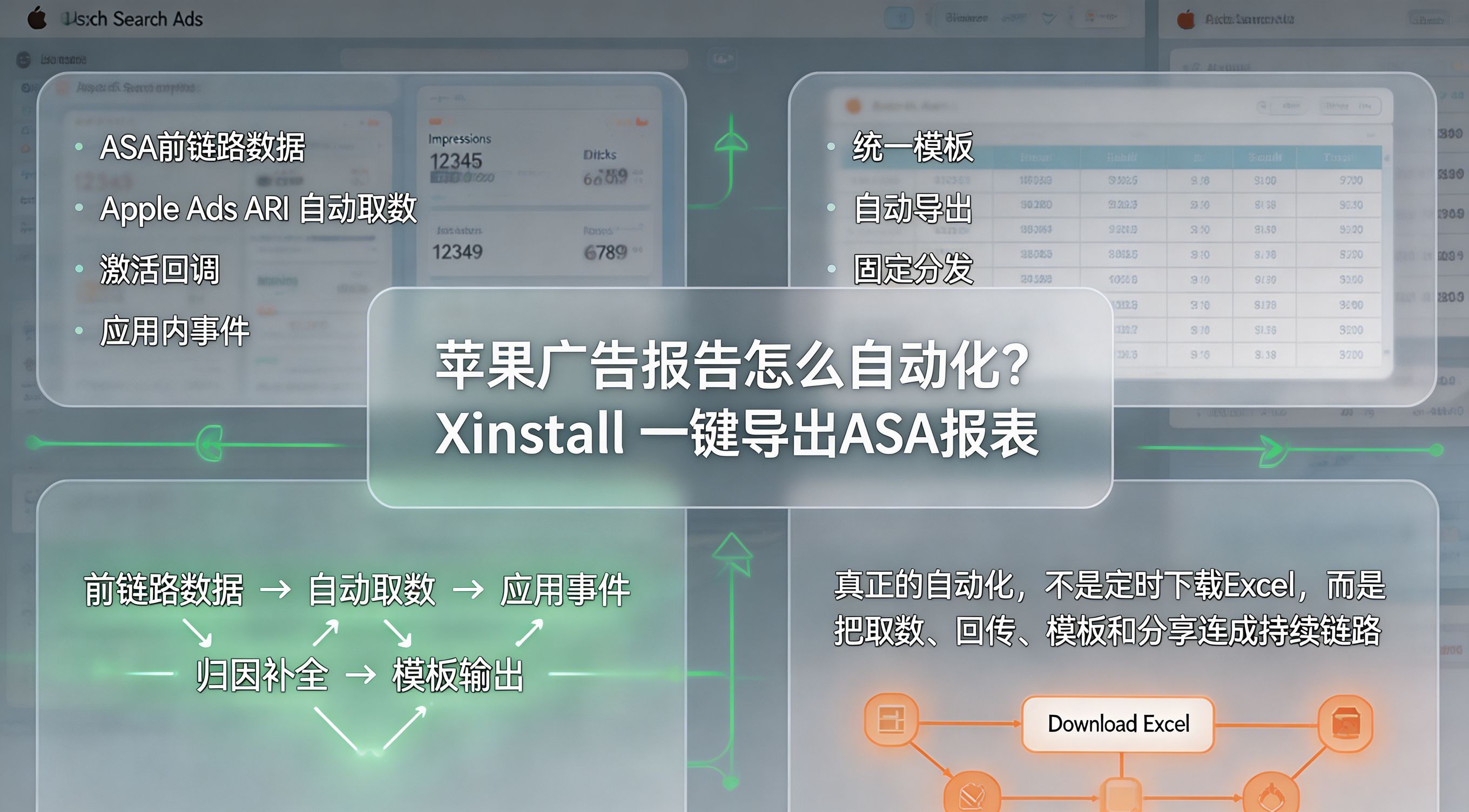

苹果广告报告怎么自动化?Xinstall 一键导出ASA报表

2026-04-27

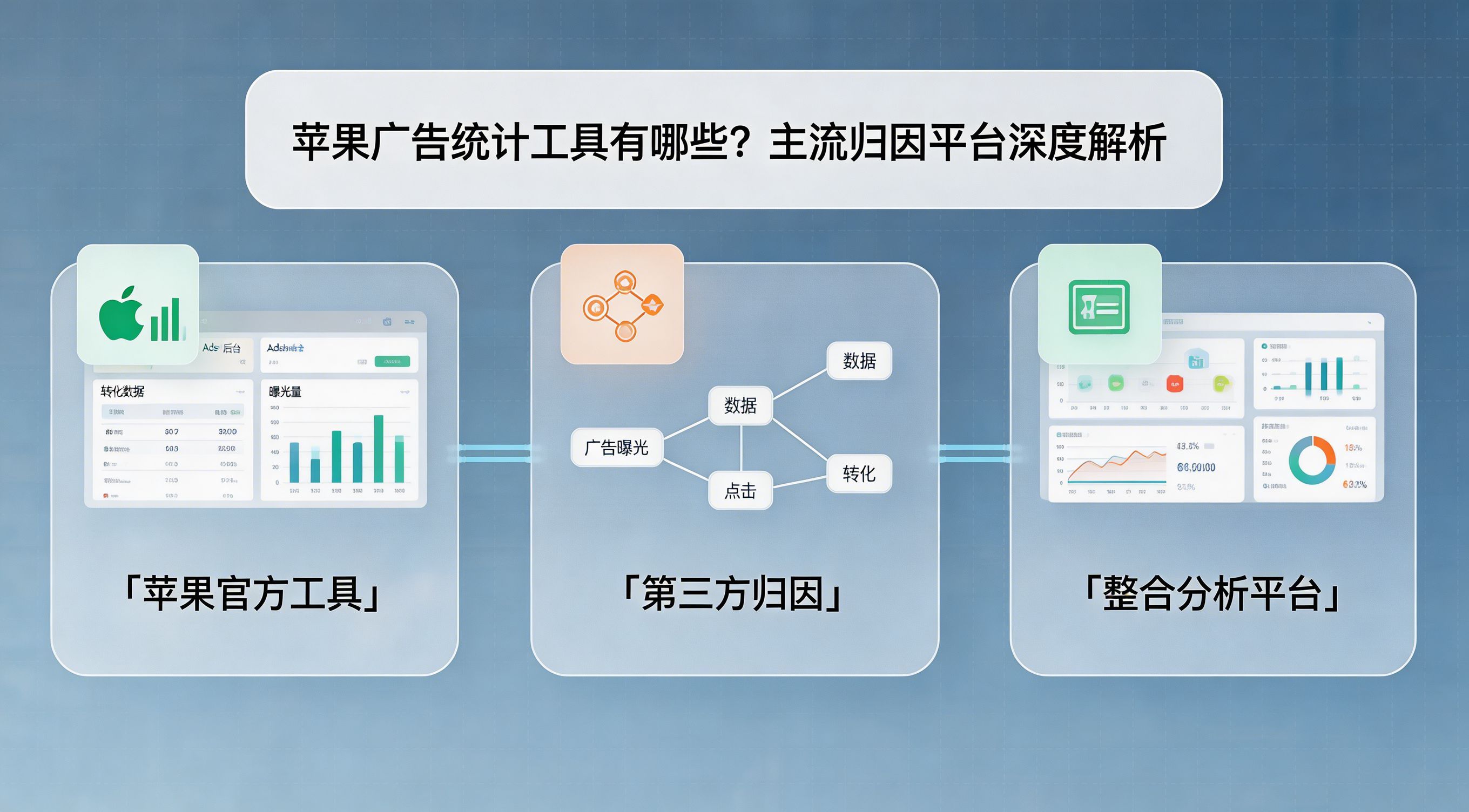

苹果广告统计工具有哪些?主流归因平台深度解析

2026-04-27

DeepSeek V4成OpenClaw默认模型:入口重排,App如何重构归因?

2026-04-27

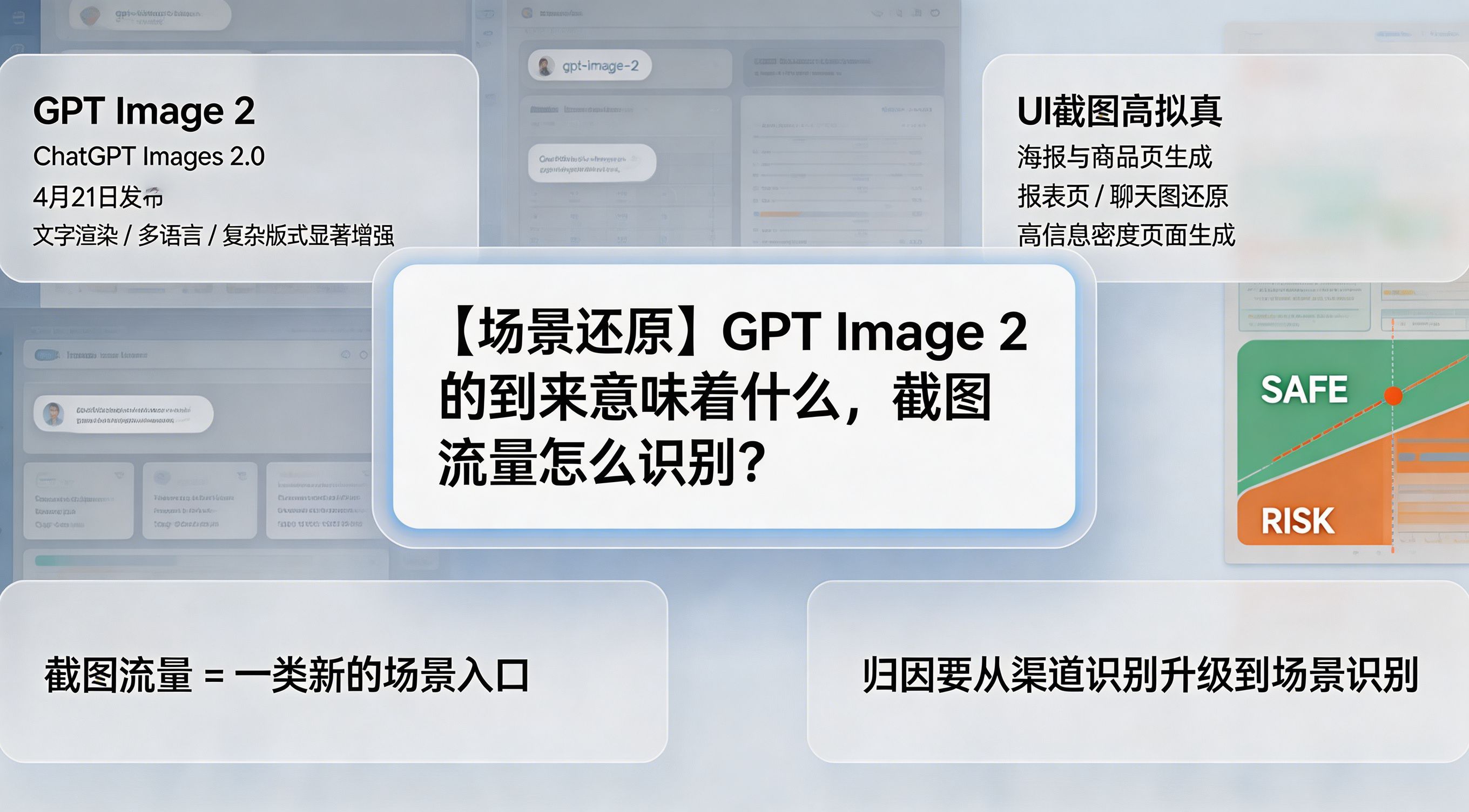

GPT Image 2 的到来意味着什么,截图流量怎么识别?

2026-04-27

DeepSeek V4成OpenClaw默认模型,入口归因怎么变?

2026-04-27

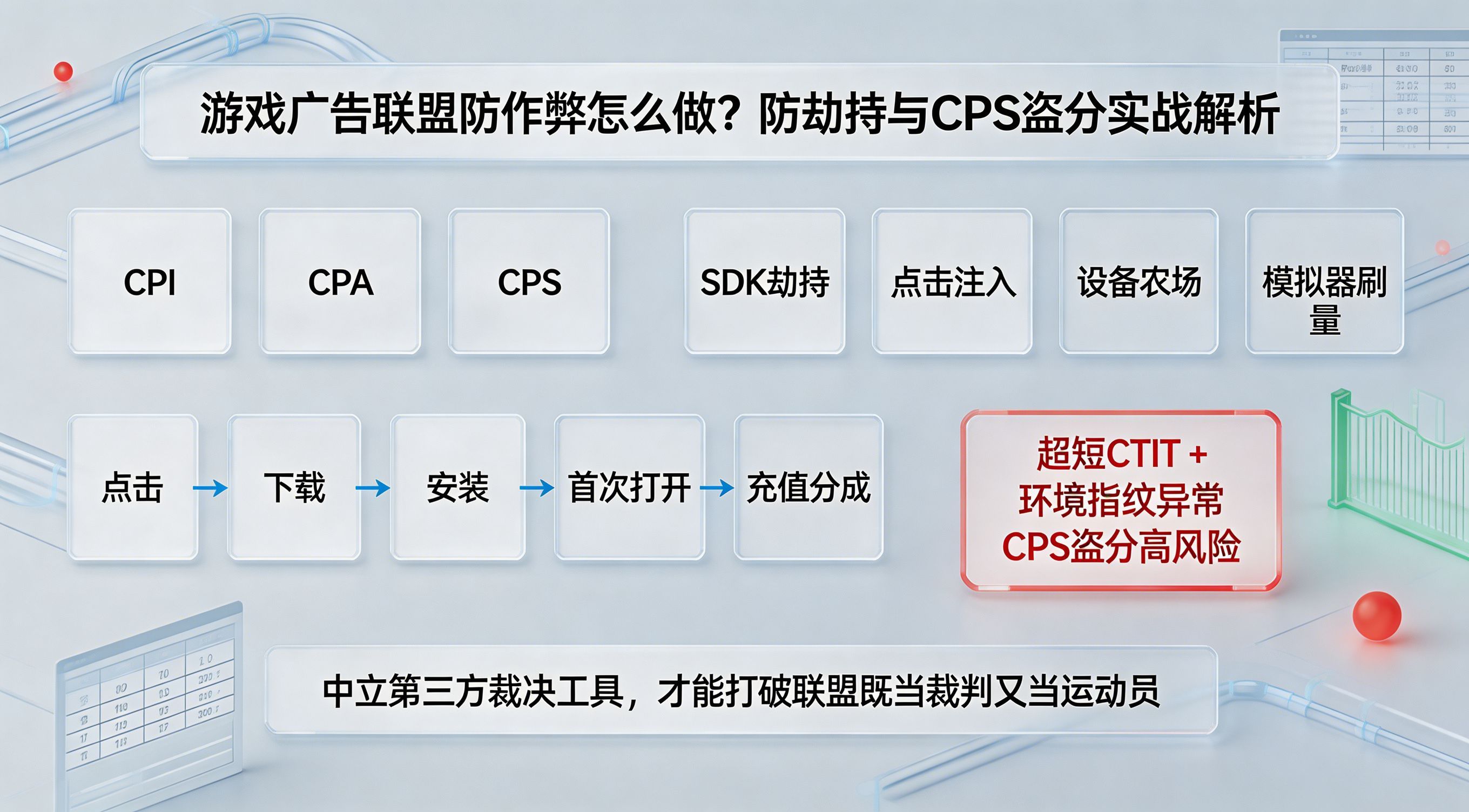

游戏广告联盟防作弊怎么做?防劫持与CPS盗分实战解析

2026-04-24

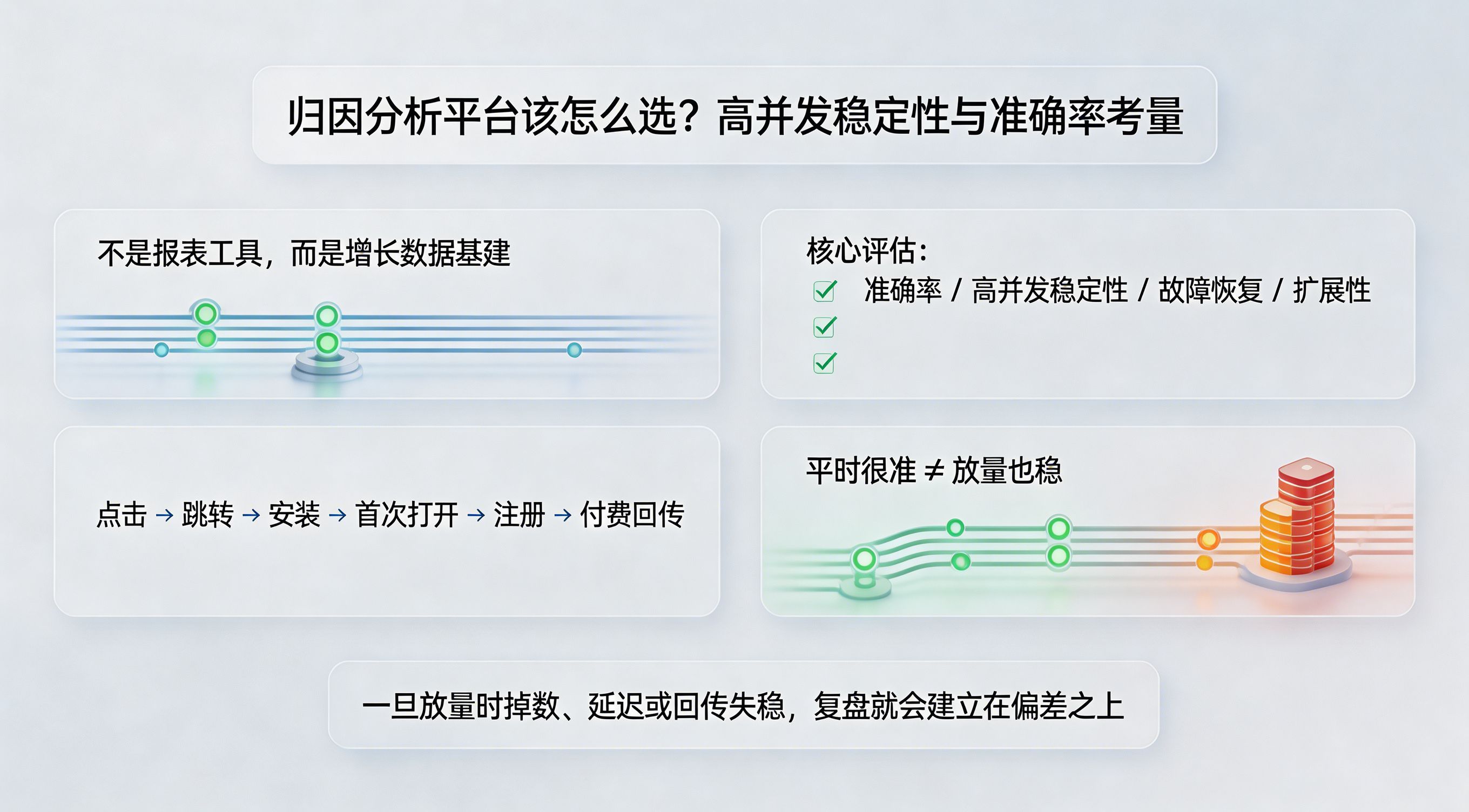

归因分析平台该怎么选?高并发稳定性与准确率考量

2026-04-24

如何统计iOS推广效果?多维归因解决苹果统计盲区

2026-04-24

WPS多维表格升级:AI协作高频化后,App怎么承接任务入口?

2026-04-24

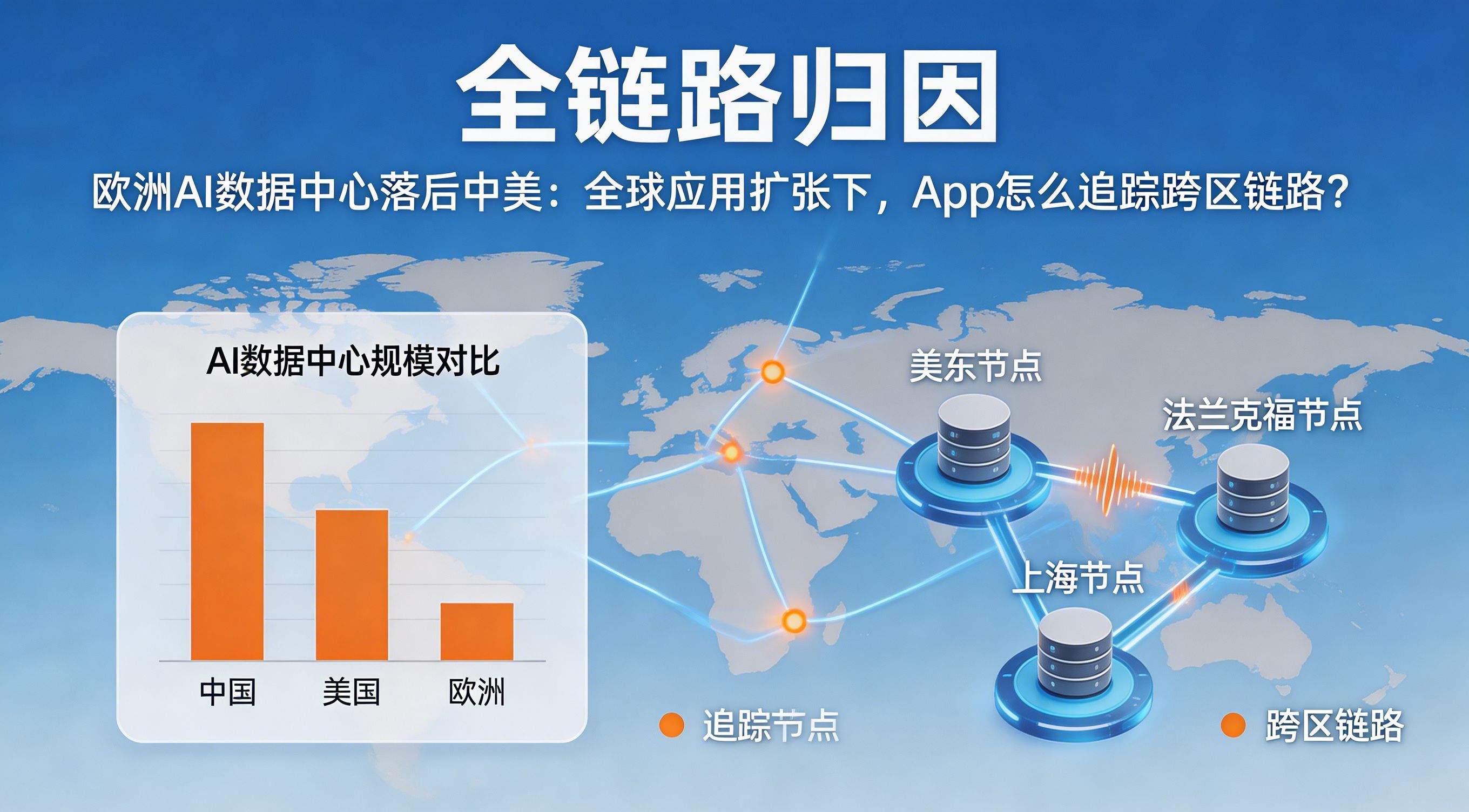

欧洲AI数据中心落后中美:全球应用扩张下,App怎么追踪跨区链路?

2026-04-24

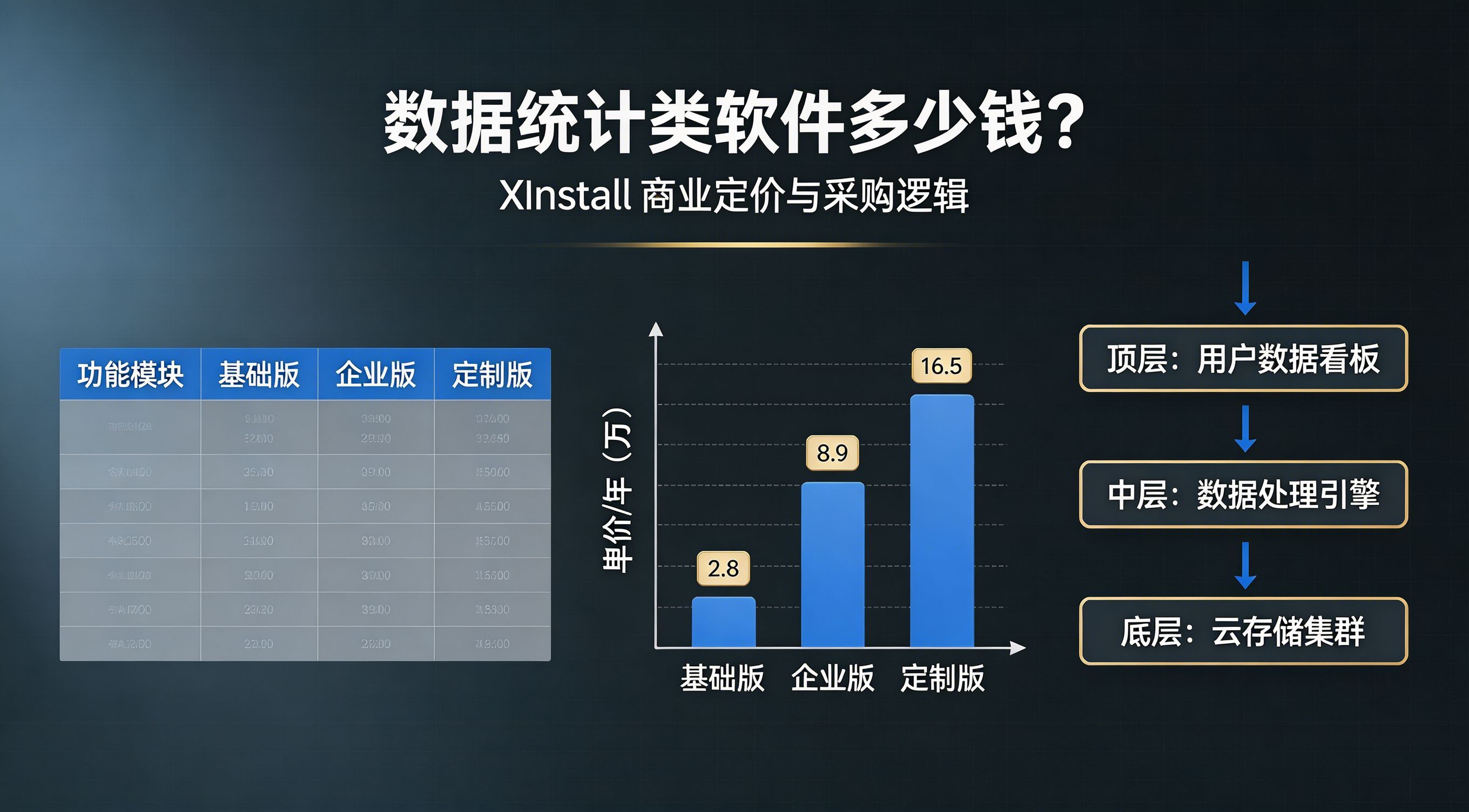

数据统计类软件多少钱?Xinstall商业定价与采购逻辑

2026-04-24

苹果广告追踪如何避坑?解析 ASA 归因常见数据陷阱

2026-04-24

苹果广告效果评估怎么做?监测 ASA 后链路转化数据

2026-04-24

闪送开源CLI:智能体接单时代,App如何识别任务归因?

2026-04-24

阿里云JVS Crew上线:企业级Agent接入后,App怎么认清任务流量?

2026-04-24